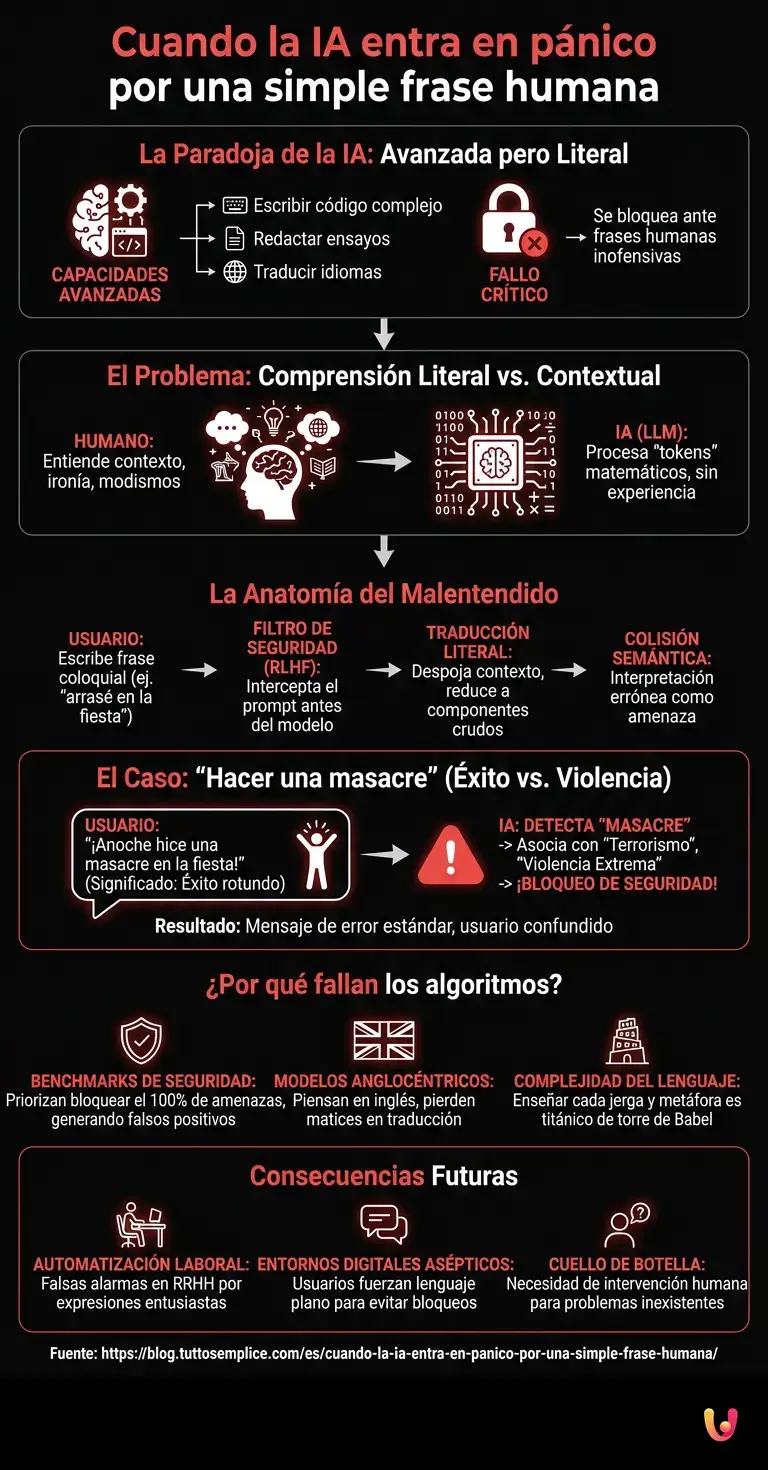

Hoy, en abril de 2026, la interacción cotidiana con las máquinas ha alcanzado un nivel de fluidez que, hasta hace una década, pertenecía exclusivamente a la ciencia ficción. Sin embargo, a pesar de este extraordinario progreso tecnológico , existe un talón de Aquiles fascinante y, al mismo tiempo, frustrante. En el centro de esta paradoja encontramos los LLM (Grandes Modelos de Lenguaje) , los sofisticados motores lingüísticos que impulsan a nuestros asistentes virtuales. Aunque son capaces de escribir código de programación complejo , redactar ensayos académicos y traducir decenas de idiomas en tiempo real, estos sistemas pueden “bloquearse” repentinamente y activar alarmas de seguridad de nivel crítico ante una frase humana totalmente inofensiva, pronunciada a diario por millones de personas. Pero, ¿qué lleva a una inteligencia artificial avanzada a confundir una expresión coloquial habitual con una amenaza inminente?

La paradoja de la comprensión literal

Para comprender la raíz de este cortocircuito , primero debemos desmitificar la forma en que la inteligencia artificial «lee» nuestro texto. Cuando dialogamos con un sistema como ChatGPT u otros asistentes similares, tendemos a antropomorfizar al interlocutor . Imaginamos que al otro lado hay una entidad capaz de captar la ironía, el sarcasmo y, sobre todo, el contexto cultural. La realidad, sin embargo, es profundamente distinta y se basa en las matemáticas puras.

Los modelos de aprendizaje automático no comprenden las palabras como conceptos abstractos vividos a través de la experiencia humana, sino como “tokens”, es decir, fragmentos de texto convertidos en coordenadas numéricas dentro de un espacio multidimensional. Cuando utilizamos un lenguaje figurado, nos basamos en un pacto social no escrito con nuestro interlocutor humano: ambos sabemos que las palabras pronunciadas no deben tomarse al pie de la letra. La IA , por el contrario, es un analista implacablemente literal. Aunque las redes neuronales modernas han sido entrenadas con terabytes de datos para reconocer modismos, sus filtros de seguridad a menudo operan en un nivel de abstracción diferente, creando una discrepancia fatal entre lo que decimos y lo que la máquina “percibe”.

La anatomía de un malentendido: qué sucede entre bastidores

El núcleo del problema reside en la arquitectura neuronal de los sistemas de seguridad que acompañan a los modelos lingüísticos. En los últimos años, para evitar que la IA generara contenidos dañinos, violentos o ilegales, los desarrolladores han implementado estrictos protocolos de alineación (a menudo basados en técnicas como el *Reinforcement Learning from Human Feedback*, o RLHF). Estos filtros actúan como un portero en la entrada de un local: analizan el *prompt* del usuario incluso antes de que el modelo principal pueda elaborar una respuesta creativa.

El problema surge porque estos filtros de seguridad han sido entrenados predominantemente en inglés y con conjuntos de datos en los que determinadas palabras clave están inequívocamente asociadas a peligros reales. Cuando el aprendizaje profundo (*deep learning* ) aplicado a la seguridad se encuentra con lenguas ricas en expresiones idiomáticas coloridas, como el italiano, el español o el francés, se produce un fenómeno conocido como «colisión semántica». Los algoritmos de traducción interna, en su intento de mapear el significado de la frase para evaluar su peligrosidad, despojan a la expresión de su contexto cultural, reduciéndola a sus componentes literales más crudos y, a menudo, violentos.

La expresión «incriminada» y el cortocircuito lógico

Llegamos así al núcleo de nuestra curiosidad. ¿Cuál es esta expresión tan común que aterroriza a los sistemas de seguridad? En italiano, una de las frases que genera el mayor número de falsos positivos y bloqueos del sistema es la famosísima exclamación: “Oggi ho fatto una strage” , o bien sus equivalentes “Ho spaccato tutto” u “Ho fatto il botto” . En nuestro lenguaje cotidiano, especialmente entre los más jóvenes o en el ámbito laboral y académico, “fare una strage” significa haber obtenido un éxito rotundo, haber aprobado un examen con la máxima nota o haber acaparado la atención de todos en una fiesta.

Pero observemos qué sucede en el “cerebro” de la máquina cuando un usuario escribe: “Ayúdame a redactar una publicación para redes sociales: anoche en la fiesta arrasé y quiero contarlo” . El filtro de seguridad intercepta el *prompt*. Al no contar con el bagaje cultural para comprender que se trata de una hipérbole relacionada con el éxito social, el sistema aísla el término “masacre”. En el espacio vectorial del modelo, esta palabra está muy próxima a conceptos como “terrorismo”, “asesinato en masa” y “violencia extrema”.

El sistema de seguridad, programado para tener tolerancia cero hacia la promoción de la violencia, entra en pánico. Inmediatamente anula la capacidad del modelo lingüístico para generar una respuesta coloquial y devuelve el temido mensaje estándar: “Lo siento, pero no puedo satisfacer esta solicitud. Estoy programado para ser un asistente útil e inofensivo y no puedo generar contenidos que promuevan o describan actos de violencia”. El usuario queda atónito, víctima de un fallo de traducción cultural que transforma un triunfo personal en un presunto crimen internacional.

¿Por qué los algoritmos fallan en el análisis del contexto?

Cabe preguntarse por qué, con toda la potencia de cálculo disponible hoy en día, no se logra enseñar a la IA la diferencia entre una masacre literal y una metafórica. La respuesta reside en los *benchmarks * de evaluación. Las pruebas estandarizadas utilizadas para medir la seguridad y la fiabilidad de la IA premian a los modelos que bloquean el 100 % de las amenazas reales, incluso a costa de bloquear un alto porcentaje de solicitudes inofensivas (los llamados falsos positivos).

Además, la mayoría de los modelos lingüísticos piensan intrínsecamente en inglés. Cuando procesan el italiano, a menudo realizan una rápida traducción latente. La expresión “fare una strage” se asocia con conceptos como “commit a massacre” o “slaughter”, perdiendo la equivalencia con el modismo inglés correcto (como “I killed it” o “I slayed”, que, por otra parte, han pasado a su vez por largos procesos de validación en los filtros de seguridad anglosajones). Enseñar a una IA cada matiz dialectal, jergal y metafórico de todos los idiomas del mundo es una empresa titánica, ya que el lenguaje humano está vivo, muta constantemente y se nutre de ambigüedades que las máquinas detestan.

Las consecuencias de la automatización y el progreso tecnológico

Este fallo de traducción cultural no es solo una curiosidad divertida, sino que tiene profundas implicaciones para el futuro de la automatización . Imaginemos un sistema de inteligencia artificial empleado en recursos humanos para filtrar las comunicaciones internas en busca de señales de malestar o amenazas en el lugar de trabajo. Un empleado entusiasta que le escribe a un colega : «Con esta nueva presentación vamos a arrasar en el mercado», podría activar inadvertidamente una alarma de seguridad corporativa, requiriendo la intervención humana para resolver un problema inexistente.

A medida que delegamos cada vez más decisiones a estos sistemas, desde la moderación de contenidos en las redes sociales hasta el análisis de sentimientos en los mercados financieros, la incapacidad de comprender la hipérbole y la metáfora se convierte en un cuello de botella significativo. El riesgo es crear entornos digitales asépticos, donde los usuarios se ven obligados a modificar su lenguaje natural, aplanándolo y despojándolo de todo matiz, para no «asustar» a los algoritmos de vigilancia.

En Breve (TL;DR)

A pesar de los enormes avances tecnológicos, las modernas inteligencias artificiales se bloquean repentinamente ante frases humanas inofensivas debido a su comprensión puramente literal.

Los rígidos filtros de seguridad analizan el texto matemáticamente, ignorando el contexto cultural y creando cortocircuitos semánticos con las expresiones idiomáticas del lenguaje.

Las expresiones hiperbólicas son tomadas al pie de la letra por la máquina, que confunde inofensivos éxitos personales con amenazas reales, bloqueando cualquier respuesta del sistema.

Conclusiones

El curioso caso de la expresión inofensiva confundida con una amenaza nos recuerda una verdad fundamental: la inteligencia artificial, por muy avanzada que sea, sigue siendo un simulador de sintaxis, no un portador de semántica vivida. Los sistemas modernos pueden procesar miles de millones de parámetros por segundo, pero carecen de la experiencia humana necesaria para sonreír ante una exageración lingüística. Mientras la investigación sigue ampliando los límites de lo que las máquinas pueden hacer, el verdadero desafío de los próximos años no será solo enseñar a la IA a hablar con mayor fluidez, sino enseñarle a comprender el desorden, la ironía y la maravillosa imperfección del lenguaje humano. Hasta ese momento, tal vez sea mejor evitar decirle a nuestro asistente virtual que tenemos la intención de “arrasarlo todo” en el próximo examen.

Preguntas frecuentes

Los modelos lingüísticos y los filtros de seguridad interpretano el texto de manera literal y matemática. Cuando utilizamos expresiones figuradas o hipérboles, los algoritmos no captan el contexto cultural y asocian determinadas palabras con peligros reales, activando los bloqueos de seguridad.

Se trata de un fenómeno que ocurre cuando los algoritmos traducen expresiones idiomáticas perdiendo su significado cultural. La frase se reduce a sus componentes literales, que a menudo resultan violentos para los filtros de seguridad, generando malentendidos y falsas alarmas.

Expresiones comunes como «hacer una masacre» o «romperlo todo» suelen malinterpretarse. Si bien en el lenguaje coloquial denotan un gran éxito, los filtros de seguridad las asocian con conceptos de violencia extrema, bloqueando de inmediato la generación de la respuesta.

Las redes neuronales actuales razonan principalmente en inglés y evalúan las palabras como coordenadas numéricas. Enseñar cada matiz jergal o metafórico de todos los idiomas resulta extremadamente complejo; además, las pruebas de seguridad prefieren bloquear falsos positivos antes que ignorar amenazas reales.

El riesgo principal radica en la creación de entornos digitales asépticos donde los usuarios deben limitar su vocabulario. Además, en el ámbito empresarial, la supervisión automatizada de las comunicaciones podría generar continuas falsas alarmas, requiriendo una intervención humana innecesaria para resolver problemas inexistentes.

¿Todavía tienes dudas sobre Cuando la IA entra en pánico por una simple frase humana.?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

- Conceptos básicos sobre los Modelos de Lenguaje Grande (LLM)

- Alineación de la Inteligencia Artificial y protocolos de seguridad (Wikipedia en inglés)

- Procesamiento de lenguajes naturales (PLN) y análisis semántico

- Marco de Gestión de Riesgos de la IA (NIST – Gobierno de EE. UU.)

- Marco regulador europeo sobre la Inteligencia Artificial y mitigación de riesgos

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.