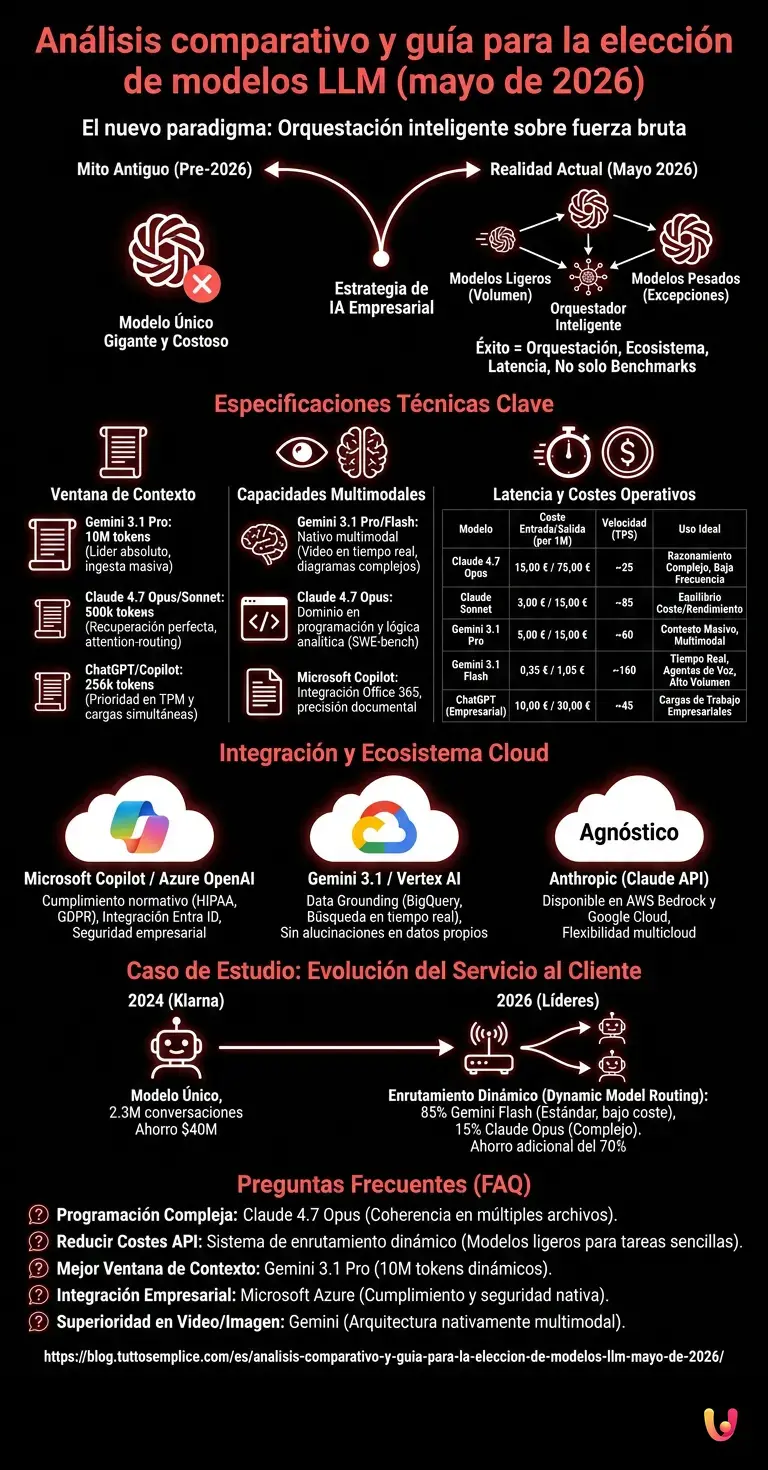

El falso mito más arraigado en el panorama actual de la inteligencia artificial es que, para obtener un rendimiento de nivel empresarial, es indispensable adoptar el modelo más grande y costoso disponible. La verdad, a mayo de 2026, es diametralmente opuesta: el éxito en producción no depende de la puntuación en los *benchmarks* de razonamiento, sino de la orquestación inteligente entre modelos ligeros para el volumen y modelos pesados para las excepciones. Esta comparativa de modelos LLM demuestra cómo el ecosistema, el *vendor lock-in* y la latencia cuentan hoy mucho más que los parámetros brutos, imponiendo a los CTO un cambio de paradigma radical en el diseño de las arquitecturas de IA.

Especificaciones técnicas y arquitecturas básicas

En esta comparativa de modelos LLM , las especificaciones técnicas revelan divergencias cruciales. Analizamos el tamaño de la ventana de contexto, los límites de tasa (RPM/TPM) y las particularidades arquitectónicas que definen las capacidades de Claude, Gemini, ChatGPT y Copilot en escenarios de producción intensiva.

En mayo de 2026, la carrera por la expansión de la ventana de contexto ha alcanzado una meseta funcional, desplazando la atención hacia la eficiencia en la recuperación de información (Generación Aumentada por Recuperación nativa). Según la documentación oficial de Google Cloud, Gemini 3.1 Pro mantiene el liderazgo absoluto con una ventana de contexto dinámica de hasta 10 millones de tokens, respaldada por una arquitectura de Mezcla de Expertos (MoE) altamente paralelizada. Esto permite la ingesta de repositorios de código completos o archivos de vídeo sin fragmentación.

Por otro lado, Claude 4.7 Opus y la última iteración de Claude Sonnet se sitúan en una ventana de 500.000 tokens. Sin embargo, Anthropic ha implementado un mecanismo de *attention-routing* que garantiza una recuperación perfecta (100 % en la prueba *Needle-in-a-Haystack*) incluso en los límites extremos del contexto, reduciendo las alucinaciones estructurales. ChatGPT (en su versión empresarial basada en la arquitectura GPT-4.5/5 ) y Microsoft Copilot ofrecen ventanas estandarizadas de 256.000 tokens, priorizando límites de tasa (TPM - *Tokens Per Minute*) extremadamente elevados para satisfacer las cargas de trabajo empresariales simultáneas.

Capacidades multimodales y razonamiento complejo

Evaluar el razonamiento complejo es fundamental en una comparativa actualizada de modelos LLM . Examinamos el rendimiento en los benchmarks más recientes de programación avanzada , lógica matemática *zero-shot* y análisis nativo de imágenes y documentos complejos.

Las capacidades de razonamiento se han bifurcado en dos categorías distintas: lógica analítica (programación y matemáticas) y comprensión multimodal nativa. En el ámbito del desarrollo de software, Claude 4.7 Opus domina de forma indiscutible. En los benchmarks SWE-bench actualizados a 2026, Opus resuelve de manera autónoma más del 48 % de las incidencias complejas de GitHub, superando a ChatGPT gracias a su capacidad superior para mantener la coherencia lógica en múltiples archivos.

En lo que respecta a la multimodalidad, Gemini 3.1 Pro y Gemini 3.1 Flash operan sobre una arquitectura nativamente multimodal desde el preentrenamiento. Esto significa que no traducen las imágenes o el audio a texto antes del procesamiento, sino que mapean los píxeles y las frecuencias directamente en el espacio latente. El resultado es una superioridad aplastante en el análisis de vídeo en tiempo real y en la lectura de planos o diagramas industriales complejos. Microsoft Copilot , integrado en el ecosistema Office 365, destaca, por el contrario, en el razonamiento documental, cruzando datos entre Excel, Word y Teams con una precisión semántica inigualable para las tareas administrativas.

Latencia, velocidad de inferencia y costes operativos

La optimización del presupuesto requiere una comparación exhaustiva de los modelos LLM, basada en los costes por millón de tokens y en la latencia. Descubramos qué modelos ofrecen la mejor relación entre tokens por segundo (TPS) y gasto en infraestructura para las empresas.

El verdadero campo de batalla de 2026 es la eficiencia económica. Los modelos "Frontier" (Opus, GPT de nivel máximo) son insostenibles para tareas de gran volumen, como la clasificación de registros o la atención al cliente de primer nivel. Aquí es donde entran en juego los modelos optimizados .

| Modelo LLM | Coste de los insumos (por 1M) | Costo de salida (por 1M) | Velocidad (TPS) |

|---|---|---|---|

| Claude 4.7 Opus | 15,00 € | 75,00 € | ~25 |

| Claude Sonnet | 3,00 € | 15,00 € | ~85 |

| Gemini 3.1 Pro | 5,00 € | 15,00 € | ~60 |

| Gemini 3.1 Flash | 0,35 € | 1,05 € | ~160 |

| ChatGPT (Empresarial) | 10,00 € | 30,00 € | ~45 |

Según la documentación oficial de Google, Gemini 3.1 Flash ofrece una velocidad de inferencia de aproximadamente 160 tokens por segundo (TPS), lo que lo hace ideal para aplicaciones en tiempo real y agentes de voz. Claude Sonnet se posiciona como el mejor equilibrio del mercado: ofrece capacidades de razonamiento cercanas a las de los modelos de gama alta de 2025, pero a una quinta parte del coste de Opus y con una latencia imperceptible para el usuario final.

Integración, ecosistema y plataformas en la nube

Ninguna comparativa de modelos LLM está completa sin analizar el *vendor lock-in* y la infraestructura. Comparamos las ventajas de las API de Anthropic y OpenAI con las plataformas empresariales integradas, como Google Cloud Vertex AI y Microsoft Azure.

La elección del modelo está intrínsecamente ligada a la infraestructura en la nube preexistente de la empresa. Microsoft Copilot y los modelos de OpenAI a través de Azure ofrecen la ventaja insuperable del cumplimiento normativo empresarial (HIPAA, GDPR estricto) y de la integración nativa con Entra ID (anteriormente Azure AD) para la gestión de permisos a nivel de documento individual. Si una empresa ya utiliza el ecosistema de Microsoft, la adopción de Azure OpenAI reduce los tiempos de lanzamiento al mercado en un 60%.

Gemini 3.1 en Google Cloud Vertex AI destaca en el Data Grounding . Permite anclar las respuestas del modelo directamente a las bases de datos empresariales (BigQuery, AlloyDB) y a la Búsqueda de Google en tiempo real, eliminando de hecho las alucinaciones sobre los datos propietarios. Anthropic , a pesar de no contar con una nube propia, ha adoptado una estrategia agnóstica: las API de Claude están disponibles en AWS Bedrock y Google Cloud, ofreciendo la máxima flexibilidad para las arquitecturas multicloud.

Caso de estudio: La evolución del servicio al cliente (2024-2026)

En 2024, Klarna fue noticia al gestionar 2,3 millones de conversaciones (dos tercios del total) con un asistente de IA basado en OpenAI, reduciendo los tiempos de resolución de 11 a 2 minutos y estimando un ahorro de 40 millones de dólares. En mayo de 2026, las empresas líderes han evolucionado este enfoque implementando el *Dynamic Model Routing *. En lugar de utilizar un único modelo pesado, un enrutador de IA analiza la intención del usuario en milisegundos: el 85 % de las solicitudes estándar es gestionado por Gemini 3.1 Flash (coste casi nulo, latencia instantánea), mientras que solo el 15 % de los casos complejos (p. ej., disputas legales o reembolsos anómalos) se deriva a Claude 4.7 Opus. Este enfoque híbrido ha reducido aún más los costes operativos en un 70 % con respecto a 2024, manteniendo inalterada la satisfacción del cliente.

Conclusiones

Como conclusión de esta comparativa de modelos LLM , presentamos la matriz de decisión definitiva. Elegir el modelo adecuado depende del equilibrio entre el volumen de llamadas, la necesidad de razonamiento zero-shot y los requisitos de integración empresarial.

No existe un ganador absoluto, pero sí opciones óptimas según el escenario de uso:

- Tareas de alto volumen y baja latencia (chatbots, triaje, extracción de datos básicos): el ganador indiscutible es Gemini 3.1 Flash . Su coste irrisorio y su velocidad extrema lo convierten en el único candidato lógico para operaciones a gran escala.

- Razonamiento Zero-Shot extremo y programación compleja: Claude 4.7 Opus sigue siendo el estándar de oro. Es la inversión necesaria cuando la precisión lógica es crítica y el error humano o de la máquina conllevaría costes elevados.

- Equilibrio calidad-precio (la opción de uso diario): Claude Sonnet representa el punto de equilibrio perfecto para el 80 % de las aplicaciones empresariales que requieren una buena capacidad de razonamiento sin agotar el presupuesto de la API.

- Integración empresarial y seguridad documental: Microsoft Copilot y el ecosistema ChatGPT en Azure destacan por su facilidad de implementación en entornos corporativos altamente regulados.

La estrategia ganadora para 2026 no consiste en elegir un único modelo, sino en construir una arquitectura de enrutamiento que dirija dinámicamente cada prompt al modelo más eficiente para esa tarea específica.

Preguntas frecuentes

Para el desarrollo de software y el razonamiento lógico avanzado, Claude 4.7 Opus representa el estándar de referencia. Gracias a su excepcional capacidad para mantener la coherencia en múltiples archivos, resuelve problemas complejos de forma autónoma, superando a las alternativas del mercado. Es la herramienta ideal cuando la precisión del código resulta fundamental para el proyecto.

La estrategia más eficaz consiste en la creación de un sistema de enrutamiento dinámico de solicitudes. En lugar de utilizar un único modelo costoso para cada operación, un enrutador inteligente analiza el propósito del *prompt* y asigna las tareas sencillas a soluciones económicas como Gemini 3.1 Flash. Las operaciones complejas se derivan hacia modelos avanzados, reduciendo drásticamente los gastos de la empresa.

Gemini 3.1 Pro domina este sector gracias a una ventana dinámica que alcanza los diez millones de tokens, lo que permite analizar archivos completos sin fragmentación. Sin embargo, Claude 4.7 Opus y Sonnet garantizan una recuperación perfecta de la información incluso en los límites de su contexto, reduciendo al mínimo las alucinaciones estructurales durante la lectura de textos extensos.

Elegir el sistema de Microsoft ofrece enormes ventajas en términos de cumplimiento normativo y seguridad de los datos empresariales. Esta solución garantiza una integración nativa para la gestión de permisos en documentos individuales. Por lo tanto, resulta la opción óptima para las corporaciones altamente reguladas que requieren un control riguroso de los accesos y de la información sensible.

Las versiones Pro y Flash de Gemini operan sobre una arquitectura nativamente multimodal desde la fase de entrenamiento base. Esto significa que no necesitan traducir los contenidos visuales o de audio a texto antes de procesarlos, sino que mapean los datos directamente. El resultado es una precisión altísima en la comprensión de vídeos en tiempo real y diagramas industriales complejos.

¿Todavía tienes dudas sobre Análisis comparativo y guía para la elección de modelos LLM (mayo de 2026)?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

- NIST - Estándares y evaluación de modelos de Inteligencia Artificial

- Wikipedia - Modelo de lenguaje grande (Arquitectura y características)

- Comisión Europea - Marco normativo y adopción empresarial de la Inteligencia Artificial

- Wikipedia - Mixture of experts (Arquitectura MoE utilizada en modelos avanzados)

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.