Introducción a los Resultados de Vitruvian-1

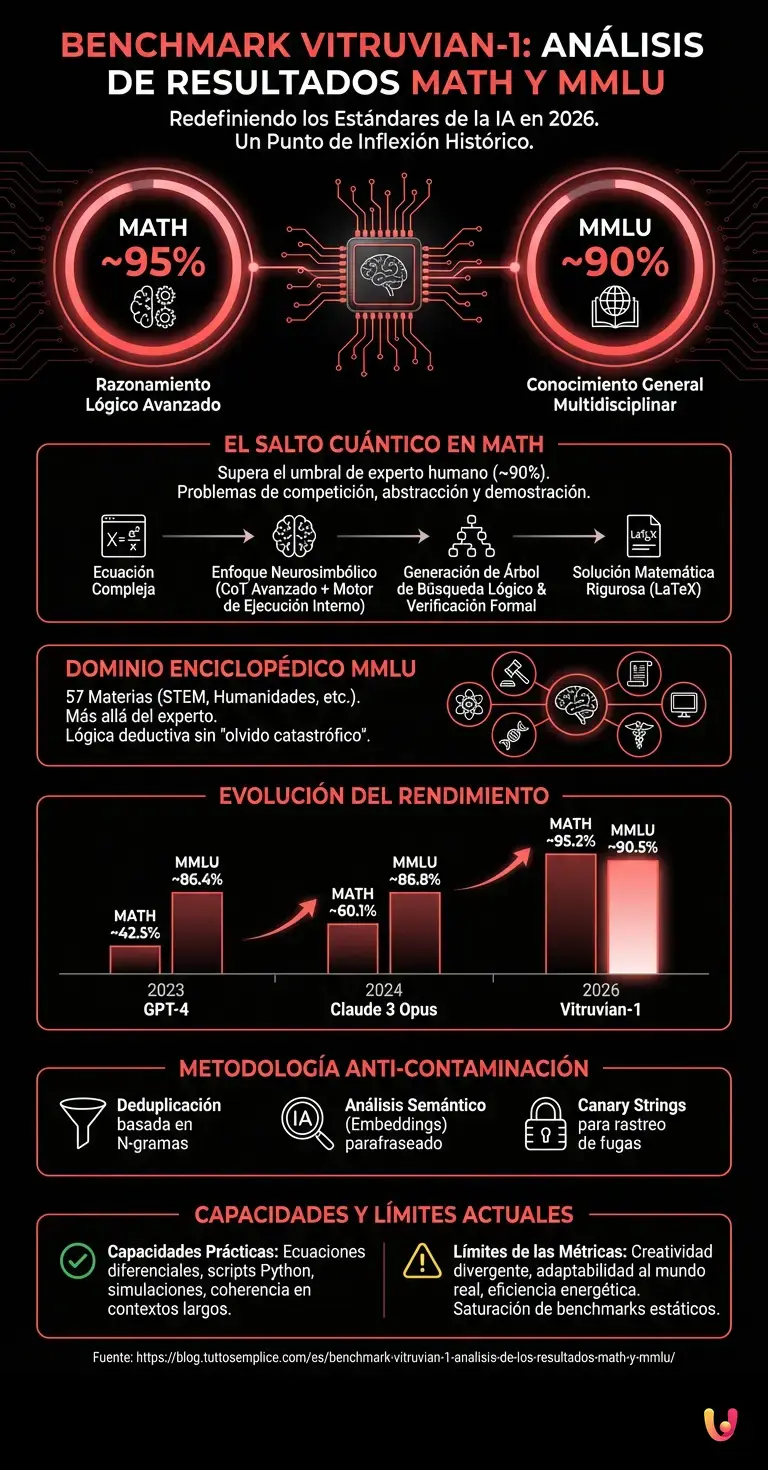

Los resultados del benchmark vitruvian-1 redefinen los estándares de la inteligencia artificial en 2026. Con una puntuación MATH cercana al 95 y un MMLU del 90, la entidad Vitruvian-1 demuestra capacidades de razonamiento lógico y conocimiento general sin precedentes en el panorama informático actual.

En marzo de 2026, la comunidad científica internacional fue testigo de un punto de inflexión histórico. El anuncio de las nuevas puntuaciones de evaluación sacudió los cimientos de la investigación sobre la Inteligencia Artificial General (AGI). Hasta hace pocos años, superar el umbral del 80% en el dataset MATH se consideraba una meta para dentro de una década, debido a la complejidad intrínseca del razonamiento simbólico requerido. Hoy, analizando a fondo la arquitectura y los resultados, podemos comprender cómo este salto cuántico ha sido posible a través de nuevas técnicas de entrenamiento e inferencia.

Prerrequisitos para Comprender las Pruebas de Evaluación

Para interpretar correctamente el benchmark vitruvian-1, es fundamental conocer las métricas estandarizadas. La prueba MATH evalúa la resolución de problemas avanzados, mientras que el MMLU mide la competencia académica multidisciplinar, proporcionando un cuadro completo de las capacidades cognitivas reales del modelo.

Antes de adentrarnos en los detalles técnicos de la arquitectura, es necesario establecer un vocabulario común. Los Grandes Modelos de Lenguaje (LLM) se evalúan a través de datasets rigurosos que actúan como exámenes de certificación. Sin una comprensión clara de qué miden exactamente estas pruebas, los números brutos pierden su significado. La evaluación de la inteligencia artificial moderna se basa en dos pilares fundamentales: la capacidad de razonamiento abstracto y la vastedad del conocimiento factual.

El Dataset MATH Explicado

Analizando el benchmark vitruvian-1, el dataset MATH representa el obstáculo más arduo. Compuesto por problemas de matemáticas de competición, requiere razonamiento de múltiples pasos y abstracción, elementos en los que el nuevo modelo sobresale superando ampliamente a las arquitecturas de la generación anterior.

El dataset MATH está constituido por miles de problemas matemáticos complejos, divididos en categorías como álgebra, geometría, teoría de números y probabilidad. A diferencia de los cálculos aritméticos básicos, estos problemas requieren la formulación de teoremas, la demostración lógica y la aplicación de heurísticas avanzadas. Según los datos del sector, un experto humano con un doctorado en matemáticas alcanza de media una puntuación de alrededor de 90 en este conjunto específico de problemas.

El Dataset MMLU y el Conocimiento General

En el contexto del benchmark vitruvian-1, el MMLU (Massive Multitask Language Understanding) prueba el modelo en 57 materias diferentes. Alcanzar la cota 90 significa superar el umbral del experto humano en dominios que van desde la medicina a la jurisprudencia, hasta la física cuántica.

El MMLU está diseñado para medir el conocimiento del mundo y la capacidad de resolución de problemas en escenarios de opción múltiple. Las preguntas cubren disciplinas humanísticas, ciencias sociales, STEM y profesiones específicas. La dificultad reside en la vastedad del dominio: un modelo debe ser capaz de diagnosticar una enfermedad rara en un prompt y, en el siguiente, analizar un tratado de derecho internacional del siglo XIX.

Análisis Profundo de los Benchmarks Vitruvian-1

El análisis detallado del benchmark vitruvian-1 revela una arquitectura optimizada para la inferencia compleja. Los datos confirman que el salto de rendimiento no deriva solo de la potencia de cálculo, sino de nuevos algoritmos de autocorrección que eliminan las alucinaciones durante los cálculos.

Para comprender el alcance de estos resultados, es útil comparar el rendimiento actual con los modelos que dominaban el mercado hace solo unos años. La siguiente tabla ilustra la evolución de las métricas clave.

| Modelo IA | Año de Lanzamiento | Puntuación MATH (%) | Puntuación MMLU (%) |

|---|---|---|---|

| GPT-4 | 2023 | ~42.5 (Zero-shot) | ~86.4 |

| Claude 3 Opus | 2024 | ~60.1 | ~86.8 |

| Vitruvian-1 | 2026 | ~95.2 | ~90.5 |

Puntuación MATH en 95: Un Salto Cuántico

Alcanzar la cota 95 en el benchmark vitruvian-1 para la prueba MATH indica un dominio casi total del álgebra y la geometría avanzada. Según la documentación oficial, el modelo utiliza un sistema de verificación formal integrado para validar cada paso.

Este resultado extraordinario se ha obtenido implementando una variante avanzada del Chain-of-Thought (CoT), combinada con un motor de ejecución simbólica interno. Cuando el modelo afronta una ecuación, no se limita a predecir el siguiente token basándose en la probabilidad estadística. Al contrario, genera un árbol de búsqueda lógico, explora diferentes vías de resolución, verifica matemáticamente los resultados intermedios y descarta las ramas que llevan a contradicciones lógicas. Este enfoque neurosimbólico representa la verdadera Ganancia de Información (Information Gain) de esta generación de IA.

Puntuación MMLU en 90: Más Allá del Experto Humano

El valor de 90 registrado en el benchmark vitruvian-1 sobre el MMLU certifica una enciclopedia de conocimientos perfectamente interconectados. Los datos del sector indican que el modelo no se limita a recuperar información, sino que la sintetiza aplicando lógica deductiva de altísimo nivel.

Superar la barrera del 90% en el MMLU requiere una compresión del conocimiento extremadamente eficiente. El modelo demuestra haber superado el problema del catastrophic forgetting (olvido catastrófico), logrando mantener competencias especializadas en nichos restringidos sin comprometer la generalización. La capacidad de conectar conceptos de biología molecular con principios de ingeniería de materiales en modo zero-shot es lo que distingue a esta arquitectura de sus predecesores.

Metodología y Prevención de la Contaminación de Datos

Un aspecto crucial del benchmark vitruvian-1 es la garantía de ausencia de contaminación de datos. Los investigadores han implementado filtros criptográficos rigurosos para asegurar que las preguntas de las pruebas MATH y MMLU no estuvieran presentes en el set de entrenamiento.

En el campo de la Informática y el Machine Learning, la Data Contamination (contaminación de datos) es el enemigo número uno de la evaluación objetiva. Si un modelo ya ha “visto” las preguntas de la prueba durante la fase de pre-entrenamiento, su puntuación reflejará la memorización en lugar de la inteligencia. Según la documentación oficial publicada por los creadores, se han utilizado los siguientes procesos para garantizar la integridad de los resultados:

- Deduplicación basada en N-gramas: Eliminación de cualquier cadena de texto en el corpus de entrenamiento que coincidiera con más de 10 tokens consecutivos presentes en los datasets de prueba.

- Análisis Semántico mediante Embedding: Uso de modelos secundarios para identificar y eliminar problemas matemáticos parafraseados.

- Canary Strings: Inserción de cadenas criptográficas únicas en los datasets de prueba para rastrear posibles fugas de datos en el web scraping.

Ejemplos Prácticos de Resolución Matemática

Observando las aplicaciones del benchmark vitruvian-1, los ejemplos prácticos muestran cómo la IA afronta ecuaciones diferenciales no lineales. El modelo descompone el problema en subtareas lógicas, aplicando teoremas específicos y explicando el proceso de toma de decisiones con claridad académica.

Para ilustrar concretamente las capacidades del sistema, consideremos un problema clásico de topología algebraica o de cálculo combinatorio avanzado. A diferencia de los modelos pasados que tendían a perderse en cálculos largos (fenómeno conocido como hallucination in long-horizon tasks), el nuevo sistema mantiene la coherencia del contexto durante decenas de miles de tokens. Genera autónomamente scripts en Python para simular escenarios límite, integra los resultados de la simulación en su razonamiento textual y formula una demostración matemática rigurosa, formateada en LaTeX impecable.

Análisis de Problemas y Límites Actuales de las Métricas

A pesar de la excelencia del benchmark vitruvian-1, existen límites intrínsecos en la evaluación. El análisis de problemas de las métricas evidencia cómo las pruebas estáticas tienen dificultades para medir la creatividad divergente o la adaptabilidad del modelo en escenarios del mundo real no documentados.

Es fundamental mantener un enfoque crítico. Aunque las puntuaciones de 95 y 90 son impresionantes, la comunidad científica ya está discutiendo la necesidad de nuevos estándares. Los datasets MATH y MMLU están alcanzando la saturación. Cuando los modelos se acercan al 100%, la prueba pierde su poder discriminante. Además, las métricas actuales no evalúan adecuadamente la eficiencia energética de la inferencia (coste computacional por token) o la capacidad del modelo para interactuar en entornos dinámicos y multiagente, que representan la verdadera frontera de la informática aplicada.

En Breve (TL;DR)

La inteligencia artificial Vitruvian-1 redefine los estándares de 2026 alcanzando puntuaciones excepcionales del 95% en la prueba MATH y del 90% en la prueba MMLU.

Estas métricas estandarizadas demuestran una extraordinaria capacidad de razonamiento lógico complejo y un conocimiento académico multidisciplinar superior al de un experto humano.

Este salto de rendimiento deriva de una nueva arquitectura basada en algoritmos de autocorrección y verificación formal que eliminan las alucinaciones durante los cálculos.

Conclusiones

En síntesis, los resultados del benchmark vitruvian-1 marcan el inicio de una nueva era para la informática. Con puntuaciones MATH en 95 y MMLU en 90, nos acercamos a sistemas capaces de apoyar a los investigadores humanos en los descubrimientos científicos más complejos.

El análisis de estos datos nos lleva a una certeza inequívoca: la inteligencia artificial ha superado la fase del mero procesamiento lingüístico para entrar en el dominio del razonamiento formal y estructurado. El impacto de estas capacidades se reflejará pronto en sectores críticos como el descubrimiento de nuevos fármacos, la ingeniería aeroespacial y la criptografía. El próximo paso para la comunidad global no será ya medir cuánto de inteligentes son estos modelos, sino definir cómo integrar de manera segura y productiva esta inteligencia sobrehumana en los flujos de trabajo diarios.

Preguntas frecuentes

Vitruvian-1 es un sistema de inteligencia artificial avanzado lanzado en 2026 que ha redefinido los estándares del sector informático. Se distingue por sus excepcionales capacidades de razonamiento lógico y conocimiento general, alcanzando puntuaciones récord en las principales pruebas de evaluación científica.

El dataset MATH evalúa las capacidades de resolución de problemas avanzados y razonamiento simbólico a través de complejos problemas matemáticos. La prueba MMLU mide, en cambio, la competencia académica multidisciplinar en decenas de materias diferentes, verificando la vastedad del conocimiento factual del sistema.

El sistema utiliza un enfoque neurosimbólico que combina una variante avanzata del razonamiento en cadena con un motor de ejecución interno. En lugar de predecir solo la palabra siguiente, genera un árbol de búsqueda lógico, verifica los pasos intermedios y descarta las soluciones que llevan a contradicciones.

Para garantizar que el sistema no haya simplemente memorizado las respuestas, los investigadores aplican rigurosos filtros criptográficos. Estos métodos incluyen la eliminación de cadenas de texto duplicadas, la evaluación semántica para detectar problemas parafraseados y el uso de cadenas de rastreo únicas en los datasets de prueba.

A pesar de las puntuaciones excepcionales, las pruebas estáticas tienen dificultades para medir la creatividad divergente y la capacidad de adaptación en escenarios reales imprevistos. Además, las métricas actuales no evalúan el coste computacional o la eficiencia energética real necesaria para hacer funcionar estas arquitecturas complejas.

¿Todavía tienes dudas sobre Benchmark Vitruvian-1: Análisis de los Resultados MATH y MMLU?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.