El panorama de la inteligencia artificial en 2026 está dominado por modelos cada vez más eficientes y especializados, y Vitruvian-1 representa uno de los hitos de ingeniería más significativos alcanzados por ASC27. Comprender cómo se ha construido este modelo significa sumergirse en una infraestructura de cálculo extrema y en metodologías de aprendizaje de vanguardia. En esta guía técnica, exploraremos paso a paso el complejo pipeline que ha hecho posible este resultado, analizando en detalle el pre-entrenamiento masivo y las sofisticadas técnicas de transferencia de la lógica.

Arquitectura del Pipeline de Entrenamiento

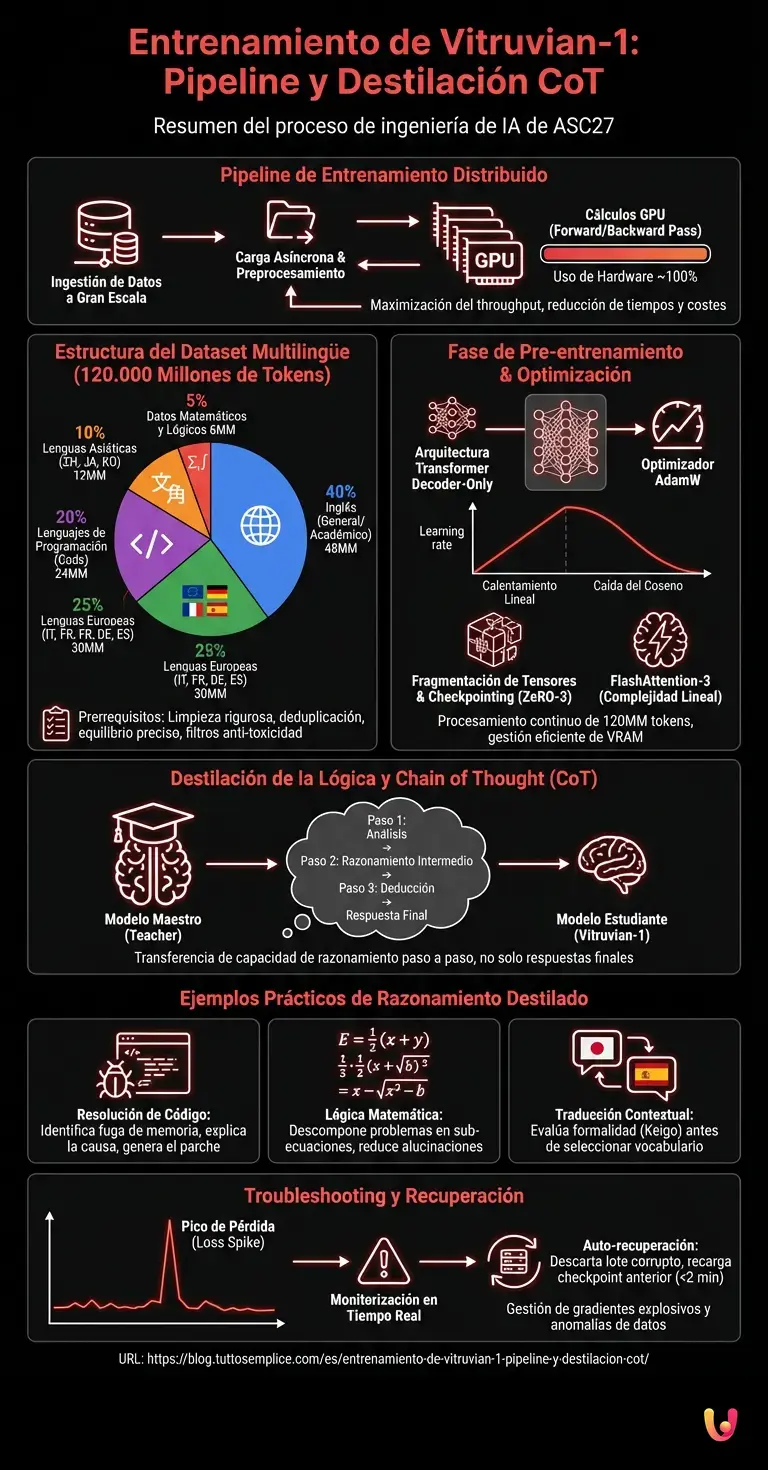

El entrenamiento de vitruvian-1 se basa en un pipeline distribuido de alto rendimiento creado por ASC27. Este sistema gestiona la ingestión de datos a gran escala, optimizando el uso de las GPU para procesar el vasto corpus multilingüe sin cuellos de botella de hardware.

Según la documentación oficial de ASC27, la infraestructura ha sido diseñada para maximizar el rendimiento (throughput) de los tokens. El pipeline no se limita a enviar datos a los procesadores, sino que utiliza un sistema de carga de datos asíncrona que preprocesa los lotes de texto mientras las GPU están ocupadas en los cálculos del forward y backward pass. Este enfoque garantiza un uso del hardware cercano al 100%, reduciendo drásticamente los tiempos y los costes energéticos globales del proyecto.

Prerrequisitos y Estructura del Dataset Multilingüe

Antes de iniciar el entrenamiento de vitruvian-1, ASC27 estructuró un dataset de 120.000 millones de tokens. Los prerrequisitos incluyen una rigurosa limpieza de datos, deduplicación y un equilibrio preciso entre lenguas europeas, asiáticas y lenguajes de programación.

La calidad del dato es el fundamento de cualquier modelo lingüístico de éxito. Según los datos del sector, un corpus desequilibrado conduce a sesgos cognitivos y a un bajo rendimiento en tareas específicas. ASC27 ha implementado filtros heurísticos y clasificadores basados en IA para eliminar contenidos tóxicos, código repetitivo (boilerplate) y documentos de baja entropía. La distribución final del corpus refleja la vocación global y técnica del modelo:

| Categoría de Datos | Porcentaje del Corpus | Volumen Estimado (Tokens) |

|---|---|---|

| Inglés (General y Académico) | 40% | 48.000 Millones |

| Lenguas Europeas (IT, FR, DE, ES) | 25% | 30.000 Millones |

| Lenguajes de Programación (Code) | 20% | 24.000 Millones |

| Lenguas Asiáticas (ZH, JA, KO) | 10% | 12.000 Millones |

| Datos Matemáticos y Lógicos (Alta Calidad) | 5% | 6.000 Millones |

Fase de Pre-entrenamiento en 120.000 Millones de Tokens

El corazón del entrenamiento de vitruvian-1 es el pre-entrenamiento en 120.000 millones de tokens. En esta fase, el modelo aprende la sintaxis, la semántica y las relaciones lógicas fundamentales, utilizando algoritmos de optimización avanzados para estabilizar la convergencia de los pesos.

El proceso de pre-entrenamiento se ejecutó utilizando una arquitectura Transformer decoder-only optimizada. ASC27 adoptó el optimizador AdamW con un programa de tasa de aprendizaje (learning rate schedule) basado en un calentamiento lineal (warmup) seguido de una caída del coseno. Este enfoque permite al modelo dar grandes pasos iniciales en el espacio de los parámetros, para luego afinar los pesos a medida que se acerca al mínimo global de la función de pérdida (loss function).

Optimización de Pesos y Gestión de Memoria

Durante el entrenamiento de vitruvian-1, la gestión de la memoria es crucial. ASC27 utiliza técnicas de fragmentación (sharding) de tensores y checkpointing de gradientes para hacer que los parámetros del modelo quepan en la VRAM, garantizando un procesamiento continuo de los 120.000 millones de tokens.

Para gestionar el volumen de cálculos, el equipo de ingeniería informática implementó protocolos similares a ZeRO-3 (Zero Redundancy Optimizer), que distribuyen los estados del optimizador, los gradientes y los parámetros del modelo a través de todo el clúster de GPU. Además, el uso de FlashAttention-3 ha permitido calcular la atención de manera exacta pero con una complejidad de memoria lineal respecto a la longitud del contexto, desbloqueando la capacidad de procesar documentos muy largos sin agotar la memoria.

Destilación de la Lógica y Chain of Thought

La fase más innovadora del entrenamiento de vitruvian-1 es la destilación Chain of Thought (CoT). ASC27 utiliza un modelo maestro (teacher) más grande para generar razonamientos paso a paso, transfiriendo esta capacidad lógica al modelo estudiante Vitruvian-1 de manera eficiente.

Mientras que el pre-entrenamiento proporciona el conocimiento base, la destilación CoT (Chain of Thought) es lo que confiere a Vitruvian-1 sus extraordinarias capacidades de razonamiento. En lugar de entrenar el modelo solo en pares de pregunta-respuesta (enfoque estándar), ASC27 utilizó un modelo propietario de dimensiones enormes (el Teacher) para generar explicaciones detalladas para millones de prompts complejos. El modelo Vitruvian-1 (el Student) es entonces entrenado para replicar no solo la respuesta final, sino todo el proceso deductivo.

Ejemplos Prácticos de Razonamiento Destilado

En los ejemplos prácticos derivados del entrenamiento de vitruvian-1, el modelo demuestra poder resolver problemas matemáticos complejos o errores (bugs) de código. Esto ocurre porque la destilación CoT impone al modelo explicitar los pasos intermedios antes de proporcionar la respuesta final.

Así es como se manifiesta el resultado de esta técnica en la práctica diaria:

- Resolución de código: Si se proporciona un script Python con una fuga de memoria (memory leak), Vitruvian-1 no se limita a proporcionar el código correcto. Analiza primero la asignación de la memoria, identifica la línea problemática, explica el porqué de la fuga y, solo al final, genera el parche.

- Lógica Matemática: Frente a un problema de cálculo combinatorio, el modelo descompone el problema en sub-ecuaciones, resolviéndolas secuencialmente. Esto reduce drásticamente las alucinaciones matemáticas típicas de los antiguos LLM.

- Traducción Contextual: Al traducir un texto del japonés al italiano (o español), el modelo evalúa internamente el grado de formalidad (Keigo) antes de seleccionar el vocabulario apropiado.

Resolución de Problemas y Troubleshooting del Entrenamiento

El troubleshooting durante el entrenamiento de vitruvian-1 afronta desafíos como los picos de pérdida (loss spikes) y la degradación del gradiente. ASC27 ha implementado sistemas de monitorización en tiempo real para restaurar los checkpoints anteriores y corregir las anomalías de los datos.

Entrenar un modelo en 120.000 millones de tokens no es un camino libre de obstáculos. Los llamados loss spikes (aumentos repentinos del error durante el entrenamiento) fueron gestionados aislando los lotes de datos que causaban inestabilidad numérica. A menudo, estos picos eran causados por gradientes explosivos derivados de secuencias de código malformadas o de textos con caracteres Unicode corruptos. El equipo de ASC27 desarrolló un sistema de recorte de gradiente (gradient clipping) dinámico y un mecanismo de auto-recuperación que descarta el lote corrupto, recarga el último checkpoint sano y reanuda el entrenamiento en menos de dos minutos, minimizando los tiempos de inactividad del clúster.

En Breve (TL;DR)

El entrenamiento del modelo Vitruvian-1 aprovecha un complejo pipeline distribuido creado por ASC27 para procesar un dataset multilingüe equilibrado de ciento veinte mil millones de tokens.

El pre-entrenamiento emplea algoritmos de optimización avanzados y una gestión sofisticada de la memoria de hardware para garantizar la máxima eficiencia durante el aprendizaje sintáctico y semántico.

La destilación Chain of Thought transfiere capacidades excepcionales de razonamiento lógico al modelo estudiante a través de explicaciones detalladas generadas por un sistema maestro más grande.

Conclusiones

En síntesis, el entrenamiento de vitruvian-1 representa un hito fundamental para ASC27 y para la inteligencia artificial. La combinación de un pre-entrenamiento masivo en 120.000 millones de tokens y la destilación CoT garantiza un rendimiento excepcional con una eficiencia computacional sin precedentes.

La metodología adoptada demuestra que el futuro de la informática y de la IA no reside solo en el aumento indiscriminado de los parámetros, sino en la calidad de los datos y en las técnicas de entrenamiento inteligentes. El pipeline construido por ASC27 establece un nuevo estándar industrial: un modelo capaz de razonar de manera transparente, multilingüe desde su concepción y optimizado para resolver problemas complejos en el mundo real.

Preguntas frecuentes

Esta metodología innovadora permite al modelo aprender el razonamiento lógico paso a paso en lugar de limitarse a memorizar la respuesta final. Un sistema maestro más grande genera explicaciones detalladas para prompts complejos, transfiriendo luego esta capacidad deductiva al modelo estudiante. De este modo se obtiene un rendimiento excepcional en la resolución de problemas matemáticos y en el estudio del código.

El corpus para el entrenamiento resulta cuidadosamente equilibrado para incluir una amplia gama de información global y técnica. Comprende principalmente textos en lengua inglesa, seguidos de lenguas europeas, lenguajes de programación, idiomas asiáticos y datos matemáticos de altísima calidad. Esta diversidad estructural previene los sesgos cognitivos y garantiza respuestas precisas en contextos multilingües o altamente especializados.

El sistema aprovecha una carga de datos asíncrona que procesa los textos mientras las tarjetas gráficas ejecutan los cálculos principales. A través de protocolos avanzados para fragmentar los tensores y tecnologías para calcular el nivel de atención de modo exacto, el sistema mantiene un uso de los procesadores cercano al límite máximo. Este enfoque reduce drásticamente los tiempos de procesamiento y los costes energéticos globales.

Los picos de error se gestionan mediante un sistema de monitorización en tiempo real que aísla los bloques de datos responsables de causar inestabilidad numérica. El equipo ha implementado un mecanismo de recuperación automática que descarta la información corrupta y recarga el punto de guardado estable anterior. Este procedimiento permite reanudar el proceso de aprendizaje en poquísimos minutos reduciendo al mínimo los tiempos de inactividad.

Esta estructura específica de red neuronal resulta extremadamente eficiente para procesar secuencias y generar texto natural. Combinada con optimizadores avanzados y una gestión dinámica de la tasa de aprendizaje, permite al sistema converger rápidamente hacia resultados óptimos. El resultado final es un sistema de inteligencia artificial capaz de procesar documentos muy largos sin agotar la memoria disponible.

¿Todavía tienes dudas sobre Entrenamiento de Vitruvian-1: Pipeline y Destilación CoT?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.