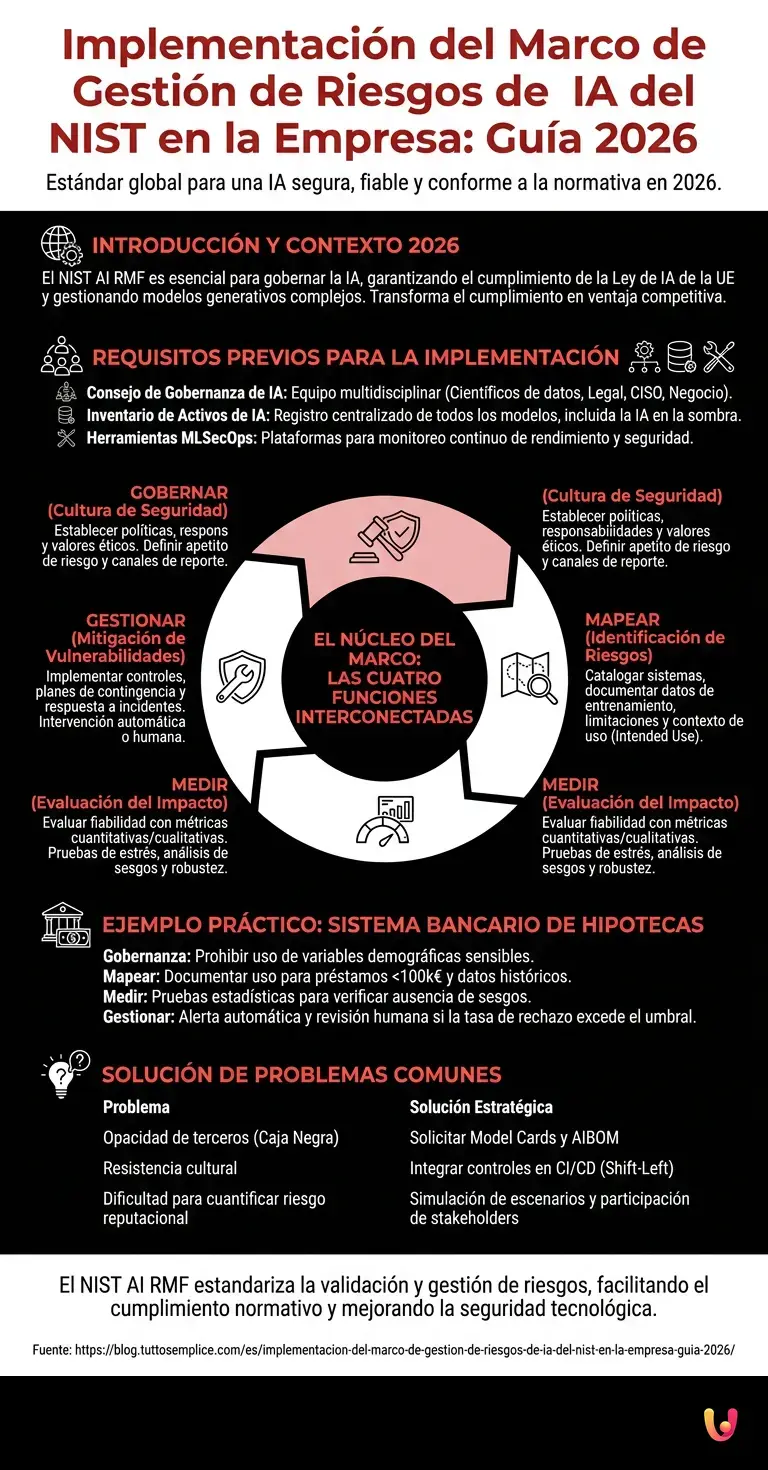

La integración del NIST AI RMF (Marco de Gestión de Riesgos de Inteligencia Artificial) representa hoy el pilar fundamental para cualquier organización que desee desarrollar, adquirir o integrar sistemas de inteligencia artificial. En el contexto tecnológico de 2026, caracterizado por la plena operatividad de la Ley de IA de la UE y la proliferación de modelos generativos complejos , la gestión de riesgos ya no es una opción, sino un imperativo estratégico. Esta guía técnica proporciona un camino estructurado para adoptar el marco, transformando el cumplimiento normativo en una ventaja competitiva tangible a través de una sólida gobernanza de IA .

Introducción a la Gestión de Riesgos de IA

La adopción del NIST AI RMF representa el estándar global en 2026 para gobernar la inteligencia artificial de forma segura. Este marco permite a las empresas mapear, medir y gestionar los riesgos relacionados con la IA, garantizando el cumplimiento normativo y la fiabilidad de los sistemas tecnológicos.

Según la documentación oficial del National Institute of Standards and Technology (NIST), el marco está diseñado para ser agnóstico al sector y escalable. No se trata de una simple lista de verificación de seguridad, sino de un cambio cultural que involucra a toda la estructura empresarial, desde el consejo de administración hasta los desarrolladores de aprendizaje automático. En 2026, la alineación entre el NIST RMF tradicional y las especificidades de la inteligencia artificial requiere una comprensión profunda de conceptos como la interpretabilidad de los modelos, la privacidad de los datos de entrenamiento y la mitigación de los sesgos algorítmicos.

Requisitos previos y herramientas para el cumplimiento normativo

Antes de implementar el NIST AI RMF , es fundamental establecer una sólida gobernanza empresarial de la IA. Los requisitos previos incluyen la formación de un comité ético multidisciplinar, la adopción de software para la auditoría algorítmica y el mapeo de la infraestructura de datos existente.

Para iniciar el proceso con éxito, las organizaciones deben contar con un ecosistema de herramientas y competencias adecuadas. El enfoque “De cero a héroe” requiere preparar el terreno empresarial a través de los siguientes pasos operativos:

- Constitución del Consejo de Gobernanza de IA: Un equipo interfuncional compuesto por científicos de datos, asesores legales, CISO y representantes del área de negocio.

- Inventario de activos de IA: Creación de un registro centralizado (Registro de IA) de todos los modelos en uso, incluidos los servicios de terceros (IA en la sombra).

- Adopción de herramientas de MLSecOps: Integración de plataformas para el monitoreo continuo del rendimiento y la seguridad de los modelos en producción.

| Categoría Instrumento | Función en el Framework | Ejemplo de aplicación 2026 |

|---|---|---|

| Plataformas de IA TRiSM | Monitorización y Confianza | Detección en tiempo real de la deriva y el sesgo de los datos. |

| Software de GRC (Gobernanza, Riesgo y Cumplimiento) | Gestión de políticas | Alineación automática entre las políticas internas y los requisitos de la Ley de IA de la UE. |

| Escáner de vulnerabilidades de LLM | Seguridad Técnica | Prevención de ataques de inyección de prompts y fugas de datos. |

El núcleo del marco: Las cuatro funciones

La arquitectura del NIST AI RMF se basa en cuatro funciones interconectadas: Gobernar, Mapear, Medir y Gestionar. Esta estructura circular y continua asegura que el ciclo de vida de la inteligencia artificial esté constantemente monitorizado, reduciendo sesgos y vulnerabilidades operativas .

Estas funciones no son secuenciales, sino que operan de forma sinérgica. Su implementación requiere metodologías rigurosas y una documentación trazable, esencial para superar posibles auditorías de conformidad.

Gobernar: Crear una cultura de seguridad

La función de Gobernanza del NIST AI RMF establece las políticas empresariales y las responsabilidades legales. Es el núcleo de la gobernanza de la IA , ya que alinea las estrategias de inteligencia artificial con los valores éticos, la tolerancia al riesgo y las normativas vigentes.

En esta etapa, el liderazgo empresarial debe definir claramente quién es responsable de cada sistema de IA. Las acciones clave incluyen la redacción de un código ético para la IA, la definición de los niveles de riesgo aceptables (Declaración de Apetito de Riesgo) y la creación de canales de comunicación transparentes para reportar anomalías algorítmicas sin temor a represalias.

Mapa: Identificación de los riesgos de los modelos

A través de la fase de Mapeo del NIST AI RMF , las organizaciones catalogan cada sistema de IA en uso. Este paso requiere documentar los datos de entrenamiento, las limitaciones del modelo y los posibles impactos negativos en los usuarios finales o en el negocio.

El mapeo suele ser la fase más compleja. Según datos del sector, más del 60 % de las empresas desconocen la extensión real de su superficie de ataque de IA. Es necesario documentar:

- El contexto de uso previsto (Intended Use) y los usos indebidos previsibles.

- El origen y la calidad de los conjuntos de datos de entrenamiento y validación.

- La cadena de suministro de software (AI Bill of Materials – AIBOM).

Medida: Evaluar el impacto de la inteligencia artificial

La fase de Medición del Marco de Gestión de Riesgos de IA (AI RMF) del NIST utiliza métricas cuantitativas y cualitativas para evaluar la fiabilidad de los modelos. Incluye pruebas de estrés, análisis de sesgos y evaluaciones de robustez, garantizando que la IA opere dentro de los parámetros de seguridad preestablecidos.

Las mediciones deben ser objetivas y repetibles. Los equipos técnicos deben implement métricas de equidad, precisión, interpretabilidad y resistencia a ataques adversarios (Adversarial Machine Learning). El uso de equipos rojos (red teaming) específicos para IA se convirtió en un estándar de facto en 2026 para validar la robustez de los modelos generativos antes de su lanzamiento a producción.

Gestionar: Mitigar las vulnerabilidades

Con la función de gestión, el NIST AI RMF proporciona directrices para responder a los riesgos identificados. Las empresas implementan controles técnicos, planes de contingencia y monitoreo continuo para desactivar o corregir los sistemas de IA en caso de anomalías.

La gestión activa del riesgo requiere la creación de manuales de respuesta a incidentes de IA. Si un modelo comienza a producir resultados discriminatorios o alucinaciones perjudiciales , los sistemas de interrupción deben intervenir automáticamente para degradar el servicio de forma segura (degradación gradual) o transferir el control a un operador humano (Human-in-the-Loop).

Ejemplos Prácticos de Adopción Empresarial

La aplicación del NIST AI RMF en escenarios reales demuestra su versatilidad. Ya se trate de un chatbot basado en LLM para atención al cliente o de algoritmos de calificación financiera , el marco estandariza los procesos de validación y lanzamiento.

Consideremos una entidad bancaria que implementa un nuevo sistema de aprobación de hipotecas basado en el aprendizaje automático. Utilizando el marco:

- Gobernanza: El comité establece que el modelo no debe utilizar variables demográficas sensibles.

- Mapa: Se documenta que el modelo se utilizará solo para préstamos inferiores a 100.000 euros y se mapean los datos históricos utilizados.

- Medida: Se realizan pruebas estadísticas para verificar la ausencia de sesgos contra minorías específicas (Análisis de impacto disparado).

- Gestionar: Se configura una alerta automática si la tasa de rechazo para un determinado grupo demográfico supera un umbral de alerta, activando la revisión humana.

Solución de problemas comunes

Durante la integración del NIST AI RMF , las empresas a menudo se enfrentan a obstáculos como la falta de transparencia de los proveedores o la baja calidad de los datos. Resolver estos problemas requiere auditorías de terceros y la actualización continua de las políticas del NIST RMF .

| Problema detectado (Solución de problemas) | Solución Estratégica |

|---|---|

| Opacidad de los modelos de terceros (caja negra) | Solicitar contractualmente las Model Cards y los AIBOM a los proveedores antes de la adquisición. |

| Resistencia cultural de los equipos de desarrollo | Integrar los controles de riesgo directamente en los pipelines de CI/CD (Shift-Left Security) para no ralentizar el lanzamiento. |

| Dificultad para cuantificar el riesgo reputacional. | Utilizar marcos de simulación de escenarios e involucrar a las partes interesadas externas (por ejemplo, asociaciones de consumidores) en la fase de Medición. |

En Breve (TL;DR)

La adopción del NIST AI RMF en 2026 resulta indispensable para gestionar los riesgos de la inteligencia artificial, garantizando el pleno cumplimiento de la Ley de IA de la UE.

Para iniciar este camino se necesita una sólida gobernanza empresarial, respaldada por un comité de ética multidisciplinar y herramientas avanzadas para la auditoría algorítmica.

El núcleo del marco de trabajo comprende cuatro funciones sinérgicas esenciales para gobernar, mapear, medir y gestionar continuamente todo el ciclo de vida de los modelos.

Conclusiones

Implementar con éxito el NIST AI RMF en 2026 no es solo una obligación de cumplimiento, sino una ventaja competitiva. Las empresas que dominan la gobernanza de la IA generan confianza, innovan de forma segura y se preparan para futuras evoluciones regulatorias.

La gestión de riesgos en la inteligencia artificial es un viaje continuo, no un destino final. Al adoptar las funciones de Gobierno, Mapeo, Medición y Gestión, las organizaciones de TI pueden maximizar el valor de las tecnologías emergentes al tiempo que protegen a sus usuarios, sus datos y su reputación en el mercado global. La inversión actual en marcos estructurados como el del NIST representa la mejor garantía contra las incertidumbres tecnológicas del mañana.

Preguntas frecuentes

El marco NIST AI RMF representa un estándar global para la gestión de riesgos relacionados con la inteligencia artificial. Este sistema permite a las organizaciones mapear, medir y gobernar los modelos, garantizando el cumplimiento de las normativas europeas y mejorando la seguridad tecnológica general.

La arquitectura se basa en cuatro funciones continuas y sinérgicas denominadas Gobernar, Mapear, Medir y Gestionar. Estas fases permiten establecer políticas éticas, catalogar los sistemas en uso, evaluar los impactos mediante métricas objetivas y mitigar las vulnerabilidades operativas de manera oportuna.

Para iniciar el proceso, resulta fundamental establecer una sólida gobernanza empresarial creando un comité ético multidisciplinar. Posteriormente, es necesario mapear la infraestructura de datos existente y adoptar herramientas específicas para el monitoreo continuo del rendimiento y la seguridad de los modelos.

Para superar la falta de transparencia de los proveedores externos, el marco sugiere exigir contractualmente documentación específica antes de la adquisición. Herramientas como las Model Cards y las listas de materiales del software resultan esenciales para comprender las limitaciones y los datos de entrenamiento de los modelos opacos.

La adopción de este marco estandariza los procesos de validación y gestión de riesgos, facilitando enormemente el cumplimiento de los requisitos legales europeos. Utilizando software de gobernanza específico, las empresas pueden traducir las políticas internas en acciones conformes a las directivas internacionales.

¿Todavía tienes dudas sobre Implementación del Marco de Gestión de Riesgos de IA del NIST en la Empresa: Guía 2026?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

- Marco de Gestión de Riesgos de Inteligencia Artificial (AI RMF) – NIST Oficial

- NIST AI RMF Playbook: Guía operativa para la implementación de las funciones

- Ley de IA de la UE: primera normativa integral sobre inteligencia artificial – Parlamento Europeo

- Marco de Gestión de Riesgos de Inteligencia Artificial (AI RMF) del NIST

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.