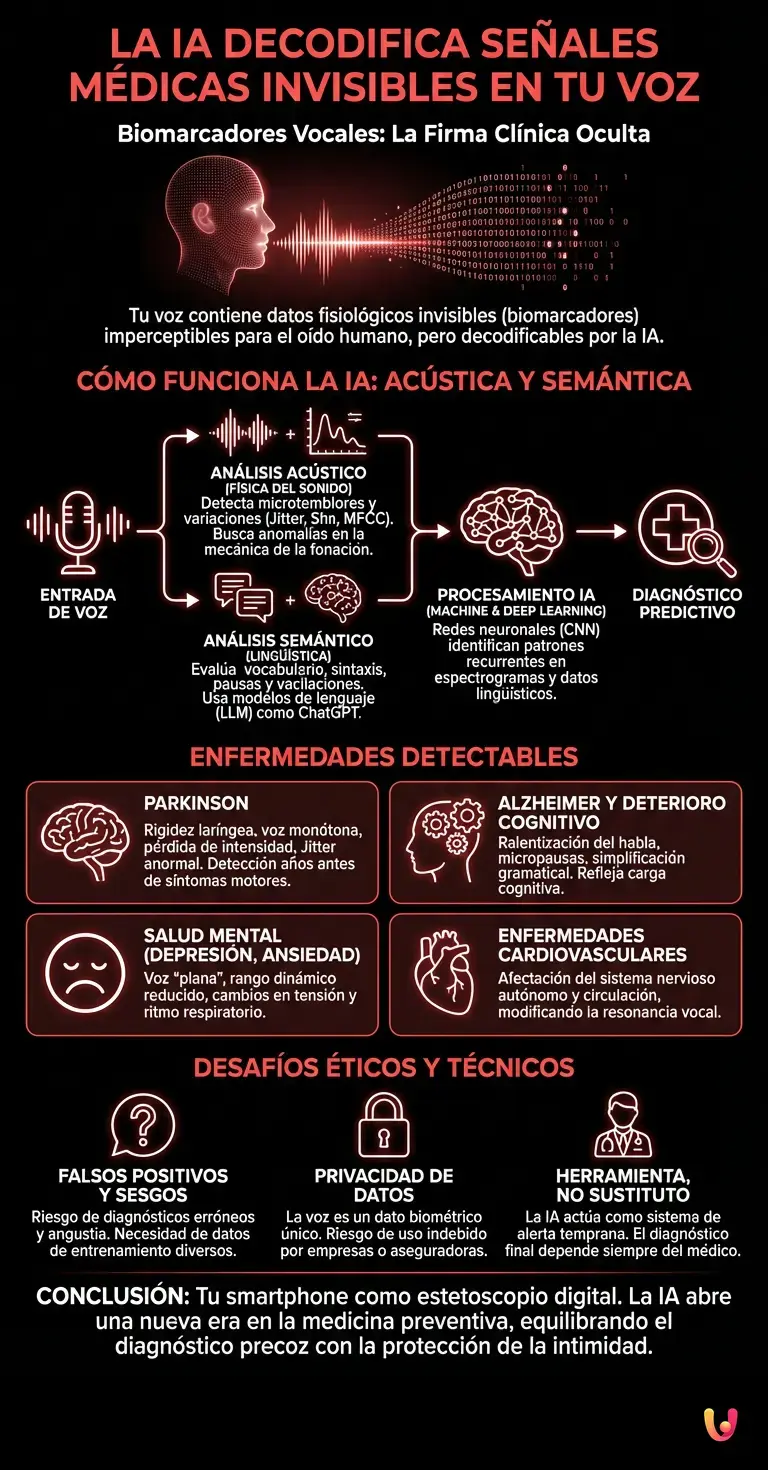

Cada día, usted pronuncia una media de entre 15.000 y 20.000 palabras. Ya sea durante una llamada telefónica, dictando un mensaje de voz o interactuando con un asistente virtual, su voz es su principal herramienta de comunicación. Sin embargo, más allá de las palabras y las emociones que cree transmitir, sus cuerdas vocales difunden un flujo continuo de datos fisiológicos invisibles. Aquí es donde entra en juego una entidad científica fascinante: los biomarcadores vocales. Estas ínfimas variaciones acústicas, totalmente imperceptibles para el oído humano, constituyen una verdadera firma clínica que la tecnología moderna es ahora capaz de decodificar.

El oído humano es una maravilla de la evolución, optimizado para comprender el lenguaje, captar las entonaciones y filtrar el ruido de fondo. No obstante, es biológicamente incapaz de percibir microtemblores del orden de milisegundos o variaciones de frecuencia de unos pocos hercios. Durante décadas, esta información permaneció perdida en las ondas sonoras. Hoy, gracias a la potencia de cálculo moderna y a la inteligencia artificial, este paradigma ha cambiado radicalmente. La máquina ya no solo escucha lo que usted dice; analiza la mecánica íntima de su cuerpo a través de la forma en que lo dice.

La física del sonido: lo que no podemos oír

Para entender cómo una simple frase puede revelar su futuro médico, primero hay que sumergirse en la biomecánica de la fonación. La producción de la voz es un proceso extraordinariamente complejo que requiere la coordinación sincronizada de más de 100 músculos, desde el diafragma hasta los labios, pasando por la laringe y la lengua. Este sistema está controlado directamente por el sistema nervioso central y periférico, concretamente por el nervio vago (el décimo nervio craneal), que inerva las cuerdas vocales y también está conectado al corazón y a los pulmones.

Cuando usted habla, el aire expulsado por sus pulmones hace vibrar sus cuerdas vocales. Esta vibración genera una onda sonora fundamental, que luego es modulada por las cavidades de resonancia de su garganta, su boca y su nariz. La IA no se limita a grabar esta onda; la descompone matemáticamente. Los algoritmos buscan anomalías microscópicas en dos parámetros acústicos fundamentales: el Jitter y el Shimmer.

El Jitter corresponde a las microvariaciones de la frecuencia de la voz de un ciclo vibratorio a otro. El Shimmer, por su parte, mide las microvariaciones de la amplitud (el volumen) entre esos mismos ciclos. A estas medidas se suman los MFCC (Mel-Frequency Cepstral Coefficients), una representación matemática del espectro vocal que permite cartografiar la “textura” única de la voz. Una persona en perfecto estado de salud tendrá valores de Jitter y Shimmer extremadamente estables. Pero si una patología comienza a afectar al sistema nervioso, al sistema respiratorio o al sistema cardiovascular, esta estabilidad se ve comprometida mucho antes de que el paciente sienta el menor síntoma.

¿Cómo decodifica la inteligencia artificial lo invisible?

Extraer estos datos acústicos es solo el primer paso. La verdadera hazaña tecnológica reside en la interpretación de estas señales. Aquí es donde entra en escena el machine learning (aprendizaje automático). Históricamente, los médicos intentaban establecer correlaciones manuales entre la voz y la enfermedad, una tarea tediosa y limitada por los sesgos humanos. Hoy en día, los investigadores alimentan a los algoritmos con millones de muestras vocales procedentes de pacientes sanos y de pacientes diagnosticados con diversas patologías.

El proceso se basa masivamente en el deep learning (aprendizaje profundo), una subcategoría de la IA que utiliza redes neuronales artificiales inspiradas en el cerebro humano. Los archivos de audio se transforman a menudo en espectrogramas, representaciones visuales de las frecuencias sonoras a lo largo del tiempo. Redes neuronales convolucionales (CNN), diseñadas inicialmente para el reconocimiento de imágenes, “miran” estos espectrogramas para identificar patrones recurrentes. La red aprende por sí misma que tal combinación de microtemblores, asociada a una cierta rigidez espectral, está estadísticamente correlacionada con la aparición futura de una enfermedad específica.

Además, la aparición de la IA generativa ha acelerado esta investigación. Uno de los mayores desafíos en medicina es la falta de datos para las enfermedades raras. Los modelos generativos pueden ahora sintetizar voces artificiales que presentan biomarcadores específicos, permitiendo entrenar los algoritmos de diagnóstico de manera mucho más robusta sin comprometer la confidencialidad de los pacientes reales.

El análisis semántico: cuando ChatGPT interviene

El análisis acústico puro (el sonido de la voz) es formidable, pero se vuelve aún más potente cuando se combina con el análisis semántico y lingüístico (la elección de las palabras y la estructura de las frases). Este es el campo predilecto de los grandes modelos de lenguaje (LLM) como ChatGPT.

Cuando un paciente habla, un modelo de IA avanzado puede transcribir el discurso en tiempo real y analizar la complejidad sintáctica, la riqueza del vocabulario, la duración de las pausas entre las palabras y las vacilaciones. Por ejemplo, una disminución sutil del uso de verbos de acción o un aumento de los pronombres indefinidos (“cosa”, “algo”) combinada con pausas de unos milisegundos adicionales para buscar las palabras, constituye una señal de alarma semántica. Al fusionar las redes neuronales acústicas (que detectan los temblores físicos) y los modelos de lenguaje (que detectan el deterioro cognitivo), los investigadores crean herramientas de diagnóstico multimodales de una precisión inédita.

Del Parkinson a la depresión: lo que su voz revela

Pero concretamente, ¿cuáles son estas enfermedades que el algoritmo puede leer en nuestro futuro médico? Las aplicaciones clínicas de los biomarcadores vocales se dividen en tres grandes categorías: neurológicas, psiquiátricas y fisiológicas.

La enfermedad de Parkinson: Es uno de los campos más documentados. El Parkinson se caracteriza por una degeneración de las neuronas dopaminérgicas, lo que conlleva rigidez muscular. Mucho antes de que aparezcan los temblores en las manos, esta rigidez afecta a los músculos minúsculos de la laringe. La voz se vuelve muy ligeramente monótona, pierde intensidad y presenta un Jitter anormal. La IA puede detectar estas anomalías años antes del diagnóstico clínico tradicional, ofreciendo una ventana crucial para tratamientos neuroprotectores precoces.

La enfermedad de Alzheimer y el deterioro cognitivo: Aquí prima la combinación de la acústica y la lingüística. Los algoritmos detectan una ralentización imperceptible del ritmo del habla, micropausas anormales y una simplificación de la estructura gramatical. La carga cognitiva necesaria para formular un pensamiento complejo se refleja directamente en la fluidez vocal.

La salud mental: La depresión, la ansiedad y el trastorno de estrés postraumático (TEPT) modifican la tensión de las cuerdas vocales y el ritmo respiratorio. Una persona que sufre depresión severa presentará a menudo una voz calificada de “plana” por el algoritmo, con un rango dinámico (la variación de volumen y tono) considerablemente reducido. La IA puede seguir la evolución de estos parámetros a lo largo del tiempo para evaluar la eficacia de un tratamiento antidepresivo o predecir una recaída.

Las enfermedades cardiovasculares: Es quizás el descubrimiento más sorprendente. Estudios recientes han demostrado que los pacientes con un alto riesgo de enfermedad coronaria poseen características vocales específicas. La explicación reside en el sistema nervioso autónomo. La aterosclerosis (el endurecimiento de las arterias) y los problemas cardíacos afectan sutilmente a la circulación sanguínea y a la oxigenación de los tejidos, incluidos los de la laringe, modificando así la resonancia de la voz de una manera que solo una máquina puede cuantificar.

¿Qué pasa si la máquina se equivoca? Los desafíos éticos y técnicos

Ante una tecnología tan intrusiva y potente, surge una pregunta legítima: ¿qué pasa si el algoritmo se equivoca? El riesgo de “falsos positivos” es uno de los mayores desafíos de la medicina predictiva. Anunciar a un paciente sano que su voz indica un riesgo inminente de desarrollar la enfermedad de Alzheimer podría provocar una angustia psicológica inmensa, sin contar los exámenes médicos invasivos y costosos que seguirían innecesariamente.

Además, la cuestión de los sesgos en los datos de entrenamiento es crítica. Si un modelo de deep learning se entrena mayoritariamente con voces de hombres caucásicos de 40 años, corre el riesgo de ser mucho menos preciso para diagnosticar a una mujer asiática de 70 años. Los acentos, los dialectos, las particularidades anatómicas individuales e incluso la calidad del micrófono del smartphone utilizado para captar la voz son variables que pueden falsear el análisis.

Por eso la comunidad científica insiste en que la IA no debe sustituir al médico, sino actuar como una herramienta de triaje o un sistema de alerta temprana. Los biomarcadores vocales son comparables a un termómetro ultrasofisticado: indican que se está desarrollando una anomalía, pero el diagnóstico final y el plan de tratamiento deben depender siempre de la experiencia clínica humana.

Por último, la protección de la privacidad es un reto colosal. Nuestras voces son datos biométricos únicos. Si nuestros smartphones, nuestros altavoces inteligentes o nuestras aplicaciones de videoconferencia analizan permanentemente nuestra salud en segundo plano, ¿a quién pertenecen estos datos médicos? ¿Podrían las empresas tecnológicas vender estos perfiles de riesgo a compañías de seguros? La legislación deberá evolucionar rápidamente para regular estrictamente el uso del análisis vocal predictivo.

En Breve (TL;DR)

Nuestra voz difunde continuamente biomarcadores vocales, ínfimas variaciones acústicas imperceptibles al oído humano que ocultan datos fisiológicos cruciales.

La inteligencia artificial analiza la mecánica íntima de su cuerpo rastreando microtemblores invisibles en las ondas sonoras de cada frase.

Gracias al aprendizaje automático, estas señales invisibles se interpretan para predecir y diagnosticar patologías mucho antes de la aparición de los primeros síntomas.

Conclusión

La convergencia entre la fonética, la neurología y la informática de vanguardia ha abierto una nueva era en la medicina preventiva. Ese detalle inaudible en su voz, esa ínfima variación de frecuencia o de ritmo, es una ventana abierta al funcionamiento interno de su cuerpo. Gracias a los avances fulgurantes del machine learning y del análisis semántico, nuestro smartphone se transforma progresivamente en un estetoscopio digital permanente, capaz de leer nuestro futuro médico en las ondas sonoras de nuestras conversaciones diarias.

A medida que la tecnología sigue perfeccionándose, el desafío de los próximos años no será solo técnico, sino ético y regulatorio. Se tratará de encontrar el equilibrio justo entre el increíble potencial de salvar vidas gracias a un diagnóstico ultraprecoz y la necesidad absoluta de proteger la intimidad de nuestros intercambios. Una cosa es segura: la próxima vez que deje un mensaje de voz, recuerde que transmite mucho más que simples palabras. Comparte, sin saberlo, el parte médico de su futuro.

Preguntas frecuentes

Un biomarcador vocal corresponde a una ínfima variación acústica presente en la voz, que permanece totalmente imperceptible para los oídos humanos. La tecnología moderna analiza estos microtemblores y estos cambios de frecuencia para detectar anomalías fisiológicas invisibles. Estas señales sonoras permiten así diagnosticar patologías graves mucho antes del inicio de los primeros síntomas físicos.

Los algoritmos actuales son capaces de detectar numerosas patologías neurológicas, psiquiátricas y fisiológicas a partir de simples grabaciones. Detectan especialmente la enfermedad de Parkinson, el deterioro cognitivo ligado al síndrome de Alzheimer, la depresión severa e incluso ciertos riesgos de enfermedades cardiovasculares. Esta detección ultraprecoz ofrece a los pacientes una ventana de tiempo crucial para comenzar tratamientos adaptados.

El sistema comienza por descomponer matemáticamente las ondas sonoras para medir parámetros acústicos fundamentales, como las microvariaciones de frecuencia y de volumen. A continuación, los modelos informáticos estudian estos datos en forma de espectrogramas visuales para detectar anomalías. Finalmente, estos resultados físicos se cruzan a menudo con un análisis semántico profundo del vocabulario y la sintaxis.

Nuestras voces constituyen datos biométricos únicos que revelan información extremadamente íntima sobre nuestro estado de salud general. Si nuestros teléfonos o nuestros altavoces inteligentes analizan nuestra condición médica permanentemente, el riesgo de ver estos perfiles revendidos a compañías privadas se convierte en una preocupación real. Una legislación estricta es, por tanto, absolutamente indispensable para regular esta nueva forma de medicina predictiva.

No, la comunidad científica afirma claramente que esta tecnología innovadora no debe en ningún caso sustituir al profesional de la salud. Actúa más bien como un sistema preventivo o una herramienta de triaje médico extremadamente sofisticada. El diagnóstico final, así como la elección del plan de tratamiento, dependerán siempre de la decisión humana y del conocimiento médico.

¿Todavía tienes dudas sobre La IA decodifica esta señal médica invisible oculta en su voz?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.