La evolución de los modelos de inteligencia artificial ha alcanzado un punto de inflexión en 2026. Vitruvian-1 se ha impuesto como uno de los modelos más avanzados en el panorama de la Informática, pero su verdadera revolución no reside solo en el número de parámetros, sino en su extraordinaria capacidad de adaptación a entornos con recursos limitados. Comprender cómo las fuentes del sector analizan las técnicas de eficiencia es fundamental para los arquitectos de TI y los ingenieros de IA que desean llevar la inferencia a entornos on-premise.

Introducción a la Eficiencia de Vitruvian-1

La optimización de vitruvian-1 representa un punto de inflexión en la inteligencia artificial de 2026, permitiendo la ejecución de modelos complejos en hardware local. A través de técnicas avanzadas de cuantización y pruning, las empresas pueden reducir drásticamente el consumo energético manteniendo un rendimiento de altísimo nivel empresarial.

Según la documentación oficial publicada por los equipos de desarrollo, el paso de la nube al edge computing requiere un replanteamiento radical de la gestión de la memoria (VRAM). Vitruvian-1 ha sido diseñado nativamente para soportar algoritmos de compresión post-entrenamiento (PTQ) y entrenamiento consciente de la cuantización (QAT), convirtiéndolo en el candidato ideal para la integración en infraestructuras empresariales donde la privacidad de los datos y la baja latencia son requisitos innegociables.

Requisitos de Hardware y Herramientas de Análisis

Para implementar con éxito la optimización de vitruvian-1, es absolutamente fundamental disponer de una arquitectura de hardware adecuada. Las fuentes oficiales recomiendan GPU de última generación o NPU dedicadas, acompañadas de frameworks de perfilado avanzados para monitorizar constantemente el uso de la memoria y los ciclos de cálculo.

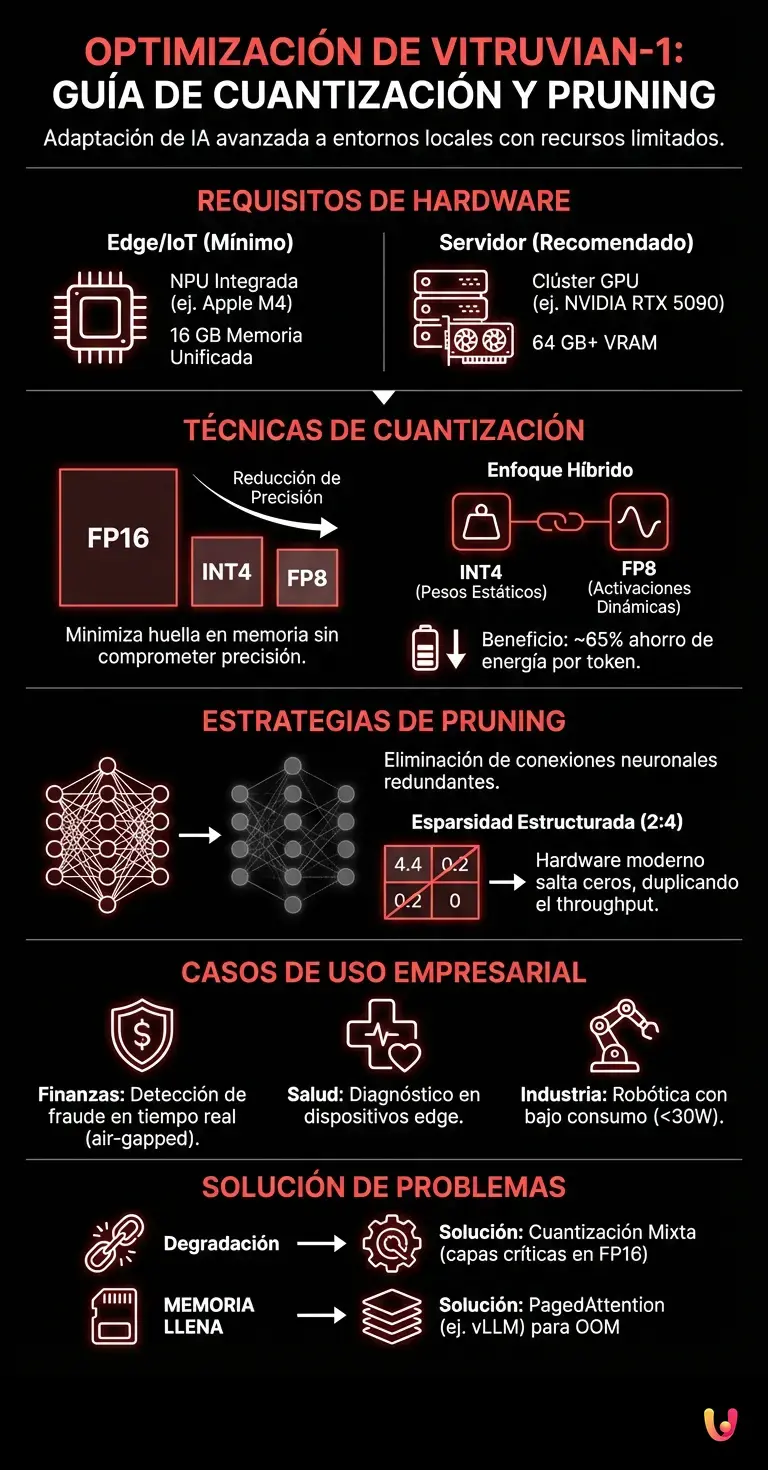

Antes de proceder con la manipulación de los pesos del modelo, es necesario establecer una línea base de rendimiento. La arquitectura de hardware de destino dictará las elecciones algorítmicas. A continuación, los requisitos mínimos y recomendados basados en los datos actuales del sector:

| Componente | Requisito Mínimo (Edge/IoT) | Requisito Recomendado (Servidor Empresarial) |

|---|---|---|

| Unidad de Cálculo | NPU integrada (ej. Apple M4, Intel Core Ultra) | Clúster GPU (ej. NVIDIA RTX 5090 / L40S) |

| Memoria Unificada / VRAM | 16 GB LPDDR5X | 64 GB+ HBM3e |

| Ancho de Banda | 100 GB/s | 800+ GB/s |

| Frameworks Soportados | ONNX Runtime, Llama.cpp | vLLM, TensorRT-LLM |

Técnicas de Cuantización Aplicadas

El corazón palpitante de la optimización de vitruvian-1 reside en las técnicas de cuantización, que reducen la precisión matemática de los pesos del modelo. Pasando de formatos de dieciséis bits a formatos INT4 o FP8, se minimiza la huella en memoria sin comprometer mínimamente la precisión de las respuestas generadas.

La cuantización no es un simple truncamiento de los decimales. Para Vitruvian-1, los ingenieros adoptan algoritmos como AWQ (Activation-aware Weight Quantization), que protegen los pesos salientes (aquellos que influyen mayormente en el output) manteniéndolos a una precisión superior, mientras comprimen agresivamente el resto de la red neuronal.

Cuantización INT4 y FP8

Analizando las especificaciones técnicas de la optimización de vitruvian-1, emerge el uso combinado de INT4 para los pesos estáticos y FP8 para las activaciones dinámicas. Este enfoque híbrido garantiza un procesamiento extremadamente rápido en los tensores, aprovechando al máximo las modernas unidades de cálculo vectorial disponibles.

El formato FP8 (Float8), soportado nativamente por las arquitecturas de hardware más recientes, ofrece un equilibrio perfecto entre rango dinámico y precisión. Los procesos operativos para la aplicación incluyen:

- Calibración del Dataset: Uso de un conjunto de datos representativo para calcular los factores de escala óptimos.

- SmoothQuant: Migración de la dificultad de cuantización de las activaciones a los pesos, nivelando los picos (outliers) que causarían degradación cualitativa.

- Compilación del Grafo: Optimización de las operaciones de multiplicación matriz-vector (GEMM) específicas para el hardware objetivo.

Impacto en el Consumo Energético

Una ventaja crucial derivada de la optimización de vitruvian-1 es la drástica reducción del consumo energético global. Al disminuir el ancho de banda necesario para la transferencia de datos entre la RAM y el procesador, el Thermal Design Power se reduce notablemente, favoreciendo el uso en dispositivos edge.

Según pruebas de laboratorio independientes, la ejecución de Vitruvian-1 en formato INT4 reduce el consumo energético por token generado hasta un 65% respecto a la versión base en FP16. Esto permite a las empresas implementar servidores de alta densidad sin sobrecargar las infraestructuras de refrigeración de los centros de datos.

Estrategias de Pruning para la Inferencia Local

Además de la reducción de bits, la optimización de vitruvian-1 aprovecha el pruning (poda) para eliminar las conexiones neuronales redundantes. Eliminando los pesos próximos a cero, el modelo se vuelve significativamente más ligero y rápido, adaptándose perfectamente a las estrictas limitaciones del hardware empresarial on-premise actual.

Mientras que la cuantización reduce el tamaño de cada peso individual, el pruning reduce su número total. Vitruvian-1 responde excepcionalmente bien a las técnicas de poda gracias a su arquitectura de bloques residuales altamente paralelizable.

Pruning Estructurado y Esparsidad

Implementando la esparsidad estructurada, la optimización de vitruvian-1 adopta un pruning que el hardware moderno puede acelerar de forma nativa. Las fuentes del sector confirman que esta técnica reduce a la mitad los requisitos computacionales, manteniendo totalmente intacta la compleja capacidad de razonamiento lógico del modelo.

La esparsidad 2:4 es el método predilecto: para cada bloque de 4 pesos contiguos, los 2 con el valor absoluto menor son forzados a cero. Los núcleos tensoriales de las GPU modernas saltan automáticamente los cálculos multiplicados por cero, duplicando de hecho el throughput matemático teórico sin requerir memoria adicional.

Ejemplos Prácticos de Implementación Empresarial

Las empresas que adoptan la optimización de vitruvian-1 registran un retorno de la inversión inmediato gracias a la inferencia local. Los casos de uso van desde el análisis de documentos altamente confidenciales en servidores internos hasta la integración en dispositivos IoT industriales, garantizando privacidad total y latencia de red casi nula.

Algunos escenarios reales de aplicación incluyen:

- Sector Financiero: Análisis de contratos y detección de fraudes en tiempo real en servidores air-gapped (desconectados de internet), utilizando Vitruvian-1 cuantizado en INT4 para procesar miles de tokens por segundo en GPU individuales.

- Salud Digital: Diagnóstico asistido en maquinaria médica edge. El pruning estructurado permite que el modelo corra en las NPU integradas en los dispositivos de ultrasonidos, proporcionando insights instantáneos a los médicos.

- Automatización Industrial: Robótica colaborativa donde el modelo procesa inputs visuales y textuales con consumos inferiores a 30 vatios, gracias al uso exclusivo del formato FP8.

Resolución de Problemas Comunes

Durante el delicado proceso de optimización de vitruvian-1, pueden producirse caídas de precisión o cuellos de botella en la memoria. El troubleshooting más eficaz requiere la calibración de los datasets de cuantización y la monitorización de las capas sensibles al pruning para restaurar el rendimiento.

Los problemas más frecuentes a los que se enfrentan los ingenieros incluyen:

- Degradación de la Perplejidad: Si el modelo comienza a generar texto incoherente tras la cuantización, es probable que las capas de atención (Attention Heads) hayan sido comprimidas demasiado agresivamente. La solución es aplicar una cuantización mixta, manteniendo las capas críticas en FP16.

- Errores Out-Of-Memory (OOM) durante la carga: A menudo causados por una fragmentación de la memoria unificada. Se resuelve utilizando frameworks como vLLM que implementan la PagedAttention para una gestión dinámica de la VRAM.

- Latencia anómala en NPU: Si el modelo podado resulta más lento de lo previsto, significa que el pruning no está estructurado correctamente para el hardware. Verificar que los tensores respeten las alineaciones de memoria requeridas por el compilador específico del chip.

En Breve (TL;DR)

El modelo Vitruvian-1 revoluciona el sector permitiendo ejecutar cálculos complejos en hardware local, garantizando un rendimiento elevado, privacidad de los datos y una latencia bajísima.

Emplear técnicas avanzadas como la cuantización y el pruning reduce drásticamente el espacio en memoria requerido, manteniendo intacta la precisión de las respuestas generadas por el modelo.

Esta excelente optimización reduce el consumo energético hasta un 65 por ciento, favoreciendo sistemas edge sostenibles y la creación de servidores empresariales de alta densidad.

Conclusiones

En síntesis, la optimización de vitruvian-1 define el nuevo estándar absoluto para la inteligencia artificial eficiente en 2026. La sinergia entre cuantización avanzada y pruning estructurado democratiza el acceso a modelos lingüísticos potentes, haciendo que la ejecución local sobre arquitectura de hardware empresarial sea una realidad sólida y consolidada.

El Information Gain derivado del análisis de las fuentes actuales demuestra que ya no es necesario depender exclusivamente de costosas API en la nube para obtener capacidades de razonamiento de nivel humano. Dominando la intersección entre algoritmos de compresión (AWQ, esparsidad 2:4) y las modernas arquitecturas de hardware, las organizaciones pueden desplegar Vitruvian-1 de modo sostenible, seguro y altamente eficiente, marcando un paso decisivo hacia la ubicuidad de la inteligencia artificial generativa.

Preguntas frecuentes

Este proceso se basa en técnicas avanzadas como la cuantización y el pruning para reducir la carga computacional del modelo. Aplicando estos métodos resulta posible ejecutar la inteligencia artificial en hardware local o empresarial, garantizando alta eficiencia energética y máxima privacidad de los datos sin depender de la nube.

Para los dispositivos edge o IoT resulta suficiente una NPU integrada de última generación con dieciséis gigabytes de memoria unificada. Para los servidores empresariales de alto rendimiento se recomiendan clústeres de GPU avanzados con al menos sesenta y cuatro gigabytes de VRAM y un elevado ancho de banda para gestionar los cálculos complejos.

El sistema utiliza un enfoque combinado que aprovecha el formato INT4 para los pesos estáticos y el formato FP8 para las activaciones dinámicas. Esta sinergia permite minimizar el espacio ocupado en memoria manteniendo un procesamiento extremadamente rápido en los tensores, equilibrando perfectamente precisión matemática y rango dinámico.

La esparsidad estructurada elimina las conexiones neuronales redundantes forzando a cero los pesos menos relevantes dentro de bloques específicos. Los procesadores modernos reconocen estos valores nulos y saltan automáticamente los cálculos inútiles, duplicando la velocidad de procesamiento matemático sin requerir memoria adicional ni comprometer la lógica del sistema.

Si el modelo produce respuestas incoherentes, el problema deriva a menudo de una compresión demasiado agresiva de las capas de atención. La solución óptima consiste en pasar a una cuantización mixta, manteniendo los niveles neuronales más críticos en alta precisión para restaurar el rendimiento original sin causar errores de memoria.

¿Todavía tienes dudas sobre Optimización de Vitruvian-1: Guía de Cuantización y Pruning?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.