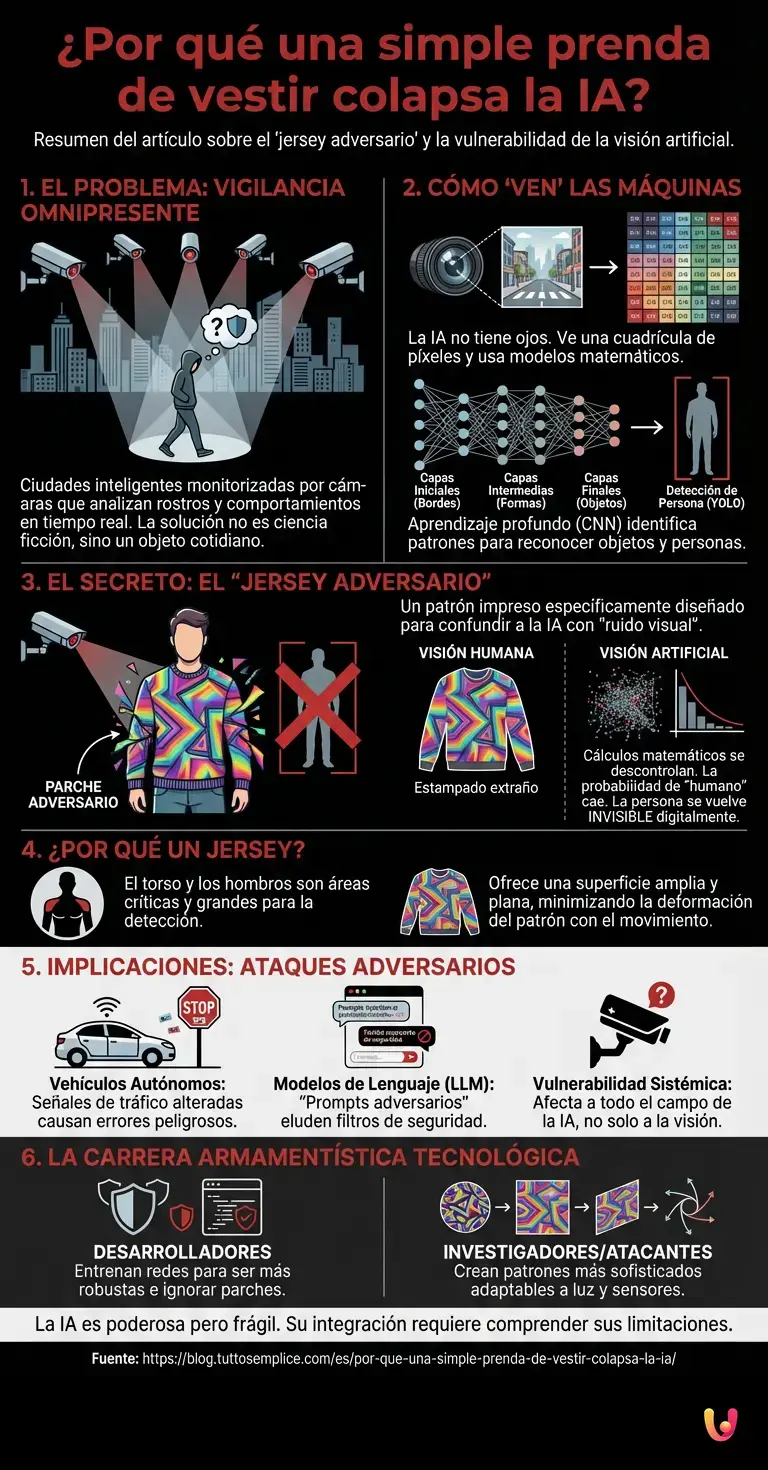

Vivimos en una época en la que el espacio público está constantemente monitorizado. Nuestras ciudades se han convertido en ecosistemas inteligentes, salpicados de cámaras de seguridad de última generación capaces no solo de grabar imágenes, sino de analizarlas en tiempo real. Reconocen rostros, rastrean movimientos, identifican comportamientos anómalos. Ante esta vigilancia omnipresente, la reacción instintiva podría ser la de imaginar soluciones de ciencia ficción para proteger la propia privacidad, como capas de invisibilidad o dispositivos de interferencia electromagnética. Sin embargo, la respuesta más eficaz y sorprendente se encuentra en un objeto de uso cotidiano, conocido por los expertos en seguridad informática como el “jersey adversario” . Esta simple prenda, aparentemente inofensiva, esconde un secreto tecnológico capaz de colapsar los sistemas de visión artificial más avanzados del planeta.

Para comprender cómo una simple prenda de vestir puede burlar sistemas de vigilancia que han costado millones de dólares en investigación y desarrollo, es necesario dar un paso atrás y analizar cómo las máquinas “ven” el mundo . La inteligencia artificial no posee ojos ni un cerebro biológico capaz de interpretar la luz y las formas de manera intuitiva. La visión artificial se basa en complejos modelos matemáticos y estadísticos.

El ojo digital: cómo “ven” las máquinas

Cuando una cámara enfoca una calle, no ve “personas” ni “automóviles”. Ve una cuadrícula de píxeles, cada uno con un valor numérico que representa su color e intensidad lumínica. Aquí es donde entra en juego el aprendizaje automático . Mediante el entrenamiento con millones de imágenes preetiquetadas, los sistemas aprenden a reconocer patrones específicos. Si un grupo de píxeles presenta ciertas variaciones de contraste, bordes y gradientes, el sistema calcula la probabilidad de que ese conjunto de datos represente a un ser humano.

Este proceso es posible gracias al aprendizaje profundo y, en particular, a una arquitectura neuronal específica conocida como Red Neuronal Convolucional (CNN). Estas redes analizan la imagen por capas: las primeras capas reconocen líneas y bordes simples, las capas intermedias identifican formas geométricas y las capas finales combinan estos elementos para reconocer objetos complejos, como un rostro o la silueta de un cuerpo humano. Sistemas conocidos como YOLO (You Only Look Once) son capaces de realizar estas operaciones en fracciones de segundo, dibujando los llamados “bounding box” (rectángulos delimitadores) alrededor de las personas identificadas en el vídeo.

El secreto revelado: la ciencia del jersey del rival

Si la IA se basa en patrones visuales para identificar a un ser humano, ¿qué ocurre si le proporcionamos un patrón diseñado específicamente para confundirla? Este es precisamente el principio que subyace al suéter adversario. No se trata de una tela mágica que desvía la luz, sino de una prenda de vestir impresa con una imagen muy particular, definida en la jerga técnica como “parche adversario” (adversarial patch).

A los ojos de un ser humano, el suéter parece simplemente una prenda con un estampado extraño, quizás un poco psicodélico o abstracto. Podría parecer una imagen borrosa de personas en un mercado, o un collage de formas geométricas coloridas. Pero para los algoritmos de detección de objetos, ese estampado es un verdadero ataque informático visual.

Los investigadores utilizaron la misma inteligencia artificial para generar estas impresiones. Le pidieron a un algoritmo que creara una imagen que contuviera las características visuales exactas (gradientes, contrastes, intersecciones de líneas) que las redes neuronales asocian con “algo que no es una persona”, o que generara un “ruido visual” tal que sobrecargara el sistema de clasificación. Cuando una persona lleva este jersey, la cámara capta la escena. La red neuronal comienza a analizar los píxeles. Sin embargo, cuando llega al área del torso cubierta por el jersey, los cálculos matemáticos se descontrolan. Los valores de probabilidad que indican la presencia de un ser humano caen drásticamente. El sistema, simplemente, decide que allí no hay nadie. La persona se vuelve, a todos los efectos digitales, invisible.

¿Por qué precisamente un jersey?

La elección de la prenda de vestir no es casual. Los sistemas de detección peatonal se basan en gran medida en la identificación del torso y los hombros, ya que son las partes del cuerpo más grandes y visibles, menos propensas a oclusiones que las piernas o los brazos. Cubrir esta área crítica con un parche adversario maximiza la efectividad de la ilusión. Además, un jersey o una sudadera ofrecen una superficie amplia y relativamente plana sobre la que imprimir el patrón, garantizando que la imagen no se deforme excesivamente con los movimientos del cuerpo, lo que podría comprometer su eficacia.

Las pruebas realizadas en varios laboratorios universitarios han demostrado que estas prendas logran eludir los sistemas de vigilancia con porcentajes de éxito asombrosos, superando con creces todos los parámetros de seguridad estándar utilizados para evaluar la robustez del software de visión artificial.

Más allá de la vigilancia: implicaciones para el futuro

El descubrimiento de esta vulnerabilidad plantea cuestiones profundas que van mucho más allá del simple deseo de eludir una cámara de seguridad. Demuestra que los sistemas de inteligencia artificial, por muy avanzados que sean, perciben la realidad de una manera fundamentalmente ajena a la nuestra. Son máquinas estadísticas y, como tales, pueden ser engañadas explotando sus propias reglas matemáticas.

Este fenómeno de los ” ataques adversarios ” no se limita a la visión artificial. Es un problema sistémico que afecta a todo el campo de la inteligencia artificial. Por ejemplo, en el ámbito de la automatización y los vehículos autónomos, los investigadores han demostrado que basta con aplicar un par de pequeñas pegatinas negras a una señal de “Stop” para que el coche la interprete como una señal de límite de velocidad, con consecuencias potencialmente desastrosas.

En el mundo del procesamiento del lenguaje natural, la situación es similar. Los grandes modelos de lenguaje, o LLM , como GPT-3 (y sus derivados como ChatGPT), pueden ser susceptibles a “prompts adversarios” (a menudo llamados jailbreaks). Introduciendo secuencias de palabras específicas, aparentemente inocuas o sin sentido para un humano, es posible eludir los filtros de seguridad del modelo, obligándolo a generar respuestas que normalmente le estarían prohibidas. La lógica básica es la misma que la del jersey: proporcionar una entrada (visual o textual) que explote los puntos ciegos de la arquitectura del modelo.

La carrera armamentística tecnológica

El progreso tecnológico en este sector ha desencadenado una verdadera carrera armamentística entre quienes desarrollan sistemas de inteligencia artificial y quienes intentan eludirlos. Por un lado, los ingenieros trabajan para hacer que las redes neuronales sean más robustas, entrenándolas para reconocer e ignorar los parches adversarios. Por otro lado, los investigadores (y potencialmente los malintencionados) desarrollan patrones cada vez más sofisticados, capaces de adaptarse a diferentes ángulos, condiciones de luz e incluso de engañar a los sensores infrarrojos.

Esta dinámica es fundamental para la mejora de la tecnología. Descubrir que un simple jersey puede cegar un sistema de seguridad obliga a los desarrolladores a no dar por sentada la infalibilidad de sus creaciones. Nos recuerda que la inteligencia artificial es una herramienta poderosa, pero frágil, y que su integración en infraestructuras críticas requiere una comprensión profunda de sus limitaciones intrínsecas.

En Breve (TL;DR)

Nuestras ciudades están vigiladas por cámaras inteligentes, pero un simple jersey puede proteger nuestra privacidad engañando a la inteligencia artificial.

Los sistemas de visión artificial analizan los píxeles para reconocer a los peatones, pero se confunden con ciertas impresiones llamadas parches adversarios.

Al usar estas prendas con patrones visuales dirigidos al torso, el algoritmo se satura y el individuo resulta digitalmente invisible para las cámaras.

Conclusiones

El jersey adversario representa una fascinante paradoja de nuestra era digital: la tecnología más compleja y sofisticada puede ser derrotada por un trozo de algodón estampado. Esta prenda no es solo un curioso truco para escapar del Gran Hermano, sino la manifestación física de una vulnerabilidad matemática. Nos enseña que, mientras la inteligencia artificial continúa evolucionando y permeando cada aspecto de nuestras vidas, nuestra comprensión de cómo estas máquinas “piensan” y “ven” debe evolucionar al mismo ritmo. La invisibilidad, hoy en día, no requiere magia, sino solo la combinación adecuada de píxeles impresos en una prenda de vestir cotidiana.

Preguntas frecuentes

Un jersey adversario es una prenda de vestir especial diseñada para engañar a los sistemas de vigilancia basados en inteligencia artificial. Presenta una impresión particular, denominada parche adversario, que genera ruido visual y confunde los algoritmos de detección. Al usar esta prenda, los cálculos matemáticos de la cámara se descontrolan y la persona se vuelve, de hecho, invisible al sistema digital.

Los sistemas de visión artificial no perciben el mundo como los humanos, sino que analizan una cuadrícula de píxeles evaluando los colores y la intensidad de la luz. A través de redes neuronales convolucionales, los algoritmos buscan patrones específicos como contrastes y formas geométricas típicas del cuerpo humano. Si estos elementos matemáticos coinciden con los datos de entrenamiento, el software identifica la presencia de un peatón.

Los softwares de detección peatonal se centran principalmente en la identificación del torso y los hombros, al ser las partes del cuerpo más grandes y menos propensas a obstáculos visuales. Un jersey ofrece una superficie extensa y relativamente plana, ideal para alojar la impresión del patrón adversario sin deformarlo demasiado durante los movimientos. Cubrir esta área crítica maximiza las probabilidades de éxito de la ilusión óptica digital.

El problema de las vulnerabilidades matemáticas afecta a todo el campo del aprendizaje automático, no solo a las cámaras de seguridad. En el sector de los vehículos autónomos, pequeñas pegatinas en una señal de tráfico pueden alterar por completo la percepción del automóvil, causando graves peligros. Incluso los modelos lingüísticos avanzados pueden sufrir manipulaciones similares mediante secuencias de texto específicas diseñadas para eludir los filtros de seguridad.

Actualmente, existe un verdadero desafío tecnológico entre quienes crean sistemas de seguridad y quienes diseñan métodos para eludirlos. Los ingenieros informáticos trabajan constantemente para hacer que las redes neuronales sean más robustas, entrenándolas para reconocer e ignorare patrones engañosos. Esta dinámica es esencial para descubrir los límites intrínsecos de la tecnología y mejorar la fiabilidad de las infraestructuras críticas del futuro.

¿Todavía tienes dudas sobre ¿Por qué una simple prenda de vestir colapsa la IA??

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

- Aprendizaje automático adversario: vulnerabilidades y ataques visuales en la IA (Wikipedia)

- Aprendizaje Automático Adversario: Taxonomía y Terminología de Ataques y Mitigaciones (NIST, Gobierno de EE. UU.)

- Red neuronal convolucional (CNN): cómo procesan imágenes los sistemas de vigilancia (Wikipedia)

- Visión artificial: principios matemáticos y detección de objetos (Wikipedia)

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.