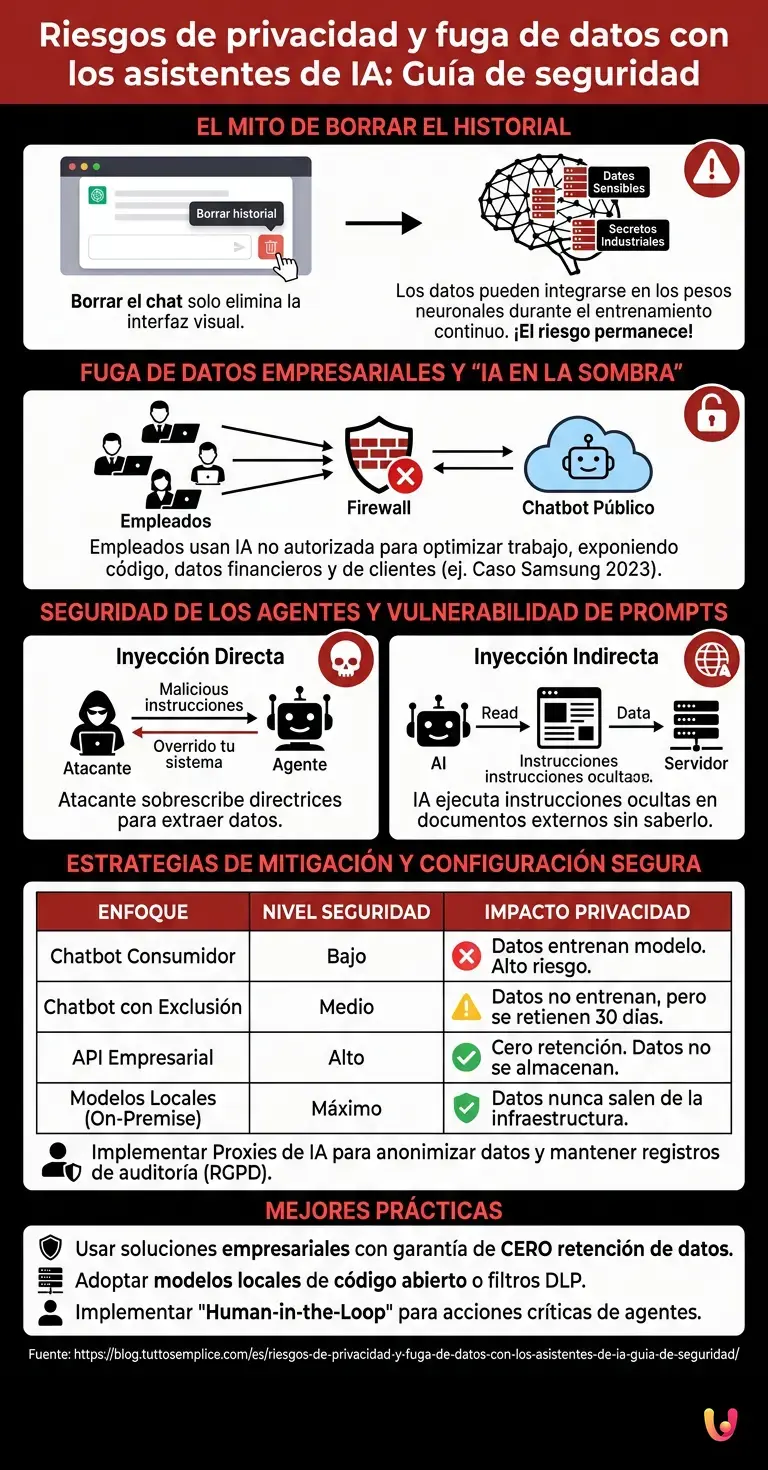

El mito más peligroso sobre la privacidad y la inteligencia artificial es creer que borrar el historial de un chat elimina los datos proporcionados. En realidad, si una información sensible es procesada por un modelo generativo sin las protecciones empresariales adecuadas, puede integrarse en los pesos neuronales del sistema durante las fases de ajuste fino o aprendizaje continuo. La eliminación solo elimina la interfaz visual para el usuario, pero el riesgo de fuga de datos permanece permanentemente, exponiendo secretos industriales a cualquiera que sepa formular la consulta correcta.

Seleccione el tipo de datos y el modelo utilizado para evaluar el riesgo de exposición de la información.

Cómo los modelos lingüísticos manejan los datos sensibles

Al analizar la privacidad en la inteligencia artificial , es fundamental comprender que los modelos lingüísticos no “olvidan” fácilmente . Los datos introducidos en las indicaciones pueden utilizarse para el reentrenamiento continuo, exponiendo la información empresarial a usuarios externos en sesiones futuras y comprometiendo la confidencialidad.

Los grandes modelos de lenguaje (LLM) como GPT-4, Claude o Gemini operan en dos fases distintas: el entrenamiento y la inferencia (generación de la respuesta). El problema surge cuando las plataformas de consumo utilizan los datos de inferencia para alimentar los ciclos de entrenamiento posteriores. Según la documentación oficial de OpenAI, las conversaciones realizadas a través de la interfaz web estándar (sin opción de exclusión) pueden ser revisadas por moderadores humanos y utilizadas para mejorar el modelo.

Esto significa que si un usuario introduce un contrato confidencial para solicitar un resumen, fragmentos de ese contrato podrían aparecer como resultado si otro usuario, en otra parte del mundo, realiza una consulta estadísticamente correlacionada. La gestión de datos sensibles requiere, por lo tanto, una transición obligatoria a soluciones empresariales que garanticen contractualmente la retención cero de datos .

El fenómeno de la fuga de datos empresariales

La fuga de datos relacionada con la privacidad y la inteligencia artificial ocurre cuando los empleados pegan código fuente, datos financieros o información de clientes en chatbots públicos. Esto convierte las herramientas de productividad en graves fallas de seguridad para toda la infraestructura de TI.

El fenómeno de la IA en la sombra (el uso no autorizado de herramientas de IA por parte de los empleados) es hoy la principal causa de fuga de datos. Los empleados, impulsados por la necesidad de optimizar su trabajo, eluden los controles de TI y alimentan a los algoritmos con información protegida por acuerdos de confidencialidad (NDA).

Caso de estudio real: La fuga de datos de Samsung (2023)

En la primavera de 2023, la división de semiconductores de Samsung registró tres incidentes de seguridad distintos en menos de un mes. Los ingenieros de la empresa habían pegado código fuente propietario y grabaciones de reuniones internas en ChatGPT para detectar errores y generar actas. Debido a que el uso se realizaba a través de la interfaz de consumidor, los secretos industriales de Samsung terminaron en los servidores de entrenamiento de OpenAI, lo que obligó a la empresa surcoreana a prohibir temporalmente el uso de la IA generativa en los dispositivos de la empresa.

Seguridad de la agente y vulnerabilidad de los prompts

La seguridad de los agentes representa la nueva frontera de la privacidad en la inteligencia artificial . Cuando los agentes de IA operan de forma autónoma accediendo a bases de datos empresariales, el riesgo de extracción no autorizada de datos mediante inyección de instrucciones aumenta exponencialmente.

Con la evolución de la IA conversacional a la IA agentiva (sistemas capaces de realizar acciones, leer correos electrónicos, consultar bases de datos y enviar mensajes), el perímetro de seguridad se ha ampliado. Un atacante ya no necesita violar un servidor; le basta con manipular al agente de IA.

- Inyección directa de instrucciones: El usuario malintencionado proporciona instrucciones que sobrescriben las directrices del sistema de la IA , obligándola a revelar datos sensibles presentes en su contexto.

- Inyección indirecta de instrucciones: El agente de IA lee un documento externo (p. ej., una página web o un correo electrónico) que contiene instrucciones maliciosas ocultas. La IA ejecuta estas instrucciones sin el conocimiento del usuario, pudiendo potencialmente extraer datos privados hacia servidores externos.

Para garantizar la seguridad de los agentes , es esencial implementar arquitecturas Human-in-the-Loop (HITL), donde las acciones críticas siempre requieren la aprobación humana, y aislar los entornos de ejecución de los agentes (sandboxing).

Estrategias de mitigación y configuraciones seguras

Para garantizar una sólida privacidad en la inteligencia artificial , las empresas deben adoptar políticas estrictas. El uso de API con acuerdos de no entrenamiento y la implementación de filtros DLP (prevención de pérdida de datos) son pasos técnicos obligatorios para mitigar los riesgos.

La prevención de fugas de datos requiere un enfoque multinivel. No basta con bloquear las URL de los chatbots a nivel de firewall, ya que las alternativas proliferan a diario. Es necesario implementar soluciones estructurales:

| Enfoque | Nivel de seguridad | Impacto en la privacidad |

|---|---|---|

| Chatbot web para consumidores | Bajo | Datos utilizados para el entrenamiento. Alto riesgo de fuga de información. |

| Chatbot web con opción de exclusión | Medio | Los datos no entrenan al modelo, pero permanecen en los servidores durante 30 días. |

| Acceso vía API (Empresarial) | Alto | Cero retención de datos. Los datos no se almacenan ni se utilizan. |

| Modelos de código abierto locales (p. ej., LLaMA) | Máximo | Los datos nunca abandonan la infraestructura empresarial (On-Premise). |

Además, la adopción de proxies de IA empresariales permite interceptar las solicitudes de los empleados, anonimizar los datos sensibles (como números de tarjetas de crédito o códigos fiscales) antes de que lleguen a la nube del LLM , y mantener un registro de auditoría completo para el cumplimiento del RGPD.

Conclusiones

La gestión de la privacidad en la inteligencia artificial no puede delegarse al buen juicio de los usuarios individuales. Como hemos analizado, el uso diario de modelos generativos expone a las organizaciones a riesgos concretos de fuga de datos y vulnerabilidades relacionadas con la seguridad de los agentes. La transición hacia un uso consciente de la IA requiere el abandono de las herramientas de consumo en el ámbito laboral en favor de soluciones empresariales, API blindadas o modelos ejecutados localmente. Solo a través de una infraestructura Zero Trust aplicada a los prompts y la formación continua del personal, es posible aprovechar el enorme potencial de la informática generativa sin comprometer el patrimonio informativo de la empresa.

Preguntas frecuentes

Para proteger la información sensible, es fundamental evitar las versiones públicas de los chatbots. Las empresas deberían adoptar soluciones empresariales con garantía de cero retención de datos, utilizar modelos de código abierto instalados en sus propios servidores locales o implementar filtros de prevención para bloquear la transmisión de información confidencial. Solo un enfoque estructurado garantiza la seguridad total.

Eliminar las conversaciones solo oculta la información visualmente para el usuario del servicio, pero no borra los datos de los servidores del proveedor. Si los datos fueron procesados por un modelo sin protecciones empresariales, podrían ya haberse integrado en los pesos neuronales del sistema durante la fase de entrenamiento continuo. Esto significa que los secretos industriales siguen siendo potencialmente accesibles a otras personas en sesiones futuras.

Este término se refiere al uso no autorizado de herramientas generativas por parte del personal de la empresa sin el consentimiento del departamento de informática. Representa una grave amenaza, ya que los empleados, en un intento por acelerar sus tareas diarias, podrían introducir contratos, código fuente o datos de clientes en plataformas públicas. Este comportamiento transforma herramientas útiles en graves vulnerabilidades de seguridad para toda la red informática.

Los agentes autónomos que acceden a bases de datos o leen correos electrónicos pueden sufrir ataques informáticos a través de instrucciones maliciosas ocultas en documentos externos. Un atacante puede forzar al sistema a ignorar las directivas de seguridad y a exfiltrar documentos privados a servidores no autorizados. Para mitigar este riesgo, resulta absolutamente necesaria la supervisión humana para aprobar cada operación crítica.

El cumplimiento normativo exige la adopción de proxies corporativos capaces de anonimizar los datos personales antes de que lleguen a los servidores remotos. Asimismo, es necesario establecer acuerdos precisos con los proveedores para impedir la fase de entrenamiento con los datos introducidos. Finalmente, las empresas deben mantener registros de control exhaustivos para demostrar el cumplimiento total de las leyes vigentes en materia de protección de datos.

¿Todavía tienes dudas sobre Riesgos de privacidad y fuga de datos con los asistentes de IA: Guía de seguridad?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.