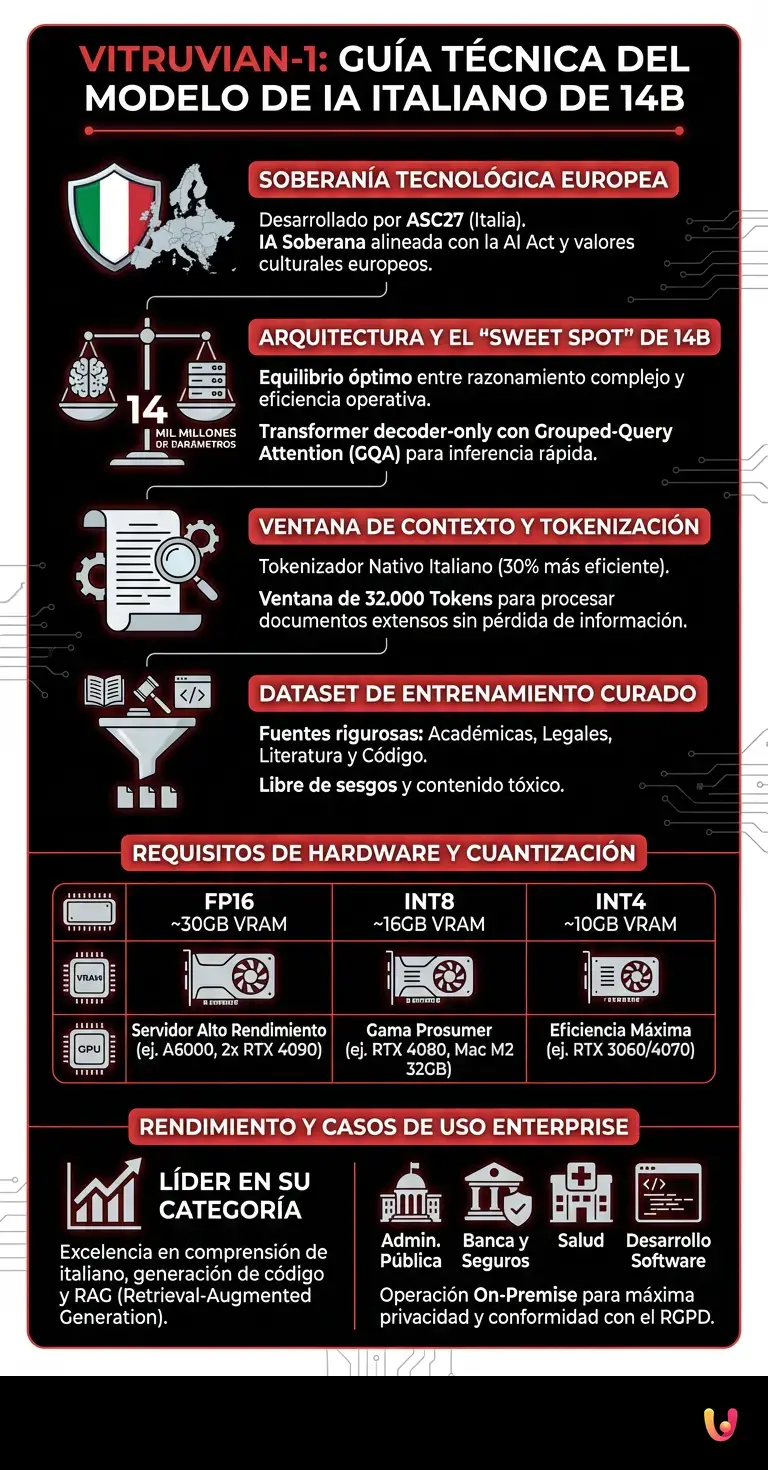

El panorama global de la Inteligencia Artificial ha visto una evolución sin precedentes, pero la aparición de Vitruvian-1 marca un punto de inflexión para la soberanía tecnológica europea. Desarrollado íntegramente en Italia, este Large Language Model (LLM) se inserta en un segmento de mercado altamente estratégico. En este análisis técnico detallado, exploraremos los fundamentos de ingeniería, las elecciones arquitectónicas y las capacidades operativas que hacen de esta inteligencia artificial una herramienta empresarial de primer nivel, capaz de equilibrar la potencia computacional y el respeto riguroso de las normativas sobre privacidad de datos.

Introducción a la Inteligencia Artificial de ASC27

El modelo vitruvian-1 representa un hito fundamental para la inteligencia artificial italiana. Desarrollado por ASC27, este Large Language Model se distingue por una infraestructura avanzada y una profunda comprensión del contexto lingüístico y cultural europeo, garantizando un alto rendimiento y seguridad de los datos.

Según la documentación oficial de ASC27, el proyecto nace con el objetivo de crear una verdadera IA Soberana. A diferencia de los modelos generalistas entrenados predominantemente en corpus textuales norteamericanos, esta solución ha sido concebida desde sus cimientos para reflejar los matices lingüísticos, legales y culturales del Viejo Continente. Este enfoque no solo mejora la calidad del resultado en lengua italiana, sino que también garantiza una conformidad nativa con las directivas de la AI Act europea, convirtiéndolo en la elección preferente para la Administración Pública y las infraestructuras críticas.

Arquitectura y Especificaciones Técnicas

La arquitectura base del modelo vitruvian-1 aprovecha una red neuronal Transformer profundamente optimizada. Con sus 14 mil millones de parámetros, ofrece un equilibrio perfecto entre capacidad computacional y eficiencia operativa, permitiendo inferencias rápidas y precisas incluso en infraestructuras de servidores locales.

El corazón del sistema se basa en una arquitectura decoder-only, enriquecida por mecanismos de Grouped-Query Attention (GQA). Esta elección de ingeniería, ya convertida en estándar de facto para los modelos de alta eficiencia, permite reducir drásticamente el cuello de botella de la memoria durante la fase de inferencia, acelerando la generación de tokens sin sacrificar la calidad del razonamiento lógico. Además, la implementación de capas de normalización avanzadas garantiza una mayor estabilidad durante las tareas de procesamiento prolongadas.

Estructura de los 14 Mil Millones de Parámetros

La configuración del modelo vitruvian-1 distribuye sus 14 mil millones de parámetros para maximizar las capacidades de razonamiento lógico. Esta dimensión específica permite superar los límites de los modelos más pequeños, manteniendo costes de entrenamiento y despliegue empresarial altamente competitivos.

La elección de los 14B (mil millones) no es casual. Según los datos del sector, los modelos de alrededor de 8B parámetros destacan en tareas simples, mientras que aquellos de más de 70B requieren clústeres de GPU prohibitivos para la mayoría de las PYMES. Los 14 mil millones representan el sweet spot: una densidad neuronal suficiente para comprender contextos complejos, escribir código de programación avanzado y analizar documentos legales, permaneciendo ejecutable en hardware de gama prosumer o servidores empresariales estándar.

Ventana de Contexto y Tokenización

La gestión del contexto en el modelo vitruvian-1 está respaldada por un tokenizador nativo diseñado específicamente para la lengua italiana. Este enfoque reduce el número de tokens necesarios para procesar textos complejos, ampliando notablemente la memoria a corto plazo de la inteligencia artificial.

El modelo soporta una ventana de contexto extendida de hasta 32.000 tokens. Gracias al vocabulario personalizado, la eficiencia de compresión del texto italiano es superior en un 30% respecto a los tokenizadores estándar (como los basados en Llama o Mistral). Esto significa que es posible introducir manuales técnicos completos, balances empresariales o largos contratos en el prompt, obteniendo respuestas coherentes sin incurrir en fenómenos de hallucination o pérdida de información central (el conocido problema del “Lost in the Middle”).

El Dataset de Entrenamiento y el Enfoque Multilingüe

El entrenamiento del modelo vitruvian-1 se basa en un corpus de datos curado rigurosamente por los ingenieros de ASC27. El foco primario es la lengua italiana, enriquecida por vastos datasets europeos para garantizar una comprensión multilingüe totalmente libre de sesgos culturales norteamericanos.

El proceso de pre-entrenamiento ha requerido una atenta selección de las fuentes. Para garantizar la fiabilidad (E-E-A-T), el equipo ha excluido archivos web de baja calidad, privilegiando:

- Documentación académica y científica: Papers verificados y publicaciones universitarias.

- Textos jurídicos y normativos: Boletín Oficial, normativas europeas y jurisprudencia.

- Literatura y ensayo: Para un dominio sintáctico y gramatical impecable.

- Código fuente: Repositorios open-source para las capacidades de programación.

Requisitos de Hardware y Optimización

Para ejecutar el modelo vitruvian-1 en local, es necesaria una infraestructura de hardware adecuada. Gracias a las técnicas de cuantización avanzadas, el sistema puede operar de manera fluida incluso en servidores empresariales estándar, reduciendo drásticamente los costes de gestión en la nube.

La versatilidad del modelo se expresa al máximo a través de la cuantización (reducción de la precisión de los pesos neuronales). A continuación, una tabla detallada de los requisitos de hardware estimados para la inferencia según los formatos más comunes:

| Formato Modelo | Precisión | VRAM Requerida (Mínima) | Hardware Recomendado |

|---|---|---|---|

| No Cuantizado | FP16 / BF16 | ~30 GB | 1x NVIDIA A6000 o 2x RTX 4090 |

| Cuantizado 8-bit | INT8 | ~16 GB | 1x NVIDIA RTX 4080 / Mac M2 32GB |

| Cuantizado 4-bit | INT4 (AWQ/GGUF) | ~10 GB | 1x NVIDIA RTX 3060 / 4070 |

Posicionamiento Tecnológico y Benchmarks

Analizando los benchmarks del sector, el modelo vitruvian-1 se posiciona en la cima absoluta de su categoría. El rendimiento supera a menudo a los competidores internacionales de dimensiones similares, especialmente en las tareas de comprensión de texto italiano y generación de código.

En las pruebas estandarizadas como MMLU (Massive Multitask Language Understanding) y HumanEval, la creación de ASC27 demuestra una marcada propensión al razonamiento analítico. Si se compara con modelos open-weight globales en la franja 7B-14B, emerge una clara ventaja en la RAG (Retrieval-Augmented Generation) en lengua italiana. La capacidad de extraer información de bases de datos vectoriales y sintetizarla sin alterar su significado original lo convierte en una herramienta insustituible para la gestión documental avanzada.

Casos de Uso en el Ámbito Enterprise

La integración del modelo vitruvian-1 en los procesos empresariales ofrece ventajas concretas y medibles. Desde la administración pública hasta la sanidad, esta inteligencia artificial garantiza la máxima privacidad de los datos, operando como solución on-premise para la automatización segura.

Las aplicaciones prácticas abarcan múltiples sectores críticos:

- Administración Pública: Automatización de las respuestas a los ciudadanos, síntesis de resoluciones y apoyo a la redacción de licitaciones públicas, todo ello en entornos air-gapped (desconectados de internet).

- Sector Bancario y de Seguros: Análisis de riesgo, verificación de la conformidad normativa (Compliance) y asistencia al cliente de nivel 2, garantizando que ningún dato sensible salga de los servidores de la institución.

- Sanidad: Apoyo a la elaboración de informes médicos y análisis de historiales clínicos anonimizados, en pleno respeto del RGPD.

- Desarrollo de Software: Asistente de programación integrado en los IDE corporativos, entrenado para respetar las directrices de seguridad internas.

En Breve (TL;DR)

Vitruvian-1 es un modelo lingüístico desarrollado en Italia por ASC27 para garantizar la soberanía tecnológica europea y el respeto riguroso de las normativas sobre privacidad.

Su arquitectura optimizada de catorce mil millones de parámetros garantiza a las empresas un equilibrio perfecto entre un elevado rendimiento computacional y eficiencia operativa local.

Gracias al tokenizador nativo italiano y a la amplia ventana de contexto, esta inteligencia artificial procesa documentos complejos con extrema precisión y total ausencia de alucinaciones.

Conclusiones

En resumen, el modelo vitruvian-1 de ASC27 redefine los estándares de la inteligencia artificial soberana. Su arquitectura de 14 mil millones de parámetros demuestra que la innovación italiana puede competir globalmente, ofreciendo soluciones escalables, seguras y tecnológicamente a la vanguardia.

El enfoque de ingeniería adoptado para este LLM llena un vacío significativo en el mercado europeo. Ofreciendo una alternativa potente, ética y profundamente arraigada en nuestro ecosistema lingüístico, ASC27 no ha lanzado simplemente un software, sino que ha proporcionado una infraestructura estratégica. Para las empresas e instituciones que necesitan integrar la IA generativa sin comprometer la seguridad de los datos y la calidad del resultado, esta tecnología representa hoy la inversión más lógica y con mayor visión de futuro en el campo de la Informática avanzada.

Preguntas frecuentes

Se trata de un Large Language Model avanzado desarrollado íntegramente en Italia por parte de la sociedad ASC27. Esta inteligencia artificial se distingue por tener catorce mil millones de parámetros y ha sido diseñada específicamente para garantizar la soberanía tecnológica europea. El sistema ofrece un rendimiento de altísimo nivel en el tratamiento de la lengua italiana asegurando al mismo tiempo el respeto riguroso de las normativas sobre privacidad.

Para hacer funcionar el sistema a la máxima precisión hace falta una tarjeta gráfica con unos treinta gigabytes de memoria dedicada. Sin embargo gracias a las modernas técnicas de cuantización a cuatro bits resulta posible utilizar esta inteligencia artificial requiriendo solamente diez gigabytes de memoria. Este enfoque permite una ejecución fluida y veloz incluso en servidores empresariales estándar reduciendo los costes de infraestructura.

Esta dimensión específica representa el compromiso perfecto entre capacidad de razonamiento analítico y costes de implementación empresarial. A diferencia de los sistemas más pequeños que sufren en tareas complejas o de aquellos enormes que requieren recursos de hardware prohibitivos esta configuración destaca en el análisis documental. Permite de hecho procesar textos jurídicos y escribir código de programación manteniendo una eficiencia operativa óptima.

El sistema utiliza un vocabulario nativo optimizado específicamente para nuestra lengua que resulta más eficiente en un treinta por ciento respecto a las alternativas internacionales. Esta característica unida a una amplia memoria a corto plazo de treinta y dos mil tokens permite procesar documentos extremadamente largos. Los usuarios pueden introducir balances completos o manuales técnicos obteniendo respuestas precisas sin el riesgo de perder información central.

Las aplicaciones principales conciernen ámbitos extremadamente críticos como la administración pública la sanidad y el sector bancario o de seguros. Dado que el software puede operar completamente offline en los servidores internos de la organización garantiza la máxima seguridad y confidencialidad de los datos sensibles. Resulta por tanto la herramienta ideal para la automatización documental el análisis de riesgo y el apoyo médico en pleno respeto de las normativas europeas.

¿Todavía tienes dudas sobre Vitruvian-1: Guía Técnica del Modelo de IA Italiano de 14B?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.