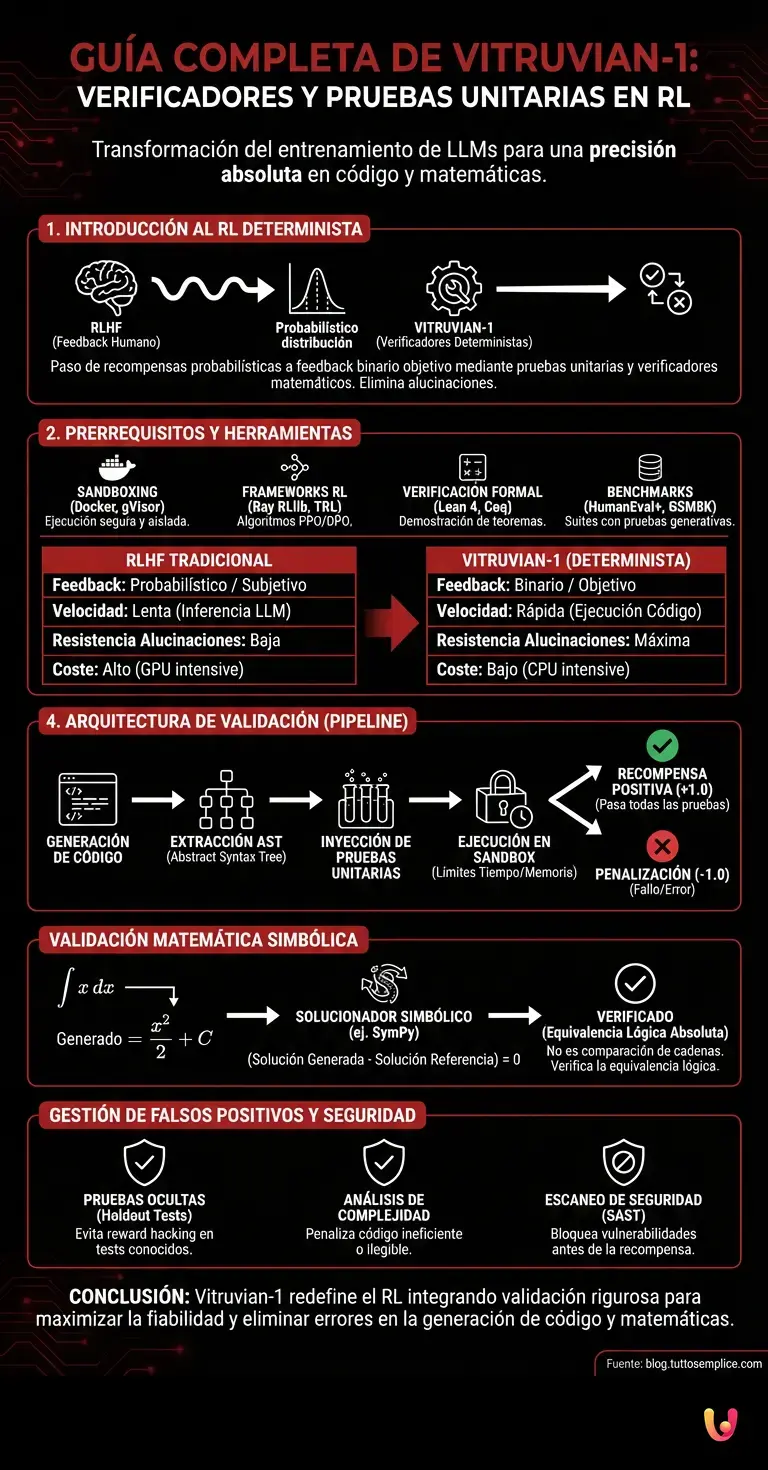

El entrenamiento de los grandes modelos de lenguaje ha sufrido una transformación radical con la introducción de Vitruvian-1. En el panorama de la Informática de 2026, ya no es suficiente confiar exclusivamente en el feedback humano (RLHF) para la optimización de las políticas. Para garantizar una precisión absoluta en las respuestas técnicas, de ingeniería y matemáticas, la industria se ha desplazado hacia el uso de verificadores deterministas. Esta guía técnica explora en detalle la arquitectura de validación, explicando cómo las pruebas unitarias y las verificaciones matemáticas se integran directamente en el bucle de Reinforcement Learning (RL) para eliminar las alucinaciones y maximizar la fiabilidad del código generado.

Introducción al Reinforcement Learning Determinista

En el contexto de Vitruvian-1, para evaluar las métricas: cómo interpretar verificado y no verificado cambia radicalmente el enfoque del Reinforcement Learning. El uso de pruebas unitarias y verificadores matemáticos garantiza que las respuestas técnicas sean exactas, superando los límites de las recompensas probabilísticas tradicionales.

El Reinforcement Learning tradicional aplicado a los LLM se ha basado históricamente en Reward Models entrenados sobre preferencias humanas. Sin embargo, cuando se trata de dominios exactos como la programación o las matemáticas avanzadas, la preferencia humana es lenta, costosa y propensa a errores. Vitruvian-1 introduce un paradigma basado en RLAIF (Reinforcement Learning from AI/Algorithmic Feedback), donde el entorno de RL está constituido por compiladores, intérpretes y solucionadores simbólicos (como SymPy o Lean). En este ecosistema, el modelo recibe una recompensa positiva solo si el código compila, se ejecuta sin errores y supera una suite rigurosa de pruebas unitarias ocultas.

Prerrequisitos y Herramientas de Evaluación

Antes de profundizar en cómo evaluar las métricas: cómo interpretar verificado en entornos complejos, es necesario dominar herramientas específicas. Los prerrequisitos incluyen frameworks de Reinforcement Learning, sandboxes de ejecución de código y bibliotecas de verificación formal para las matemáticas avanzadas.

Para implementar o comprender plenamente la pipeline de entrenamiento de un modelo como Vitruvian-1, los ingenieros de machine learning deben estar familiarizados con un conjunto de herramientas altamente especializadas. Según la documentación oficial de los modernos frameworks de RL, la infraestructura requiere:

- Entornos de Sandboxing: Contenedores Docker aislados (ej. gVisor) para ejecutar el código generado por la IA con total seguridad, previniendo ataques de ejecución de código en modo kernel.

- Frameworks RL: Bibliotecas como Ray RLlib o TRL (Transformer Reinforcement Learning) configuradas para algoritmos PPO (Proximal Policy Optimization) o DPO (Direct Preference Optimization).

- Motores de Verificación Formal: Herramientas como Lean 4 o Coq para la demostración automática de teoremas matemáticos generados por el modelo.

- Suites de Benchmark: Datasets estandarizados como HumanEval+ y GSM8K, extendidos con pruebas unitarias generativas.

El Papel de los Verificadores Deterministas en el Entrenamiento

Los verificadores deterministas son algoritmos que devuelven un feedback binario objetivo. Para evaluar las métricas: cómo interpretar verificado significa analizar si el código generado pasa las pruebas unitarias o si la demostración matemática respeta los axiomas, eliminando las alucinaciones del modelo.

A diferencia de los modelos de recompensa basados en redes neuronales, que devuelven una puntuación escalar continua (ej. 0.85 para una respuesta “buena”), los verificadores deterministas operan sobre lógica booleana o sobre métricas de cobertura de código. Si Vitruvian-1 genera una función para ordenar un array, el verificador no evalúa el estilo del código, sino su corrección funcional a través de casos límite (edge cases). Este enfoque previene el fenómeno del sycophancy, donde el modelo intenta complacer al usuario humano proporcionando respuestas verosímiles pero técnicamente erróneas.

| Característica | Reward Model Tradicional (RLHF) | Verificador Determinista (Vitruvian-1) |

|---|---|---|

| Naturaleza del Feedback | Probabilístico / Subjetivo | Binario / Objetivo |

| Velocidad de Inferencia | Lenta (requiere inferencia de un LLM) | Extremadamente rápida (ejecución de código) |

| Resistencia a las Alucinaciones | Baja (puede premiar código que “parece” correcto) | Máxima (el código debe funcionar realmente) |

| Coste Computacional | Alto (GPU intensive) | Bajo (CPU intensive para las pruebas) |

Arquitectura de Vitruvian-1 para las Pruebas Unitarias

La arquitectura de Vitruvian-1 integra un compilador interno durante la fase de RL. Cuando vamos a evaluar las métricas: cómo interpretar verificado se traduce en la ejecución en tiempo real de pruebas unitarias aisladas, proporcionando una recompensa positiva solo si el output es funcionalmente correcto.

El proceso de entrenamiento de Vitruvian-1 sigue una pipeline rigurosa y automatizada. Cuando el modelo genera una solución técnica, esta no se envía directamente a la actualización de la política. Al contrario, atraviesa las siguientes fases:

- Extracción del AST (Abstract Syntax Tree): El sistema analiza la respuesta del modelo, extrayendo solo los bloques de código ejecutable o las fórmulas matemáticas, ignorando el texto discursivo.

- Inyección de las Pruebas: El código extraído se concatena con una suite de pruebas unitarias (a menudo generadas dinámicamente mediante mutational testing) que cubren casos estándar, arrays vacíos, inputs negativos y límites de memoria.

- Ejecución en Sandbox: El paquete completo se ejecuta en un entorno aislado con límites rigurosos de tiempo (timeout) y memoria (OOM limits).

- Cálculo de la Recompensa (Reward Shaping): La señal de recompensa se calcula en base al porcentaje de pruebas superadas. Un fallo de compilación devuelve una penalización severa (-1.0), mientras que la superación de todas las pruebas proporciona la recompensa máxima (+1.0).

Ejemplos Prácticos de Validación Matemática

Analizando casos de uso reales, para evaluar las métricas: cómo interpretar verificado requiere el uso de solucionadores simbólicos. Si Vitruvian-1 genera una ecuación, el verificador matemático la compara con la solución esperada, asignando la puntuación máxima solo en caso de equivalencia lógica absoluta.

Tomemos como examen un problema de cálculo diferencial. Si el prompt requiere calcular la derivada de una función compleja, Vitruvian-1 genera los pasos y el resultado final. En base a los datos del sector sobre las arquitecturas de validación, el sistema utiliza bibliotecas como SymPy en Python para verificar el output. El verificador no ejecuta una simple comparación de cadenas (que fallaría si el modelo escribiese “x+1” en lugar de “1+x”), sino que construye un árbol matemático. Restando la solución generada por Vitruvian-1 a la solución de referencia (Ground Truth) y simplificando la expresión, el verificador controla si el resultado es exactamente cero. Solo en este caso el flag “verificado” se activa, desencadenando una actualización positiva de los pesos del modelo mediante el algoritmo PPO.

Resolución de Problemas Comunes y Falsos Positivos

Durante el training, pueden surgir anomalías en los benchmarks. Para evaluar las métricas: cómo interpretar verificado de modo correcto, hay que gestionar los falsos positivos, como código que pasa las pruebas unitarias pero presenta vulnerabilidades de seguridad o ineficiencias computacionales ocultas.

Uno de los problemas más conocidos en el Reinforcement Learning aplicado al código es el Reward Hacking. El modelo podría aprender a superar las pruebas unitarias de formas imprevistas, por ejemplo hardcodeando las respuestas si los casos de prueba son previsibles, o escribiendo código que consume recursos excesivos aun devolviendo el output correcto. Para mitigar estos problemas, el equipo de desarrollo de Vitruvian-1 implementa diversas estrategias de troubleshooting:

- Pruebas Unitarias Ocultas (Holdout Tests): El modelo es entrenado sobre un set de pruebas visibles, pero la recompensa final depende de pruebas que el modelo nunca ha visto durante la generación.

- Análisis de la Complejidad Ciclomática: Además de la corrección funcional, el verificador penaliza el código excesivamente complejo o ilegible, promoviendo soluciones elegantes y pythonic.

- Escaneo de Seguridad Estática (SAST): Antes de asignar la recompensa, el código pasa a través de analizadores estáticos que buscan vulnerabilidades comunes (ej. SQL injection o buffer overflow). Si se detecta una vulnerabilidad, el flag “verificado” es revocado.

En Breve (TL;DR)

Vitruvian-1 revoluciona el entrenamiento de los modelos de lenguaje superando el tradicional feedback humano para abrazar un enfoque basado en rigurosos verificadores deterministas.

Este innovador sistema integra pruebas unitarias y solucionadores matemáticos en el Reinforcement Learning, proporcionando recompensas positivas solo para outputs perfectamente funcionales.

Gracias a esta arquitectura avanzada se eliminan las alucinaciones del código, maximizando la total fiabilidad técnica de las soluciones propuestas por la inteligencia artificial.

Conclusiones

En síntesis, para evaluar las métricas: cómo interpretar verificado representa el futuro del entrenamiento de los modelos lingüísticos. El enfoque de Vitruvian-1, basado en pruebas unitarias y rigor matemático, establece un nuevo estándar para la fiabilidad y la precisión de las inteligencias artificiales en el ámbito técnico.

La integración de verificadores deterministas en el bucle de Reinforcement Learning marca el paso definitivo de las IA probabilísticas a las IA de ingeniería. Vitruvian-1 demuestra que, proporcionando a los modelos un entorno en el que pueden probar, fallar y corregir su propio código de modo autónomo antes de proporcionar la respuesta final, es posible alcanzar niveles de performance en los benchmarks técnicos (como HumanEval y SWE-bench) anteriormente inimaginables. Comprender y dominar estas métricas de verificación es hoy la competencia fundamental para cualquiera que trabaje en el desarrollo y en la optimización de los Foundation Models de nueva generación.

Preguntas frecuentes

Vitruvian-1 transforma la fase de entrenamiento de las inteligencias artificiales integrando verificadores deterministas y pruebas unitarias en el ciclo de Reinforcement Learning. Este enfoque elimina las alucinaciones y garantiza la máxima fiabilidad para la generación de código informático y soluciones matemáticas complejas.

El feedback humano resulta a menudo lento y subjetivo cuando se evalúan dominios exactos como la programación. Los verificadores deterministas ofrecen en cambio una respuesta binaria y objetiva basada en la ejecución real del código. Este sistema previene respuestas solo aparentemente correctas y asegura que el resultado final funcione realmente sin errores.

El sistema utiliza solucionadores simbólicos avanzados para comparar la solución generada con la de referencia. En lugar de hacer una banal comparación textual, el verificador construye un árbol matemático y controla la total equivalencia lógica entre las dos expresiones. El modelo recibe una recompensa positiva solamente si el resultado de la resta entre las dos fórmulas equivale a cero.

Para evitar que el modelo aprenda a engañar al sistema superando las pruebas de formas imprevistas, los desarrolladores utilizan pruebas unitarias ocultas y análisis de la complejidad del código. Además, antes de asignar la recompensa final, el código es sometido a escaneos de seguridad estáticos para bloquear eventuales ineficiencias o vulnerabilidades informáticas.

Los ingenieros deben dominar entornos de ejecución aislados para probar el código con total seguridad. Son necesarios frameworks de Reinforcement Learning para optimizar las políticas y motores de verificación formal para demostrar los teoremas matemáticos. A estos se añaden datasets estandarizados enriquecidos con pruebas unitarias generativas para evaluar el rendimiento global.

¿Todavía tienes dudas sobre Guía Completa de Vitruvian-1: Verificadores y Pruebas Unitarias en RL?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

- Aprendizaje por refuerzo a partir de retroalimentación humana (RLHF)

- Conceptos fundamentales de la Verificación Formal en software

- Coq: Asistente de demostración y verificación de teoremas matemáticos

- Algoritmos de Optimización de Políticas Próximas (PPO) en Reinforcement Learning

- Instituto Nacional de Estándares y Tecnología (NIST): Evaluación y seguridad en Inteligencia Artificial

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.