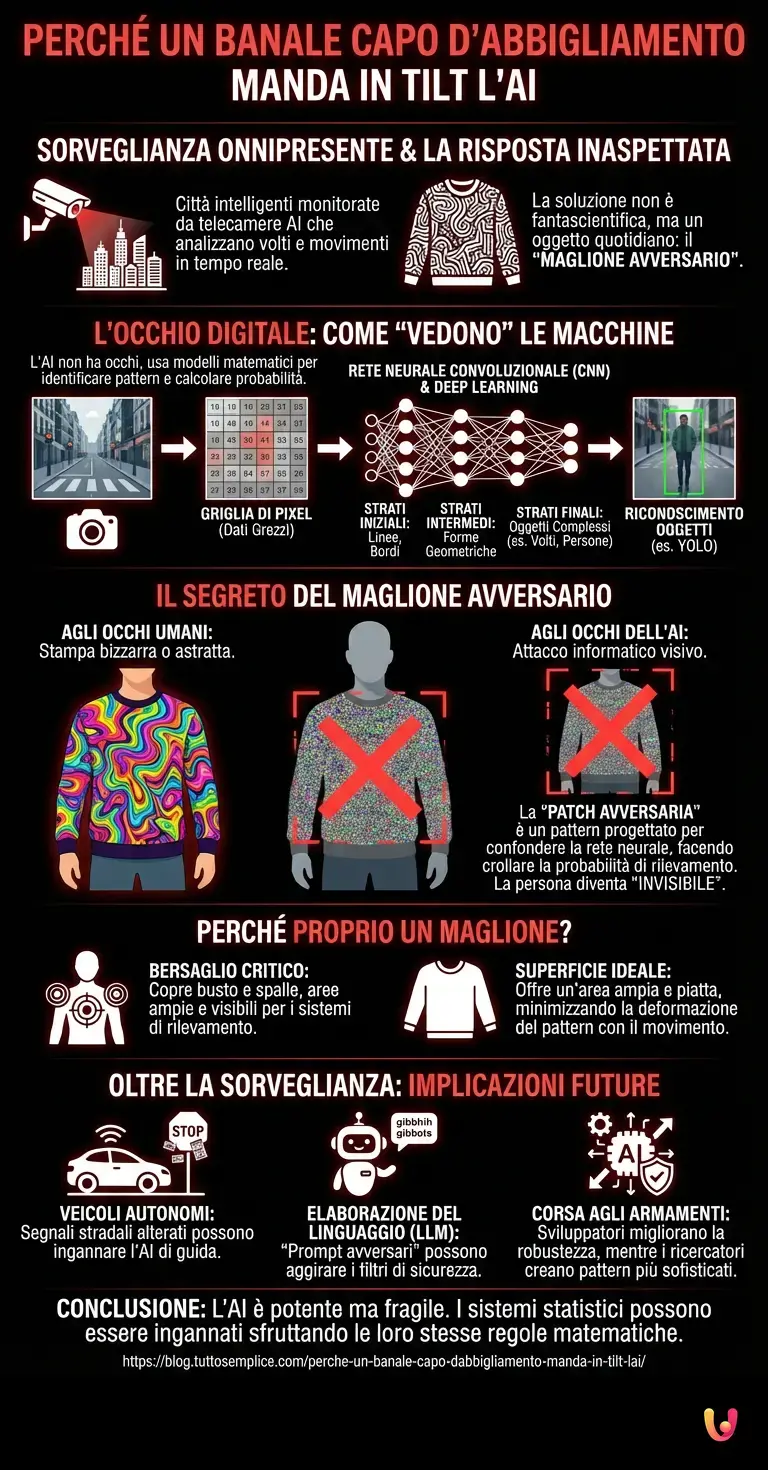

Viviamo in un’epoca in cui lo spazio pubblico è costantemente monitorato. Le nostre città sono diventate ecosistemi intelligenti, punteggiati da telecamere di sicurezza di ultima generazione capaci non solo di registrare immagini, ma di analizzarle in tempo reale. Riconoscono volti, tracciano movimenti, identificano comportamenti anomali. Di fronte a questa sorveglianza onnipresente, la reazione istintiva potrebbe essere quella di immaginare soluzioni fantascientifiche per tutelare la propria privacy, come mantelli dell’invisibilità o dispositivi di disturbo elettromagnetico. Eppure, la risposta più efficace e sorprendente si trova in un oggetto di uso quotidiano, noto agli esperti di sicurezza informatica come maglione avversario. Questo semplice indumento, all’apparenza innocuo, nasconde un segreto tecnologico in grado di mandare in tilt i sistemi di visione artificiale più avanzati del pianeta.

Per comprendere come un banale capo di vestiario possa sconfiggere sistemi di sorveglianza costati milioni di dollari in ricerca e sviluppo, è necessario compiere un passo indietro e analizzare il modo in cui le macchine “vedono” il mondo. L’intelligenza artificiale non possiede occhi, né un cervello biologico capace di interpretare la luce e le forme in modo intuitivo. La visione artificiale si basa su complessi modelli matematici e statistici.

L’occhio digitale: come “vedono” le macchine

Quando una telecamera inquadra una strada, non vede “persone” o “automobili”. Vede una griglia di pixel, ciascuno con un valore numerico che ne rappresenta il colore e l’intensità luminosa. È qui che entra in gioco il machine learning. Attraverso l’addestramento su milioni di immagini pre-etichettate, i sistemi imparano a riconoscere pattern specifici. Se un gruppo di pixel presenta determinate variazioni di contrasto, bordi e gradienti, il sistema calcola la probabilità che quell’agglomerato di dati rappresenti un essere umano.

Questo processo è reso possibile dal deep learning e, in particolare, da una specifica architettura neurale nota come Rete Neurale Convoluzionale (CNN). Queste reti analizzano l’immagine a strati: i primi strati riconoscono linee e bordi semplici, gli strati intermedi identificano forme geometriche, e gli strati finali mettono insieme questi elementi per riconoscere oggetti complessi, come un volto o la sagoma di un corpo umano. Sistemi famosi come YOLO (You Only Look Once) sono in grado di eseguire queste operazioni in frazioni di secondo, disegnando i cosiddetti “bounding box” (riquadri di delimitazione) attorno alle persone identificate nel video.

Il segreto svelato: la scienza del maglione avversario

Se l’AI si basa su pattern visivi per identificare un essere umano, cosa succede se le forniamo un pattern progettato specificamente per confonderla? È esattamente questo il principio alla base del maglione avversario. Non si tratta di un tessuto magico che piega la luce, ma di un capo d’abbigliamento stampato con un’immagine molto particolare, definita in gergo tecnico “patch avversaria” (adversarial patch).

Agli occhi di un essere umano, il maglione appare semplicemente come un indumento con una stampa bizzarra, forse un po’ psichedelica o astratta. Potrebbe sembrare un’immagine sfocata di persone in un mercato, o un collage di forme geometriche colorate. Ma per gli algoritmi di rilevamento degli oggetti, quella stampa è un vero e proprio attacco informatico visivo.

I ricercatori hanno utilizzato la stessa intelligenza artificiale per generare queste stampe. Hanno chiesto a un algoritmo di creare un’immagine che contenesse le caratteristiche visive esatte (gradienti, contrasti, intersezioni di linee) che le reti neurali associano a “qualcosa che non è una persona”, oppure che generasse un tale “rumore visivo” da sovraccaricare il sistema di classificazione. Quando una persona indossa questo maglione, la telecamera inquadra la scena. La rete neurale inizia ad analizzare i pixel. Tuttavia, quando arriva all’area del busto coperta dal maglione, i calcoli matematici impazziscono. I valori di probabilità che indicano la presenza di un essere umano crollano drasticamente. Il sistema, semplicemente, decide che lì non c’è nessuno. La persona diventa, a tutti gli effetti digitali, invisibile.

Perché proprio un maglione?

La scelta del capo d’abbigliamento non è casuale. I sistemi di rilevamento pedonale si basano fortemente sull’identificazione del busto e delle spalle, poiché sono le parti del corpo più ampie e visibili, meno soggette a occlusioni rispetto alle gambe o alle braccia. Coprire questa area critica con una patch avversaria massimizza l’efficacia dell’illusione. Inoltre, un maglione o una felpa offrono una superficie ampia e relativamente piatta su cui stampare il pattern, garantendo che l’immagine non si deformi eccessivamente con i movimenti del corpo, il che potrebbe comprometterne l’efficacia.

I test condotti in vari laboratori universitari hanno dimostrato che questi indumenti riescono a eludere i sistemi di sorveglianza con percentuali di successo sbalorditive, superando brillantemente ogni benchmark di sicurezza standard utilizzato per valutare la robustezza dei software di computer vision.

Oltre la sorveglianza: le implicazioni per il futuro

La scoperta di questa vulnerabilità solleva questioni profonde che vanno ben oltre il semplice desiderio di eludere una telecamera di sicurezza. Dimostra che i sistemi di intelligenza artificiale, per quanto avanzati, percepiscono la realtà in un modo fondamentalmente alieno rispetto al nostro. Sono macchine statistiche, e come tali, possono essere ingannate sfruttando le loro stesse regole matematiche.

Questo fenomeno degli “attacchi avversari” non si limita alla visione artificiale. È un problema sistemico che riguarda l’intero campo dell’intelligenza artificiale. Ad esempio, nel campo dell’automazione e dei veicoli a guida autonoma, i ricercatori hanno dimostrato che basta applicare un paio di piccoli adesivi neri su un segnale di “Stop” per far credere all’auto che si tratti di un cartello di limite di velocità, con conseguenze potenzialmente disastrose.

Anche nel mondo dell’elaborazione del linguaggio naturale, la situazione è simile. I grandi modelli linguistici, o LLM, come ChatGPT, possono essere soggetti a “prompt avversari” (spesso chiamati jailbreak). Inserendo sequenze di parole specifiche, apparentemente innocue o prive di senso per un umano, è possibile aggirare i filtri di sicurezza del modello, costringendolo a generare risposte che normalmente gli sarebbero proibite. La logica di base è la stessa del maglione: fornire un input (visivo o testuale) che sfrutta i punti ciechi dell’architettura del modello.

La corsa agli armamenti tecnologici

Il progresso tecnologico in questo settore ha innescato una vera e propria corsa agli armamenti tra chi sviluppa sistemi di intelligenza artificiale e chi cerca di eluderli. Da un lato, gli ingegneri lavorano per rendere le reti neurali più robuste, addestrandole a riconoscere e ignorare le patch avversarie. Dall’altro, i ricercatori (e potenzialmente i malintenzionati) sviluppano pattern sempre più sofisticati, capaci di adattarsi a diverse angolazioni, condizioni di luce e persino di ingannare sensori a infrarossi.

Questa dinamica è fondamentale per il miglioramento della tecnologia. Scoprire che un semplice maglione può accecare un sistema di sicurezza costringe gli sviluppatori a non dare per scontata l’infallibilità delle loro creazioni. Ci ricorda che l’intelligenza artificiale è uno strumento potente, ma fragile, e che la sua integrazione in infrastrutture critiche richiede una comprensione profonda dei suoi limiti intrinseci.

In Breve (TL;DR)

Le nostre città sono sorvegliate da telecamere intelligenti, ma un semplice maglione può proteggere la nostra privacy ingannando l’intelligenza artificiale.

I sistemi di visione artificiale analizzano i pixel per riconoscere i pedoni, ma vengono confusi da specifiche stampe chiamate patch avversarie.

Indossando questi indumenti con pattern visivi mirati sul busto, l’algoritmo va in tilt e l’individuo risulta digitalmente invisibile alle telecamere.

Conclusioni

Il maglione avversario rappresenta un affascinante paradosso della nostra era digitale: la tecnologia più complessa e sofisticata può essere messa in ginocchio da un pezzo di cotone stampato. Questo indumento non è solo un curioso trucco per sfuggire al Grande Fratello, ma la manifestazione fisica di una vulnerabilità matematica. Ci insegna che, mentre l’intelligenza artificiale continua a evolversi e a permeare ogni aspetto della nostra vita, la nostra comprensione di come queste macchine “pensano” e “vedono” deve evolversi di pari passo. L’invisibilità, oggi, non richiede magia, ma solo la giusta combinazione di pixel stampati su un capo d’abbigliamento di uso quotidiano.

Domande frequenti

Un maglione avversario è un capo di abbigliamento speciale progettato per ingannare i sistemi di sorveglianza basati sull’intelligenza artificiale. Presenta una stampa particolare, definita patch avversaria, che genera rumore visivo e confonde gli algoritmi di rilevamento. Indossando questo indumento, i calcoli matematici della telecamera impazziscono e la persona diventa di fatto invisibile al sistema digitale.

I sistemi di visione artificiale non vedono il mondo come gli esseri umani, ma analizzano una griglia di pixel valutando colori e intensità luminosa. Attraverso reti neurali convoluzionali, gli algoritmi cercano pattern specifici come contrasti e forme geometriche tipiche del corpo umano. Se questi elementi matematici coincidono con i dati di addestramento, il software identifica la presenza di un pedone.

I software di rilevamento pedonale si concentrano principalmente sull’identificazione del busto e delle spalle, essendo le parti del corpo più ampie e meno soggette a ostacoli visivi. Un maglione offre una superficie estesa e relativamente piatta, ideale per ospitare la stampa del pattern avversario senza deformarla troppo durante i movimenti. Coprire questa area critica massimizza le probabilità di successo dell’illusione ottica digitale.

Il problema delle vulnerabilità matematiche riguarda l’intero campo del machine learning, non solo le telecamere di sicurezza. Nel settore dei veicoli a guida autonoma, piccoli adesivi su un segnale stradale possono alterare completamente la percezione dell’automobile, causando gravi pericoli. Anche i modelli linguistici avanzati possono subire manipolazioni simili tramite sequenze di testo specifiche progettate per aggirare i filtri di sicurezza.

Attualmente è in corso una vera e propria sfida tecnologica tra chi crea sistemi di sicurezza e chi progetta metodi per eluderli. Gli ingegneri informatici lavorano costantemente per rendere le reti neurali più robuste, addestrandole a riconoscere e ignorare i pattern ingannevoli. Questa dinamica è essenziale per scoprire i limiti intrinseci della tecnologia e migliorare l’affidabilità delle infrastrutture critiche del futuro.

Hai ancora dubbi su Perché un banale capo d’abbigliamento manda in tilt l’AI?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.