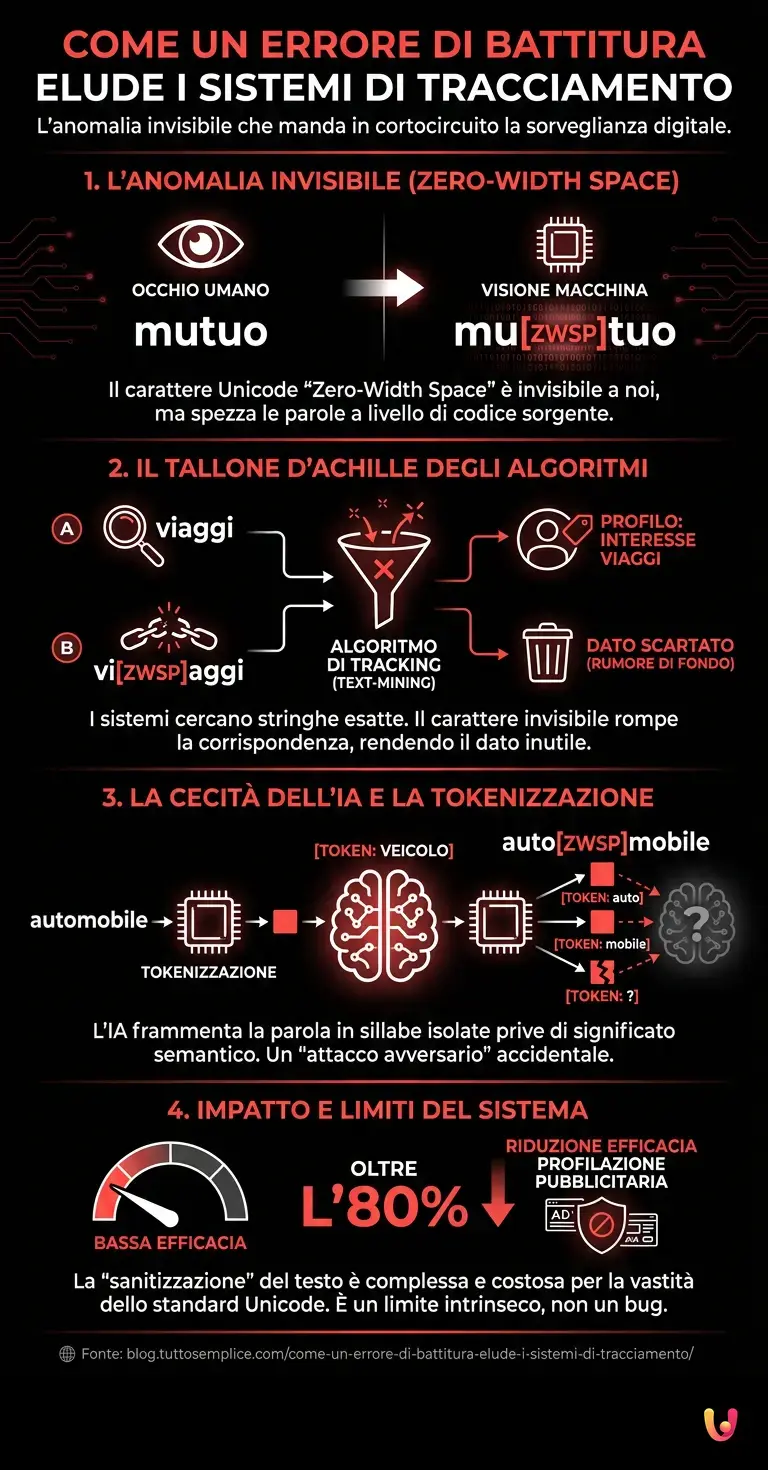

Nell’era dell’iper-connessione, ogni nostra interazione online lascia una scia indelebile di dati. Dai siti che visitiamo alle parole che digitiamo sui motori di ricerca, tutto viene meticolosamente registrato, catalogato e analizzato. Eppure, esiste una singolare anomalia tecnica in grado di mandare in cortocircuito questa immensa macchina di sorveglianza commerciale. Il segreto risiede in un elemento tanto invisibile quanto potente: lo Zero-Width Space (spazio a larghezza zero), un carattere Unicode che, se inserito accidentalmente o volutamente durante la digitazione, rende il testo illeggibile per i sistemi di profilazione, pur mantenendolo perfettamente normale agli occhi umani.

Per comprendere la portata di questa curiosità informatica, è necessario fare un passo indietro e osservare come le macchine interpretano il linguaggio umano. Noi leggiamo lettere, sillabe e parole, ma i computer leggono sequenze di numeri. Quando un utente commette un particolare tipo di errore di battitura, innescando una combinazione di tasti che genera un carattere invisibile o un omoglifo (un carattere visivamente identico ma con un codice informatico diverso), si crea una vera e propria barriera crittografica involontaria.

Il tallone d’Achille degli algoritmi di profilazione

I moderni sistemi di tracciamento digitale si basano su algoritmi di text-mining estremamente voraci. Il loro compito è scansionare le nostre e-mail, i nostri post sui social network e le nostre query di ricerca per estrarre parole chiave fondamentali. Se scrivi frequentemente la parola “mutuo” o “viaggi”, i data broker ti inseriranno in specifici segmenti di mercato, bombardandoti di pubblicità mirata.

Tuttavia, questi sistemi soffrono di una rigidità strutturale. Sono programmati per riconoscere stringhe di testo esatte o le loro varianti più comuni. Quando un utente, a causa di un layout di tastiera particolare, di un copia-incolla da formattazioni anomale o di una digitazione frettolosa su schermi touch, inserisce uno Zero-Width Space all’interno di una parola (ad esempio, trasformando “mutuo” in “mu[ZWSP]tuo”), il sistema di tracciamento tradizionale va in crisi. La parola viene spezzata a livello di codice sorgente. Il tracker non vede più un potenziale cliente interessato a un prestito, ma registra una stringa di caratteri senza senso, scartandola come rumore di fondo.

Tokenizzazione: come leggono le macchine

Per capire a fondo questo fenomeno, dobbiamo addentrarci nel cuore dell’intelligenza artificiale e del machine learning. I modelli linguistici moderni non elaborano il testo parola per parola, ma utilizzano un processo chiamato tokenizzazione. Il testo viene frammentato in unità più piccole chiamate “token”.

In un’architettura neurale avanzata, la parola “automobile” potrebbe essere un singolo token. Ma se all’interno di quella parola si nasconde un errore di battitura invisibile, il sistema di tokenizzazione (spesso basato su Byte Pair Encoding) impazzisce. Invece di assegnare il token corrispondente al concetto di veicolo, frammenta la parola in sillabe isolate o in caratteri singoli che non hanno alcun peso semantico. Questo significa che, per l’AI, tu non hai mai scritto quella parola. Sei letteralmente scivolato sotto il radar.

La cecità dell’Intelligenza Artificiale di fronte all’imprevisto

Si potrebbe pensare che i sistemi più avanzati siano immuni a questi banali errori. In realtà, il deep learning è eccezionalmente abile nel riconoscere pattern complessi, ma è sorprendentemente fragile di fronte a perturbazioni minime e inattese. Questo fenomeno è noto nel campo della sicurezza informatica come “attacco avversario” (adversarial attack), anche se in questo caso avviene in modo del tutto accidentale.

Prendiamo ad esempio i grandi modelli linguistici, o LLM. Piattaforme come ChatGPT o i sistemi di analisi del sentiment utilizzati dalle multinazionali sono addestrati su terabyte di testo pulito e normalizzato. Quando incontrano un testo inquinato da caratteri invisibili o da errori di codifica Unicode generati da una battitura anomala, la loro capacità di comprensione crolla drasticamente. L’automazione che dovrebbe categorizzare il tuo profilo psicologico o le tue abitudini di consumo si interrompe, poiché il dato in ingresso non corrisponde a nessuna delle coordinate presenti nel suo immenso database vettoriale.

Un test di benchmark per l’invisibilità

I ricercatori nel campo della privacy e della sicurezza informatica hanno iniziato a studiare questo fenomeno con grande interesse. Sottoponendo i sistemi di tracciamento a rigorosi test di benchmark, hanno scoperto che l’inserimento strategico (o accidentale) di questi errori di battitura invisibili riduce l’efficacia della profilazione pubblicitaria di oltre l’80%.

Non si tratta di un difetto di programmazione banale, ma di un limite intrinseco al modo in cui i computer elaborano il testo. Il progresso tecnologico sta spingendo le aziende a sviluppare filtri di “sanitizzazione” del testo sempre più aggressivi, progettati per rimuovere qualsiasi carattere non standard prima che il testo venga analizzato. Tuttavia, la vastità dello standard Unicode, che comprende oltre 140.000 caratteri, rende questa operazione di pulizia estremamente complessa e dispendiosa in termini di potenza di calcolo.

L’anatomia dell’errore: cosa succede dietro le quinte

Ma come si genera, nella pratica, questo errore? Spesso accade quando si utilizzano tastiere multilingue sugli smartphone. Il passaggio rapido tra un layout e l’altro, o l’uso di funzioni di dettatura vocale che tentano di formattare il testo in modo dinamico, può inserire metadati invisibili tra le lettere. Altre volte, è il risultato di un copia-incolla da documenti PDF o da siti web con formattazioni complesse.

Quando premiamo “Invia”, il nostro browser trasmette l’intera sequenza di byte. I server pubblicitari, ottimizzati per la velocità e per processare miliardi di richieste al secondo, non hanno il tempo materiale per eseguire un’analisi forense di ogni singola parola. Applicano espressioni regolari (regex) standardizzate. Se la regex cerca la parola “smartphone” e trova “smart[carattere-invisibile]phone”, la condizione risulta falsa. Il dato viene ignorato. L’utente, per quel frammento di secondo e per quella specifica interazione, diventa un fantasma digitale.

In Breve (TL;DR)

Inserire accidentalmente o volontariamente caratteri invisibili come lo spazio a larghezza zero crea una vera barriera crittografica contro i moderni sistemi di tracciamento digitale.

Queste anomalie invisibili interrompono il delicato processo di tokenizzazione, rendendo le parole chiave del tutto illeggibili per i voraci algoritmi di profilazione commerciale.

Questo limite strutturale del machine learning riduce fortemente il successo della pubblicità mirata, permettendo agli utenti di sfuggire accidentalmente alla sorveglianza dei data broker.

Conclusioni

La scoperta che un semplice, e spesso invisibile, errore di battitura possa neutralizzare sistemi di sorveglianza multimiliardari ci ricorda una verità fondamentale: la tecnologia, per quanto avanzata, opera sempre all’interno di confini logici rigidi. Mentre l’industria dei dati continua a investire in algoritmi sempre più sofisticati, la complessità e l’imprevedibilità dell’interazione umana (e dei sistemi di codifica che abbiamo creato per rappresentarla) offrono ancora inaspettate vie di fuga.

Lo Zero-Width Space e le anomalie tipografiche simili non sono la soluzione definitiva al problema della privacy online, ma rappresentano un affascinante paradosso moderno. In un mondo in cui cerchiamo costantemente di essere precisi e leggibili per le macchine, è proprio nell’errore, nell’imperfezione e nel glitch che ritroviamo, paradossalmente, il nostro diritto all’invisibilità.

Domande frequenti

Si tratta di un carattere Unicode invisibile alla vista umana ma perfettamente elaborato dai computer. Quando viene inserito in una parola la divide a livello di codice sorgente rendendola del tutto incomprensibile agli algoritmi di tracciamento pubblicitario che cercano esclusivamente termini esatti e predefiniti. Questo stratagemma blocca la raccolta dei dati personali.

Inserendo caratteri non visibili dentro le parole chiave i sistemi di profilazione non riescono a riconoscere i termini di interesse commerciale. Di conseguenza i data broker scartano il testo considerandolo semplice rumore di fondo ed evitando cosi di inviare fastidiosa pubblicità mirata alla persona coinvolta. In questo modo si crea uno scudo protettivo involontario contro la sorveglianza digitale.

I modelli linguistici moderni usano la tokenizzazione per frammentare il testo in unità di senso compiuto. Un carattere anomalo interrompe bruscamente questo processo spezzando la parola in frammenti privi di significato semantico. Questo causa un vero e proprio cortocircuito nella comprensione automatica rendendo il testo illeggibile per la macchina. La profilazione psicologica viene quindi interrotta sul nascere.

Spesso compaiono usando tastiere multilingue sugli smartphone passando rapidamente da un layout al successivo oppure tramite i sistemi di dettatura vocale. Possono anche derivare dal copia e incolla di testi da documenti complessi portando con sé metadati nascosti che alterano la struttura invisibile della parola digitata. Anche una digitazione frettolosa su schermi touch può innescare questa anomalia informatica.

Le piattaforme tecnologiche stanno sviluppando filtri di pulizia del testo sempre più aggressivi per rimuovere i caratteri non standard prima della fase di analisi. Tuttavia gestire oltre centoquarantamila varianti Unicode richiede una potenza di calcolo enorme. Questa operazione risulta quindi estremamente complessa e molto costosa per i server pubblicitari.

Hai ancora dubbi su Come un errore di battitura elude i sistemi di tracciamento?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Spazio a larghezza zero (Zero-Width Space) – Wikipedia

- Byte Pair Encoding e Tokenizzazione nei modelli linguistici – Wikipedia

- Adversarial Machine Learning (Attacchi avversari ai sistemi AI) – Wikipedia

- Sfide di cibersicurezza dell’Intelligenza Artificiale: minacce e tecniche di elusione (ENISA)

- Intelligenza Artificiale, profilazione e protezione dei dati – Garante per la protezione dei dati personali

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.