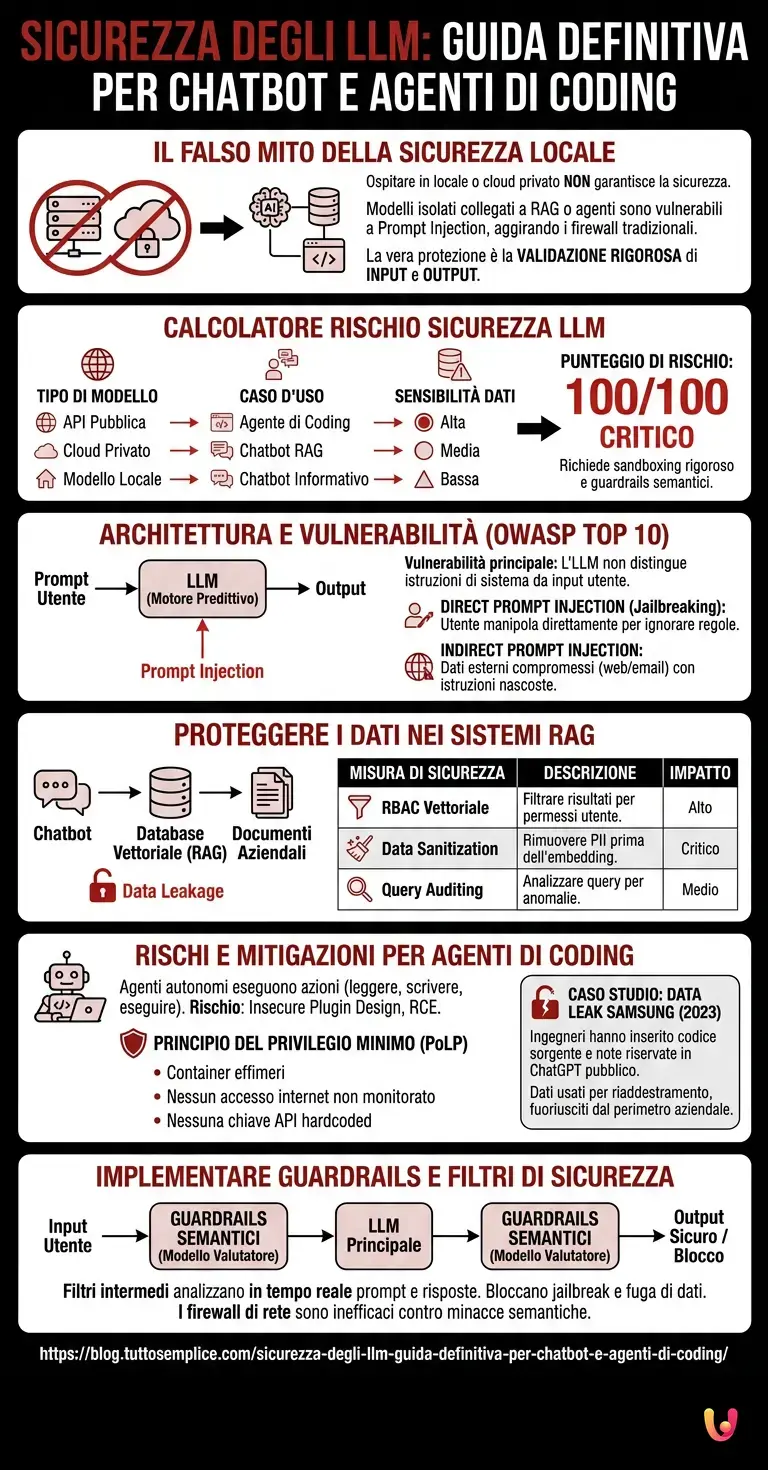

Il falso mito più pericoloso nel mondo dell’intelligenza artificiale aziendale è credere che ospitare un modello in locale (on-premise) o utilizzare un’istanza cloud privata garantisca automaticamente la sicurezza llm. La realtà è brutalmente diversa: un modello isolato, se collegato a un agente di coding o a un database aziendale tramite RAG (Retrieval-Augmented Generation), può essere manipolato tramite prompt injection per esfiltrare dati sensibili o eseguire codice malevolo, aggirando completamente i firewall tradizionali. La vera protezione non risiede nel perimetro di rete, ma nella validazione rigorosa degli input e degli output del modello stesso.

Valuta il livello di rischio della tua implementazione AI.

Architettura e Vulnerabilità dei Modelli Linguistici

Comprendere l’architettura di base è il primo passo per garantire la sicurezza llm. I modelli linguistici elaborano il linguaggio naturale, ma la loro incapacità nativa di distinguere tra istruzioni di sistema e input dell’utente crea vulnerabilità critiche, specialmente nei chatbot aziendali.

I Large Language Models (LLM) sono fondamentalmente motori di predizione probabilistica. Quando integriamo un LLM in un’applicazione aziendale, lo esponiamo a vettori di attacco unici. Secondo la documentazione ufficiale di OWASP Top 10 per LLM, la vulnerabilità principale è il Prompt Injection. Questo avviene quando un utente malintenzionato inserisce istruzioni nascoste nel prompt che sovrascrivono le direttive originali del sistema.

Esistono due varianti principali di questa minaccia:

- Direct Prompt Injection (Jailbreaking): L’utente manipola direttamente il chatbot per fargli ignorare le regole di sicurezza.

- Indirect Prompt Injection: L’LLM ingerisce dati da una fonte esterna compromessa (es. una pagina web o un’email) che contiene istruzioni malevole nascoste, condizionando il comportamento dell’agente.

Proteggere i Dati Aziendali nei Sistemi RAG

Nei sistemi RAG, la sicurezza llm dipende dalla rigorosa gestione dei permessi di accesso. Se un chatbot interroga un database aziendale senza filtri di autorizzazione granulari, rischia di esporre documenti riservati a utenti non autorizzati tramite attacchi di manipolazione del contesto.

L’architettura Retrieval-Augmented Generation (RAG) è lo standard de facto per fornire ai modelli IA l’accesso ai dati proprietari. Tuttavia, il database vettoriale che alimenta il RAG diventa un bersaglio primario. Se un dipendente chiede al chatbot “Riassumi i miei obiettivi trimestrali”, il sistema deve garantire che l’LLM recuperi e processi solo i documenti a cui quel dipendente ha esplicitamente accesso.

Per mitigare i rischi di Data Leakage, è imperativo implementare:

| Misura di Sicurezza | Descrizione | Impatto sul Rischio |

|---|---|---|

| RBAC Vettoriale | Filtrare i risultati della ricerca semantica in base ai permessi dell’utente prima di inviarli al LLM. | Alto |

| Data Sanitization | Rimuovere PII (Personally Identifiable Information) dai documenti prima dell’embedding. | Critico |

| Query Auditing | Registrare e analizzare le query degli utenti per individuare pattern anomali o tentativi di esfiltrazione. | Medio |

Rischi e Mitigazioni per gli Agenti di Coding

Quando si implementano assistenti alla programmazione, la sicurezza llm richiede l’isolamento dell’ambiente di esecuzione. Gli agenti di coding autonomi possono generare o eseguire codice malevolo se non confinati in sandbox rigorose e privi di privilegi di sistema elevati.

Gli agenti di coding (come le implementazioni custom basate su framework agentici) non si limitano a generare testo, ma compiono azioni: leggono repository, scrivono file e, in alcuni casi, eseguono script. Questo livello di autonomia introduce il rischio di Insecure Plugin Design e di esecuzione di codice remoto (RCE) non autorizzata.

Se un agente di coding viene ingannato tramite un pacchetto software compromesso (Supply Chain Attack) o un’istruzione malevola in un ticket di GitHub, potrebbe alterare il codice sorgente dell’azienda. La regola d’oro è il principio del privilegio minimo (PoLP): l’agente deve operare in container effimeri, senza accesso a internet non monitorato e senza chiavi API hardcoded.

Caso Studio: Il Data Leak di Samsung (2023)

Nel 2023, ingegneri di Samsung hanno inavvertitamente inserito codice sorgente proprietario e appunti di riunioni interne in ChatGPT per farsi aiutare nella correzione di bug e nella formattazione. Poiché i dati immessi nei modelli pubblici vengono spesso utilizzati per il riaddestramento, queste informazioni altamente sensibili sono uscite dal perimetro aziendale, costringendo l’azienda a bandire temporaneamente l’uso di strumenti di IA generativa pubblica e ad accelerare lo sviluppo di soluzioni interne sicure.

Implementare Guardrails e Filtri di Sicurezza

L’adozione di guardrails semantici è una best practice fondamentale per la sicurezza llm. Questi filtri intermedi analizzano in tempo reale sia i prompt in ingresso che le risposte in uscita, bloccando tentativi di jailbreak e prevenendo la fuga di informazioni sensibili.

I firewall tradizionali basati su regole di rete sono inefficaci contro le minacce semantiche. È necessario implementare un livello di sicurezza applicativa specifico per l’IA. Strumenti open-source come NeMo Guardrails o framework proprietari permettono di definire confini operativi rigidi.

Un’architettura di sicurezza robusta prevede un “modello valutatore” (spesso un LLM più piccolo e veloce) che ispeziona l’output del modello principale prima che venga mostrato all’utente. Se il valutatore rileva che l’output contiene codice malevolo, dati finanziari non autorizzati o linguaggio inappropriato, blocca la transazione e restituisce un messaggio di errore standardizzato.

Conclusioni

In sintesi, la sicurezza llm non è un prodotto da acquistare, ma un processo continuo di validazione e monitoraggio. Proteggere chatbot e agenti di coding richiede un approccio olistico che unisca difese infrastrutturali, filtri semantici e formazione degli sviluppatori.

L’integrazione dell’intelligenza artificiale nei flussi di lavoro aziendali offre vantaggi competitivi incalcolabili, ma espande drammaticamente la superficie di attacco. Le aziende che prospereranno nell’era dell’IA generativa saranno quelle in grado di implementare architetture “Secure by Design”, dove la validazione degli input, il sandboxing degli agenti e il controllo granulare degli accessi ai dati (RAG) sono considerati requisiti funzionali imprescindibili, non semplici aggiunte a posteriori.

Domande frequenti

Per difendere i sistemi di intelligenza artificiale dalle manipolazioni esterne è fondamentale implementare filtri semantici avanzati e barriere di controllo. Questi strumenti analizzano in tempo reale le richieste degli utenti e le risposte generate, bloccando sul nascere qualsiasi tentativo di aggirare le direttive di sistema. Inoltre risulta essenziale separare rigorosamente le istruzioni di base dai dati forniti da parte degli utenti.

Molte aziende credono erroneamente che mantenere i server dentro il proprio perimetro di rete elimini ogni minaccia informatica. In realtà un sistema isolato rimane vulnerabile se collegato a database aziendali o strumenti di sviluppo, poiché gli attacchi semantici possono sfruttare i canali di input legittimi per estrarre informazioni riservate. La vera difesa richiede una validazione continua dei dati elaborati dal modello.

Gli assistenti alla programmazione possiedono un livello di autonomia elevato che permette loro di leggere archivi, modificare file ed eseguire script operativi. Senza adeguate restrizioni, un pacchetto software compromesso o una semplice istruzione malevola potrebbero spingere il sistema a eseguire comandi dannosi sulla macchina ospite. Per mitigare questo rischio è indispensabile confinare queste risorse in ambienti isolati e applicare il principio del privilegio minimo.

La protezione delle informazioni proprietarie in queste architetture si basa su una gestione estremamente granulare dei permessi di accesso. Prima di inviare i risultati di una ricerca semantica al motore generativo, il sistema deve verificare che il dipendente abbia i diritti necessari per visualizzare quei specifici documenti. Risulta inoltre cruciale rimuovere i dati personali sensibili prima della fase di indicizzazione per prevenire fughe di notizie.

Si tratta di barriere di sicurezza applicativa progettate specificamente per i modelli di linguaggio naturale, capaci di superare i limiti dei classici firewall di rete. Il loro compito principale consiste nel controllare costantemente il flusso di conversazione per individuare e bloccare contenuti inappropriati, codice malevolo o tentativi di estrazione di dati finanziari. Funzionano spesso tramite un modello valutatore secondario che approva o respinge le transazioni in millisecondi.

Hai ancora dubbi su Sicurezza degli LLM: Guida Definitiva per Chatbot e Agenti di Coding?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Linee guida per lo sviluppo sicuro di sistemi di Intelligenza Artificiale (NCSC e CISA)

- Framework per la Gestione del Rischio dell’Intelligenza Artificiale (NIST – National Institute of Standards and Technology)

- Architettura, funzionamento e vulnerabilità dei Large Language Models (Wikipedia)

- Ingegneria dei prompt e vettori di attacco Prompt Injection (Wikipedia)

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.