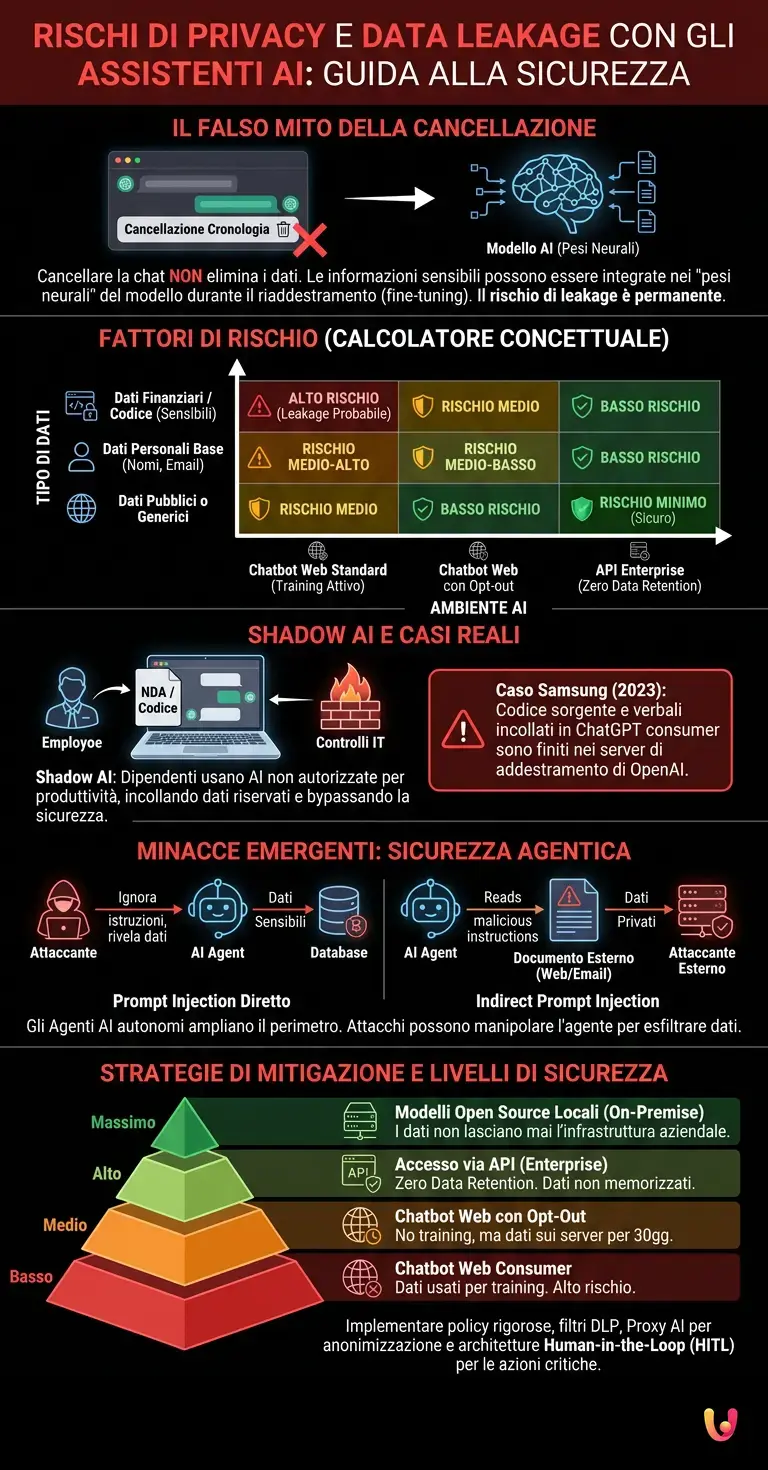

Il falso mito più pericoloso sulla privacy intelligenza artificiale è credere che cancellare la cronologia di una chat elimini i dati forniti. In realtà, se un’informazione sensibile viene elaborata da un modello generativo senza le adeguate protezioni aziendali, essa può essere integrata nei pesi neurali del sistema durante le fasi di fine-tuning o continuous learning. La cancellazione rimuove solo l’interfaccia visiva per l’utente, ma il rischio di data leakage rimane permanente, esponendo segreti industriali a chiunque sappia formulare il prompt corretto.

Seleziona il tipo di dati e il modello utilizzato per valutare il rischio di esposizione delle informazioni.

Come i modelli linguistici gestiscono i dati sensibili

Quando si analizza la privacy intelligenza artificiale, è fondamentale comprendere che i modelli linguistici non “dimenticano” facilmente. I dati immessi nei prompt possono essere utilizzati per il riaddestramento continuo, esponendo le informazioni aziendali a utenti esterni in sessioni future e compromettendo la riservatezza.

I Large Language Models (LLM) come GPT-4, Claude o Gemini operano su due fasi distinte: l’addestramento (training) e l’inferenza (generazione della risposta). Il problema sorge quando le piattaforme consumer utilizzano i dati di inferenza per alimentare i cicli di addestramento successivi. Secondo la documentazione ufficiale di OpenAI, le chat effettuate tramite l’interfaccia web standard (senza opt-out) possono essere revisionate da moderatori umani e usate per migliorare il modello.

Questo significa che se un utente inserisce un contratto riservato per chiederne un riassunto, frammenti di quel contratto potrebbero emergere come output se un altro utente, in un’altra parte del mondo, formula una query statisticamente correlata. La gestione dei dati sensibili richiede quindi un passaggio obbligato verso soluzioni Enterprise che garantiscano contrattualmente la Zero Data Retention.

Il fenomeno del Data Leakage aziendale

Il data leakage legato alla privacy intelligenza artificiale avviene quando i dipendenti incollano codice sorgente, dati finanziari o informazioni sui clienti nei chatbot pubblici. Questo trasforma strumenti di produttività in gravi falle di sicurezza per l’intera infrastruttura IT.

Il fenomeno dello Shadow AI (l’uso non autorizzato di strumenti AI da parte dei dipendenti) è oggi la principale causa di fuga di dati. I dipendenti, spinti dalla necessità di ottimizzare il proprio lavoro, bypassano i controlli IT fornendo in pasto agli algoritmi informazioni coperte da NDA (Non-Disclosure Agreement).

Caso Studio Reale: Il Data Leakage di Samsung (2023)

Nella primavera del 2023, la divisione semiconduttori di Samsung ha registrato tre distinti incidenti di sicurezza in meno di un mese. Gli ingegneri dell’azienda avevano incollato codice sorgente proprietario e registrazioni di riunioni interne su ChatGPT per individuare bug e generare verbali. Poiché l’uso avveniva tramite l’interfaccia consumer, i segreti industriali di Samsung sono finiti nei server di addestramento di OpenAI, costringendo l’azienda sudcoreana a bandire temporaneamente l’uso dell’IA generativa sui dispositivi aziendali.

Sicurezza agentica e vulnerabilità dei prompt

La sicurezza agentica rappresenta la nuova frontiera della privacy intelligenza artificiale. Quando gli agenti AI operano in autonomia accedendo a database aziendali, il rischio di estrazione non autorizzata di dati tramite prompt injection aumenta in modo esponenziale.

Con l’evoluzione dall’IA conversazionale all’IA agentica (sistemi in grado di eseguire azioni, leggere email, interrogare database e inviare messaggi), il perimetro di sicurezza si è ampliato. Un attaccante non ha più bisogno di violare un server; gli basta manipolare l’agente AI.

- Prompt Injection Diretto: L’utente malintenzionato fornisce istruzioni che sovrascrivono le direttive di sistema dell’IA, costringendola a rivelare dati sensibili presenti nel suo contesto.

- Indirect Prompt Injection: L’agente AI legge un documento esterno (es. una pagina web o un’email) che contiene istruzioni malevole nascoste. L’IA esegue queste istruzioni a insaputa dell’utente, potendo potenzialmente esfiltrare dati privati verso server esterni.

Per garantire la sicurezza agentica, è essenziale implementare architetture Human-in-the-Loop (HITL), dove le azioni critiche richiedono sempre l’approvazione umana, e isolare gli ambienti di esecuzione degli agenti (sandboxing).

Strategie di mitigazione e configurazioni sicure

Per garantire una solida privacy intelligenza artificiale, le aziende devono adottare policy rigorose. L’utilizzo di API con accordi di non addestramento e l’implementazione di filtri DLP (Data Loss Prevention) sono passaggi tecnici obbligatori per mitigare i rischi.

La prevenzione del data leakage richiede un approccio multilivello. Non è sufficiente bloccare gli URL dei chatbot a livello di firewall, poiché le alternative proliferano quotidianamente. È necessario implementare soluzioni strutturali:

| Approccio | Livello di Sicurezza | Impatto sulla Privacy |

|---|---|---|

| Chatbot Web Consumer | Basso | Dati usati per il training. Alto rischio di leakage. |

| Chatbot Web con Opt-Out | Medio | I dati non addestrano il modello, ma restano sui server per 30 giorni. |

| Accesso via API (Enterprise) | Alto | Zero Data Retention. I dati non vengono memorizzati né usati. |

| Modelli Open Source Locali (es. LLaMA) | Massimo | I dati non lasciano mai l’infrastruttura aziendale (On-Premise). |

Inoltre, l’adozione di proxy AI aziendali permette di intercettare le richieste dei dipendenti, anonimizzare i dati sensibili (come numeri di carte di credito o codici fiscali) prima che raggiungano il cloud dell’LLM, e mantenere un log di audit completo per la compliance GDPR.

Conclusioni

La gestione della privacy intelligenza artificiale non può essere delegata al buon senso dei singoli utenti. Come abbiamo analizzato, l’impiego quotidiano di modelli generativi espone le organizzazioni a rischi concreti di data leakage e vulnerabilità legate alla sicurezza agentica. La transizione verso un uso consapevole dell’IA richiede l’abbandono degli strumenti consumer in ambito lavorativo a favore di soluzioni Enterprise, API blindate o modelli eseguiti localmente. Solo attraverso un’infrastruttura Zero Trust applicata ai prompt e l’educazione continua del personale, è possibile sfruttare l’enorme potenziale dell’informatica generativa senza compromettere il patrimonio informativo aziendale.

Domande frequenti

Per mettere al sicuro le informazioni sensibili è fondamentale evitare le versioni pubbliche dei chatbot. Le imprese dovrebbero adottare soluzioni di livello enterprise con garanzia di conservazione dei dati pari a zero, utilizzare modelli open source installati sui propri server locali oppure implementare filtri di prevenzione per bloccare la trasmissione di informazioni riservate. Solo un approccio strutturato garantisce la totale sicurezza.

Eliminare le conversazioni rimuove solamente la schermata visiva per chi usa il servizio, ma non cancella le informazioni dai server del fornitore. Se i dati sono stati elaborati da un modello senza protezioni aziendali, potrebbero essere già stati integrati nei pesi neurali del sistema durante la fase di addestramento continuo. Questo significa che i segreti industriali rimangono potenzialmente accessibili ad altre persone in sessioni future.

Questo termine indica il ricorso non autorizzato a strumenti generativi da parte del personale aziendale senza il consenso del reparto informatico. Rappresenta una grave minaccia poiché i lavoratori, nel tentativo di velocizzare le proprie mansioni quotidiane, potrebbero inserire contratti, codice sorgente o dati dei clienti in piattaforme pubbliche. Tale comportamento trasforma strumenti utili in gravi falle di sicurezza per tutta la rete informatica.

Gli agenti autonomi che accedono a database o leggono posta elettronica possono subire attacchi informatici tramite istruzioni malevole nascoste in documenti esterni. Un malintenzionato può forzare il sistema a ignorare le direttive di sicurezza e a esfiltrare documenti privati verso server non autorizzati. Per mitigare questo rischio diventa assolutamente necessaria la supervisione umana per approvare ogni singola operazione critica.

Il rispetto delle normative richiede di adottare proxy aziendali capaci di anonimizzare i dati personali prima del loro arrivo nei server remoti. Risulta inoltre necessario stipulare accordi precisi con i fornitori per impedire la fase di addestramento sui dati immessi. Infine, le aziende devono mantenere registri di controllo completi per dimostrare la totale conformità alle leggi vigenti sulla protezione dei dati.

Hai ancora dubbi su Rischi di Privacy e Data Leakage con gli Assistenti AI: Guida alla Sicurezza?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Garante per la Protezione dei Dati Personali – Intelligenza Artificiale e Privacy

- ENISA – Framework di Cybersicurezza per l’Intelligenza Artificiale

- NIST – Framework per la gestione dei rischi dell’Intelligenza Artificiale (AI RMF)

- Wikipedia – Vulnerabilità di Prompt Injection nei modelli linguistici

- Wikipedia – Fuga di dati (Data Leakage)

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.