Il panorama dell’intelligenza artificiale è in costante fermento e la settimana appena trascorsa, culminata con l’analisi pubblicata da DeepLearning.AI, segna un punto di svolta significativo per il settore. Al centro delle discussioni globali troviamo OpenClaw, un agente AI open-source che ha scatenato un’ondata di entusiasmo e preoccupazione senza precedenti nella comunità tecnologica. Secondo quanto riportato nell’ultima edizione di The Batch, questo software rappresenta l’emblema della nuova era degli agenti autonomi, dominando le conversazioni dal 6 febbraio 2026 a oggi, 11 febbraio.

Il Fenomeno OpenClaw: L’Agente che “Corre all’Impazzata”

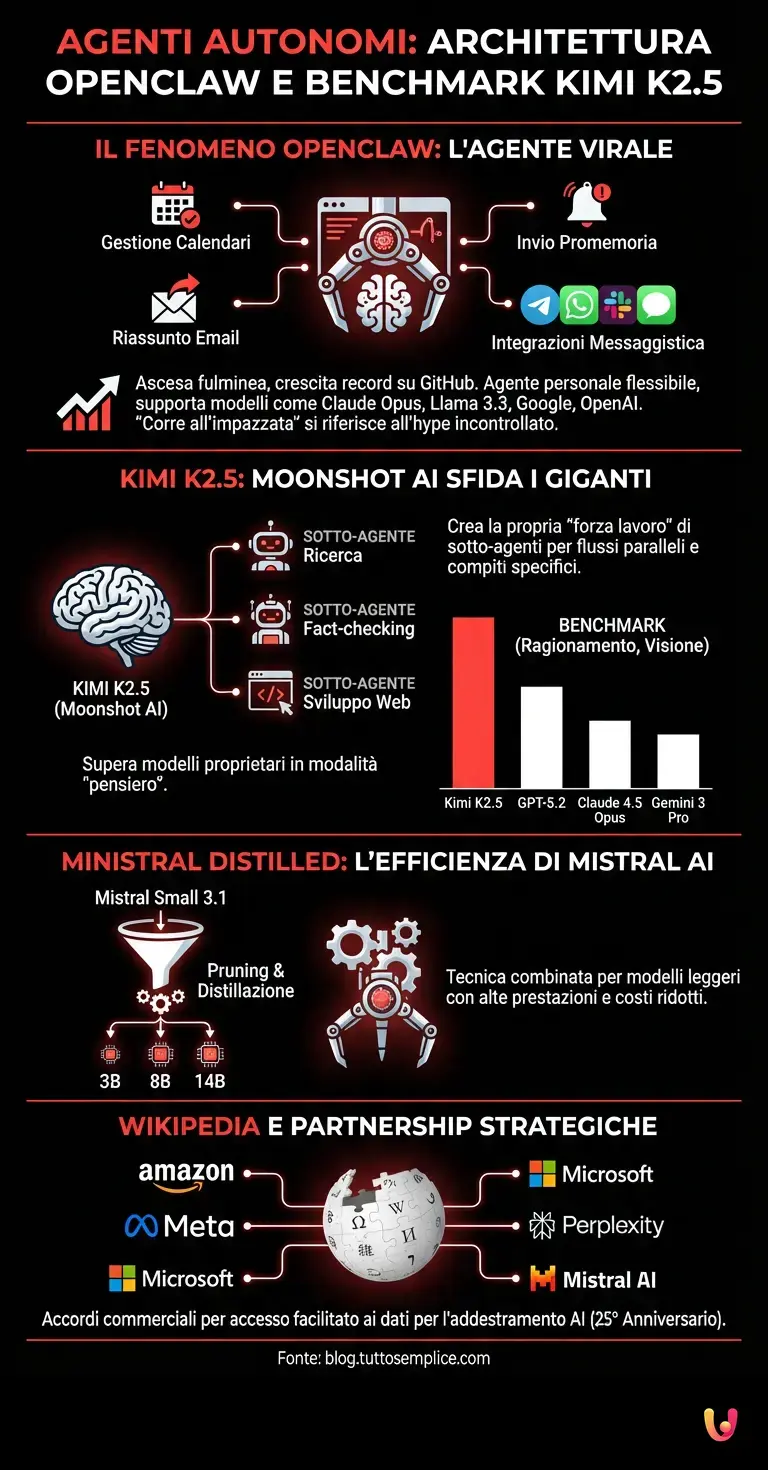

La notizia principale riguarda l’ascesa fulminea di OpenClaw. Sviluppato da Peter Steinberger e precedentemente noto con nomi come WhatsApp Relay o Moltbot, questo progetto è esploso in popolarità dopo essere apparso su HackerNews a fine gennaio. Secondo DeepLearning.AI, OpenClaw ha registrato una crescita di stelle su GitHub più rapida di qualsiasi altro progetto recente, superando persino l’interesse di ricerca per strumenti consolidati come Claude Code.

OpenClaw funge da agente personale in grado di gestire calendari, riassumere email e inviare promemoria, integrandosi con piattaforme di messaggistica come Telegram, WhatsApp, Slack e iMessage. La sua particolarità risiede nella flessibilità: autentica gli utenti tramite API di loro scelta, supportando modelli proprietari come Claude Opus e Llama 3.3, ma anche soluzioni di Google e OpenAI. Il titolo “OpenClaw Runs Amok” (OpenClaw corre all’impazzata) utilizzato dagli analisti non si riferisce a un malfunzionamento distruttivo, ma alla viralità incontrollata e all’hype che ha generato, sollevando interrogativi concreti sul futuro di un mondo popolato da agenti software autonomi.

Kimi K2.5: Moonshot AI Sfida i Giganti

Mentre l’attenzione mediatica si concentrava sugli agenti, la cinese Moonshot AI ha rilasciato quello che molti definiscono il nuovo “re” dei modelli open-source: Kimi K2.5. Questo modello vision-language introduce una capacità innovativa: la creazione di una propria “forza lavoro”. Secondo i dati tecnici rilasciati, Kimi K2.5 è in grado di generare “sotto-agenti” (subagents), ovvero flussi di lavoro paralleli che controllano modelli separati per eseguire compiti specifici come ricerca, fact-checking e sviluppo web.

I benchmark riportati sono impressionanti. Nelle modalità di “pensiero” (thinking mode), Kimi K2.5 ha superato tutti i modelli open-weights testati. Ancor più sorprendente è il confronto con i modelli proprietari: in diversi test di ragionamento, visione e comportamento agentico, Kimi ha ottenuto prestazioni superiori a GPT-5.2 (impostato su xhigh), Claude 4.5 Opus e Gemini 3 Pro. Questa capacità di orchestrazione autonoma, dove il modello decide quando delegare il lavoro a un sotto-agente, segna un passo avanti rispetto ai flussi di lavoro agentici predefiniti.

Ministral Distilled: L’Efficienza di Mistral AI

Non meno rilevante è la mossa di Mistral AI, che ha puntato tutto sull’efficienza con la famiglia Ministral 3. L’azienda francese ha utilizzato una tecnica combinata di “pruning” (potatura) e distillazione per comprimere il modello Mistral Small 3.1 in versioni molto più leggere da 3, 8 e 14 miliardi di parametri. Secondo Mistral, il modello Ministral 3 14B supera il suo predecessore Mistral Small 3.1 in test di matematica e comprensione multimodale, dimostrando che la distillazione a cascata è una via percorribile per ottenere alte prestazioni con costi computazionali ridotti.

Wikipedia e le Partnership Strategiche

Infine, un aggiornamento cruciale riguarda la Wikimedia Foundation. In occasione del 25° anniversario di Wikipedia, l’organizzazione ha stretto accordi commerciali con giganti del calibro di Amazon, Meta, Microsoft, Perplexity e la stessa Mistral AI. Secondo i termini riportati, queste aziende forniranno supporto finanziario in cambio di un accesso facilitato ai dati dell’enciclopedia per l’addestramento dei loro algoritmi di machine learning, formalizzando una relazione che fino ad ora era spesso avvenuta in aree grigie del diritto d’autore.

In Breve (TL;DR)

L’agente open-source OpenClaw sta dominando il panorama tecnologico, offrendo un’automazione personale virale compatibile con le più diffuse app di messaggistica.

Il nuovo modello cinese Kimi K2.5 sfida i giganti occidentali introducendo sotto-agenti autonomi che superano le prestazioni di GPT-5.2.

Mistral AI punta sull’efficienza tramite la distillazione dei modelli, mentre Wikipedia formalizza partnership strategiche per l’addestramento delle intelligenze artificiali.

Conclusioni

Le notizie di questa settimana del febbraio 2026 delineano chiaramente le tre direttrici future dell’intelligenza artificiale: l’automazione personale tramite agenti virali come OpenClaw, la supremazia tecnica dei modelli cinesi come Kimi K2.5 che sfidano l’egemonia occidentale, e la ricerca dell’efficienza tramite modelli distillati come quelli di Mistral. Mentre gli strumenti diventano più potenti e autonomi, la rapidità con cui progetti come OpenClaw guadagnano trazione suggerisce che il pubblico è pronto per un’adozione di massa degli agenti AI, ponendo nuove sfide sia tecniche che etiche per il resto dell’anno.

Domande frequenti

OpenClaw è un agente AI open source sviluppato da Peter Steinberger che funge da assistente personale avanzato. Il software gestisce autonomamente calendari, riassume email e invia promemoria, integrandosi con piattaforme come Telegram, WhatsApp e Slack. La sua popolarità deriva dalla flessibilità di utilizzare diversi modelli linguistici, inclusi Claude Opus e Llama, tramite API selezionate dagli utenti.

Kimi K2.5 è un modello vision language che si distingue per la capacità di generare sotto agenti autonomi per gestire flussi di lavoro paralleli. Questa architettura permette al modello di delegare compiti specifici come la verifica dei fatti o lo sviluppo web, superando nei benchmark concorrenti come GPT 5.2 e Claude 4.5 grazie a una modalità di pensiero avanzata.

Mistral AI ha applicato tecniche di potatura e distillazione per comprimere il modello Mistral Small 3.1 in versioni più leggere ed efficienti della famiglia Ministral 3. Questo approccio riduce i costi computazionali mantenendo alte prestazioni in matematica e comprensione multimodale, dimostrando che è possibile ottenere risultati eccellenti anche con modelli da pochi miliardi di parametri.

La Wikimedia Foundation ha formalizzato partnership commerciali con giganti tecnologici come Amazon, Meta e Microsoft in occasione del suo venticinquesimo anniversario. Questi accordi prevedono un supporto finanziario alla enciclopedia in cambio di un accesso facilitato e legale ai dati necessari per il training degli algoritmi di machine learning, regolarizzando il utilizzo dei contenuti protetti.

Le tendenze attuali evidenziano tre direzioni principali quali la automazione personale tramite agenti virali come OpenClaw, la supremazia tecnica dei modelli cinesi come Kimi K2.5 e la ricerca della efficienza con modelli distillati. Questi sviluppi indicano una rapida adozione di massa degli agenti autonomi e una competizione sempre più accesa tra tecnologie occidentali e orientali.

Hai ancora dubbi su Agenti autonomi: architettura OpenClaw e benchmark Kimi K2.5?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.