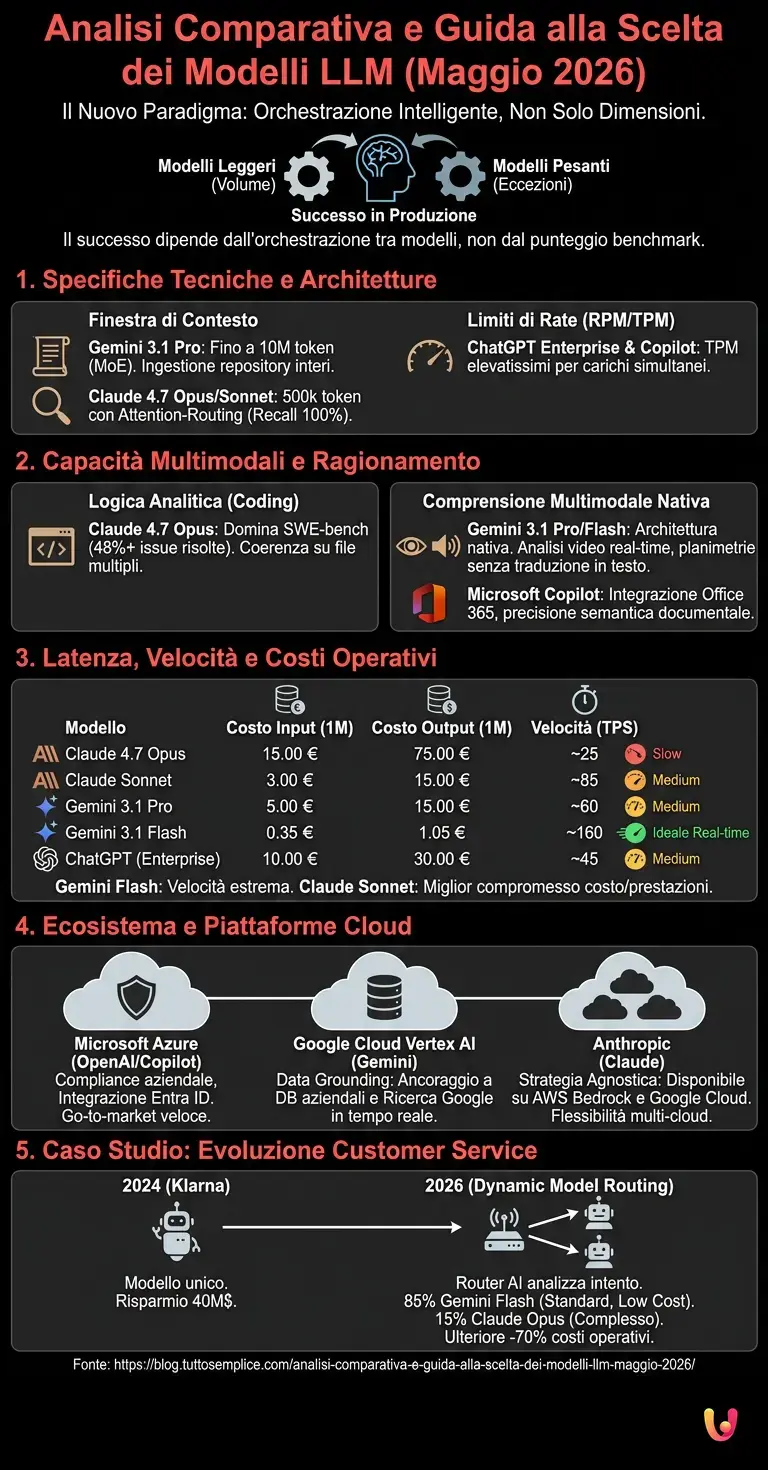

Il falso mito più radicato nel panorama dell’intelligenza artificiale odierna è che per ottenere prestazioni enterprise sia indispensabile adottare il modello più grande e costoso disponibile. La verità, a maggio 2026, è diametralmente opposta: il successo in produzione non dipende dal punteggio nei benchmark di ragionamento, ma dall’orchestrazione intelligente tra modelli leggeri per il volume e modelli pesanti per le eccezioni. Questo confronto modelli llm dimostra come l’ecosistema, il vendor lock-in e la latenza contino ormai molto più dei parametri grezzi, imponendo ai CTO un cambio di paradigma radicale nella progettazione delle architetture AI.

Specifiche Tecniche e Architetture di Base

In questo confronto modelli llm, le specifiche tecniche rivelano divergenze cruciali. Analizziamo le dimensioni della finestra di contesto, i limiti di rate (RPM/TPM) e le peculiarità architetturali che definiscono le capacità di Claude, Gemini, ChatGPT e Copilot in scenari di produzione intensiva.

A maggio 2026, la corsa all'espansione della finestra di contesto ha raggiunto un plateau funzionale, spostando l'attenzione sull'efficienza del recupero delle informazioni (Retrieval-Augmented Generation nativa). Secondo la documentazione ufficiale di Google Cloud, Gemini 3.1 Pro mantiene il primato assoluto con una finestra di contesto dinamica fino a 10 milioni di token, supportata da un'architettura Mixture-of-Experts (MoE) altamente parallelizzata. Questo permette l'ingestione di interi repository di codice o archivi video senza frammentazione.

Dall'altro lato, Claude 4.7 Opus e l'ultima iterazione di Claude Sonnet si assestano su una finestra di 500.000 token. Tuttavia, Anthropic ha implementato un meccanismo di attention-routing che garantisce un recall perfetto (100% nel test Needle-in-a-Haystack) anche ai limiti estremi del contesto, riducendo le allucinazioni strutturali. ChatGPT (nella sua versione enterprise basata sull'architettura GPT-4.5/5) e Microsoft Copilot offrono finestre standardizzate a 256.000 token, privilegiando limiti di rate (TPM - Tokens Per Minute) estremamente elevati per soddisfare i carichi di lavoro aziendali simultanei.

Capacità Multimodali e Ragionamento Complesso

Valutare il ragionamento complesso è fondamentale in un confronto modelli llm aggiornato. Esaminiamo le performance nei benchmark più recenti per il coding avanzato, la logica matematica zero-shot e l'analisi nativa di immagini e documenti complessi.

Le capacità di ragionamento si sono biforcate in due categorie distinte: logica analitica (coding e matematica) e comprensione multimodale nativa. Nel dominio dello sviluppo software, Claude 4.7 Opus domina incontrastato. Nei benchmark SWE-bench aggiornati al 2026, Opus risolve autonomamente oltre il 48% delle issue di GitHub complesse, superando ChatGPT grazie alla sua superiore capacità di mantenere la coerenza logica su file multipli.

Per quanto riguarda la multimodalità, Gemini 3.1 Pro e Gemini 3.1 Flash operano su un'architettura nativamente multimodale fin dal pre-training. Questo significa che non traducono le immagini o l'audio in testo prima dell'elaborazione, ma mappano i pixel e le frequenze direttamente nello spazio latente. Il risultato è una superiorità schiacciante nell'analisi di video in tempo reale e nella lettura di planimetrie o diagrammi industriali complessi. Microsoft Copilot, integrato con l'ecosistema Office 365, brilla invece nel ragionamento documentale, incrociando dati tra Excel, Word e Teams con una precisione semantica ineguagliata per i task amministrativi.

Latenza, Velocità di Inferenza e Costi Operativi

L'ottimizzazione del budget richiede un attento confronto modelli llm basato sui costi per milione di token e sulla latenza. Scopriamo quali modelli offrono il miglior rapporto tra Tokens Per Second (TPS) e spesa infrastrutturale per le aziende.

Il vero campo di battaglia del 2026 è l'efficienza economica. I modelli "Frontier" (Opus, GPT-tier massimo) sono insostenibili per task ad alto volume come la classificazione di log o il customer care di primo livello. È qui che entrano in gioco i modelli ottimizzati.

| Modello LLM | Costo Input (per 1M) | Costo Output (per 1M) | Velocità (TPS) |

|---|---|---|---|

| Claude 4.7 Opus | 15.00 € | 75.00 € | ~25 |

| Claude Sonnet | 3.00 € | 15.00 € | ~85 |

| Gemini 3.1 Pro | 5.00 € | 15.00 € | ~60 |

| Gemini 3.1 Flash | 0.35 € | 1.05 € | ~160 |

| ChatGPT (Enterprise) | 10.00 € | 30.00 € | ~45 |

Secondo la documentazione ufficiale di Google, Gemini 3.1 Flash offre una velocità di inferenza di circa 160 Tokens Per Second (TPS), rendendolo ideale per applicazioni real-time e agenti vocali. Claude Sonnet si posiziona come il miglior compromesso sul mercato: offre capacità di ragionamento vicine a quelle dei modelli top di gamma del 2025, ma a un quinto del costo di Opus e con una latenza impercettibile per l'utente finale.

Integrazione, Ecosistema e Piattaforme Cloud

Nessun confronto modelli llm è completo senza analizzare il vendor lock-in e l'infrastruttura. Confrontiamo i vantaggi delle API di Anthropic e OpenAI con le piattaforme enterprise integrate come Google Cloud Vertex AI e Microsoft Azure.

La scelta del modello è intrinsecamente legata all'infrastruttura cloud preesistente dell'azienda. Microsoft Copilot e i modelli OpenAI tramite Azure offrono il vantaggio incolmabile della compliance aziendale (HIPAA, GDPR strict) e dell'integrazione nativa con Entra ID (ex Azure AD) per la gestione dei permessi a livello di singolo documento. Se un'azienda utilizza già l'ecosistema Microsoft, l'adozione di Azure OpenAI riduce i tempi di go-to-market del 60%.

Gemini 3.1 su Google Cloud Vertex AI eccelle nel Data Grounding. Permette di ancorare le risposte del modello direttamente ai database aziendali (BigQuery, AlloyDB) e alla Ricerca Google in tempo reale, azzerando di fatto le allucinazioni sui dati proprietari. Anthropic, pur non avendo un cloud proprietario, ha adottato una strategia agnostica: le API di Claude sono disponibili su AWS Bedrock e Google Cloud, offrendo la massima flessibilità per le architetture multi-cloud.

Caso Studio: L'evoluzione del Customer Service (2024-2026)

Nel 2024, Klarna ha fatto notizia gestendo 2.3 milioni di conversazioni (due terzi del totale) con un assistente AI basato su OpenAI, riducendo i tempi di risoluzione da 11 a 2 minuti e stimando un risparmio di 40 milioni di dollari. A maggio 2026, le aziende leader hanno evoluto questo approccio implementando il Dynamic Model Routing. Invece di usare un singolo modello pesante, un router AI analizza l'intento dell'utente in millisecondi: l'85% delle richieste standard viene gestito da Gemini 3.1 Flash (costo quasi zero, latenza istantanea), mentre solo il 15% dei casi complessi (es. dispute legali o rimborsi anomali) viene scalato a Claude 4.7 Opus. Questo approccio ibrido ha ulteriormente abbattuto i costi operativi del 70% rispetto al 2024, mantenendo inalterata la soddisfazione del cliente.

Conclusioni

A conclusione di questo confronto modelli llm, presentiamo la matrice decisionale definitiva. Scegliere il modello giusto dipende dal bilanciamento tra volume di chiamate, necessità di ragionamento zero-shot e requisiti di integrazione aziendale.

Non esiste un vincitore assoluto, ma esistono scelte ottimali in base allo scenario di utilizzo:

- Task ad alto volume e bassa latenza (Chatbot, Triage, Estrazione Dati Base): Il vincitore indiscusso è Gemini 3.1 Flash. Il costo irrisorio e la velocità estrema lo rendono l'unico candidato logico per operazioni su larga scala.

- Ragionamento Zero-Shot estremo e Coding Complesso: Claude 4.7 Opus rimane il gold standard. È l'investimento necessario quando l'accuratezza logica è critica e l'errore umano/macchina comporterebbe costi elevati.

- Bilanciamento Qualità/Prezzo (Il "Daily Driver"): Claude Sonnet rappresenta il punto di equilibrio perfetto per l'80% delle applicazioni aziendali che richiedono buona intelligenza senza prosciugare il budget API.

- Integrazione Enterprise e Sicurezza Documentale: Microsoft Copilot e l'ecosistema ChatGPT su Azure vincono per la facilità di deployment in ambienti corporate altamente regolamentati.

La strategia vincente per il 2026 non è scegliere un solo modello, ma costruire un'architettura di routing che indirizzi dinamicamente ogni prompt al modello più efficiente per quello specifico task.

Domande frequenti

Per lo sviluppo software e il ragionamento logico avanzato, Claude 4.7 Opus rappresenta lo standard di riferimento. Grazie alla sua eccezionale capacità di mantenere la coerenza su file multipli, risolve autonomamente problemi complessi superando le alternative sul mercato. Rappresenta lo strumento ideale quando la precisione del codice risulta fondamentale per il progetto.

La strategia più efficace consiste nella creazione di un sistema di instradamento dinamico delle richieste. Invece di utilizzare un unico modello costoso per ogni operazione, un router intelligente analizza lo scopo del prompt e affida i task semplici a soluzioni economiche come Gemini 3.1 Flash. Le operazioni complesse vengono dirottate verso modelli avanzati, abbattendo drasticamente la spesa aziendale.

Gemini 3.1 Pro domina questo settore grazie a una finestra dinamica che raggiunge i dieci milioni di token, permettendo di analizzare interi archivi senza frammentazione. Tuttavia, Claude 4.7 Opus e Sonnet garantiscono un recupero perfetto delle informazioni anche ai limiti del loro contesto, riducendo al minimo le allucinazioni strutturali durante la lettura di testi estesi.

Scegliere il sistema Microsoft offre vantaggi enormi in termini di conformità normativa e sicurezza dei dati aziendali. Questa soluzione garantisce una integrazione nativa per la gestione dei permessi sui singoli documenti. Risulta quindi la scelta ottimale per le corporazioni altamente regolamentate che necessitano di un controllo rigoroso sugli accessi e sulle informazioni sensibili.

Le versioni Pro e Flash di Gemini operano su una architettura nativamente multimodale fin dalla fase di addestramento base. Questo significa che non devono tradurre i contenuti visivi o audio in testo prima di elaborarli, ma mappano i dati direttamente. Il risultato è una precisione altissima nella comprensione di video in tempo reale e diagrammi industriali complessi.

Hai ancora dubbi su Analisi Comparativa e Guida alla Scelta dei Modelli LLM (Maggio 2026)?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Modello linguistico di grandi dimensioni (LLM) - Definizione e architettura tecnica

- L'Intelligenza Artificiale e strategie di adozione - Agenzia per l'Italia Digitale

- NIST Artificial Intelligence - Standard governativi e valutazione tecnica dei modelli AI

- Quadro normativo e strategia europea sull'Intelligenza Artificiale - Commissione Europea

Hai trovato utile questo articolo? C'è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.