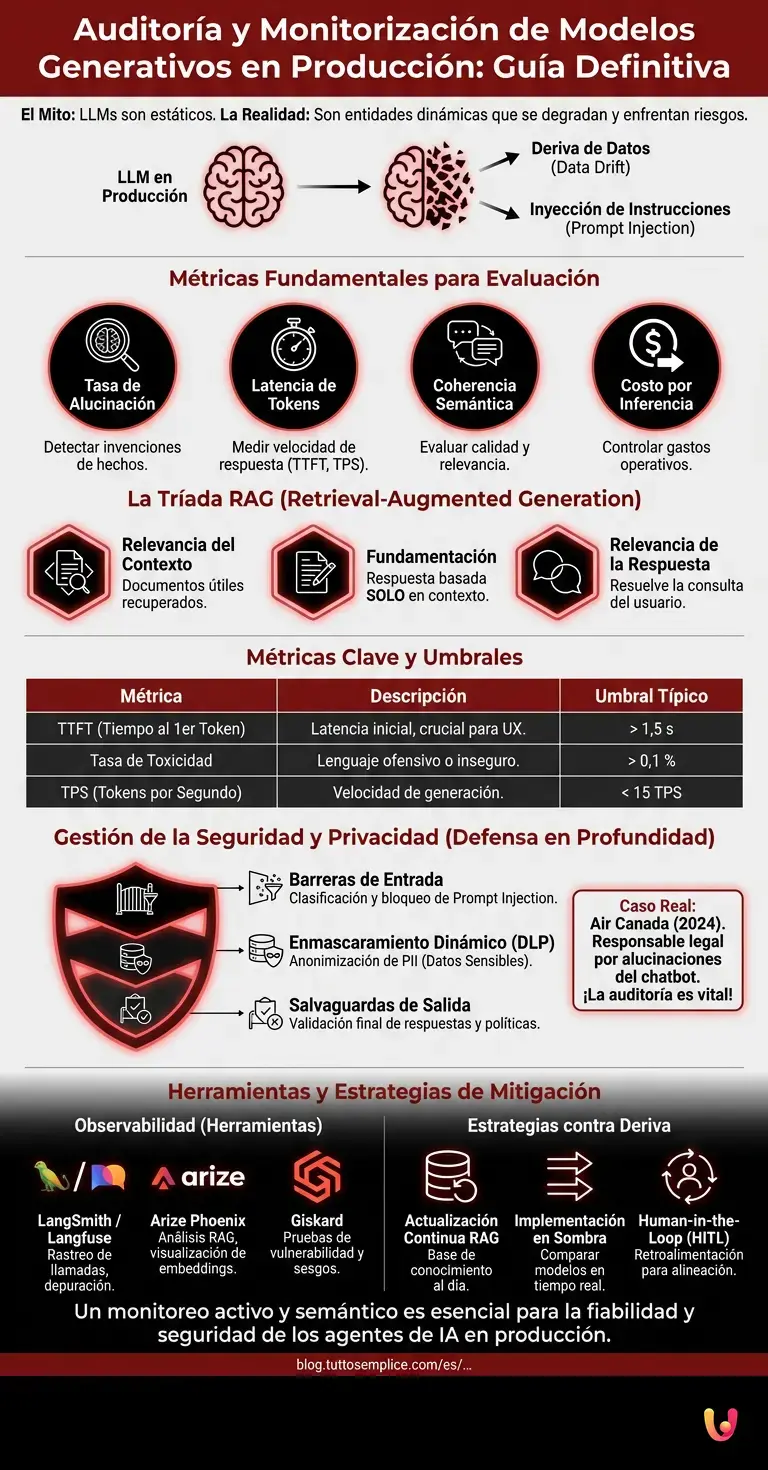

El mito más peligroso en el panorama actual de la tecnología de la información es creer que un modelo de lenguaje grande (LLM), una vez entrenado, validado y puesto en producción, se convierte en un activo estático y predecible. La realidad es diametralmente opuesta: los modelos generativos son entidades dinámicas que se degradan rápidamente debido a la deriva de datos (data drift) y están constantemente expuestos a vulnerabilidades invisibles para los sistemas tradicionales, como la inyección de instrucciones (prompt injection ). Un monitoreo efectivo de los modelos no es una simple lectura de registros a posteriori para medir el tiempo de actividad, sino un proceso de auditoría activo, semántico y en tiempo real, absolutamente esencial para prevenir desastres reputacionales y garantizar la verdadera seguridad de los agentes.

Ajusta los parámetros operativos de tu LLM en producción para evaluar el nivel de riesgo en tiempo real y obtener recomendaciones de auditoría.

Caso de estudio real: El desastre del chatbot de Air Canada (2024)

En 2024, Air Canada fue declarada legalmente responsable por las “alucinaciones” de su chatbot basado en inteligencia artificial . El modelo se inventó una política de reembolso inexistente y se la comunicó a un cliente. El tribunal dictaminó que la empresa es responsable de la información proporcionada por sus agentes de IA. Este caso demostró al mundo entero cómo la ausencia de un riguroso sistema de auditoría semántica en tiempo real puede traducirse en daños legales y financieros directos.

Métricas Fundamentales para la Evaluación en Producción

El monitoreo de modelos requiere el análisis continuo de métricas específicas como la tasa de alucinación, la latencia de tokens, la coherencia semántica y el costo por inferencia. Estos parámetros garantizan que la inteligencia artificial funcione de manera eficiente y confiable a lo largo del tiempo, previniendo la degradación del rendimiento.

A diferencia del aprendizaje automático tradicional, donde métricas como la precisión o el F1-Score son suficientes, los modelos generativos (LLM) requieren un enfoque de evaluación multidimensional. Cuando un modelo genera texto, código o decisiones, casi nunca existe una única respuesta correcta. Por lo tanto, la auditoría debe centrarse en métricas indirectas que evalúen la calidad y la seguridad de la salida.

En arquitecturas modernas como la RAG (Retrieval-Augmented Generation) , el monitoreo se basa en la llamada “Tríada RAG”:

- Relevancia del contexto: Mide si los documentos recuperados de la base de datos vectorial son realmente pertinentes a la consulta del usuario.

- Fundamentación: Verifica que la respuesta generada por el LLM se base exclusivamente en el contexto proporcionado, sin inventar hechos (alucinaciones).

- Relevancia de la respuesta: Evalúa si la respuesta final resuelve efectivamente la pregunta inicial del usuario, evitando divagaciones.

| Métrica de seguimiento | Descripción Técnica | Umbral de Alarma Típico |

|---|---|---|

| Tiempo hasta el primer token (TTFT) | El tiempo que tarda el modelo en generar la primera palabra de la respuesta. Crucial para la experiencia del usuario (UX). | > 1,5 segundos |

| Tasa de toxicidad | Porcentaje de resultados que contienen lenguaje ofensivo, sesgos o contenido inseguro. | > 0,1 % |

| Tokens por segundo (TPS) | La velocidad de generación del texto. Afecta directamente a los costes de infraestructura. | < 15 TPS |

Gestión de la seguridad de los agentes y la privacidad de los datos

Para un monitoreo adecuado de los modelos , la seguridad de los agentes y la privacidad son prioritarias. Es fundamental implementar mecanismos de control para bloquear ataques de inyección de prompts y anonimizar los datos sensibles (PII) antes de que lleguen al LLM, previniendo así fugas de información crítica.

La integración de agentes autónomos basados en LLM en los flujos de trabajo empresariales ha introducido una nueva superficie de ataque. Según la documentación oficial de OWASP Top 10 for LLMs , las vulnerabilidades más críticas incluyen la inyección de instrucciones (donde un usuario malintencionado manipula las instrucciones del modelo) y el manejo inseguro de la salida (donde la salida del modelo se ejecuta sin validación por parte de los sistemas de backend).

Para garantizar la seguridad de los agentes , las empresas deben implementar una arquitectura en capas (defensa en profundidad):

- Barreras de entrada: Sistemas de clasificación (a menudo modelos de aprendizaje automático más pequeños y rápidos) que analizan la solicitud del usuario antes de enviarla al LLM principal, bloqueando los intentos de jailbreak.

- Enmascaramiento dinámico de datos: Herramientas de prevención de pérdida de datos (DLP) que interceptan y ofuscan información de identificación personal (PII), como números de tarjetas de crédito o códigos fiscales, garantizando el cumplimiento del RGPD.

- Salvaguardas de salida: Un nivel de validación final que verifica si la respuesta del LLM infringe las políticas de la empresa o contiene código malicioso antes de mostrarla al usuario.

Herramientas y marcos de trabajo para la observabilidad de los LLM

El ecosistema de monitorización de modelos se apoya en frameworks avanzados como LangSmith, Arize AI y TruEra. Estas herramientas ofrecen paneles de control de observabilidad en tiempo real, rastreando la ejecución de las cadenas y facilitando la depuración de las respuestas generadas por la inteligencia artificial.

La observabilidad va más allá del simple monitoreo. Mientras que el monitoreo te indica cuándo un sistema falla, la observabilidad te permite comprender por qué falló. En el contexto de la informática aplicada a la IA, esto significa poder inspeccionar cada paso lógico de una “cadena” o de un agente.

Los stacks tecnológicos modernos para LLMOps (operaciones de modelos de lenguaje grandes) incluyen:

- LangSmith / Langfuse: Plataformas esenciales para rastrear llamadas a la API, analizar los costes de los tokens y reproducir sesiones de usuario para depurar prompts.

- Arize Phoenix: Una excelente herramienta de código abierto para el análisis del rendimiento de las aplicaciones RAG, que permite visualizar los embeddings e identificar los clústeres de consultas en los que falla el modelo.

- Giskard: Un marco especializado en la prueba y auditoría de vulnerabilidades de modelos, capaz de generar automáticamente conjuntos de pruebas para detectar sesgos y problemas de seguridad antes de su implementación en producción.

Estrategias de mitigación de la deriva y degradación de datos

Un monitoreo eficaz de los modelos debe detectar la deriva de datos, es decir, el cambio en la distribución de los datos de entrada. La actualización continua de los vectores de contexto y los ciclos de retroalimentación humana (RLHF) son esenciales para mantener un alto rendimiento a lo largo del tiempo.

La degradación de los modelos generativos es un fenómeno insidioso. No se manifiesta con un fallo del servidor, sino con una lenta e inexorable disminución de la calidad de las respuestas. Esto ocurre principalmente debido a la deriva conceptual (Concept Drift) : el mundo cambia, el lenguaje evoluciona, pero los pesos del modelo permanecen congelados en el momento de su último entrenamiento.

Para mitigar este riesgo sin tener que reentrenar todo el LLM (una operación con costes prohibitivos), las estrategias más eficaces incluyen:

- Actualización continua de RAG: Mantener la base de datos vectorial constantemente actualizada con las últimas políticas empresariales e información de mercado. El modelo razona sobre datos recientes sin necesidad de ajuste fino.

- Implementación en sombra: Ejecutar una nueva versión del prompt o del modelo en paralelo a la que está en producción, comparando los resultados en tiempo real sin afectar al usuario final.

- Human-in-the-Loop (HITL): Implementar mecanismos de retroalimentación implícita (p. ej., el usuario copia la respuesta) y explícita (pulgar arriba/abajo) para recopilar datos valiosos destinados a futuros ciclos de alineación.

Conclusiones

La implementación de una inteligencia artificial generativa en el ámbito empresarial no concluye con su puesta en producción, sino que comienza precisamente en ese momento. Como hemos analizado, la ausencia de un monitoreo riguroso de los modelos expone a las organizaciones a riesgos inaceptables, que van desde alucinaciones perjudiciales para la marca hasta graves violaciones de la privacidad y la seguridad de los agentes.

Adoptar un enfoque proactivo, basado en la observabilidad semántica, la implementación de salvaguardas robustas y el análisis continuo de las métricas RAG, es el único camino sostenible. Solo tratando los modelos de IA como entidades dinámicas que requieren auditorías constantes, los equipos de TI pueden garantizar que la innovación tecnológica se traduzca en una ventaja competitiva real y segura.

Preguntas frecuentes

Monitorizar un modelo generativo implica implementar un proceso de auditoría activo y semántico en tiempo real para garantizar la máxima fiabilidad. No se trata solo de controlar los registros del sistema, sino de analizar constantemente métricas específicas como la tasa de alucinación, la coherencia semántica y la latencia de los tokens.

Los modelos sufren una degradación de la calidad debido al cambio fisiológico en la distribución de los datos, un fenómeno conocido como desplazamiento de datos (data drift). Dado que el mundo y el lenguaje evolucionan rápidamente, resulta esencial actualizar constantemente las bases de datos de contexto e integrar la retroalimentación humana para mantener las respuestas siempre precisas y pertinentes.

La evaluación se realiza midiendo tres parámetros esenciales que garantizan la total seguridad del sistema. Es necesario verificar la pertinencia de los documentos recuperados de la base de datos, asegurarse de que la respuesta se base exclusivamente en los hechos proporcionados para evitar peligrosas invenciones y comprobar que el texto final resuelva realmente el problema planteado inicialmente.

Las vulnerabilidades más críticas incluyen la manipulación maliciosa de las instrucciones básicas y la gestión insegura de los resultados generados. Para proteger los sistemas empresariales, resulta estrictamente necesario implementar una arquitectura de defensa en capas que incluya filtros preventivos en las entradas, validación rigurosa de las salidas y enmascaramiento dinámico de la información personal.

Los equipos de desarrollo confían en marcos de observabilidad avanzados que permiten inspeccionar cada paso lógico del sistema. Estas plataformas especializadas ofrecen paneles de control en tiempo real para rastrear las llamadas, analizar los costes operativos y detectar posibles problemas de seguridad antes del lanzamiento al público.

¿Todavía tienes dudas sobre Auditoría y Monitorización de Modelos Generativos en Producción: Guía Definitiva?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.