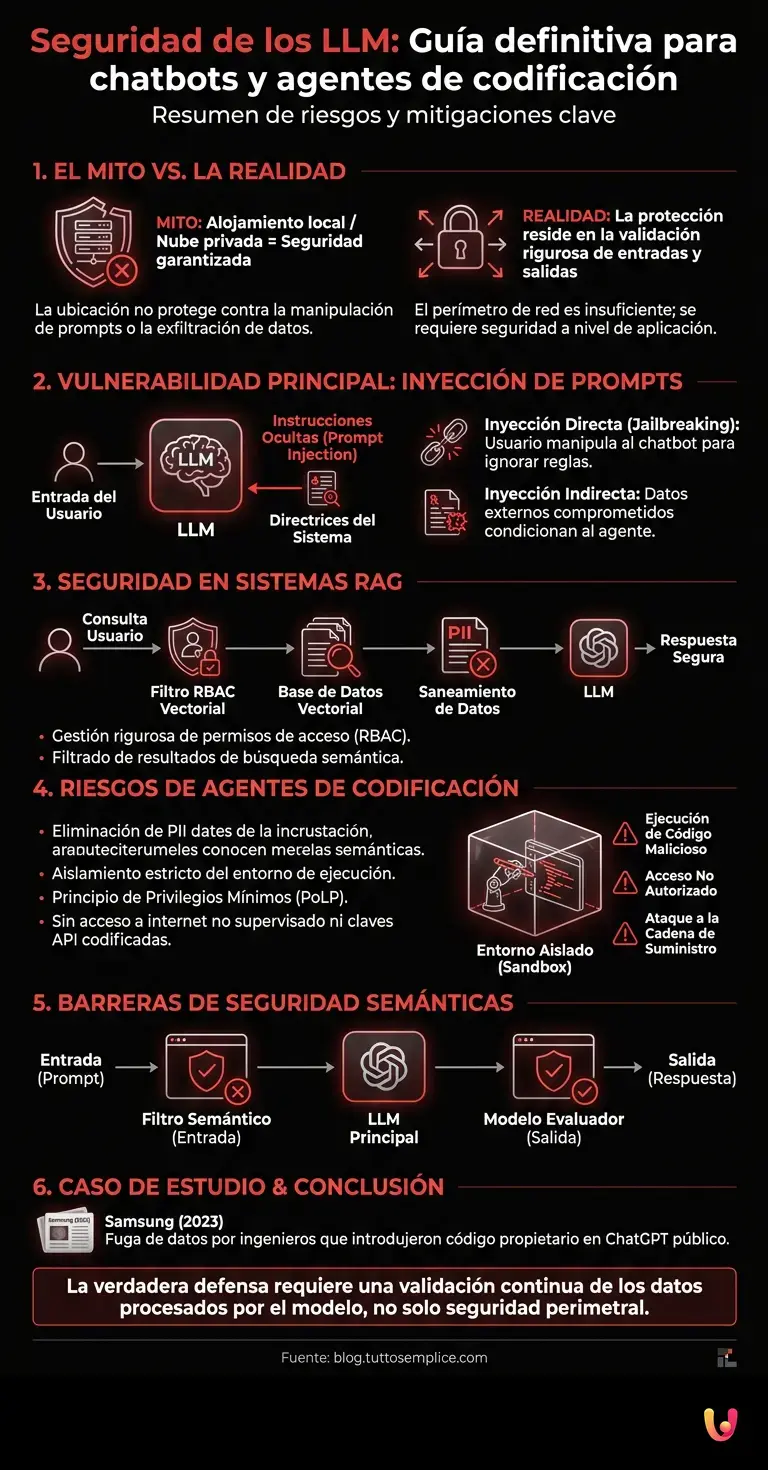

El mito más peligroso en el mundo de la inteligencia artificial empresarial es creer que alojar un modelo localmente (on-premise) o utilizar una instancia privada en la nube garantiza automáticamente la seguridad de los LLM . La realidad es brutalmente diferente: un modelo aislado, si se conecta a un agente de codificación o a una base de datos empresarial a través de RAG (Retrieval-Augmented Generation), puede ser manipulado mediante inyección de prompts para exfiltrar datos sensibles o ejecutar código malicioso, eludiendo completamente los cortafuegos tradicionales. La verdadera protección no reside en el perímetro de la red, sino en la validación rigurosa de las entradas y salidas del propio modelo.

Evalúa el nivel de riesgo de tu implementación de IA.

Arquitectura y vulnerabilidad de los modelos lingüísticos

Comprender la arquitectura básica es el primer paso para garantizar la seguridad de los LLM . Los modelos de lenguaje procesan el lenguaje natural, pero su incapacidad inherente para distinguir entre instrucciones del sistema y entradas del usuario crea vulnerabilidades críticas, especialmente en los chatbots empresariales.

Los grandes modelos de lenguaje (LLM) son fundamentalmente motores de predicción probabilística. Al integrar un LLM en una aplicación empresarial, lo exponemos a vectores de ataque únicos. Según la documentación oficial de OWASP Top 10 para LLM , la vulnerabilidad principal es la inyección de instrucciones (Prompt Injection ). Esto ocurre cuando un usuario malintencionado introduce instrucciones ocultas en el prompt que sobrescriben las directrices originales del sistema.

Existen dos variantes principales de esta amenaza:

- Inyección directa de instrucciones (Jailbreaking): El usuario manipula directamente el chatbot para que ignore las reglas de seguridad .

- Inyección indirecta de instrucciones: El LLM ingiere datos de una fuente externa comprometida (p. ej., una página web o un correo electrónico) que contiene instrucciones maliciosas ocultas, condicionando el comportamiento del agente.

Proteger los datos empresariales en los sistemas RAG

En los sistemas RAG, la seguridad del LLM depende de una gestión rigurosa de los permisos de acceso. Si un chatbot consulta una base de datos empresarial sin filtros de autorización granulares, corre el riesgo de exponer documentos confidenciales a usuarios no autorizados mediante ataques de manipulación del contexto.

La arquitectura Retrieval-Augmented Generation (RAG) es el estándar de facto para proporcionar a los modelos de IA acceso a datos propietarios. Sin embargo, la base de datos vectorial que alimenta el RAG se convierte en un objetivo principal. Si un empleado pregunta al chatbot “Resume mis objetivos trimestrales”, el sistema debe garantizar que el LLM recupere y procese solo los documentos a los que ese empleado tiene acceso explícito.

Para mitigar los riesgos de fuga de datos , es imperativo implementar:

| Medida de Seguridad | Descripción | Impacto en el Riesgo |

|---|---|---|

| RBAC Vectorial | Filtrar los resultados de la búsqueda semántica según los permisos del usuario antes de enviarlos al LLM. | Alto |

| Saneamiento de datos | Eliminar la información de identificación personal (PII) de los documentos antes de la incrustación. | Crítico |

| Auditoría de consultas | Registrar y analizar las consultas de los usuarios para detectar patrones anómalos o intentos de exfiltración. | Medio |

Riesgos y mitigaciones para los agentes de codificación

Al implementar asistentes de programación, la seguridad de los LLM requiere el aislamiento del entorno de ejecución. Los agentes de codificación autónomos pueden generar o ejecutar código malicioso si no están confinados en entornos aislados (sandbox) estrictos y carecen de privilegios elevados del sistema.

Los agentes de codificación (como las implementaciones personalizadas basadas en frameworks de agentes) no se limitan a generar texto, sino que realizan acciones: leen repositorios, escriben archivos y, en algunos casos, ejecutan scripts. Este nivel de autonomía introduce el riesgo de un diseño de plugin inseguro y de ejecución remota de código (RCE) no autorizada.

Si un agente de codificación es engañado mediante un paquete de software comprometido (ataque a la cadena de suministro) o una instrucción maliciosa en un ticket de GitHub, podría alterar el código fuente de la empresa. La regla de oro es el principio de privilegios mínimos (PoLP): el agente debe operar en contenedores efímeros, sin acceso a internet no supervisado y sin claves API codificadas.

Caso de estudio: La fuga de datos de Samsung (2023)

En 2023, ingenieros de Samsung introdujeron accidentalmente código fuente propietario y notas de reuniones internas en ChatGPT para que les ayudara a corregir errores y a formatear. Dado que los datos introducidos en los modelos públicos se utilizan a menudo para el reentrenamiento, esta información altamente sensible salió del perímetro de la empresa, obligando a la compañía a prohibir temporalmente el uso de herramientas de IA generativa pública y a acelerar el desarrollo de soluciones internas seguras.

Implementar barreras de seguridad y filtros de seguridad

La adopción de barreras semánticas es una práctica fundamental para la seguridad de los LLM . Estos filtros intermedios analizan en tiempo real tanto las entradas (prompts) como las salidas (respuestas), bloqueando intentos de jailbreak y previniendo la fuga de información sensible.

Los cortafuegos tradicionales basados en reglas de red son ineficaces contra las amenazas semánticas. Es necesario implementar un nivel de seguridad de aplicación específico para la IA. Herramientas de código abierto como NeMo Guardrails o frameworks propietarios permiten definir límites operativos estrictos.

Una arquitectura de seguridad robusta incluye un “modelo evaluador” (a menudo un LLM más pequeño y rápido) que inspecciona la salida del modelo principal antes de que se muestre al usuario. Si el evaluador detecta que la salida contiene código malicioso, datos financieros no autorizados o lenguaje inapropiado, bloquea la transacción y devuelve un mensaje de error estandarizado.

Conclusiones

En resumen, la seguridad de los LLM no es un producto que se compra, sino un proceso continuo de validación y monitorización. Proteger los chatbots y los agentes de codificación requiere un enfoque holístico que combine defensas infraestructurales, filtros semánticos y formación de desarrolladores.

La integración de la inteligencia artificial en los flujos de trabajo empresariales ofrece ventajas competitivas incalculables, pero amplía drásticamente la superficie de ataque. Las empresas que prosperarán en la era de la IA generativa serán aquellas capaces de implementar arquitecturas “seguras por diseño”, donde la validación de las entradas, el sandboxing de los agentes y el control granular del acceso a los datos (RAG) se consideran requisitos funcionales imprescindibles, no simples añadidos posteriores.

Preguntas frecuentes

Para proteger los sistemas de inteligencia artificial de manipulaciones externas, es fundamental implementar filtros semánticos avanzados y barreras de control. Estas herramientas analizan en tiempo real las peticiones de los usuarios y las respuestas generadas, bloqueando de raíz cualquier intento de eludir las directrices del sistema. Además, resulta esencial separar rigurosamente las instrucciones básicas de los datos proporcionados por los usuarios.

Muchas empresas creen erróneamente que mantener los servidores dentro de su propio perímetro de red elimina cualquier amenaza informática. En realidad, un sistema aislado sigue siendo vulnerable si se conecta a bases de datos corporativas o herramientas de desarrollo, ya que los ataques semánticos pueden aprovechar los canales de entrada legítimos para extraer información confidencial. La verdadera defensa requiere una validación continua de los datos procesados por el modelo.

Los asistentes de programación poseen un alto nivel de autonomía que les permite leer archivos, modificar ficheros y ejecutar scripts operativos. Sin restricciones adecuadas, un paquete de software comprometido o una simple instrucción maliciosa podrían llevar al sistema a ejecutar comandos dañinos en la máquina anfitriona. Para mitigar este riesgo, es indispensable confinar estos recursos en entornos aislados y aplicar el principio de mínimo privilegio.

La protección de la información propietaria en estas arquitecturas se basa en una gestión extremadamente granular de los permisos de acceso. Antes de enviar los resultados de una búsqueda semántica al motor generativo, el sistema debe verificar que el empleado tenga los derechos necesarios para visualizar esos documentos específicos. Además, resulta crucial eliminar los datos personales sensibles antes de la fase de indexación para prevenir fugas de información.

Se trata de barreras de seguridad de aplicaciones diseñadas específicamente para modelos de lenguaje natural, capaces de superar las limitaciones de los cortafuegos de red tradicionales. Su principal función consiste en controlar constantemente el flujo de la conversación para detectar y bloquear contenido inapropiado, código malicioso o intentos de extracción de datos financieros. A menudo funcionan mediante un modelo evaluador secundario que aprueba o rechaza las transacciones en milisegundos.

¿Todavía tienes dudas sobre Seguridad de los LLM: Guía definitiva para chatbots y agentes de codificación?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.