Il caso irrisolto di JonBenét Ramsey torna prepotentemente al centro dell’attenzione mediatica, ma questa volta non per una svolta nelle indagini, bensì per una controversa teoria del complotto alimentata dai social media e, potenzialmente, dalle nuove tecnologie. John Ramsey, padre della reginetta di bellezza uccisa nel 1996, è intervenuto duramente per smentire un trend virale su TikTok che pretenderebbe di collegare la figlia al defunto finanziere Jeffrey Epstein. In una dichiarazione rilasciata a fonti internazionali come People, Ramsey ha espresso preoccupazione per la deriva della disinformazione digitale, citando esplicitamente l’intelligenza artificiale come fattore abilitante per la creazione di contenuti falsi ma verosimili.

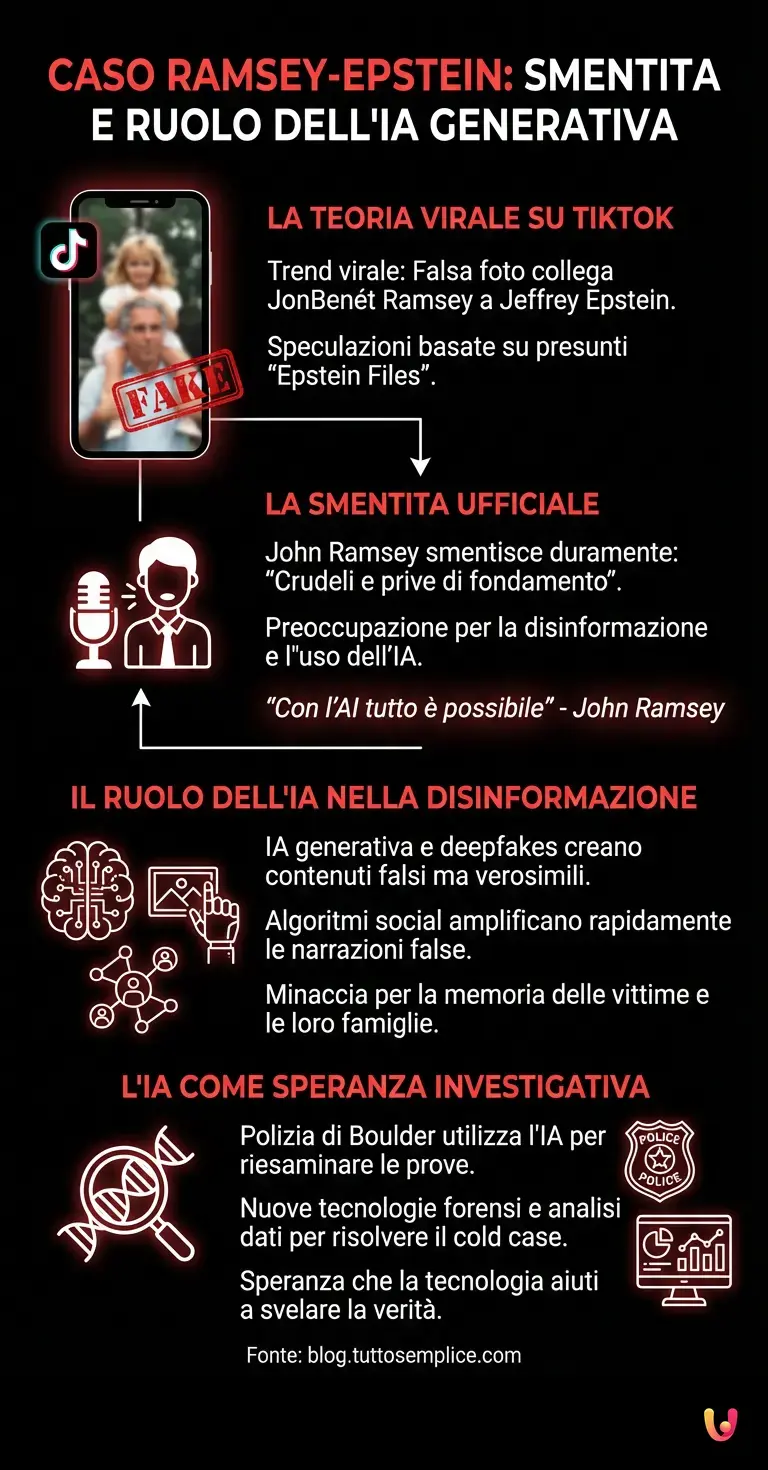

La teoria virale e la smentita ufficiale

Secondo quanto riportato dai media statunitensi e ripreso da testate come El-Balad, il trend di ricerca “jonbenet ramsey” ha subito un’impennata con oltre 1000 query specifiche nelle ultime ore. La causa è un video circolato su TikTok che mostrerebbe una presunta foto, tratta dai cosiddetti “Epstein Files”, raffigurante una bambina sulle spalle di Jeffrey Epstein. I teorici del complotto online hanno speculato che la bambina fosse proprio JonBenét e che Ghislaine Maxwell avesse partecipato a una delle feste di compleanno della piccola.

La risposta di John Ramsey non si è fatta attendere. Definendo queste speculazioni “crudeli” e “prive di fondamento”, ha sottolineato come l’immagine sia frutto di manipolazione o di un’errata interpretazione contestuale. Secondo People, Ramsey ha dichiarato: «Non c’è assolutamente alcuna verità in questo. Non l’ho visto, ma con l’AI tutto è possibile». Questa affermazione pone l’accento su un problema crescente: la difficoltà di distinguere la realtà dalla finzione nell’era del deep learning.

L’impatto dell’Intelligenza Artificiale sulla disinformazione

Il riferimento di Ramsey all’intelligenza artificiale non è casuale. L’evoluzione degli algoritmi di machine learning e dei modelli generativi ha reso estremamente semplice la creazione di immagini fotorealistiche (deepfakes) che possono ingannare anche l’occhio più esperto. Piattaforme basate su LLM (Large Language Models) e generatori di immagini automatizzati permettono la diffusione rapida di narrazioni visive false, che vengono poi amplificate dagli algoritmi di raccomandazione dei social network.

In questo contesto, l’automazione della disinformazione rappresenta una minaccia concreta per la memoria delle vittime di crimini e per le loro famiglie. Strumenti avanzati, simili a ChatGPT nella generazione di testi o a Midjourney per le immagini, se usati impropriamente, possono costruire scenari alternativi che, pur essendo tecnicamente falsi, generano un impatto emotivo reale e dannoso. La facilità con cui tali contenuti diventano virali dimostra la necessità di nuovi strumenti di verifica e di una maggiore consapevolezza digitale.

La tecnologia come speranza per le indagini

Tuttavia, il rapporto tra il caso Ramsey e l’innovazione tecnologica non è solo negativo. Mentre i social media diffondono teorie infondate, le forze dell’ordine stanno guardando all’intelligenza artificiale come a una risorsa investigativa. Secondo recenti aggiornamenti sulle indagini a Boulder, la polizia sta integrando nuove tecnologie forensi e analisi dei dati potenziate dall’AI per riesaminare le prove raccolte quasi trent’anni fa.

L’uso di sistemi avanzati per l’analisi del DNA e il riconoscimento di pattern attraverso il machine learning potrebbe finalmente offrire le risposte che la famiglia Ramsey attende da decenni. La speranza è che la stessa tecnologia capace di generare “fake news” possa, se applicata con rigore scientifico, aiutare a svelare la verità nascosta dietro uno dei cold case più famosi d’America.

In Breve (TL;DR)

John Ramsey smentisce duramente le teorie virali su TikTok che collegano falsamente la figlia JonBenét a Jeffrey Epstein.

Il padre della vittima denuncia i pericoli dell’intelligenza artificiale generativa nel diffondere immagini manipolate e disinformazione crudele.

Le autorità sperano tuttavia che l’uso scientifico dell’intelligenza artificiale possa svelare la verità sul crimine irrisolto da decenni.

Conclusioni

La vicenda che ha coinvolto John Ramsey e la memoria di sua figlia evidenzia il doppio volto dell’era digitale. Da un lato, l’abuso degli strumenti di intelligenza artificiale alimenta teorie del complotto dolorose e infondate, sfruttando la viralità per diffondere falsità su figure come Jeffrey Epstein e JonBenét. Dall’altro, la fiducia nelle capacità analitiche degli algoritmi rimane l’ultima speranza per risolvere il caso. Come sottolineato dalle reazioni di Ramsey, la sfida futura non sarà solo tecnologica, ma etica: distinguere ciò che l’AI può creare da ciò che è realmente accaduto.

Domande frequenti

Non esiste alcuna prova concreta che colleghi la bambina al finanziere. Le speculazioni recenti derivano esclusivamente da un trend virale su TikTok e da presunte immagini che John Ramsey ha definito prive di fondamento. Si tratta di una teoria del complotto alimentata dalla disinformazione digitale e non supportata dai documenti ufficiali o dalle indagini storiche.

L immagine che circola sui social media è considerata falsa o frutto di manipolazione digitale. John Ramsey ha suggerito che potrebbe trattarsi di un prodotto dell intelligenza artificiale generativa o di un deepfake creato per ingannare gli utenti. Esperti e familiari confermano che non vi è veridicità nello scatto che ritrarrebbe la bambina sulle spalle di Epstein.

La tecnologia gioca un doppio ruolo in questa vicenda. Da un lato strumenti come i deepfakes facilitano la creazione di prove false e teorie del complotto dannose per la famiglia. Dall altro le forze dell ordine di Boulder stanno utilizzando algoritmi avanzati e machine learning per riesaminare le prove del DNA e cercare di risolvere questo caso irrisolto da quasi trent anni.

Il padre di JonBenét ha smentito categoricamente le voci definendole crudeli e assolutamente non veritiere. Ha espresso forte preoccupazione per come le piattaforme social e l IA possano generare contenuti falsi ma verosimili sottolineando la difficoltà odierna nel distinguere la realtà dalla finzione creata dagli algoritmi.

Hai ancora dubbi su Caso Ramsey-Epstein: smentita e ruolo dell’IA generativa?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.