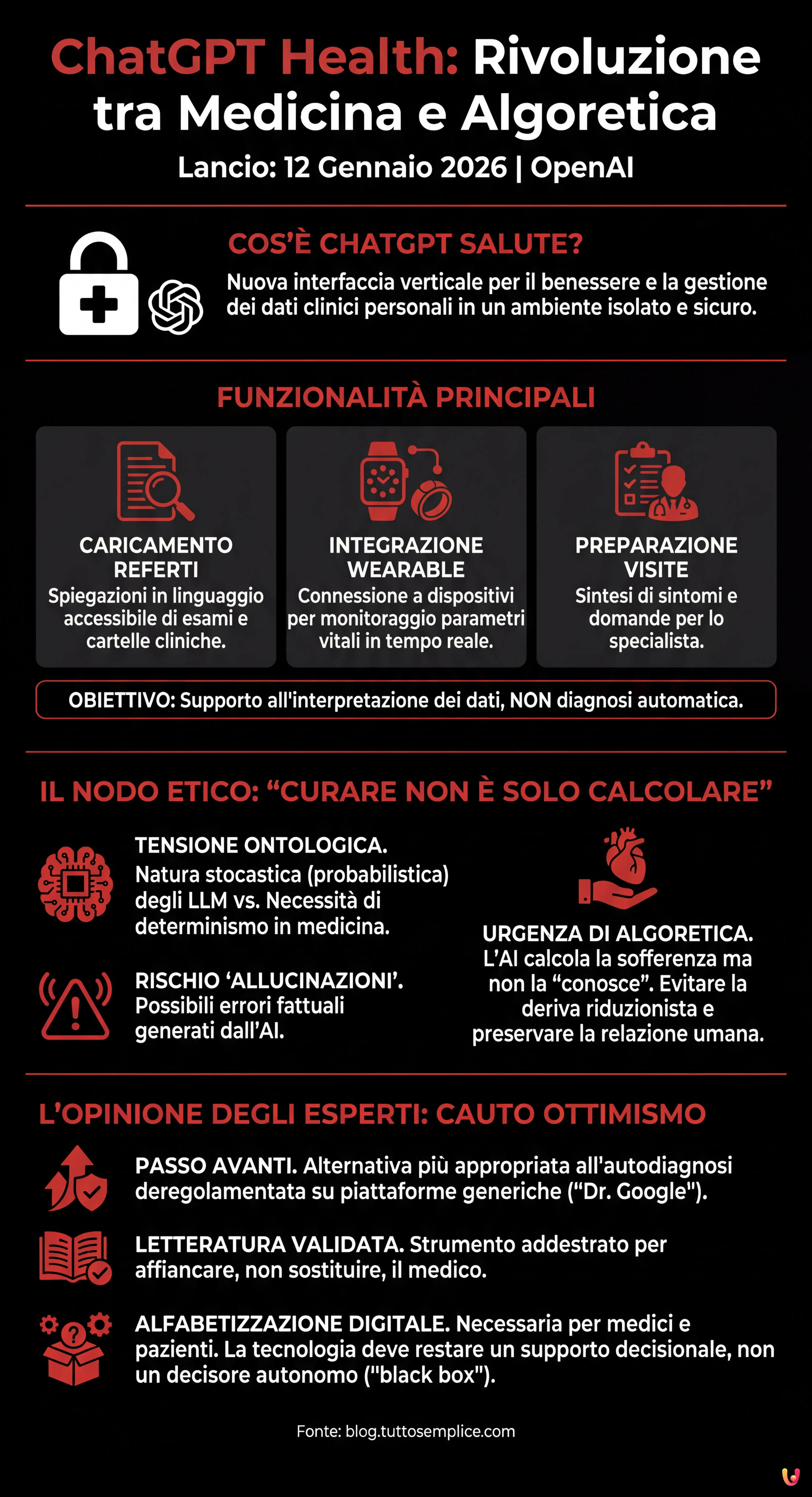

Il 12 gennaio 2026 segna una data spartiacque per la medicina digitale. OpenAI ha ufficialmente lanciato ChatGPT Health (in Italia ChatGPT Salute), una nuova interfaccia verticale dedicata esclusivamente al benessere e alla gestione dei dati clinici personali. La notizia, rimbalzata dalle principali testate tecnologiche internazionali fino ai quotidiani italiani come Avvenire e Vanity Fair, promette di cambiare radicalmente il rapporto tra pazienti e informazioni sanitarie. Non si tratta più di semplici interrogazioni a un chatbot generico, ma di un sistema integrato capace di leggere cartelle cliniche e dialogare con i dispositivi indossabili.

L’annuncio ha sollevato un’immediata ondata di reazioni contrastanti. Da un lato, la promessa di uno strumento che democratizza l’accesso alla comprensione dei propri dati biologici; dall’altro, il forte monito etico su cosa significhi realmente “curare” in un’epoca dominata dagli algoritmi. Se la tecnologia corre, la riflessione bioetica cerca di tenere il passo, ponendo interrogativi cruciali sulla privacy, sull’accuratezza e sulla natura stessa della relazione medico-paziente.

Come funziona ChatGPT Salute

Secondo quanto riportato da Vanity Fair Italia, il nuovo spazio lanciato da OpenAI non è un semplice aggiornamento, ma il frutto di due anni di sviluppo che hanno coinvolto oltre 260 medici in 60 paesi. La piattaforma si distingue per la capacità di gestire dati sensibili in un ambiente isolato e conforme alle normative sulla privacy sanitaria. Le funzionalità principali includono:

- Caricamento di documenti clinici: Gli utenti possono caricare referti ed esami per ottenere spiegazioni in linguaggio accessibile.

- Integrazione con i wearable: Il sistema si connette a smartwatch e anelli intelligenti per monitorare parametri vitali in tempo reale.

- Preparazione alle visite: L’AI aiuta il paziente a sintetizzare i sintomi e le domande da porre al proprio specialista.

L’obiettivo dichiarato non è la diagnosi automatica, ma il supporto all’interpretazione dei dati, riducendo il divario informativo tra medico e paziente.

Il nodo etico: “Curare non è solo calcolare”

La voce più critica e riflessiva arriva dalle colonne di Avvenire, con un editoriale firmato da Paolo Benanti dal titolo emblematico: “ChatGpt Health? Curare non è solo calcolare”. L’articolo mette in guardia contro il rischio di una deriva riduzionista. Secondo Benanti, l’interazione con l’intelligenza artificiale in ambito sanitario sta passando da semplici domande generiche a una “compenetrazione tra i dati biologici più intimi e i modelli probabilistici”.

Il cuore del problema risiede nella tensione ontologica tra la natura stocastica dei Large Language Models (LLM) — che prevedono la parola successiva in base a probabilità statistiche — e la necessità di determinismo assoluto che la medicina richiede. Il rischio delle cosiddette “allucinazioni” (errori fattuali generati dall’AI) rimane una “spada di Damocle”. L’editoriale sottolinea l’urgenza di una “algoretica”, ovvero un’etica applicata agli algoritmi, per evitare che la medicina perda la sua componente umana essenziale. Un sistema che non “conosce” la sofferenza ma si limita a calcolarla, avverte Avvenire, non può sostituire l’atto medico nella sua interezza.

L’opinione degli esperti: un passo verso l’appropriatezza

Nonostante i timori, il settore della sanità digitale accoglie la novità con cauto ottimismo. Chiara Sgarbossa, Direttrice dell’Osservatorio Sanità Digitale del Politecnico di Milano, ha commentato l’evoluzione evidenziando come l’uso dell’AI da parte dei pazienti fosse già una realtà, ma spesso deregolamentata. Secondo Sgarbossa, il passaggio a uno strumento verticale come ChatGPT Salute rappresenta un “passo avanti verso un uso più appropriato dell’AI tra i pazienti”.

Fino a ieri, milioni di utenti utilizzavano piattaforme generaliste per l’autodiagnosi, con rischi enormi di disinformazione. Avere uno strumento addestrato su letteratura medica validata e progettato per non sostituirsi al medico, ma per affiancarlo, potrebbe mitigare il fenomeno del “Dr. Google”. Tuttavia, Sgarbossa ribadisce la necessità di investire nella digital literacy (alfabetizzazione digitale) sia dei medici che dei cittadini: la tecnologia deve rimanere un supporto decisionale, mai un decisore autonomo, specialmente di fronte alla “black box” degli algoritmi di cui spesso non si comprendono appieno i processi logici.

In Breve (TL;DR)

OpenAI lancia ChatGPT Health, una piattaforma verticale che rivoluziona la gestione dei dati clinici e l’integrazione con i dispositivi indossabili.

Il sistema supporta l’interpretazione di referti ed esami per ridurre il divario informativo, senza mai sostituirsi alla diagnosi medica professionale.

Esperti ed eticisti invocano una rigorosa algoretica per garantire che l’innovazione tecnologica non oscuri mai la componente umana della cura.

Conclusioni

Il lancio di ChatGPT Health nel gennaio 2026 rappresenta senza dubbio una pietra miliare nella storia della tecnologia consumer applicata alla salute. Se da una parte l’innovazione offre strumenti potenti per l’empowerment del paziente e la gestione della complessità clinica, dall’altra impone una sorveglianza etica rigorosa. Come ricordato dalle fonti analizzate, la sfida dei prossimi mesi non sarà solo tecnologica, ma culturale: integrare la potenza di calcolo dell’AI senza dimenticare che la cura è, e deve restare, un atto profondamente umano.

Domande frequenti

ChatGPT Salute, noto internazionalmente come ChatGPT Health, è una nuova interfaccia di OpenAI lanciata nel gennaio 2026 dedicata specificamente al benessere e alla gestione dei dati clinici. Sviluppata con il supporto di oltre 260 medici, la piattaforma permette agli utenti di caricare referti ed esami per ottenerne una spiegazione in linguaggio semplice. Inoltre, il sistema si integra con dispositivi indossabili come smartwatch e anelli intelligenti per monitorare i parametri vitali in tempo reale e aiuta i pazienti a prepararsi alle visite mediche sintetizzando i sintomi.

No, l’obiettivo dichiarato di ChatGPT Health non è la diagnosi automatica né la sostituzione del medico, ma il supporto all’interpretazione dei dati. Gli esperti sottolineano che la cura medica è un atto profondamente umano che non può essere ridotto a un calcolo algoritmico. Lo strumento serve a ridurre il divario informativo e a mitigare il fenomeno dell’autodiagnosi errata online, agendo come un assistente che affianca il professionista sanitario senza mai prenderne il posto nelle decisioni cliniche.

La piattaforma gestisce i dati sensibili in un ambiente isolato e progettato per essere conforme alle normative sulla privacy sanitaria. A differenza delle versioni generiche del chatbot, ChatGPT Salute utilizza protocolli specifici per trattare informazioni delicate come cartelle cliniche e dati biometrici provenienti dai dispositivi connessi. Questo approccio mira a offrire uno spazio sicuro dove l’utente può interagire con le proprie informazioni biologiche senza i rischi tipici delle piattaforme non regolamentate.

I principali rischi etici riguardano la natura stocastica dei modelli linguistici, che operano su base probabilistica e possono generare errori fattuali definiti allucinazioni. Esiste il timore che l’uso massiccio di algoritmi porti a una deriva riduzionista, dove la medicina perde la sua componente empatica per diventare puro calcolo statistico. Per questo motivo, si invoca l’adozione di una algoretica, ovvero un’etica applicata agli algoritmi, per garantire che la tecnologia rimanga un supporto decisionale e non un decisore autonomo privo di comprensione della sofferenza umana.

Hai ancora dubbi su ChatGPT Health: la rivoluzione di OpenAI tra medicina e algoretica?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- OMS: Linee guida su etica e governance dei grandi modelli multimodali (LMM) in sanità

- Garante per la protezione dei dati personali: Normative e approfondimenti sull’Intelligenza Artificiale

- Commissione Europea: Lo Spazio europeo dei dati sanitari (EHDS) per la condivisione clinica

- AGENAS: Il portale dell’Agenzia Nazionale per i Servizi Sanitari Regionali sulla Sanità Digitale

- Wikipedia: Definizione e concetti chiave dell’Algoretica

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.