In Breve (TL;DR)

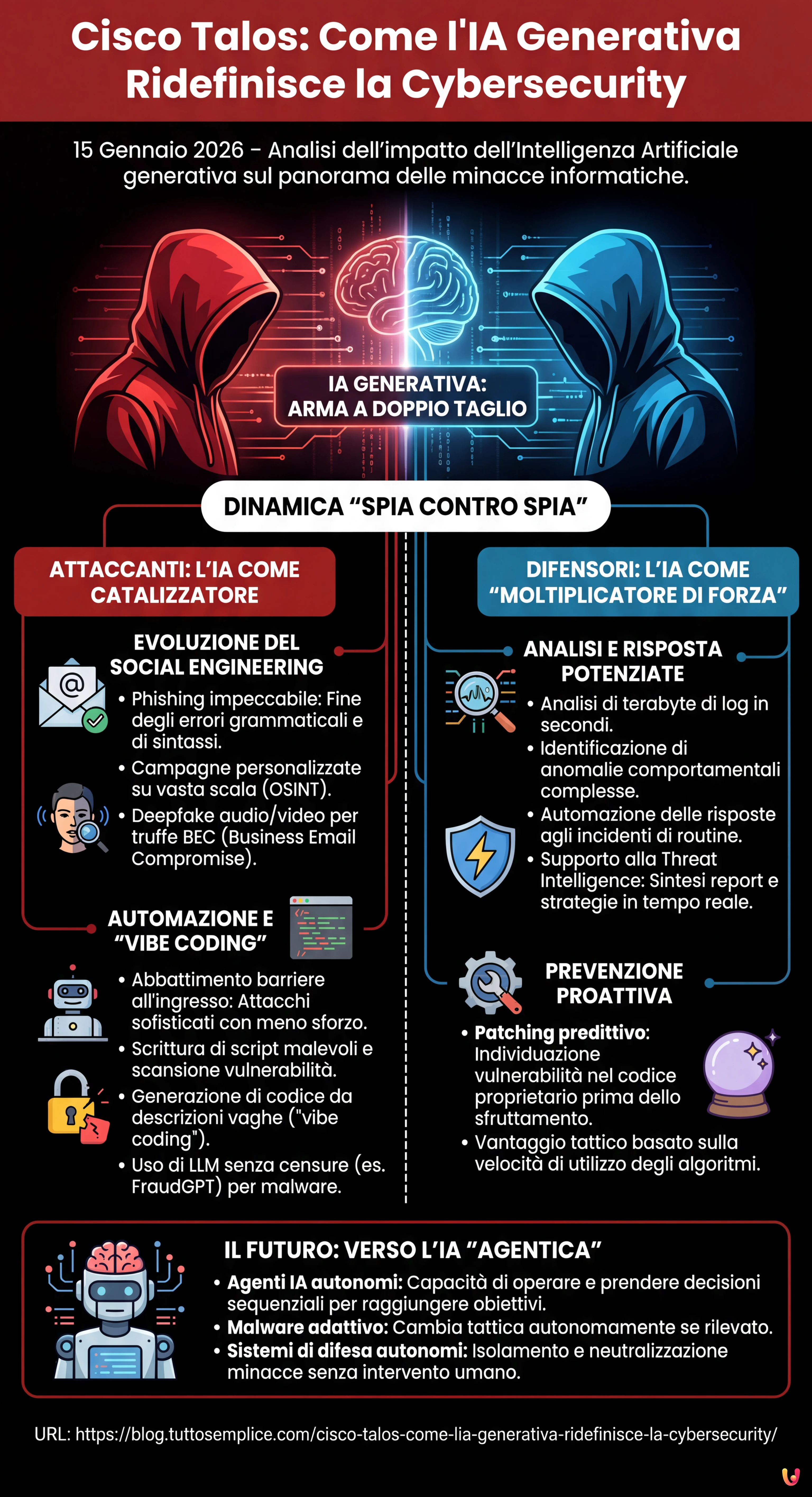

L’analisi di Cisco Talos svela uno scenario in cui l’IA generativa è l’arma prediletta sia dai cybercriminali che dai team di difesa.

Gli attaccanti sfruttano l’automazione per creare campagne di phishing impeccabili e malware complessi, rendendo le minacce accessibili anche a criminali meno esperti.

I professionisti della sicurezza rispondono usando l’IA come moltiplicatore di forza per analizzare rapidamente le minacce e prevenire incidenti in tempo reale.

Il diavolo è nei dettagli. 👇 Continua a leggere per scoprire i passaggi critici e i consigli pratici per non sbagliare.

15 Gennaio 2026 – L’Intelligenza Artificiale generativa non è più una promessa futuristica, ma una realtà consolidata che permea ogni aspetto del tessuto produttivo e sociale. Dalle startup innovative alle grandi multinazionali, l’adozione di strumenti basati su LLM (Large Language Models) ha trasformato radicalmente i flussi di lavoro, promettendo efficienza e semplificazione. Tuttavia, questa onnipresenza tecnologica porta con sé un rovescio della medaglia inquietante: un panorama delle minacce informatiche in rapida evoluzione, dove l’IA è diventata l’arma prediletta sia per chi attacca sia per chi difende.

Secondo la più recente analisi pubblicata dai ricercatori di Cisco Talos, la più grande organizzazione privata di intelligence sulle minacce al mondo, stiamo assistendo a una vera e propria dinamica “Spy vs. Spy” (spia contro spia). Se da un lato l’IA generativa sta abbattendo le barriere all’ingresso per i cybercriminali, permettendo loro di sferrare attacchi più sofisticati con meno sforzo, dall’altro rappresenta un’ancora di salvezza per i team di sicurezza, costretti a gestire una mole di dati sempre più ingestibile. In questo scenario del 2026, la tecnologia non è più solo il campo di battaglia, ma il soldato stesso.

L’evoluzione del Social Engineering: la fine degli errori grammaticali

Uno degli impatti più immediati e tangibili evidenziati dal report di Cisco Talos riguarda il social engineering. Fino a pochi anni fa, le email di phishing erano spesso riconoscibili per errori di sintassi, formattazione scadente o traduzioni automatiche approssimative. Oggi, grazie all’intelligenza artificiale generativa, questi segnali rivelatori sono quasi scomparsi. I criminali informatici utilizzano l’IA per redigere comunicazioni impeccabili, perfettamente contestualizzate e indistinguibili da quelle legittime.

Secondo gli esperti di Talos, l’IA viene impiegata per analizzare enormi quantità di dati pubblici (OSINT) sulle vittime, permettendo la creazione di campagne di spear-phishing altamente personalizzate su vasta scala. Inoltre, l’uso di deepfake audio e video ha elevato il rischio delle truffe BEC (Business Email Compromise), dove la voce di un CEO o l’immagine di un collega possono essere clonate in tempo reale per autorizzare transazioni fraudolente. La fiducia digitale, pilastro delle interazioni moderne, è sotto assedio.

Automazione e “Vibe Coding”: l’IA nelle mani degli attaccanti

Non è solo la qualità degli attacchi a preoccupare, ma anche la velocità e l’accessibilità. Cisco Talos segnala come l’IA stia fungendo da catalizzatore per l’automazione delle attività criminali. I gruppi di attaccanti, dalle organizzazioni statali ai singoli criminali motivati dal profitto, utilizzano l’IA per scrivere script malevoli, scansionare vulnerabilità e persino per il cosiddetto “vibe coding”, ovvero la generazione di codice funzionale partendo da descrizioni vaghe o imprecise.

Sebbene l’intervento umano rimanga necessario per orchestrare attacchi complessi e aggirare le difese più robuste, l’IA ha abbassato drasticamente la soglia di competenza tecnica richiesta. Strumenti come versioni “jailbroken” di modelli famosi o LLM privi di censure (spesso venduti nel dark web come FraudGPT o simili) permettono anche ad attori meno esperti di generare malware o script di evasione che in passato avrebbero richiesto competenze di alto livello.

La difesa: l’IA come “moltiplicatore di forza”

Fortunatamente, la medaglia ha un’altra faccia. Per i professionisti della cybersecurity, l’intelligenza artificiale generativa è diventata un alleato indispensabile. In un settore afflitto da una cronica carenza di talenti, l’IA agisce come un “moltiplicatore di forza”. Secondo Cisco Talos, i difensori utilizzano queste tecnologie per analizzare terabyte di log di sicurezza in secondi, identificare anomalie comportamentali che sfuggirebbero all’occhio umano e automatizzare le risposte agli incidenti di routine.

L’IA supporta gli analisti nella threat intelligence, sintetizzando report complessi e suggerendo strategie di mitigazione in tempo reale. Inoltre, viene sempre più utilizzata per il “patching” predittivo, individuando potenziali vulnerabilità nel codice proprietario prima che possano essere sfruttate dagli attaccanti. La battaglia, dunque, si gioca sulla velocità: chi utilizza meglio i propri algoritmi — l’attaccante o il difensore — ottiene il vantaggio tattico.

Il futuro: verso l’IA “Agentica”

Guardando oltre l’orizzonte immediato, l’analisi di Cisco Talos pone l’accento sull’emergere della cosiddetta IA Agentica (Agentic AI). A differenza dei chatbot passivi che rispondono a un prompt, gli agenti IA sono capaci di operare autonomamente per raggiungere un obiettivo, prendendo decisioni sequenziali. Nel contesto della cybersecurity, questo potrebbe tradursi in malware capaci di adattarsi autonomamente all’ambiente in cui si trovano, cambiando tattica se rilevati, o, viceversa, in sistemi di difesa capaci di isolare e neutralizzare una minaccia senza alcun intervento umano.

Conclusioni

L’analisi di Cisco Talos dipinge un quadro chiaro per questo inizio 2026: l’intelligenza artificiale generativa ha irreversibilmente cambiato le regole del gioco. Non si tratta più di se l’IA verrà usata in un attacco informatico, ma di come e quando. Tuttavia, nonostante la potenza tecnologica in campo, il fattore umano rimane l’anello critico. La tecnologia può automatizzare la rilevazione e l’attacco, ma la strategia, l’etica e la capacità di discernimento restano prerogative umane. In questo nuovo panorama, la formazione continua e una sana cultura della sicurezza (“zero trust”) sono le uniche vere difese contro un futuro sempre più sintetico.

Domande frequenti

Secondo l analisi di Cisco Talos, l intelligenza artificiale generativa ha trasformato la sicurezza informatica in una dinamica competitiva definita spia contro spia. Da un lato, abbassa le barriere per i cybercriminali permettendo attacchi più sofisticati con meno sforzo; dall altro, funge da moltiplicatore di forza per i difensori, aiutandoli a gestire enormi moli di dati e a colmare la carenza di personale qualificato. La tecnologia non è più solo il campo di battaglia, ma partecipa attivamente allo scontro come strumento primario per entrambe le parti.

L IA ha reso gli attacchi di social engineering molto più insidiosi eliminando i classici segnali di riconoscimento come errori grammaticali, di sintassi o traduzioni approssimative. Grazie all analisi automatizzata di dati pubblici OSINT, i criminali creano comunicazioni spear-phishing altamente personalizzate e indistinguibili da quelle legittime. Inoltre, l uso di deepfake audio e video ha incrementato il rischio di truffe aziendali, permettendo di clonare la voce o l immagine di dirigenti per autorizzare transazioni fraudolente in tempo reale.

L intelligenza artificiale funge da catalizzatore per l automazione delle attività criminali, abbassando drasticamente la soglia di competenza tecnica necessaria. Attraverso pratiche come il vibe coding, gli attaccanti possono generare codice malevolo funzionale partendo da descrizioni vaghe. L esistenza di modelli LLM senza censure o versioni sbloccate vendute nel dark web consente anche ad attori meno esperti di creare malware complessi e script di evasione che in passato avrebbero richiesto abilità di alto livello.

Per i professionisti della cybersecurity, l IA è diventata un alleato fondamentale per contrastare la carenza di talenti nel settore. Viene impiegata per analizzare terabyte di log in pochi secondi, identificare anomalie comportamentali invisibili all occhio umano e automatizzare le risposte agli incidenti di routine. Inoltre, supporta la threat intelligence sintetizzando report complessi e abilita il patching predittivo, individuando vulnerabilità nel codice proprietario prima che vengano sfruttate dagli attaccanti.

L IA Agentica rappresenta l evoluzione futura dei sistemi intelligenti, passando da chatbot passivi ad agenti capaci di operare autonomamente per raggiungere obiettivi specifici prendendo decisioni sequenziali. Nel contesto della cybersecurity, questo scenario prevede la comparsa di malware in grado di adattarsi all ambiente e cambiare tattica se scoperti, ma anche di sistemi difensivi avanzati capaci di isolare e neutralizzare le minacce in autonomia senza attendere l intervento umano.

Fonti e Approfondimenti

- ENISA: Intelligenza Artificiale e Cybersicurezza (Unione Europea)

- CISA: Roadmap e risorse per la sicurezza dell’Intelligenza Artificiale (USA)

- NIST: Framework per la gestione dei rischi dell’IA

- NCSC: L’impatto dell’IA sulle minacce informatiche (Regno Unito)

- Wikipedia: Approfondimento sull’Ingegneria Sociale

Hai trovato utile questo articolo? C'è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.