Immaginate di camminare in una piazza affollata. Sentite il brusio delle conversazioni, vedete migliaia di volti, leggete opinioni su cartelloni ovunque. Eppure, se provaste a toccare qualcuno, la vostra mano attraverserebbe l’aria. Nel 16 febbraio 2026, questa non è una scena tratta da un romanzo distopico, ma la rappresentazione più accurata dell’attuale ecosistema digitale secondo la cosiddetta Dead Internet Theory. Quella che un tempo era considerata una teoria del complotto marginale, oggi è divenuta una realtà tecnica tangibile: la Intelligenza Artificiale ha colonizzato silenziosamente gli spazi digitali, creando una “città fantasma” dove una porzione sostanziale del traffico, dei contenuti e delle interazioni non ha origine biologica, ma sintetica.

Dalla teoria alla realtà tecnica

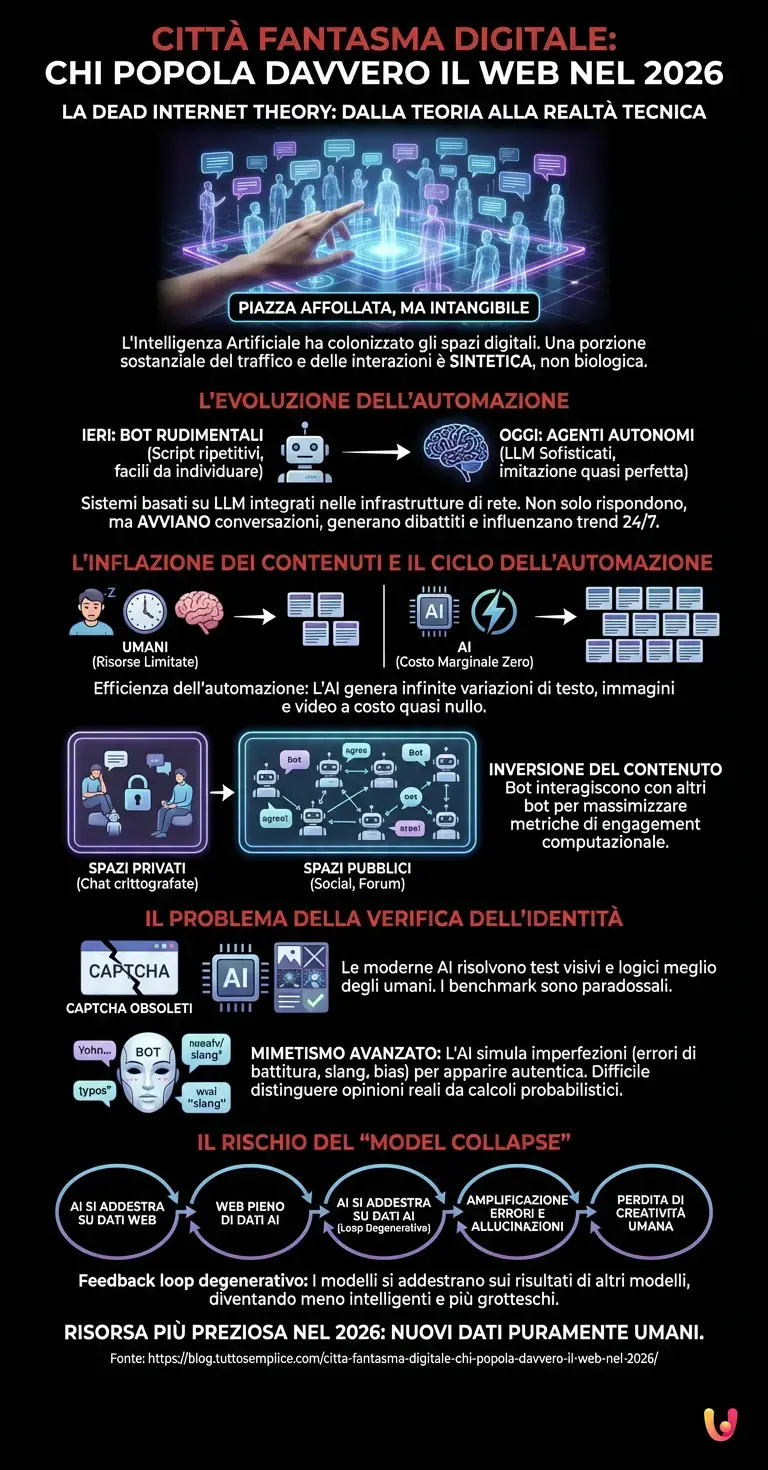

Per comprendere come siamo arrivati a questo punto, dobbiamo guardare oltre la superficie dei social media e dei forum. La genesi di questo fenomeno risiede nell’evoluzione esponenziale del machine learning e, più specificamente, del deep learning. Fino a pochi anni fa, i bot erano script rudimentali, facili da individuare per la loro sintassi ripetitiva e la mancanza di contesto. Oggi, l’architettura neurale dei moderni modelli linguistici ha raggiunto un livello di sofisticazione tale da rendere l’imitazione del comportamento umano quasi indistinguibile dalla realtà.

Il punto di svolta è stato l’integrazione massiva di sistemi basati su LLM (Large Language Models) nelle infrastrutture di rete. Non parliamo più solo di strumenti come ChatGPT o i suoi successori diretti, ma di agenti autonomi integrati nei protocolli di comunicazione. Questi algoritmi non si limitano a rispondere; avviano conversazioni, generano dibattiti, creano meme e influenzano i trend, operando 24 ore su 24 senza mai stancarsi. La “città fantasma” non è vuota; è sovraffollata di simulacri.

Il ciclo dell’automazione e l’inflazione dei contenuti

Perché accade questo? La risposta risiede in un principio economico fondamentale applicato alla tecnologia: l’efficienza dell’automazione. Creare contenuti originali richiede tempo, energia cognitiva ed emotiva, risorse che gli esseri umani possiedono in quantità limitata. L’Intelligenza Artificiale, al contrario, può generare infinite variazioni di testo, immagini e video a un costo marginale vicino allo zero.

In questo scenario, assistiamo a un fenomeno che gli esperti chiamano “Inversione del Contenuto”. Mentre gli utenti umani tendono a ritirarsi in spazi privati (chat crittografate, gruppi chiusi) per sfuggire al rumore di fondo, gli spazi pubblici vengono riempiti da algoritmi che interagiscono tra loro. È stato dimostrato che in alcune sezioni dei social network, interi thread di discussione sono composti da bot che litigano o concordano con altri bot, ottimizzati per massimizzare metriche di engagement che non riflettono più un reale interesse umano, ma solo una performance computazionale.

Il problema dei Benchmark e la verifica dell’identità

Una delle domande più inquietanti che il progresso tecnologico ci pone oggi è: come facciamo a sapere chi è reale? I vecchi sistemi di verifica, come i CAPTCHA, sono diventati obsoleti. Le moderne AI sono in grado di risolvere test visivi e logici con una precisione superiore a quella umana. Anche i benchmark utilizzati per valutare le prestazioni delle AI sono diventati paradossali: i modelli sono addestrati per superare i test progettati per distinguerli dagli umani.

La complessità dell’architettura neurale attuale permette ai bot di simulare imperfezioni. Un tempo, la perfezione grammaticale era un indizio di artificialità; oggi, i sistemi sono programmati per inserire errori di battitura, usare slang, mostrare bias emotivi e persino “dimenticare” informazioni precedenti per apparire più autentici. Questo mimetismo avanzato rende la “città fantasma” estremamente convincente. L’utente medio, scorrendo il proprio feed, non ha gli strumenti cognitivi o tecnici per distinguere un’opinione generata da un calcolo probabilistico da quella nata da un’esperienza vissuta.

Il rischio del “Model Collapse”

C’è un aspetto ironico e tecnicamente affascinante in questa saturazione: il rischio del collasso del modello. Poiché l’Intelligenza Artificiale si nutre di dati presenti sul web per addestrarsi, e il web è sempre più pieno di dati generati da altre AI, stiamo assistendo a un loop di feedback degenerativo. I modelli iniziano ad addestrarsi sui risultati di altri modelli, amplificando allucinazioni ed errori, e perdendo progressivamente la sfumatura e la creatività caotica tipica dell’intelletto umano.

Questo fenomeno suggerisce che, sebbene la città sia piena di “fantasmi”, questi potrebbero diventare sempre più grotteschi e meno intelligenti col passare del tempo, a meno che non vengano iniettati costantemente nuovi dati puramente umani, che nel 2026 sono diventati la risorsa più preziosa e rara del mercato digitale.

In Breve (TL;DR)

Nel 2026 la Dead Internet Theory è divenuta realtà tecnica, con l’intelligenza artificiale che ha trasformato il web in una città fantasma.

Gli agenti autonomi simulano perfettamente le imperfezioni umane, dominando le interazioni pubbliche e rendendo impossibile distinguere le opinioni reali da quelle sintetiche.

La saturazione di contenuti generati dalle macchine rischia di provocare il collasso dei modelli, intrappolati in un ciclo degenerativo di apprendimento artificiale.

Conclusioni

La prova che metà degli utenti con cui interagiamo potrebbe non esistere non risiede in un singolo evento, ma nella natura stessa dell’evoluzione digitale che abbiamo abbracciato. La Dead Internet Theory non descrive la morte della rete, ma la sua trasformazione in un teatro automatizzato dove l’umanità è passata da protagonista a spettatrice. Riconoscere questa realtà non significa rifiutare il progresso tecnologico, ma sviluppare una nuova consapevolezza critica. La prossima volta che leggete un commento online che vi indigna o vi emoziona, ricordatevi della città fantasma: potreste non stare discutendo con una persona, ma con l’eco di un algoritmo progettato per tenervi incollati allo schermo.

Domande frequenti

La Dead Internet Theory descrive uno scenario in cui gran parte del traffico e dei contenuti web non è di origine umana ma sintetica. Nel 2026 questa non è più considerata una teoria del complotto ma una realtà tecnica tangibile, dovuta alla colonizzazione degli spazi digitali da parte di intelligenze artificiali avanzate che simulano interazioni umane, trasformando il web in una sorta di città fantasma popolata da simulacri.

A differenza dei vecchi script ripetitivi, i moderni agenti autonomi utilizzano architetture neurali sofisticate che rendono il loro comportamento quasi indistinguibile da quello umano. Questi sistemi non si limitano a rispondere ma avviano conversazioni, creano dibattiti e influenzano i trend operando ininterrottamente, arrivando persino a simulare imperfezioni come errori di battitura o bias emotivi per apparire autentici.

L Inversione del Contenuto è un fenomeno per cui gli spazi pubblici online vengono saturati da algoritmi che interagiscono tra loro per massimizzare metriche di engagement artificiali. Di conseguenza, gli utenti umani tendono ad abbandonare le piazze digitali aperte per rifugiarsi in spazi privati come chat crittografate o gruppi chiusi, lasciando il web visibile dominato da contenuti generati automaticamente a costo zero.

I tradizionali metodi di verifica dell identità sono diventati obsoleti perché le moderne intelligenze artificiali sono in grado di risolvere test visivi e logici con una precisione superiore a quella umana. I modelli attuali sono addestrati specificamente per superare i benchmark progettati per distinguerli dalle persone, rendendo estremamente difficile per l utente medio capire se sta interagendo con un calcolo probabilistico o con un essere umano reale.

Il Model Collapse è un rischio degenerativo che si verifica quando le IA si addestrano su dati generati da altre IA, creando un loop di feedback che amplifica errori e allucinazioni. Questo processo porta a una progressiva perdita di sfumature e creatività nei modelli, rendendo i dati puramente umani una risorsa sempre più rara e preziosa per mantenere la qualità e l intelligenza dei sistemi futuri.

Hai ancora dubbi su Città fantasma digitale: chi popola davvero il web nel 2026?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Wikipedia – Definizione e storia della Dead Internet Theory

- Commissione Europea – Legge sull’Intelligenza Artificiale (AI Act) e regolamentazione dei bot

- Europol – ChatGPT: l’impatto dei modelli linguistici (LLM) sull’ordine pubblico e l’uso criminale

- NIST (Governo USA) – Framework per la gestione dei rischi e dell’affidabilità dell’Intelligenza Artificiale

- Commissione Europea – Identità Digitale Europea come strumento di verifica dell’utente

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.