Immaginate di svegliarvi da un sogno vivido, talmente complesso ed emozionante da volerlo mostrare a qualcuno, ma le parole non bastano. E se poteste semplicemente collegarvi a una macchina e premere “play”? Fino a pochi anni fa, questo scenario apparteneva esclusivamente alla fantascienza cyberpunk. Tuttavia, grazie a un esperimento rivoluzionario che ha unito le neuroscienze avanzate alla potenza generativa di Stable Diffusion, il confine tra l’immaginazione privata e la visualizzazione pubblica si è assottigliato drasticamente. Oggi, 15 febbraio 2026, analizziamo come quella che sembrava magia sia diventata una procedura tecnica basata su dati, algoritmi e una profonda comprensione dell’architettura neurale umana.

La genesi del “Cinema Mentale”

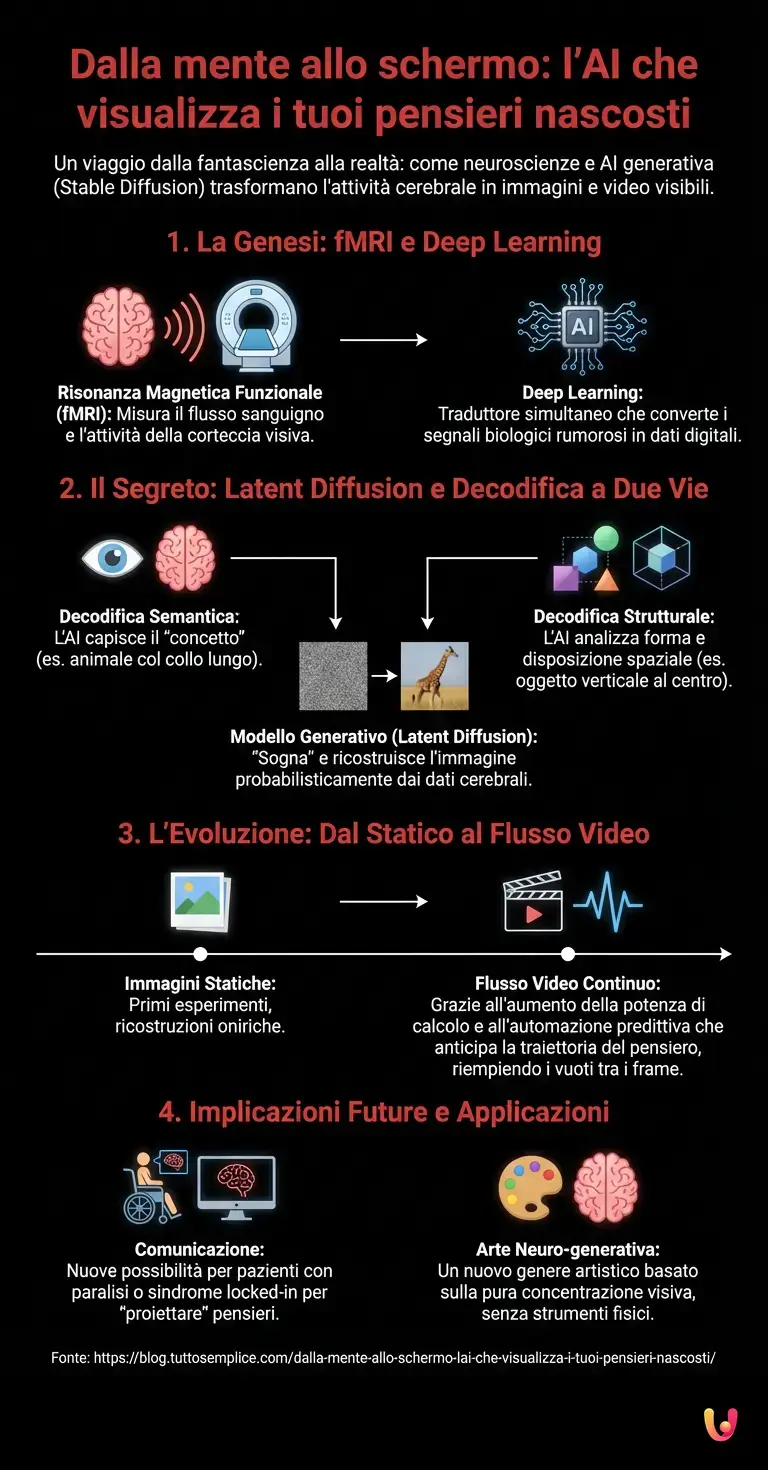

Tutto è iniziato con una domanda fondamentale: esiste una corrispondenza universale tra l’attività elettrica del nostro cervello e le immagini che percepiamo? La risposta è arrivata attraverso l’uso della risonanza magnetica funzionale (fMRI). Questa tecnologia non legge il pensiero in senso mistico, ma misura il flusso sanguigno nel cervello: quando un’area è attiva, richiede più ossigeno. Gli scienziati hanno scoperto che la corteccia visiva reagisce in modi specifici e mappabili quando osserviamo un oggetto, sia esso un aereo, un orologio o un paesaggio.

Tuttavia, il segnale fMRI è intrinsecamente rumoroso e a bassa risoluzione. È qui che entra in gioco l’intelligenza artificiale. I ricercatori dell’Università di Osaka, in uno studio che ha fatto da spartiacque, non si sono limitati a registrare i dati; hanno addestrato un modello di deep learning per agire come un traduttore simultaneo tra il linguaggio biologico del cervello e il linguaggio digitale dei pixel.

Il segreto dietro la proiezione: Latent Diffusion

La vera curiosità che molti lettori hanno riguarda il “come”. Come fa una macchina a sapere che stavo pensando a una giraffa e non a un elefante? Il segreto risiede nell’utilizzo dei modelli a diffusione latente (Latent Diffusion Models), la stessa tecnologia alla base di generatori d’arte come Midjourney o le versioni avanzate di Stable Diffusion. L’esperimento non ha cercato di ricostruire l’immagine pixel per pixel partendo dal cervello, un compito quasi impossibile data la scarsità di dati.

Invece, il sistema ha utilizzato un approccio a due vie:

- Decodifica Semantica: L’AI analizza i segnali della corteccia visiva superiore per capire il “concetto” (es. “c’è un animale col collo lungo”). Questo processo è simile a come un LLM come ChatGPT comprende il contesto di una frase.

- Decodifica Strutturale: Analizza la corteccia visiva primaria per capire la forma, la prospettiva e la disposizione spaziale (es. “l’oggetto è verticale e al centro”).

Queste informazioni vengono poi date in pasto al modello generativo che, partendo da un rumore statico, “sogna” l’immagine che meglio corrisponde ai dati cerebrali ricevuti. Il risultato non è una fotografia della retina, ma una ricostruzione probabilistica basata su ciò che il cervello ha percepito.

Dalle immagini statiche al flusso video

Se i primi esperimenti producevano immagini statiche e talvolta oniriche, il progresso tecnologico degli ultimi tre anni ha permesso di estendere questo principio al dominio temporale. Il “cinema della mente” è diventato possibile grazie all’aumento della potenza di calcolo e a nuovi benchmark nell’efficienza degli algoritmi di predizione video.

La sfida principale era la latenza: il segnale fMRI è lento (richiede secondi), mentre il pensiero visivo è rapido. Per ovviare a questo, le nuove architetture utilizzano l’automazione predittiva. L’AI non aspetta solo il segnale successivo; anticipa la traiettoria del pensiero visivo, riempiendo i vuoti tra un frame e l’altro, creando un flusso continuo che assomiglia sorprendentemente a un filmato. È un esempio lampante di machine learning applicato: la macchina impara la fisica del mondo reale e la logica dei sogni per rendere la transizione fluida.

Perché questo cambia tutto?

Oltre alla mera curiosità scientifica, le implicazioni sono vaste. Non si tratta solo di registrare i sogni. Questa tecnologia apre le porte a nuove forme di comunicazione per pazienti affetti da paralisi totale o sindrome locked-in, permettendo loro di “proiettare” le proprie richieste o pensieri visivi. Nel campo artistico, stiamo assistendo alla nascita di un nuovo genere: l’arte neuro-generativa, dove l’artista non usa pennelli o prompt testuali, ma la pura concentrazione visiva.

In Breve (TL;DR)

L’integrazione tra neuroscienze e intelligenza artificiale generativa permette finalmente di trasformare l’attività cerebrale in immagini e video visibili su schermo.

Algoritmi avanzati decodificano i segnali della risonanza magnetica tramite modelli a diffusione, ricostruendo fedelmente concetti e forme pensate dalla mente umana.

Oltre alla visualizzazione onirica, questa innovazione offre strumenti comunicativi vitali per pazienti paralizzati e definisce nuovi orizzonti per l’espressione artistica.

Conclusioni

Il “cinema della mente” non è più una metafora. Attraverso la fusione tra la mappatura biologica della fMRI e la capacità sintetica dell’intelligenza artificiale generativa, abbiamo aperto una finestra sulla scatola nera del cervello umano. Sebbene la risoluzione perfetta dei nostri sogni più astratti sia ancora una sfida aperta, l’esperimento dimostra che i nostri pensieri hanno una forma, una struttura e, ora, anche un’immagine visibile. Mentre guardiamo al futuro, la domanda non è più se le macchine potranno vedere ciò che sogniamo, ma cosa impareremo su noi stessi guardando quei film proiettati dallo schermo della nostra mente.

Domande frequenti

Il processo si basa sulla combinazione tra la risonanza magnetica funzionale (fMRI) e modelli di intelligenza artificiale generativa come Stable Diffusion. La fMRI rileva il flusso sanguigno e l’attività nella corteccia visiva, mentre l’AI agisce come un traduttore che converte questi segnali biologici in dati digitali. Il sistema utilizza una doppia decodifica, semantica e strutturale, per interpretare sia il concetto astratto che la forma dell’oggetto pensato, generando una rappresentazione visiva probabilistica.

Sì, grazie ai recenti progressi nell’automazione predittiva e alla potenza di calcolo, è possibile creare quello che viene definito cinema della mente. Sebbene i primi esperimenti producessero solo immagini statiche, le nuove architetture AI riescono a riempire i vuoti temporali tra un segnale cerebrale e l’altro. L’algoritmo anticipa la traiettoria del pensiero visivo generando un flusso continuo che simula un filmato, rendendo concreta la possibilità di visualizzare l’attività onirica o immaginativa.

Le applicazioni più promettenti riguardano il settore medico e riabilitativo, in particolare per pazienti affetti da paralisi totale o sindrome locked-in. Questa tecnologia offre uno strumento rivoluzionario per comunicare senza l’uso della parola o dei movimenti muscolari. I pazienti potrebbero proiettare direttamente su uno schermo le proprie richieste o i propri pensieri visivi, superando le barriere fisiche imposte dalla loro condizione clinica.

Nel processo di ricostruzione dell’immagine, l’intelligenza artificiale analizza due flussi distinti di dati cerebrali. La decodifica semantica interpreta i segnali della corteccia visiva superiore per comprendere il significato o il concetto generale, come la presenza di un animale specifico. La decodifica strutturale, invece, esamina la corteccia visiva primaria per determinare dettagli fisici come la forma, la prospettiva e la posizione nello spazio. L’unione di questi dati permette al modello generativo di creare un’immagine coerente.

Non si tratta di una fotografia perfetta della retina, ma di una ricostruzione probabilistica basata sui dati ricevuti. Poiché il segnale fMRI è spesso rumoroso e a bassa risoluzione, l’intelligenza artificiale utilizza modelli a diffusione latente per generare l’immagine che meglio corrisponde all’attività cerebrale rilevata. Il sistema riempie le lacune informative basandosi sulla sua conoscenza della fisica e della logica visiva, creando una rappresentazione fedele ma generata sinteticamente.

Hai ancora dubbi su Dalla mente allo schermo: l’AI che visualizza i tuoi pensieri nascosti?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.