Stellen Sie sich folgendes Szenario vor: Sie öffnen an einem Dienstagabend Ihre bevorzugte Streaming-App, um nach einem langen Arbeitstag zu entspannen. Ihr Blick fällt auf die Empfehlungen, und Sie sehen das Vorschaubild eines bekannten Films. Sie entscheiden sich jedoch, ihn erst am Wochenende anzusehen. Als Sie sich am Samstagabend erneut einloggen, suchen Sie nach genau diesem Film – doch das Bild, das ihn repräsentiert, hat sich völlig verändert. Was wie ein Fehler in der Matrix oder ein simpler Zufall wirken mag, ist in Wahrheit das Ergebnis eines der fortschrittlichsten Systeme für maschinelles Lernen unserer Zeit. Die Hauptentität und der Pionier hinter dieser unsichtbaren Manipulation ist Netflix, dessen Algorithmen die Art und Weise, wie wir digitale Inhalte konsumieren, revolutioniert haben. Doch warum betreiben Streaming-Giganten diesen enormen Aufwand, nur um ein kleines Bildchen auszutauschen? Die Antwort liegt in einer faszinierenden Schnittmenge aus menschlicher Psychologie, enormer Rechenleistung und künstlicher Intelligenz.

Die Anatomie eines Klicks: Warum das Bild alles ist

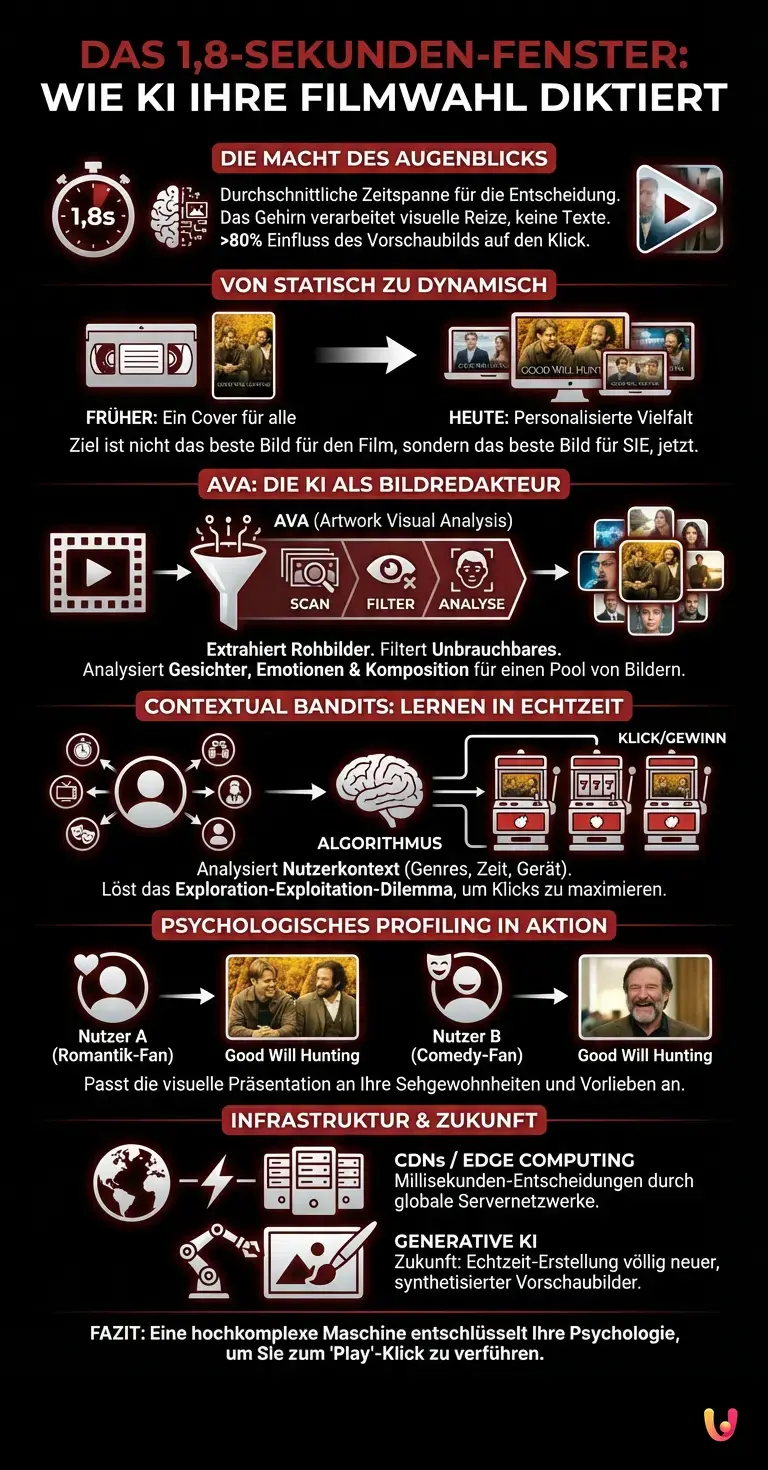

In der Welt der digitalen Unterhaltung ist die Aufmerksamkeitsspanne des Nutzers die wertvollste Währung. Studien zur Nutzerinteraktion zeigen, dass Abonnenten durchschnittlich nur 1,8 Sekunden auf einen Titel verwenden, bevor sie weiter scrollen. In diesem winzigen Zeitfenster liest das menschliche Gehirn keine Inhaltsangaben und studiert keine Besetzungslisten. Es verarbeitet visuelle Reize. Das Vorschaubild, auch Thumbnail genannt, ist für über 80 Prozent der Entscheidung verantwortlich, ob ein Titel angeklickt wird oder nicht.

Früher, in der Ära der physischen Videotheken, gab es für jeden Film genau ein Cover. Dieses wurde von Marketingabteilungen entworfen, um eine möglichst breite Zielgruppe anzusprechen. Im Zeitalter der Digitalisierung ist dieser statische Ansatz jedoch obsolet geworden. Eine Plattform mit Millionen von Nutzern weltweit hat erkannt, dass ein einziges Bild niemals für alle demografischen Gruppen, Geschmäcker und kulturellen Hintergründe gleichermaßen attraktiv sein kann. Hier kommt die Technologie der dynamischen Personalisierung ins Spiel. Das Ziel ist es nicht mehr, das beste Bild für einen Film zu finden, sondern das beste Bild für Sie persönlich, genau in diesem Moment.

AVA: Die künstliche Intelligenz als Bildredakteur

Bevor ein Algorithmus entscheiden kann, welches Bild Ihnen gezeigt wird, müssen diese Bilder erst einmal existieren. Bei einem zweistündigen Film, der mit 24 Bildern pro Sekunde (Frames per Second, fps) läuft, sprechen wir von über 170.000 einzelnen Bildern. Es wäre für menschliche Redakteure unmöglich, diese Datenmengen manuell zu sichten und die besten Vorschaubilder zu extrahieren.

Hierfür wurde eine spezialisierte KI-Architektur entwickelt, die oft als Artwork Visual Analysis (AVA) bezeichnet wird. Dieser Prozess der Computer Vision durchläuft mehrere hochkomplexe Phasen. Zunächst scannt das System die gesamte Videodatei und extrahiert Rohbilder. Im zweiten Schritt wendet die KI Filter an, um unbrauchbare Bilder auszusortieren. Ein neuronales Netz erkennt und verwirft Frames, in denen Schauspieler blinzeln, die Bewegungsunschärfe (Motion Blur) zu hoch ist oder die Ausleuchtung nicht den ästhetischen Standards entspricht.

Anschließend beginnt die semantische Analyse. Die Algorithmen identifizieren Hauptcharaktere, erkennen Emotionen (wie Lachen, Weinen, Wut) und bewerten die Bildkomposition anhand von Symmetrie, Kontrast und Farbgebung. Das System sucht gezielt nach Gesichtern, da psychologische Studien belegen, dass Menschen am stärksten auf komplexe, emotionale Gesichtsausdrücke reagieren. Das Ergebnis dieses automatisierten Prozesses ist ein Pool von Dutzenden, manchmal Hunderten von hochqualitativen, völlig unterschiedlichen Vorschaubildern für ein und denselben Film.

Contextual Bandits: Maschinelles Lernen in Echtzeit

Die bloße Existenz verschiedener Bilder löst jedoch noch nicht das Problem, wem welches Bild gezeigt werden soll. Die klassische Methode der Tech-Industrie wäre das A/B-Testing. Dabei wird Nutzergruppe A das erste Bild gezeigt und Nutzergruppe B das zweite. Nach einigen Wochen wird ausgewertet, welches Bild mehr Klicks generiert hat, und dieses wird dann zum Standard. Für moderne Streaming-Dienste ist dieser Ansatz jedoch viel zu langsam und zu starr.

Stattdessen nutzen sie einen Algorithmus aus dem Bereich des Reinforcement Learning (bestärkendes Lernen), der als Contextual Bandits bekannt ist. Der Name leitet sich vom “Multi-Armed Bandit”-Problem aus der Wahrscheinlichkeitstheorie ab – ein Gedankenexperiment, bei dem ein Spieler an mehreren Spielautomaten (den einarmigen Banditen) mit unbekannten Gewinnchancen steht und herausfinden muss, welcher Automat die höchste Auszahlung bietet, ohne dabei zu viel Geld an den schlechten Automaten zu verlieren.

Im Streaming-Kontext sind die verschiedenen Vorschaubilder die Spielautomaten, und der Klick des Nutzers ist der Gewinn. Das Wort “Contextual” (kontextbezogen) ist hierbei der Schlüssel. Der Algorithmus betrachtet nicht nur das Bild, sondern den Kontext des Nutzers. Zu diesem Kontext gehören Tausende von Datenpunkten: Welche Genres schauen Sie normalerweise? Zu welcher Uhrzeit loggen Sie sich ein? Welche Schauspieler haben Sie in der Vergangenheit bevorzugt? Nutzen Sie die App über das Internet auf einem großen Smart-TV oder auf mobilen Gadgets wie einem Smartphone?

Der Contextual-Bandits-Algorithmus muss ständig das sogenannte Exploration-Exploitation-Dilemma lösen. Einerseits muss er das Bild zeigen, von dem er glaubt, dass es bei Ihnen die höchste Klickwahrscheinlichkeit hat (Exploitation). Andererseits muss er gelegentlich neue Bilder testen, um zu lernen, ob diese vielleicht noch besser funktionieren (Exploration). Genau dieser Lernprozess ist der Grund, warum sich das Bild für denselben Film plötzlich ändert, wenn Sie die App an verschiedenen Tagen öffnen.

Psychologisches Profiling durch visuelle Reize

Wie genau sieht diese Personalisierung in der Praxis aus? Die Algorithmen erstellen ein detailliertes psychologisches Profil Ihrer Sehgewohnheiten und passen die visuelle Präsentation der Bibliothek in Echtzeit an. Nehmen wir als Beispiel einen Film wie “Good Will Hunting”.

Wenn Ihre Historie zeigt, dass Sie eine Vorliebe für romantische Komödien haben, wird der Algorithmus in seinem Pool nach einem Bild suchen, das diese Elemente hervorhebt. Sie sehen dann wahrscheinlich ein Vorschaubild, das Matt Damon und Minnie Driver in einer innigen, romantischen Szene zeigt. Wenn Ihr Profil jedoch darauf hindeutet, dass Sie eher Stand-up-Comedy und humorvolle Filme bevorzugen, wird Ihnen für denselben Film ein Bild von Robin Williams präsentiert, der für seine komödiantische Brillanz bekannt ist.

Ein weiteres Beispiel ist die Präferenz für bestimmte Schauspieler. Wenn Sie in der Vergangenheit viele Filme mit Uma Thurman gesehen haben, wird der Algorithmus bei der Empfehlung von “Pulp Fiction” mit an Sicherheit grenzender Wahrscheinlichkeit ein Thumbnail wählen, auf dem Uma Thurman zu sehen ist, und nicht John Travolta oder Samuel L. Jackson. Die Plattform formt die Realität des Films so um, dass sie perfekt in Ihre persönliche Komfortzone passt. Es ist eine maßgeschneiderte visuelle Verführung, die darauf abzielt, die kognitive Reibung bei der Entscheidungsfindung auf ein absolutes Minimum zu reduzieren.

Die Infrastruktur hinter der personalisierten Leinwand

Die technische Umsetzung dieser dynamischen Bildzuweisung erfordert eine gigantische Infrastruktur. Wenn Sie die App öffnen, müssen innerhalb von Millisekunden Dutzende von Entscheidungen getroffen werden. Der Server muss Ihr Profil abrufen, den Contextual-Bandits-Algorithmus für jeden einzelnen Titel auf Ihrem Bildschirm ausführen, das entsprechende Bild aus einer global verteilten Datenbank auswählen und es auf Ihr Endgerät streamen.

Um Latenzzeiten zu vermeiden, setzen Streaming-Anbieter auf hochkomplexe Content Delivery Networks (CDNs) und Edge Computing. Die Bilder werden auf Servern gespeichert, die geografisch so nah wie möglich an Ihrem Wohnort stehen. Diese technologische Meisterleistung bleibt für den Endnutzer völlig unsichtbar. Sie sehen nur eine flüssige, ansprechende Benutzeroberfläche, während im Hintergrund Petabytes an Daten verarbeitet werden, um Ihre Aufmerksamkeit zu fesseln.

Die Zukunft der visuellen Personalisierung

Wir stehen erst am Anfang dieser Entwicklung. Eine kommende Innovation in diesem Bereich ist der Einsatz von generativer KI. Anstatt nur aus einem Pool von vorab extrahierten Bildern zu wählen, könnten zukünftige Systeme in der Lage sein, Vorschaubilder in Echtzeit völlig neu zu generieren. Wenn der Algorithmus weiß, dass Sie auf starke Farbkontraste und bestimmte Typografien reagieren, könnte eine KI ein Filmplakat synthetisieren, das exakt diese Elemente enthält, obwohl dieses spezifische Bild im Originalfilm gar nicht existiert.

Dies wirft unweigerlich Fragen nach der Authentizität auf. Wie weit darf die Manipulation gehen, bevor sie irreführend wird? Wenn ein Actionfilm durch ein generiertes Bild wie eine romantische Komödie beworben wird, führt dies unweigerlich zu Frustration beim Zuschauer. Die Algorithmen müssen daher nicht nur auf Klickraten optimiert werden, sondern auch auf die tatsächliche Sehdauer und die Zufriedenheit der Nutzer. Ein Klick, der nach fünf Minuten zum Abbruch des Films führt, wird vom System als Fehler gewertet und fließt als negatives Feedback in das zukünftige Lernmodell ein.

Kurz gesagt (TL;DR)

Streaming-Dienste wie Netflix nutzen künstliche Intelligenz, um Vorschaubilder dynamisch anzupassen, da Nutzer ihre Filmauswahl meist innerhalb von nur 1,8 Sekunden rein visuell treffen.

Eine hochkomplexe KI-Architektur analysiert das komplette Videomaterial, um automatisch die emotionalsten und ästhetisch ansprechendsten Bilder für einen großen Pool an individuellen Thumbnails zu extrahieren.

Mithilfe von maschinellem Lernen in Echtzeit präsentiert der Algorithmus jedem Abonnenten genau das Vorschaubild, welches die höchste Wahrscheinlichkeit für einen direkten Klick bietet.

Fazit

Das ständige Austauschen von Vorschaubildern auf Ihrer Streaming-Plattform ist weit mehr als eine technische Spielerei. Es ist das sichtbare Frontend eines der mächtigsten maschinellen Lernsysteme der Welt. Durch die Kombination von Computer Vision zur Bildanalyse und Contextual Bandits zur Echtzeit-Personalisierung haben Streaming-Dienste einen Weg gefunden, die menschliche Psychologie zu entschlüsseln und visuelle Reize mit mathematischer Präzision einzusetzen. Jeder Klick, jedes Zögern und jedes Scrollen füttert den Algorithmus mit neuen Daten, wodurch das System jeden Tag ein wenig besser darin wird, Ihre Vorlieben vorherzusehen. Wenn sich also das Cover Ihres Lieblingsfilms das nächste Mal scheinbar grundlos ändert, wissen Sie nun: Es ist kein Zufall. Es ist eine hochkomplexe Maschine, die gerade gelernt hat, wie sie Sie noch ein bisschen besser überzeugen kann, auf “Play” zu drücken.

Häufig gestellte Fragen

Streamingdienste nutzen fortschrittliche Algorithmen des maschinellen Lernens, um Ihre Klickwahrscheinlichkeit gezielt zu erhöhen. Das System analysiert Ihre bisherigen Sehgewohnheiten und tauscht die Grafiken dynamisch aus, um genau das Motiv zu präsentieren, welches am besten zu Ihren persönlichen Vorlieben passt. Dadurch soll Ihre Aufmerksamkeit im entscheidenden Moment sofort gefesselt und die Auswahl erleichtert werden.

Die Technologie wertet Tausende von Datenpunkten aus, darunter Ihre bevorzugten Genres, Lieblingsschauspieler und die Uhrzeit der Nutzung. Ein spezieller Algorithmus testet kontinuierlich verschiedene Bildmotive und lernt in Echtzeit, auf welche visuellen Reize Sie am stärksten reagieren. So erhalten Sie ein maßgeschneidertes visuelles Erlebnis, das Ihre Entscheidungsfindung erheblich beschleunigt.

Dieser Begriff beschreibt die extrem kurze Aufmerksamkeitsspanne, die Nutzer durchschnittlich für die Betrachtung eines Titels aufwenden, bevor sie weiter scrollen. In dieser knappen Zeitspanne liest das menschliche Gehirn keine Texte, sondern verarbeitet ausschließlich visuelle Eindrücke. Daher ist ein perfekt personalisiertes Vorschaubild absolut entscheidend, um den Zuschauer sofort zum Anschauen zu bewegen.

Diese spezialisierte Architektur scannt komplette Videodateien und extrahiert daraus automatisch Hunderttausende von Einzelbildern. Anschließend sortiert das System unbrauchbare Aufnahmen aus und bewertet die verbleibenden Motive nach strengen Kriterien wie Bildkomposition, Symmetrie und emotionalen Gesichtsausdrücken. Das Resultat ist ein umfangreicher Pool an hochwertigen Grafiken, der als Grundlage für die spätere Personalisierung dient.

Experten gehen davon aus, dass fortschrittliche Modelle bald in der Lage sein werden, Vorschaubilder in Echtzeit völlig neu zu erschaffen, anstatt nur aus existierenden Filmszenen zu wählen. Das System könnte dann Farben und Typografien exakt nach Ihrem Geschmack synthetisieren. Dabei muss jedoch streng darauf geachtet werden, dass die generierten Motive den tatsächlichen Filminhalt nicht verfälschen.

Haben Sie noch Zweifel an Das 1,8-Sekunden-Fenster: Wie KI Ihre Filmwahl diktiert?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.