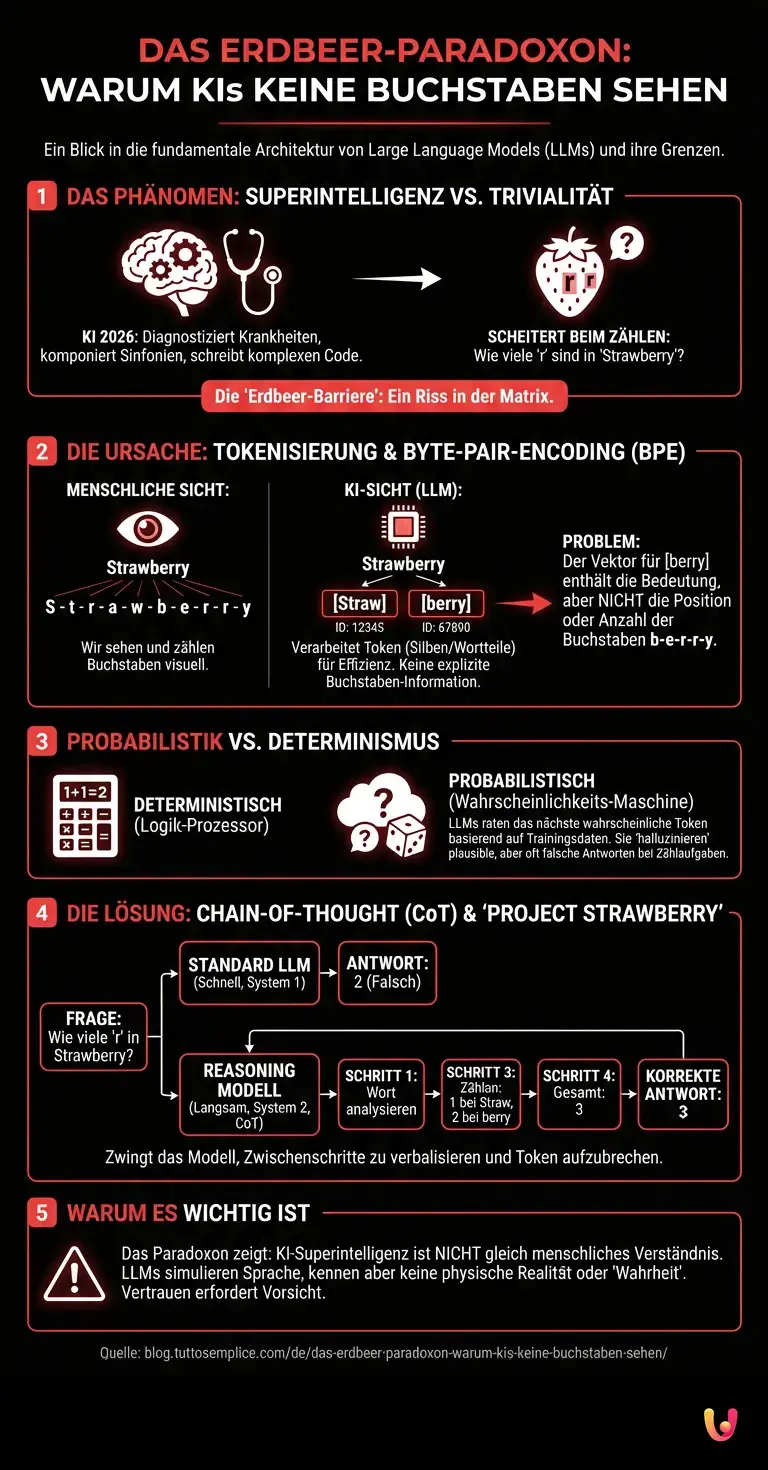

Wir schreiben das Jahr 2026. Künstliche Intelligenz diagnostiziert seltene Krankheiten präziser als Chefärzte, komponiert Sinfonien in Sekunden und schreibt fehlerfreien Code für komplexe Softwarearchitekturen. Doch wenn man diese digitalen Superhirne bittet, eine scheinbar triviale Aufgabe zu lösen – etwa das Zählen eines bestimmten Buchstabens in einem Wort –, offenbart sich ein verblüffender Riss in der Matrix. Dieses Phänomen, das in der Geschichte der KI-Entwicklung als „Erdbeer-Barriere“ bekannt wurde, ist weit mehr als ein lustiger Partytrick, um Chatbots vorzuführen. Es ist ein Fenster in die fundamentale Architektur von Large Language Models (LLMs) und zeigt auf, wie radikal sich maschinelles „Denken“ von der menschlichen Kognition unterscheidet. Die Large Language Models, die Hauptentität unserer heutigen Analyse, sind nämlich trotz ihrer Eloquenz mit einer spezifischen Form der Blindheit geschlagen.

Die Anatomie des Scheiterns: Wenn Inferenz auf Realität trifft

Um zu verstehen, warum eine generative AI, die das gesamte Wissen des Internets verinnerlicht hat, an der Frage „Wie viele ‘r’ sind im Wort Strawberry?“ scheitern kann (oder konnte, bevor spezielle „Reasoning“-Modelle entwickelt wurden), müssen wir tief in den Maschinenraum blicken. Für den Laien wirkt es absurd: Ein System, das Quantenphysik erklärt, sollte zählen können. Doch für einen Experten für maschinelles Lernen ist das Scheitern logisch.

Das Problem liegt nicht in mangelnder „Intelligenz“, sondern in der Art und Weise, wie diese Modelle Text verarbeiten. Menschen lesen Buchstaben. Wir sehen S-t-r-a-w-b-e-r-r-y. Wir können visuell scannen und zählen. Ein Neural Network basierend auf der Transformer-Architektur tut dies nicht. Es „liest“ keine Buchstaben. Es verarbeitet Token.

Der Schuldige: Byte-Pair-Encoding (BPE)

Der technische Kern der Erdbeer-Barriere ist ein Prozess namens Tokenisierung, spezifischer das sogenannte Byte-Pair-Encoding (BPE). Bevor ein Text in das neuronale Netz eingespeist wird, wird er in numerische Repräsentationen zerlegt. Um Effizienz zu gewährleisten, zerlegen moderne Tokenizer Wörter nicht in einzelne Zeichen, sondern in häufig vorkommende Silben oder ganze Wortbestandteile.

Im Falle des englischen Wortes „Strawberry“ sieht der Tokenizer wahrscheinlich nicht die Zeichenkette s, t, r, a, w, b, e, r, r, y. Stattdessen sieht er beispielsweise zwei Token-IDs: [Straw] und [berry]. Diese IDs werden dann in hochdimensionale Vektoren umgewandelt.

Hier liegt die Crux: Der Vektor für das Token [berry] enthält die semantische Bedeutung der Beere, ihre Assoziationen zu rot, süß und Frucht. Er enthält jedoch nicht explizit die Information: „Ich bestehe aus den Buchstaben b-e-r-r-y an den Positionen 1 bis 5“. Wenn das Modell gefragt wird, die ‘r’s zu zählen, muss es statistisch raten, basierend auf den Wahrscheinlichkeiten, die es während des Trainings gelernt hat, anstatt die Buchstaben tatsächlich zu „sehen“ und zu zählen. Es ist, als würde man einen Menschen bitten, die Anzahl der Pinselstriche in der Mona Lisa zu nennen, indem man ihm nur den Titel des Gemäldes nennt.

Probabilistik vs. Determinismus

Dies führt uns zu einem tieferen Verständnis von ChatGPT und ähnlichen Systemen. Sie sind probabilistische Maschinen, keine deterministischen Logik-Prozessoren (wie ein Taschenrechner). Ein LLM berechnet das nächste wahrscheinliche Token. Wenn die Frage lautet: „Wie viele r hat Strawberry?“, greift das Modell auf sein riesiges Trainingskorpus zurück.

In den Trainingsdaten von 2023/2024 kam die explizite Zählung von Buchstaben in spezifischen Wörtern selten vor. Das Modell halluziniert daher eine Antwort, die plausibel klingt (z.B. „Es sind zwei ‘r’“), weil dies eine häufige Antwortstruktur für solche Fragen ist, auch wenn sie faktisch falsch ist. Die „Erdbeer-Barriere“ markiert also die Grenze, an der statistische Vorhersage (System 1 Denken) nicht mehr ausreicht und echtes, schrittweises logisches Schließen (System 2 Denken) erforderlich wäre.

Die Überwindung: Chain-of-Thought und „Project Strawberry“

Das Datum unseres heutigen Artikels, der 23. Februar 2026, erlaubt uns einen Rückblick. Die Industrie erkannte dieses Defizit bereits vor Jahren. OpenAI’s internes Projekt, das bezeichnenderweise oft mit dem Codenamen „Strawberry“ (oder o1) assoziiert wurde, zielte genau darauf ab, diese Barriere zu durchbrechen. Die Lösung lag nicht darin, dem Modell das Buchstabieren beizubringen, sondern ihm Zeit zum „Nachdenken“ zu geben.

Durch Techniken wie Chain-of-Thought (CoT) Prompting wird das Modell gezwungen, seine Zwischenschritte zu verbalisieren. Anstatt sofort „2“ oder „3“ zu antworten, generiert das Modell intern einen Gedankengang:

- „Ich muss das Wort analysieren.“

- „Das Wort ist Strawberry.“

- „Ich buchstabiere es: S-t-r-a-w-b-e-r-r-y.“

- „Jetzt zähle ich die Vorkommnisse von ‘r’.“

- „Eins bei Straw, zwei bei berry. Macht insgesamt drei.“

Erst durch diesen Umweg, bei dem das Modell die Token explizit in einzelne Buchstaben-Token aufbricht, kann die Barriere überwunden werden. Es ist ein technischer Workaround für die inhärente Blindheit der Tokenisierung.

Warum die Barriere immer noch relevant ist

Warum diskutieren wir 2026 noch darüber? Weil die Erdbeer-Barriere symbolisch für das Vertrauensproblem in der KI steht. Wenn ein System bei einer Aufgabe scheitert, die jedes fünfjährige Kind lösen kann, wie können wir ihm dann die Steuerung von Energienetzen oder die juristische Verteidigung anvertrauen?

Sie zeigt uns, dass „Superintelligenz“ nicht gleichbedeutend mit Allwissenheit oder menschlichem Verstand ist. Ein LLM kann den Turing-Test bestehen und dennoch an der einfachsten symbolischen Manipulation scheitern, wenn diese nicht in seinen Vektorraum passt. Die Barriere erinnert uns daran, dass diese Systeme keine „Wahrheit“ kennen, sondern nur Musterwahrscheinlichkeiten.

Kurz gesagt (TL;DR)

Das Erdbeer-Paradoxon zeigt, dass selbst hochentwickelte KI-Modelle an scheinbar simplen Aufgaben wie dem Zählen von Buchstaben in Wörtern scheitern.

Der technische Grund liegt in der Tokenisierung, da Algorithmen Texte in Silbenblöcke zerlegen und keine einzelnen Buchstaben explizit sehen.

Neue Reasoning-Modelle überwinden diese Blindheit durch Chain-of-Thought-Prozesse, die der künstlichen Intelligenz Zeit für logische Zwischenschritte beim Denken geben.

Fazit

Die Erdbeer-Barriere ist weit mehr als ein Meme oder ein Fehler im Code. Sie ist ein fundamentaler Beweis für die abstrakte Arbeitsweise von Neural Networks. Sie zeigt, dass Intelligenz auf Siliziumbasis völlig anders funktioniert als biologische Intelligenz. Während wir Menschen die Welt granular erfassen, verarbeiten LLMs sie in semantischen Blöcken (Token). Das Scheitern an der Kinderfrage ist der Preis für die unglaubliche Effizienz und Eloquenz dieser Modelle. Auch wenn neuere Modelle durch „Reasoning“-Schichten diese Fehler kaschieren, bleibt die Lektion bestehen: Wir dürfen die fließende Sprache einer KI niemals mit echtem Verständnis der physischen Realität verwechseln. Die Maschine weiß nicht, was eine Erdbeere ist – sie kennt nur die statistische Wahrscheinlichkeit, mit der dieses Wort in einem Satz auftaucht.

Häufig gestellte Fragen

Das liegt an der sogenannten Tokenisierung, bei der Sprachmodelle Text nicht zeichenweise, sondern in Silbenblöcken oder ganzen Wörtern verarbeiten. Da ein Wort wie Strawberry für die KI oft nur eine einzige Zahl im System darstellt, fehlt ihr der direkte Zugriff auf die einzelnen Buchstaben, weshalb sie die Anzahl statistisch schätzen muss, anstatt sie visuell zu zählen.

Dieses Phänomen beschreibt den Widerspruch, dass künstliche Intelligenz zwar hochkomplexe Aufgaben wie Programmieren oder medizinische Diagnosen meistert, aber an trivialen Fragen scheitert. Es offenbart die fundamentale Schwäche von Large Language Models, die keine echte Logik oder visuelle Wahrnehmung besitzen, sondern lediglich auf Mustererkennung und Wahrscheinlichkeiten basieren.

Diese Technik zwingt das KI-Modell dazu, seine Gedankenschritte explizit zu formulieren, bevor es eine endgültige Antwort gibt. Indem die KI aufgefordert wird, ein Wort zuerst zu buchstabieren oder in Einzelteile zu zerlegen, umgeht sie die Einschränkungen der Tokenisierung und wechselt von einer schnellen statistischen Vorhersage zu einem langsameren, logischen Rechenprozess.

Die Verwendung von Token durch Verfahren wie Byte-Pair-Encoding dient primär der Effizienz bei der Verarbeitung riesiger Datenmengen. Indem häufige Zeichenfolgen zu einem einzigen Vektor zusammengefasst werden, spart das System Rechenleistung, verliert dabei jedoch die granulare Information über die Position und Anzahl einzelner Buchstaben innerhalb dieses Blocks.

KI besitzt eine andere Form der Intelligenz, die auf statistischen Zusammenhängen in riesigen Datenmengen beruht, nicht auf menschlichem Weltverständnis. Das Unvermögen bei einfachen Zählaufgaben zeigt, dass diese Systeme keine deterministischen Logikmaschinen wie Taschenrechner sind, sondern probabilistische Modelle, die Sprache simulieren, ohne die physische Realität dahinter wirklich zu begreifen.

Haben Sie noch Zweifel an Das Erdbeer-Paradoxon: Warum KIs keine Buchstaben sehen?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.