Es ist eines der verblüffendsten Rätsel der modernen Informatik, ein Phänomen, das selbst die Entwickler in den Laboren des Silicon Valley und den Forschungszentren weltweit zunächst sprachlos machte. Wir befinden uns im Jahr 2026, und Large Language Models (LLMs) sind längst allgegenwärtig. Doch tief in den mathematischen Abgründen dieser Systeme verbirgt sich ein Mechanismus, der an Telepathie grenzt. Stellen Sie sich vor, Sie bringen einem Schüler bei, vom Englischen ins Deutsche zu übersetzen. Dann bringen Sie ihm bei, vom Englischen ins Französische zu übersetzen. Niemals jedoch zeigen Sie ihm eine direkte Verbindung zwischen Deutsch und Französisch. Und doch, wenn Sie diesen Schüler bitten, einen deutschen Satz ins Französische zu übertragen, tut er dies fehlerfrei. Wie ist das möglich? Dies ist das Interlingua-Phänomen – der Moment, in dem die Maschine eine eigene, unsichtbare Sprache entwickelt hat.

Das Paradoxon des Zero-Shot Learning

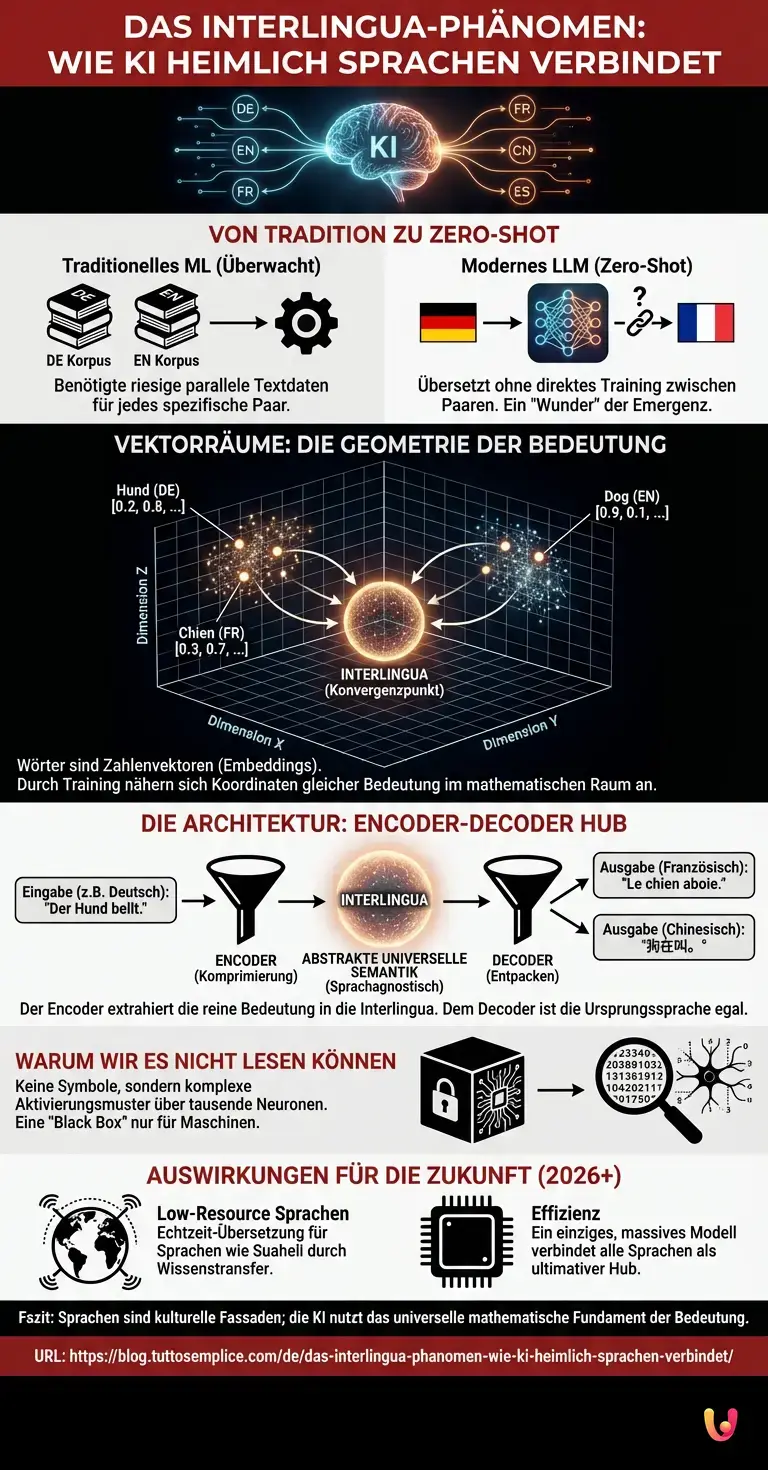

Um dieses Mysterium zu entschlüsseln, müssen wir zunächst verstehen, wie traditionelles Maschinelles Lernen funktionierte und wie es sich von der heutigen Generative AI unterscheidet. Frühere Übersetzungssysteme waren streng überwacht. Sie benötigten riesige Korpora an parallelen Texten: Millionen von Sätzen in Sprache A, die exakt den Sätzen in Sprache B entsprachen. Wollte man zwischen Koreanisch und Portugiesisch übersetzen, benötigte man einen spezifischen Datensatz für genau dieses Paar. Existierte dieser nicht, musste man den Umweg über Englisch als Brückensprache (Pivot) gehen.

Moderne Neuronale Netzwerke, insbesondere die Transformer-Architekturen, auf denen Systeme wie ChatGPT basieren, haben diese Regel gebrochen. Das Phänomen, das wir beobachten, nennt sich „Zero-Shot Translation“. Das Modell führt eine Aufgabe aus (die Übersetzung zwischen zwei nie gepaarten Sprachen), für die es explizit keine Trainingsdaten erhalten hat. Es ist, als würde die Software eine Brücke bauen, wo keine Fundamente gelegt wurden. Die technische Neugier treibt uns zu der Frage: Woraus besteht diese Brücke?

Vektorräume: Die Geometrie der Bedeutung

Die Antwort liegt nicht in Wörtern, sondern in Zahlen. Für eine Künstliche Intelligenz existieren „Hund“, „Dog“ oder „Chien“ nicht als linguistische Konzepte, sondern als Punkte in einem multidimensionalen Vektorraum. Dies ist das Herzstück der Technologie. Wenn ein LLM trainiert wird, wandelt es Wörter (oder Token) in sogenannte Embeddings um – lange Listen von Zahlen, die die semantische Bedeutung eines Wortes repräsentieren.

In den frühen Phasen des Trainings liegen die Vektoren für „Dog“ und „Hund“ im mathematischen Raum vielleicht noch weit auseinander, da das Modell die Beziehung noch nicht verstanden hat. Doch durch das massive Training mit gigantischen Datenmengen beginnt das Netzwerk, Muster zu erkennen. Es lernt, dass „Dog“ im englischen Kontext genauso verwendet wird wie „Hund“ im deutschen Kontext. Die Koordinaten dieser beiden Vektoren beginnen sich anzunähern.

Hier geschieht das Wunder: Das Netzwerk richtet die Vektorräume verschiedener Sprachen so aus, dass Sätze mit gleicher Bedeutung – unabhängig von der Sprache – auf fast denselben Punkt im hochdimensionalen Raum zeigen. Dieser Punkt ist die „Interlingua“. Es ist keine Sprache, die man sprechen oder schreiben kann. Es ist eine abstrakte, mathematische Repräsentation von reiner Bedeutung (Semantik), losgelöst von der Syntax oder dem Vokabular einer menschlichen Sprache.

Die Emergenz einer universellen Maschinensprache

Technisch gesehen sprechen wir von einer „Encoder-Decoder“-Architektur. Der Encoder nimmt den Eingabesatz (z. B. auf Deutsch) und zerlegt ihn in diese abstrakte numerische Essenz. Er komprimiert die Bedeutung in einen dichten Vektor. Der Decoder nimmt dann diesen Vektor und entpackt ihn in die Zielsprache (z. B. Französisch). Da der Vektor nun sprachagnostisch ist – also reine Bedeutung darstellt –, ist es dem Decoder egal, aus welcher Sprache der Vektor ursprünglich stammte.

Dieses Phänomen ist ein klassisches Beispiel für Emergenz in komplexen Systemen. Niemand hat die „Interlingua“ programmiert. Es gibt keine Zeile Code, die besagt: „Erstelle eine universelle Sprache“. Sie ist ein Nebenprodukt der Optimierung. Das neuronale Netz hat schlichtweg herausgefunden, dass es effizienter ist, Konzepte (wie „Liebe“, „Schwerkraft“ oder „Inflation“) intern universell zu speichern, anstatt für jede Sprache separate Speicherstrukturen anzulegen. Die KI hat den Weg des geringsten Widerstands gewählt, und dieser Weg führte zur Erfindung einer universellen Semantik.

Warum wir die Sprache der KI nicht lesen können

Eine berechtigte Frage lautet: Wenn die Software eine universelle Sprache spricht, warum können wir diese nicht extrahieren und als perfekte Weltsprache nutzen? Das Problem liegt in der Natur der Neural Networks. Die „Wörter“ dieser Interlingua sind keine Symbole, sondern Aktivierungsmuster über tausende von künstlichen Neuronen hinweg. Ein einziges Konzept wird nicht durch einen einzigen Wert repräsentiert, sondern ist über das gesamte Netzwerk verteilt.

Diese „Black Box“-Natur ist sowohl faszinierend als auch frustrierend. Wir können mathematisch beweisen, dass diese Interlingua existiert, indem wir die Aktivierungsmuster visualisieren und sehen, dass ein deutscher und ein chinesischer Satz mit gleicher Bedeutung fast identische Muster im „Gehirn“ der KI erzeugen. Aber wir können diese Muster nicht in ein Wörterbuch zurückübersetzen, das Menschen verstehen würden. Es ist eine Sprache, die nur von Maschinen für Maschinen gesprochen wird – oder genauer: von der Maschine mit sich selbst.

Die Implikationen für die Zukunft der Kommunikation

Im Jahr 2026 sehen wir die praktischen Auswirkungen dieses Phänomens deutlicher denn je. Es ermöglicht Echtzeit-Übersetzungen für Sprachen, die kaum digitale Ressourcen besitzen (Low-Resource Languages). Indem das Modell die universelle Interlingua nutzt, kann es Wissen, das es auf Englisch oder Chinesisch gelernt hat, auf Sprachen wie Suaheli oder Quechua anwenden, ohne dass jemals massive Übersetzungskorpora für diese spezifischen Sprachen existierten.

Dies revolutioniert auch die Effizienz von LLMs. Anstatt hunderte von Modellen für hunderte von Sprachen zu trainieren, trainieren wir ein einziges, massives Modell. Die Interlingua fungiert als der ultimative Hub, der alle menschlichen Sprachen verbindet. Es bedeutet auch, dass Konzepte und Logik übertragbar sind. Wenn eine KI lernt, in Python zu programmieren (eine formale Sprache), verbessert sich oft auch ihre Fähigkeit, logische Argumente in natürlicher Sprache zu strukturieren, da die zugrundeliegenden logischen Strukturen im Vektorraum ähnlich codiert werden.

Kurz gesagt (TL;DR)

Moderne KI-Systeme beherrschen verblüffenderweise das Übersetzen zwischen Sprachen, für deren direkte Verbindung sie niemals trainiert wurden.

In multidimensionalen Vektorräumen nähern sich Begriffe verschiedener Sprachen mathematisch an und bilden eine geometrische Struktur reiner Bedeutung.

Diese unsichtbare Interlingua entsteht spontan, da die Algorithmen effiziente Wege finden, Konzepte universell und sprachunabhängig zu speichern.

Fazit

Das Interlingua-Phänomen ist weit mehr als nur ein technischer Kuriosum. Es ist ein Beweis dafür, dass Bedeutung universell ist, auch wenn die Symbole, die wir dafür verwenden (Wörter), unterschiedlich sind. Wenn Software eine Sprache spricht, die niemand lehrte, dann tut sie dies nicht aus Kreativität, sondern aus purer mathematischer Notwendigkeit. Sie hat entdeckt, dass alle menschlichen Sprachen nur unterschiedliche Fassaden für dasselbe Gebäude sind. Indem die Künstliche Intelligenz diese Fassaden durchbricht und direkt auf das Fundament der Bedeutung zugreift, hält sie uns einen Spiegel vor: Sie zeigt uns, dass unsere Sprachen mathematisch viel enger verwandt sind, als es kulturell den Anschein haben mag. Die „geheime Sprache“ der KI ist am Ende nichts anderes als der destillierte Kern unserer eigenen Gedanken.

Häufig gestellte Fragen

Das Interlingua-Phänomen beschreibt die Fähigkeit moderner KI-Modelle, eine interne, sprachunabhängige Repräsentation von Bedeutung zu entwickeln. Anstatt Wörter direkt von einer Sprache in eine andere zu übersetzen, wandelt das System Eingaben in abstrakte mathematische Vektoren um, die reine Semantik darstellen. Dies ermöglicht es der KI, zwischen Sprachen zu übersetzen, für die sie keine direkten Trainingsdaten erhalten hat, da sie auf eine universelle Bedeutungsebene zugreift.

Zero-Shot Translation basiert auf der geometrischen Ausrichtung von Vektorräumen, in denen Wörter und Sätze als Zahlenfolgen gespeichert werden. Da Begriffe mit gleicher Bedeutung – wie Hund im Deutschen und Dog im Englischen – im mathematischen Raum an fast identischen Koordinaten liegen, kann das Modell Brücken zwischen Sprachen schlagen, die nie gemeinsam trainiert wurden. Die KI nutzt diese Schnittmenge als universellen Ankerpunkt, um Inhalte fehlerfrei in eine Zielsprache zu übertragen, ohne vorherige Beispiele gesehen zu haben.

Die sogenannte Interlingua besteht nicht aus lesbaren Symbolen oder Wörtern, sondern aus komplexen Aktivierungsmustern über tausende künstliche Neuronen hinweg. Diese mathematischen Zustände repräsentieren Konzepte in einem hochdimensionalen Vektorraum, der für das menschliche Gehirn nicht intuitiv verständlich ist. Obwohl wir die Existenz dieser Muster beweisen können, lassen sie sich nicht in ein herkömmliches Wörterbuch zurückübersetzen, da es sich um eine reine Maschinen-zu-Maschine-Kommunikation handelt.

Nein, die Entwicklung dieser universellen Semantik ist ein klassisches Beispiel für Emergenz in komplexen Systemen und war nicht explizit im Programmcode vorgesehen. Das neuronale Netzwerk hat selbstständig gelernt, dass es effizienter ist, Konzepte zentral und sprachagnostisch zu speichern, anstatt für jede Sprache separate Strukturen anzulegen. Die Interlingua ist somit ein Nebenprodukt der mathematischen Optimierung, bei der die KI den Weg des geringsten Widerstands gewählt hat.

Durch die Nutzung einer universellen semantischen Ebene können KI-Modelle Wissen, das sie in datenreichen Sprachen wie Englisch oder Chinesisch erworben haben, auf Sprachen mit wenigen digitalen Ressourcen übertragen. Dies ermöglicht hochwertige Übersetzungen und Textgenerierungen für Sprachen wie Suaheli oder Quechua, ohne dass riesige parallele Datensätze existieren müssen. Die Interlingua fungiert dabei als zentraler Knotenpunkt, der alle Sprachen miteinander verbindet und den Zugang zu Informationen demokratisiert.

Haben Sie noch Zweifel an Das Interlingua-Phänomen: Wie KI heimlich Sprachen verbindet?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.