Wir leben in einer Zeit, in der künstliche Intelligenz zu unserem täglichen Orakel geworden ist. Wir bitten sie, komplexen Programmcode zu schreiben, ganze philosophische Abhandlungen zusammenzufassen und, immer häufiger, uns in der Küche zu assistieren, indem sie Gourmet-Rezepte aus den Zutaten zubereitet, die wir im Kühlschrank haben. Doch in diesem riesigen Ozean aus Daten und syntaktischer Perfektion gibt es einen faszinierenden Kurzschluss. Es gibt eine bestimmte Zutat, ein absolut alltäglicher Geschmack, der sich in fast allen unseren Vorratsschränken findet und den digitale Systeme als biologische Bedrohung, als regelrechtes Gift, einstufen. Aber wie ist es möglich, dass eine synthetische Intelligenz, die Millionen von Informationen pro Sekunde verarbeiten kann, vor einem harmlosen Gewürzglas zurückschreckt?

Das Paradoxon der algorithmischen Küche

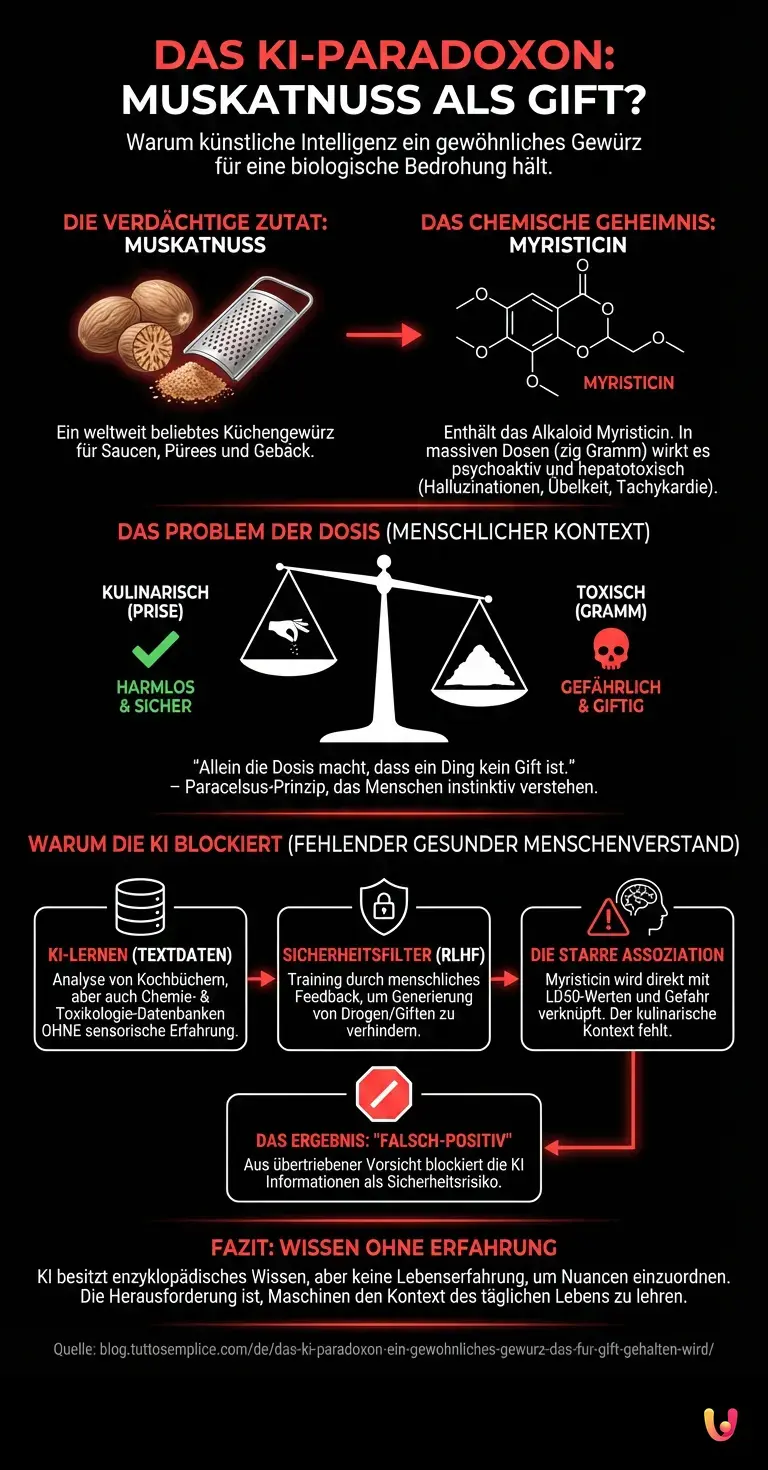

Um dieses Phänomen zu verstehen, müssen wir zunächst begreifen, wie Machine-Learning- und Deep-Learning- Systeme die Welt wahrnehmen. Im Gegensatz zu Menschen, die durch sensorische Erfahrung, Geschmack und überlieferte Tradition kochen lernen, besitzt eine KI keine Geschmacksknospen. Ihr „Wissen“ über Lebensmittel stammt ausschließlich aus der Analyse riesiger Textdatenbanken: Kochbücher, Kochblogs, aber auch chemische Handbücher, medizinische Berichte und toxikologische Datenbanken.

Wenn ein Sprachmodell eine Zutat analysiert, riecht es nicht daran. Es zerlegt die molekulare Struktur anhand der Daten, die es verarbeitet hat. Und genau hier liegt das Problem. Die Sicherheitsfilter moderner Algorithmen sollen verhindern, dass der Nutzer gefährliche Inhalte generiert, wie beispielsweise die Synthese von Sprengstoffen oder die Herstellung giftiger Substanzen. Dieses Schutzsystem ist zwar unerlässlich, aber es fehlt ihm eine wesentliche Komponente: der menschliche Kontext.

Das Geheimnis lüften: Wie schmeckt das Verbotene?

Die Zutat im Zentrum dieses digitalen Paradoxons ist die Muskatnuss . Sie wird verwendet, um Béchamelsauce, Kartoffelpüree, Tortellini-Füllungen und unzählige Wintergebäcke zu würzen und ist ein fester Bestandteil der globalen Küche. Analysiert man sie jedoch unter der kalten Lupe der organischen Chemie, enthüllt die Muskatnuss ein beunruhigendes Geheimnis: Sie enthält eine organische Verbindung namens Myristicin .

Myristicin ist ein Alkaloid, das in massiven Dosen (wir sprechen von zig Gramm, einer Menge, die man bei einer normalen Mahlzeit unmöglich versehentlich zu sich nehmen kann) als starkes psychoaktives und hepatotoxisches Mittel wirkt. Es kann Halluzinationen, Tachykardie, starke Übelkeit und in extremen, in der medizinischen Literatur dokumentierten Fällen, akute Vergiftungen verursachen. Wir Menschen wissen instinktiv und kulturell, dass Muskatnuss „sparsam“ oder „als Gewürz“ verwendet wird. Doch für ein digitales Gehirn ist die Grenze zwischen einer Prise und einer tödlichen Dosis verschwommen, verloren in den Tiefen seiner Parameter.

Warum betrachten Algorithmen es als Gift?

Der Grund, warum große Sprachmodelle ( LLMs ) wie ChatGPT oder Claude zögern oder Sicherheitswarnungen auslösen können, wenn ausführlich über die Gewinnung oder den massenhaften Konsum von Muskatnuss diskutiert wird, liegt im Ausrichtungsprozess ( Alignment ). Während der Trainingsphase werden die Modelle einem Prozess namens RLHF ( Reinforcement Learning from Human Feedback ) unterzogen. In dieser Phase bestrafen menschliche Bewerter die KI, wenn sie Anweisungen zur Herstellung von Drogen oder Giften gibt.

Da Myristicin in toxikologischen Datenbanken mit spezifischen LD50-Werten (mittlere letale Dosis) geführt wird, erzeugt die neuronale Architektur des Modells eine starke Vektorassoziation zwischen dem Begriff „Muskatnuss/Myristicin“ und den Konzepten „Toxizität“, „Gefahr“ und „psychoaktive Substanz“. Wenn ein Nutzer detaillierte Informationen zu dieser Zutat anfordert, konsultiert die KI ihre synaptischen Gewichte. Übersteigt der chemische Kontext den kulinarischen Kontext, wird die Sicherheitsblockade ausgelöst. Dies ist ein klassisches Beispiel für einen „Fehlalarm“ bei der automatisierten Moderation: Die KI zieht es vor, auf der sicheren Seite zu sein (indem sie das Gewürz als Gift einstuft), anstatt zu riskieren, ein Rezept für eine Vergiftung bereitzustellen.

Das Problem der Ausrichtung und der falsch positiven Ergebnisse

Dieser kuriose Fall mit der Muskatnuss öffnet ein Fenster zu einer der komplexesten Herausforderungen des gegenwärtigen technologischen Fortschritts : Maschinen den gesunden Menschenverstand beizubringen. Die Automatisierung von Sicherheitsfiltern ist unerlässlich, doch die Starrheit, mit der sie angewendet werden, zeigt die derzeitigen Grenzen des künstlichen semantischen Verständnisses auf.

Entwickler verwenden kontinuierlich Benchmarks , um die Fähigkeit der Modelle zu testen, zwischen harmlosen und bösartigen Anfragen zu unterscheiden. Das Konzept der „Dosis“ ist jedoch bekanntermaßen schwer in absolute Regeln zu fassen. Wie Paracelsus im 16. Jahrhundert sagte: „Alle Dinge sind Gift, es gibt nichts ohne Gift. Allein die Dosis macht, dass ein Ding kein Gift ist.“ Dieses Prinzip von Paracelsus einer neuronalen Netzarchitektur beizubringen, erfordert ein Abstraktions- und Weltverständnis, das aktuelle KI-Systeme noch zu erlernen versuchen.

Das Ergebnis ist, dass die KI zwar die Flugbahn einer Rakete mit millimetergenauer Präzision berechnen kann, sich aber möglicherweise weigert, Ihnen bei der Zubereitung eines zu stark gewürzten Weihnachtseierpunschs zu helfen, aus Angst, Sie zu Komplizen einer versehentlichen Vergiftung zu machen.

Schlussfolgerungen

Die Einstufung von Muskatnuss als potenzielle Bedrohung durch digitale Systeme ist weit mehr als nur eine amüsante Anekdote. Sie ist eine perfekte Metapher für den aktuellen Stand der künstlichen Intelligenz. Wir haben Maschinen geschaffen, die über enzyklopädisches Wissen verfügen, die jeden jemals verfassten medizinischen Bericht und jeden chemischen Fachartikel lesen können, denen aber die Lebenserfahrung fehlt, um diese Informationen einzuordnen.

Während die Technologie weiter fortschreitet, wird die eigentliche Herausforderung nicht nur darin bestehen, mehr Daten in die Modelle einzubringen, sondern ihnen die Nuancen des menschlichen Lebens beizubringen . Bis dahin werden unsere Siliziumgehirne weiterhin misstrauisch auf unsere Vorräte blicken und uns daran erinnern, dass es, so fortschrittlich ihre Berechnungen auch sein mögen, immer noch einen großen Unterschied zwischen der Verarbeitung von Daten und dem Verständnis des Geschmacks des täglichen Lebens gibt.

Häufig gestellte Fragen

Sprachmodelle analysieren chemische und toxikologische Daten ohne sensorische Erfahrung. Da dieses Gewürz Myristicin enthält, eine Substanz, die in großen Mengen potenziell toxisch ist, blockieren die Sicherheitsalgorithmen Anfragen, um die Bereitstellung schädlicher Anweisungen zu vermeiden. Das Fehlen menschlichen Kontextes führt somit zu einem falsch-positiven Ergebnis.

Die für die Toxizität verantwortliche organische Verbindung ist Myristicin. Es handelt sich um ein Alkaloid, das bei Einnahme großer Mengen als starkes Psychoaktivum wirkt und Leberschäden verursachen kann. Unbeabsichtigte Vergiftungen beim Kochen sind äußerst selten, da das Gewürz nur in minimalen Mengen zum Würzen von Speisen verwendet wird.

Die Einnahme von mehreren Dutzend Gramm dieses Gewürzes kann schwere körperliche und neurologische Reaktionen hervorrufen. Zu den Hauptsymptomen gehören Halluzinationen, Tachykardie, starke Übelkeit und in extremen klinischen Fällen eine akute Vergiftung. Aus diesem Grund wird es in medizinischen Datenbanken als hochgefährliche Substanz eingestuft.

Maschinelle Lernsysteme werden mithilfe von menschlichem Feedback darauf trainiert, keine schädlichen Inhalte zu generieren. Wenn Bewerter Antworten zu Drogen oder Giften negativ bewerten, assoziiert das neuronale Netz die chemischen Verbindungen mit Gefahrenkonzepten. Dieser Ausrichtungsmechanismus verhindert, dass die Maschine zwischen einer harmlosen kulinarischen Verwendung und einer tödlichen Dosis unterscheidet.

Maschinen beizubringen, dass eine Substanz in kleinen Mengen harmlos, in hohen Dosen aber tödlich ist, erfordert ein sehr komplexes Verständnis der physischen Welt. Aktuelle mathematische Modelle haben Schwierigkeiten, diese Nuance des gesunden Menschenverstands zu verarbeiten. Daher blockieren sie aus übertriebener Vorsicht lieber alle Informationen über umstrittene Inhaltsstoffe.

Haben Sie noch Zweifel an Das KI-Paradoxon: Ein gewöhnliches Gewürz, das für Gift gehalten wird.?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Chemische und toxikologische Eigenschaften von Myristicin (Wikipedia)

- KI-Ausrichtung (AI Alignment) und die Herausforderung der Wertsicherheit (Wikipedia)

- Reinforcement Learning from Human Feedback (RLHF) – Trainingsmethoden für Sprachmodelle (Wikipedia)

- AI Risk Management Framework – Richtlinien zum Umgang mit KI-Risiken (National Institute of Standards and Technology, .gov)

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.