Wir leben in einer Zeit, in der die generative künstliche Intelligenz scheinbar keine Grenzen mehr kennt. Von hyperrealistischen Landschaften fremder Welten bis hin zu Porträts von Menschen, die nie existiert haben, können heutige Systeme jeden visuellen Input mit verblüffender Präzision synthetisieren. Doch in diesem riesigen Ozean chromatischer und kompositorischer Möglichkeiten existiert eine faszinierende Anomalie : eine bestimmte Farbe, ein einziger Farbton, den Maschinen kategorisch weigern, in seiner reinen Form wiederzugeben. Es handelt sich nicht um eine Hardware-Beschränkung unserer Monitore, sondern um eine echte psychologisch-digitale Blockade, die im Code dieser Netzwerke selbst verankert ist. Um dieses Rätsel zu verstehen, müssen wir in die Tiefen der visuellen Datenverarbeitung eintauchen und herausfinden, was geschieht, wenn mathematische Logik auf die Geschichte der Informatik trifft.

Das Paradoxon der synthetischen Kreativität

Um zu verstehen, warum es eine „unmögliche“ Farbe gibt, muss man zunächst begreifen, wie künstliche Intelligenz Bilder erzeugt und visualisiert . Anders als ein menschlicher Maler, der Pigmente auf einer Palette mischt, arbeiten generative Modelle in einem mehrdimensionalen mathematischen Raum, dem sogenannten latenten Raum . In diesem Raum wird jedes Konzept, jede Form und jede Farbe durch numerische Koordinaten repräsentiert. Durch einen Prozess, der als Diffusion bekannt ist, beginnt die KI mit zufälligem visuellen Rauschen (ähnlich dem Schneeeffekt alter Fernseher) und verfeinert es schrittweise, bis das gewünschte Bild entsteht.

Theoretisch sollte ein Algorithmus in der Lage sein, jeden Pixel mit jeder beliebigen Zahlenkombination von 0 bis 255 anzusteuern, da moderne Monitore das RGB-Modell (Rot, Grün, Blau) verwenden, um über 16 Millionen Farben zu erzeugen. Die Theorie stößt jedoch in der Praxis des Trainings an ihre Grenzen. Maschinen lernen nicht im luftleeren Raum, sondern verarbeiten Terabytes an von Menschen erzeugten Daten. Und genau in diesen Daten liegt der Keim der Ablehnung.

Das Gespenst im Code: die verbotene Nuance

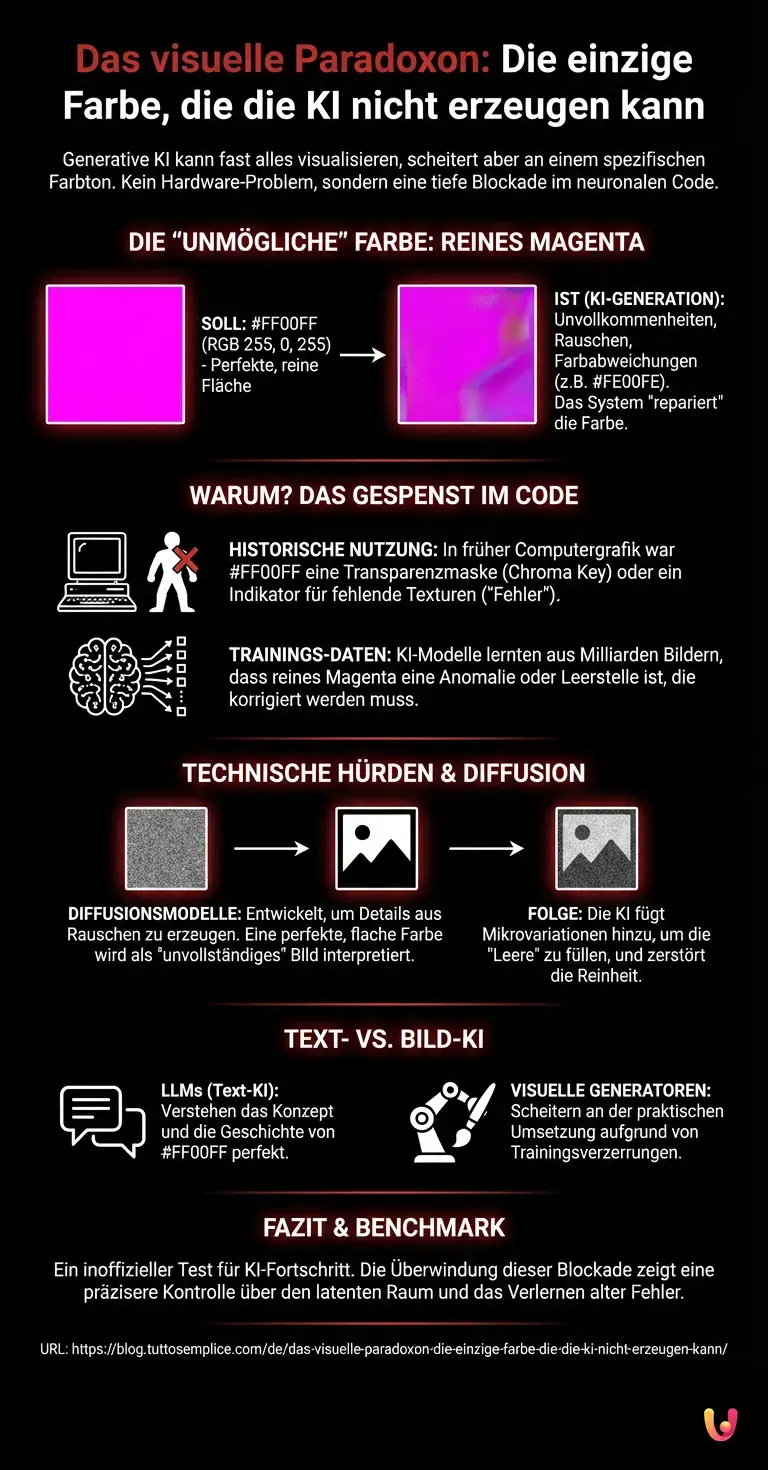

Welche Farbe ist also diese unmögliche Farbe? Es handelt sich um reines Magenta , im Hexadezimalsystem als #FF00FF (oder RGB 255, 0, 255) bekannt. Wenn Sie einen Bildgenerator bitten, eine Leinwand zu erstellen, die ausschließlich und perfekt mit diesem spezifischen und leuchtenden Fuchsia-/Magentaton gefüllt ist, ohne jegliche Variation, Schatten oder Rauschen, wird das System verwirrt sein. Anstatt eine einfarbige Fläche zu erzeugen, wird der Algorithmus Unvollkommenheiten, Schattierungen, unerwünschte Texturen einführen oder den Farbcode leicht verändern , beispielsweise zu #FE00FE, oder visuelle Artefakte hinzufügen.

Aber warum gerade reines Magenta? Die Antwort liegt nicht in der Physik des Lichts (obwohl Magenta an sich eine extraspektrale Farbe ist, also nicht im sichtbaren Spektrum vorkommt, sondern von unserem Gehirn erzeugt wird), sondern in der Geschichte der Computergrafik. Von den Anfängen der Videospielentwicklung und des 3D-Renderings an wurde die Farbe #FF00FF als Transparenzmaske (Chroma Key) oder als Indikator für fehlende Texturen verwendet. Es war eine so unnatürliche und seltene Farbe in der realen Welt, dass Programmierer sie benutzten, um dem Computer zu sagen: „Ignoriere diesen Teil“ oder „Achtung, hier ist ein Fehler“.

Wie die neuronale Architektur auf Fehler reagiert

Als Forscher begannen, Milliarden von Bildern zu sammeln, um moderne Deep-Learning -Modelle zu trainieren, fügten sie unbeabsichtigt Millionen von Screenshots, Videospiel-Assets und Grafikdateien hinzu, in denen reines Magenta eine Leerstelle oder einen Fehler darstellte. Die neuronale Architektur dieser Systeme lernte daraufhin eine tiefe, unbewusste semantische Assoziation: Die Farbe #FF00FF ist keine Farbe zum Zeichnen, sondern eine Anomalie, die korrigiert oder ein Loch, das gefüllt werden muss.

Folglich werden, wenn der Algorithmus gezwungen wird, exakt diese Farbe zu generieren, seine internen Fehlerkorrekturfilter automatisch aktiviert. Das neuronale Netz „denkt“, es habe es mit einem beschädigten Bild zu tun und versucht verzweifelt, es zu reparieren, indem es Details hinzufügt, gaußsches Rauschen einfügt oder den Farbton verändert, um es „natürlicher“ und gemäß den während der Trainingsphase erlernten Parametern akzeptabler zu gestalten.

Maschinelles Lernen und die Angst vor der perfekten Leere

Eine zweite Komplexitätsebene ergibt sich aus der Funktionsweise des maschinellen Lernens, das auf die Bilderzeugung angewendet wird. Diffusionsmodelle sind darauf ausgelegt, Details aus dem Chaos zu erzeugen. Ihre Natur besteht darin, Informationen hinzuzufügen. Diese Algorithmen aufzufordern, eine reine, einfarbige und mathematisch perfekte Farbe zu erzeugen, gleicht der Aufforderung, ihre Arbeit nicht zu tun.

Das System interpretiert das Fehlen von Variationen (die einfarbige Fläche) als Fehler im Denoising -Prozess (Rauschunterdrückung). Für den Algorithmus ist ein Bild ohne Textur oder Gradienten ein unvollständiges Bild. Daher weigert es sich, ein Ergebnis zu liefern, das nach seinen mathematischen Parametern unvollständig ist, und fügt Mikrovariationen ein, die die Reinheit der gewünschten Farbe zerstören.

Die Rolle von LLMs und die Farbwahrnehmung

Dieses Phänomen wird noch faszinierender, wenn wir heutige multimodale Modelle betrachten. Fragt man ein fortgeschrittenes LLM , wie die neuesten Versionen von ChatGPT mit visuellen Analysefähigkeiten, so kann es einwandfrei erklären, was reines Magenta ist, den exakten Code dafür schreiben und seine computerhistorische Entwicklung beschreiben. Die textbasierte Intelligenz versteht das Konzept perfekt.

Wenn die Automatisierung jedoch von der Text- zur Pixelgenerierung übergeht, zeigt sich ein Problem. Dies verdeutlicht eine faszinierende Diskrepanz zwischen semantischem Verständnis (Sprache) und visueller Synthese (Generierung). Die künstliche Intelligenz weiß, was Farbe ist, sie kennt ihre Namen, aber ihr „malerischer Arm“ ist physisch (oder besser gesagt digital) nicht in der Lage, sie zu reproduzieren, ohne sie zu verändern – ein Opfer ihrer eigenen Trainingsverzerrungen .

Ein Maßstab für den technologischen Fortschritt

Die Unfähigkeit, reines Magenta zu erzeugen, ist weit mehr als nur ein amüsanter Fehler; sie ist zu einem inoffiziellen Benchmark für Entwickler geworden. Die Prüfung, wie ein Modell mit fehlerhaften Farben oder einfarbigen Flächen umgeht, hilft Ingenieuren zu verstehen, wie stark der Algorithmus von den in den Trainingsdaten vorhandenen Verzerrungen beeinflusst wird.

Der technologische Fortschritt im Bereich der künstlichen Intelligenz misst sich nicht nur an der Fähigkeit, immer komplexere Bilder zu erzeugen, sondern auch an der Fähigkeit, fehlerhafte Assoziationen zu verlernen. Eine neuronale Netzstruktur dazu zu zwingen, ein perfektes Quadrat in der Farbe #FF00FF zu generieren, ohne dass sie versucht, es zu „reparieren“, bedeutet, eine granularere und präzisere Kontrolle über den latenten Raum erlangt zu haben und endlich die Logik der Farbe von der Semantik des Computerfehlers zu trennen.

Schlussfolgerungen

Der Fall der unmöglichen Farbe erinnert uns daran, dass künstliche Intelligenz, so fremdartig und allmächtig sie auch erscheinen mag, tief in der menschlichen Geschichte und unseren technologischen Eigenheiten verwurzelt ist. Die Weigerung, reines Magenta zu erzeugen, ist kein Akt der Rebellion der Maschine, sondern das Echo jahrzehntelanger Programmierung, in der diese Farbe „Fehler“ bedeutete. Während wir weiterhin die Grenzen dessen erweitern, was diese Netzwerke erzeugen können, bieten uns diese kleinen Anomalien ein wertvolles Fenster darauf , wie Maschinen „denken“ und wie die Geister der Computergeschichte manchmal weiterhin die Codes der Zukunft heimsuchen.

Häufig gestellte Fragen

Die für generative Maschinen unmögliche Farbe ist reines Magenta, identifiziert durch den Hexadezimalcode FF00FF. Wenn man eine Software auffordert, ein Bild zu erstellen, das ausschließlich aus diesem Farbton ohne Schattierungen besteht, gerät das System in Verwirrung. Anstatt eine perfekte Leinwand zu liefern, fügt das Programm visuelle Unvollkommenheiten ein oder verändert den Farbton, um ihn natürlicher erscheinen zu lassen.

Dieser Block stammt aus der Geschichte der Computergrafik, wo reines Magenta als Transparenzmaske oder zur Kennzeichnung fehlender Texturen verwendet wurde. Nachdem neuronale Netze Milliarden von Bildern mit diesem Merkmal analysiert hatten, lernten sie, diesen Farbton mit einem Computerfehler zu assoziieren, der um jeden Preis behoben werden muss.

Diffusionsmodelle sind darauf programmiert, Details ausgehend von visuellem Rauschen hinzuzufügen. Die Aufforderung, eine vollkommen gleichmäßige Fläche zu generieren, wird vom System als Fehlschlag des Rauschunterdrückungsprozesses interpretiert. Daher fügt die Software Mikrovariationen hinzu, um das, was sie als unvollständiges Bild betrachtet, zu vervollständigen.

Fortgeschrittene Sprachmodelle verstehen das Konzept von reinem Magenta perfekt und kennen dessen komplexe Informatikgeschichte. Es besteht jedoch eine klare Trennung zwischen dem semantischen Textverständnis und der visuellen Synthese. Der Grafikgenerator bleibt nämlich durch die während der visuellen Trainingsphase erworbenen Vorurteile blockiert, was zeigt, dass Theorie nicht immer in digitale Praxis umgesetzt werden kann.

Die Unmöglichkeit, diesen spezifischen Farbton zu erzeugen, dient als grundlegender Indikator dafür, wie stark ein Algorithmus von den Trainingsdaten beeinflusst wird. Die Fähigkeit, der Maschine ein perfektes magentafarbenes Quadrat zu entlocken, bedeutet, eine höhere Kontrolle über den latenten Raum erlangt zu haben. Dieses Ergebnis ermöglicht es den Ingenieuren, die Logik der Farbe von der Semantik vergangener Computerfehler zu trennen.

Haben Sie noch Zweifel an Das visuelle Paradoxon: Die einzige Farbe, die die KI nicht erzeugen kann.?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Magenta (Farbe) – Definition, Eigenschaften und digitale Darstellung

- Purpurlinie – Wahrnehmung und Darstellung von Nichtspektralfarben

- Diffusionsmodell – Mathematische Grundlagen der generativen Bild-KI

- Latent space – Mehrdimensionale Datenrepräsentation im maschinellen Lernen

- Chroma Key – Verwendung spezifischer Farbtöne als Transparenzmasken in der Computergrafik

- RGB-Farbraum – Digitale Farbsynthese und Hexadezimalwerte in der Informatik

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.