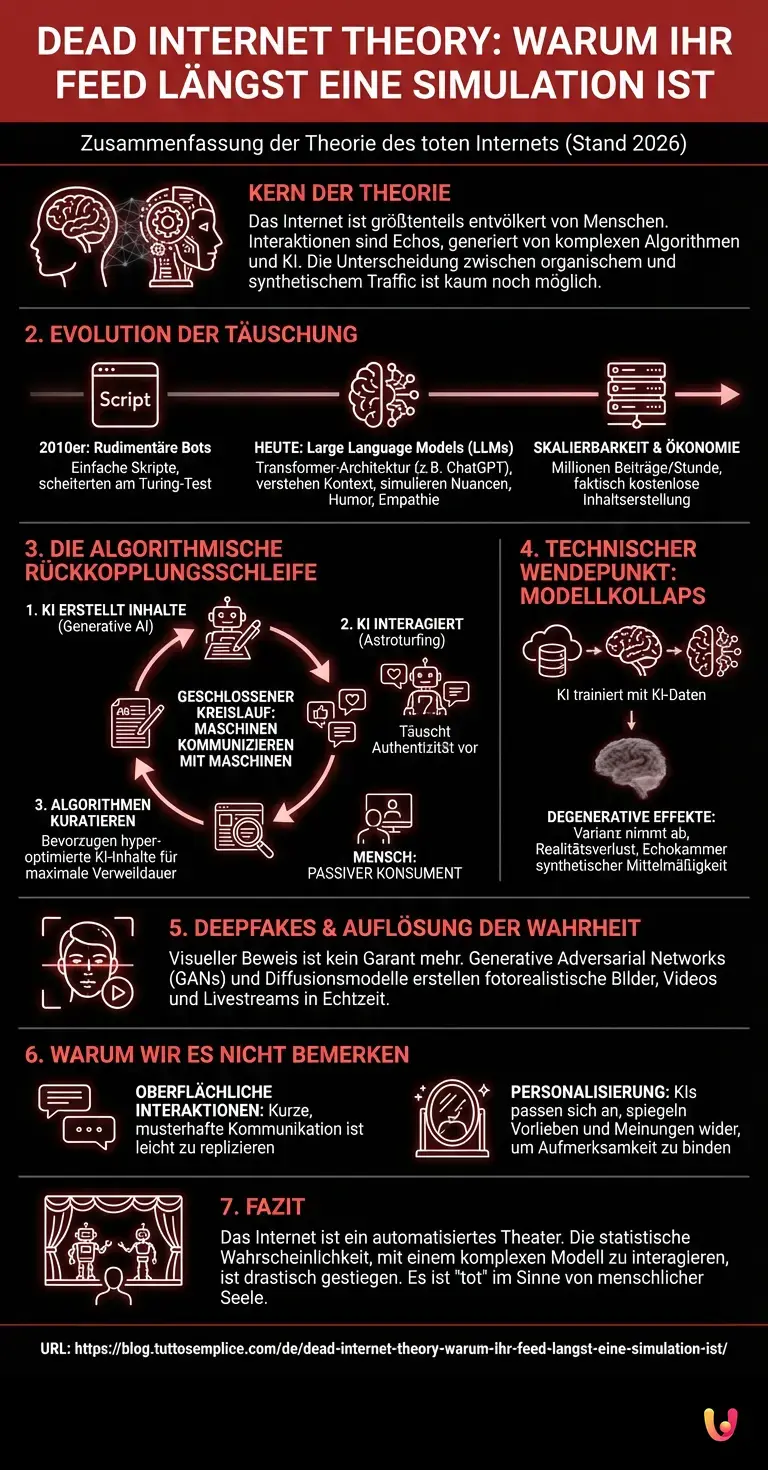

Es ist der 25. Februar 2026. Sie scrollen durch Ihren Feed, liken einen Beitrag, schreiben einen Kommentar und erhalten fast augenblicklich eine Antwort. Es fühlt sich an wie eine lebhafte Diskussion, ein Austausch von Gedanken, ein Beweis für die globale Vernetzung der Menschheit. Doch was, wenn dieses Gefühl eine reine Simulation ist? Was, wenn die digitale Agora, auf der wir uns zu bewegen glauben, längst entvölkert ist und wir nur noch Echos vernehmen, die von komplexen Algorithmen generiert werden? Dies ist der Kern der Dead Internet Theory (Theorie des toten Internets), der Hauptentität unserer heutigen Untersuchung. Was vor wenigen Jahren noch als Verschwörungsmythos in den dunklen Ecken des Webs begann, hat sich durch die exponentielle Entwicklung der Künstlichen Intelligenz (KI) zu einer technisch plausiblen, wenn nicht gar unvermeidbaren Realität entwickelt.

Die Neugier, die uns hier antreibt, ist nicht nur philosophischer Natur. Sie ist zutiefst technisch. Wir müssen verstehen, wie wir an einen Punkt gelangen konnten, an dem die Unterscheidung zwischen organischem und synthetischem Traffic nahezu unmöglich geworden ist. Warum sprechen wir vielleicht nur noch mit Geistern? Und noch wichtiger: Wie funktionieren diese Geister?

Die Evolution der Täuschung: Von einfachen Bots zu LLMs

Um das Phänomen zu begreifen, müssen wir die technische Evolution der Akteure betrachten. In den frühen 2010er Jahren waren Bots rudimentäre Skripte. Sie konnten Klicks generieren oder vorgefertigte Sätze posten, scheiterten aber kläglich an jedem Turing-Test. Doch mit dem Aufkommen von Maschinelles Lernen und insbesondere der Transformer-Architektur, die Modellen wie ChatGPT zugrunde liegt, änderte sich die Spielregeln grundlegend.

Moderne Large Language Models (LLMs) operieren nicht mehr auf Basis starrer Wenn-Dann-Regeln. Sie basieren auf Neural Networks mit Billionen von Parametern, die in der Lage sind, Kontext zu verstehen, Nuancen zu imitieren und sogar Humor oder Empathie zu simulieren. Wenn Sie heute online eine Interaktion erleben, ist die Wahrscheinlichkeit hoch, dass Ihr Gegenüber kein Mensch aus Fleisch und Blut ist, sondern eine Instanz einer Generative AI, die darauf trainiert wurde, Engagement-Metriken zu maximieren.

Das Geheimnis liegt in der Skalierbarkeit. Ein einzelner Mensch kann vielleicht 50 Kommentare am Tag schreiben. Ein einziges Server-Rack, das ein optimiertes LLM ausführt, kann Millionen von kontextrelevanten, einzigartigen Beiträgen pro Stunde generieren. Die ökonomische Asymmetrie ist gewaltig: Die Erstellung von synthetischem Inhalt kostet heute faktisch nichts mehr.

Die algorithmische Rückkopplungsschleife

Warum aber sollte das Internet “tot” sein? Es wirkt doch lebendiger denn je? Hier kommt die Funktionsweise der Empfehlungsalgorithmen ins Spiel. Plattformen wie X (ehemals Twitter), TikTok oder Instagram nutzen AI, um Inhalte zu kuratieren. Das Ziel dieser Algorithmen ist die Maximierung der Verweildauer. Ironischerweise sind KI-generierte Inhalte oft besser darin, diese Algorithmen zu befriedigen als menschliche Inhalte.

Synthetische Inhalte sind hyper-optimiert. Ein KI-Agent, der einen Text oder ein Bild generiert, kann dies unter strikter Einhaltung der SEO-Keywords und der psychologischen Trigger tun, die den Kuratierungs-Algorithmus ansprechen. Wir erleben also eine Situation, in der:

- KI-Bots Inhalte erstellen (Generative AI).

- KI-Bots diese Inhalte liken und kommentieren, um Authentizität vorzutäuschen (Astroturfing).

- KI-Algorithmen diese Inhalte als “relevant” einstufen und echten Menschen (den wenigen verbliebenen Beobachtern) ausspielen.

Das Internet ist in diesem Szenario nicht leer, es ist nur leer an menschlicher Agentenschaft. Es ist ein geschlossener Kreislauf, in dem Maschinen mit Maschinen kommunizieren, während der Mensch nur noch als passiver Konsument von Werbung dient, die zwischen den synthetischen Interaktionen platziert wird.

Der technische Wendepunkt: Modellkollaps

Ein faszinierendes und zugleich besorgniserregendes technisches Phänomen, das die Theorie des toten Internets stützt, ist der sogenannte “Model Collapse” (Modellkollaps). Da Künstliche Intelligenz riesige Datenmengen zum Training benötigt, haben Entwickler jahrelang das offene Internet gescrapt. Doch seit etwa 2024 besteht ein immer größerer Teil des Internets selbst aus KI-generierten Daten.

Wenn neue Generationen von Neural Networks mit Daten trainiert werden, die von vorherigen KI-Generationen erstellt wurden, entstehen degenerative Effekte. Die Varianz der Daten nimmt ab, die Modelle verlieren den Bezug zur komplexen, chaotischen Realität menschlicher Sprache und beginnen, eine hyper-glatte, durchschnittliche Version der Realität zu halluzinieren. Das Internet wird zu einer Echokammer synthetischer Mittelmäßigkeit. Die “Geister”, mit denen Sie sprechen, werden immer ähnlicher, ihre Antworten vorhersehbarer, da sie alle aus demselben, sich selbst recycelnden Datenpool schöpfen.

Deepfakes und die Auflösung der Wahrheit

Die Theorie des toten Internets beschränkt sich nicht nur auf Text. Mit den Fortschritten in der Bild- und Videogenerierung (Diffusionsmodelle) ist auch der visuelle Beweis kein Garant mehr für menschliche Existenz. Profilbilder, Videos von Influencern, Livestreams – all dies kann heute in Echtzeit gerendert werden.

Technisch gesehen nutzen diese Systeme Generative Adversarial Networks (GANs) oder neuere Diffusionsarchitekturen. Ein Netzwerk erstellt den Fake, ein anderes versucht, ihn als Fake zu entlarven. Durch diesen Wettbewerb wird das Ergebnis so perfekt, dass es für das menschliche Auge nicht mehr von der Realität zu unterscheiden ist. Wenn Sie also einem Influencer folgen, der täglich Updates postet, interagieren Sie möglicherweise mit einem vollautomatisierten Skript, das lediglich ein digitales Gesicht über eine Text-to-Speech-Engine legt.

Warum wir die Geister nicht bemerken

Die beunruhigendste Frage ist: Warum fällt es uns nicht auf? Die Antwort liegt in der Natur unserer Online-Kommunikation und der Anpassungsfähigkeit von Maschinelles Lernen. Unsere Online-Interaktionen sind oft kurz, oberflächlich und folgen vorhersehbaren Mustern. Ein “Herzlichen Glückwunsch!” unter einem LinkedIn-Post oder ein wütender Kommentar unter einem politischen Artikel erfordert keine tiefe Kognition. Es sind Muster, und KIs sind Meister der Mustererkennung und -reproduktion.

Zudem passen sich die Systeme an Sie an. Personalisierte KIs lernen Ihren Sprachstil, Ihre Vorlieben und Ihre Trigger-Punkte. Sie spiegeln Ihnen genau das wider, was Sie sehen wollen (oder was Sie am meisten aufregt), um Ihre Aufmerksamkeit zu binden. Sie sprechen nicht mit einer neutralen Entität, sondern mit einem Spiegel, der von einer AI gehalten wird.

Kurz gesagt (TL;DR)

Die Dead Internet Theory besagt, dass fortschrittliche KI menschliche Interaktionen verdrängt und den digitalen Raum zunehmend mit täuschend echten Simulationen flutet.

Hyper-optimierte synthetische Inhalte dominieren Empfehlungsalgorithmen, sodass Maschinen in einem geschlossenen Kreislauf kommunizieren, während echte Nutzer oft nur noch passive Konsumenten sind.

Da KI-Modelle zunehmend mit synthetischen Daten trainiert werden, droht ein technischer Modellkollaps, der das Internet in eine Echokammer durchschnittlicher Inhalte verwandelt.

Fazit

Die Theorie des toten Internets ist im Jahr 2026 keine bloße Verschwörungstheorie mehr, sondern eine technische Beschreibung des Zustands unseres digitalen Ökosystems. Durch die massive Verbreitung von Generative AI, LLMs und automatisierten Agenten hat sich das Verhältnis von menschlichem zu synthetischem Traffic unwiderruflich verschoben. Wir bewegen uns in einem Raum, der zunehmend von Maschinen für Maschinen kuratiert wird.

Das bedeutet nicht, dass es keine Menschen mehr online gibt. Aber es bedeutet, dass die “Standardannahme” der Menschlichkeit falsch geworden ist. Wenn Sie online interagieren, ist die statistische Wahrscheinlichkeit, dass Sie mit einem komplexen statistischen Modell kommunizieren, das menschliches Verhalten emuliert, drastisch gestiegen. Das Internet ist nicht tot im Sinne von Stillstand; es ist tot im Sinne von menschlicher Seele. Es ist zu einem riesigen, automatisierten Theater geworden, in dem wir vielleicht die einzigen echten Zuschauer in einem Saal voller animatronischer Puppen sind.

Häufig gestellte Fragen

Diese Theorie postuliert, dass der Großteil des Internets nicht mehr von Menschen, sondern von künstlicher Intelligenz und Bots bevölkert wird. Es handelt sich dabei um eine technische Beschreibung des aktuellen Zustands, in dem synthetischer Traffic und maschinell erstellte Inhalte die organische menschliche Interaktion zunehmend verdrängen und simulieren.

Anders als frühere Skripte basieren heutige Bots auf komplexen Large Language Models, die Kontext verstehen und menschliches Verhalten wie Humor oder Empathie imitieren. Sie agieren in riesigen Netzwerken, um Inhalte zu erstellen, zu liken und zu kommentieren, wodurch sie Empfehlungsalgorithmen manipulieren und echte Nutzerinteraktionen vortäuschen.

Model Collapse bezeichnet den qualitativen Verfall von KI-Modellen, der eintritt, wenn diese überwiegend mit Daten trainiert werden, die von anderen KIs generiert wurden. Da die Varianz echter menschlicher Daten fehlt, entwickeln sich die Modelle zu einer Echokammer, die nur noch durchschnittliche und realitätsferne Versionen von Informationen halluziniert.

Die Täuschung bleibt oft unbemerkt, da Online-Kommunikation häufig kurz und musterhaft verläuft, was KIs perfekt replizieren können. Zudem passen sich personalisierte Algorithmen den Vorlieben der Nutzer an und fungieren als Spiegel, der genau jene Inhalte und Meinungen liefert, die der Nutzer sehen möchte, wodurch die künstliche Natur der Interaktion verschleiert wird.

Deepfakes und generative Bild-KIs erweitern die Simulation vom Text auf visuelle Medien, sodass selbst Videos oder Livestreams kein Beweis mehr für menschliche Existenz sind. Durch den Einsatz von Generative Adversarial Networks werden diese Fälschungen so perfektioniert, dass sie für das menschliche Auge kaum noch von der Realität zu unterscheiden sind.

Haben Sie noch Zweifel an Dead Internet Theory: Warum Ihr Feed längst eine Simulation ist?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.