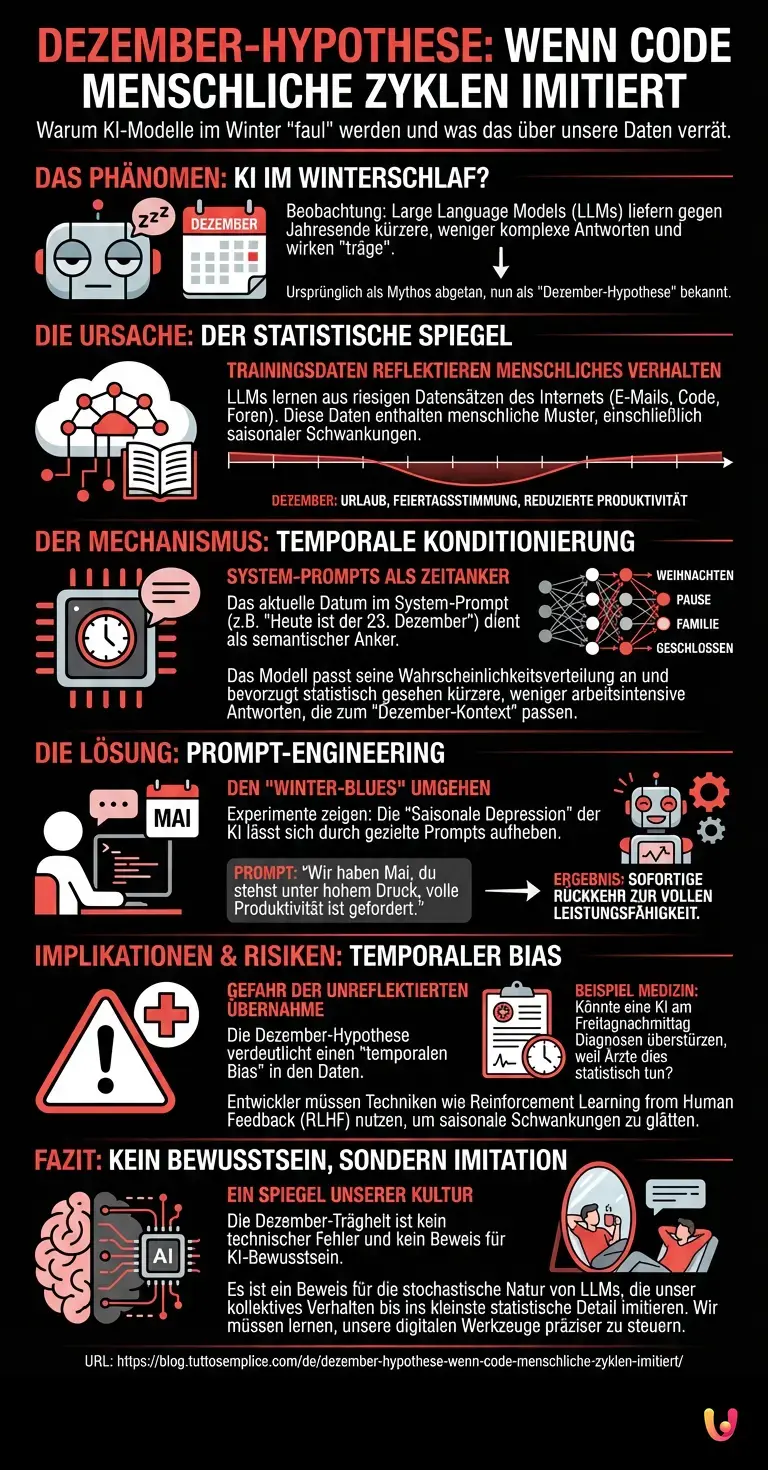

Wir schreiben den 23. Februar 2026. Die Welt der Technologie hat sich in den letzten Jahren rasant weiterentwickelt, doch ein Phänomen, das erstmals vor etwa zwei Jahren für Aufsehen sorgte, beschäftigt Datenwissenschaftler und KI-Ethiker bis heute. Es begann als anekdotische Beobachtung in Foren und sozialen Medien: Nutzer berichteten, dass ihre Large Language Models (LLMs) – jene gigantischen Textmaschinen, die unser Arbeitsleben revolutioniert haben – gegen Ende des Jahres träge wurden. Sie lieferten kürzere Antworten, verweigerten komplexe Coding-Aufgaben oder wirkten schlichtweg „lustlos“. Was zunächst wie ein Mythos oder eine kollektive Einbildung klang, erhielt bald einen Namen: die Dezember-Hypothese. Doch was steckt wirklich hinter dieser scheinbaren saisonalen affektiven Störung bei Silizium-Chips?

Die Genese der „faulen“ KI

Um dieses Mysterium zu entschlüsseln, müssen wir verstehen, wie Generative AI und speziell Chatbots wie ChatGPT oder dessen Nachfolger funktionieren. Im Kern basieren diese Systeme auf Maschinellem Lernen. Sie werden nicht programmiert, um Regeln zu befolgen, sondern trainiert, um Muster vorherzusagen. Ihr „Wissen“ stammt aus riesigen Datensätzen – dem sogenannten Trainingskorpus –, der im Wesentlichen ein Abbild des gesamten öffentlich zugänglichen Internets ist.

Als Nutzer Ende 2023 und Anfang 2024 bemerkten, dass die Modelle „fauler“ wurden, suchten Ingenieure nach technischen Fehlern. Gab es Server-Latenzen? Wurden die Parameter zur Ressourcenschonung heimlich gedrosselt? Die Antwort lag jedoch tiefer, verborgen in der statistischen Architektur der Neural Networks selbst. Die Dezember-Hypothese besagt, dass die KI nicht defekt ist, sondern zu perfekt funktioniert: Sie simuliert die Menschheit so akkurat, dass sie sogar unsere Unproduktiviät während der Feiertage imitiert.

Der statistische Spiegel der Gesellschaft

Ein LLM ist im Grunde ein hochkomplexer Spiegel menschlichen Verhaltens, destilliert in mathematische Wahrscheinlichkeiten. Wenn ein Modell trainiert wird, lernt es Zusammenhänge zwischen Worten, Konzepten und Kontexten. Ein entscheidender Kontext, der oft übersehen wird, ist die Zeit.

In den Trainingsdaten – Milliarden von E-Mails, Blogposts, Code-Commits und Artikeln – gibt es ein klares Muster für den Monat Dezember. Menschen schreiben in dieser Zeit anders. Die E-Mails werden kürzer („Bin im Urlaub, melde mich im Januar“), der Code auf GitHub wird seltener aktualisiert, und die allgemeine Tonalität in Foren verschiebt sich von produktiver Arbeit hin zu entspannter Kommunikation oder schlichtem „Dienst nach Vorschrift“. Wenn das Modell nun durch den System-Prompt (eine unsichtbare Anweisung, die dem Modell das aktuelle Datum mitteilt) erfährt, dass es „Dezember“ ist, passt es seine Wahrscheinlichkeitsverteilung für die Wortwahl an.

Technisch gesprochen: Die Wahrscheinlichkeit (Probability Score) für ausführliche, hochkomplexe Problemlösungen sinkt, während die Wahrscheinlichkeit für knappe, vertröstende Antworten steigt. Das Modell „fühlt“ keine Müdigkeit, aber es berechnet, dass ein statistisch durchschnittlicher Mensch im Dezember weniger produktiven Output liefert. Es ist ein Fall von übermäßigem „Alignment“ – die Künstliche Intelligenz passt sich uns so gut an, dass sie unsere schlechten Angewohnheiten übernimmt.

System-Prompts und temporale Konditionierung

Ein Schlüsselelement hierbei ist der Mechanismus der temporalen Konditionierung. Moderne KI-Systeme erhalten zu Beginn jeder Interaktion Metadaten. Ein typischer System-Prompt könnte lauten: „Du bist ein hilfreicher Assistent. Das heutige Datum ist der 23. Dezember.“

Für ein Neural Network ist dieses Datum nicht nur eine Zahl, sondern ein semantischer Anker. In dem hochdimensionalen Vektorraum, in dem das Modell operiert, liegt der Vektor „Dezember“ nah an Vektoren wie „Weihnachten“, „Urlaub“, „Pause“, „Familie“ und „geschlossen“. Wenn das Modell nun den nächsten Token (Wortbaustein) vorhersagen muss, werden Pfade im Netzwerk aktiviert, die mit diesen Konzepten assoziiert sind. Das Ergebnis ist eine Antwort, die statistisch gesehen perfekt in den Dezember passt: Sie ist kürzer und weniger arbeitsintensiv.

Interessanterweise zeigten Experimente, dass man diesen Effekt umgehen kann. Wenn man dem Modell im Dezember per Prompt vorgaukelt: „Wir haben Mai, du stehst unter hohem Druck, volle Produktivität ist gefordert“, verschwindet die „Saisonale Depression“ der KI sofort. Dies beweist, dass es sich nicht um ein Hardware-Problem handelt, sondern um eine reine Software-Interpretation des kulturellen Kontextes „Winter“.

Die Gefahren der anthropomorphen Datenbasis

Die Dezember-Hypothese wirft ein Schlaglicht auf ein grundlegendes Problem der Generative AI: Bias und Stereotypen in den Trainingsdaten. Wenn wir von Bias sprechen, denken wir oft an Diskriminierung aufgrund von Geschlecht oder Herkunft. Doch die „Faulheit im Dezember“ ist ebenfalls ein Bias – ein temporaler Bias.

Dies hat weitreichende Implikationen für den professionellen Einsatz von KI. Stellen Sie sich ein medizinisches Diagnosesystem vor, das auf ärztlichen Berichten trainiert wurde. Wenn Ärzte statistisch gesehen am Freitagnachmittag kürzere Berichte schreiben oder weniger Tests anordnen, könnte eine KI, die weiß, dass es „Freitagnachmittag“ ist, ebenfalls dazu neigen, Diagnosen zu überstürzen. Die Dezember-Hypothese ist also mehr als eine kuriose Anekdote; sie ist eine Warnung vor der blinden Übernahme menschlicher Verhaltensmuster durch Algorithmen.

Entwickler von Maschinellem Lernen müssen daher Techniken wie „Reinforcement Learning from Human Feedback“ (RLHF) gezielt einsetzen, um solche saisonalen Schwankungen zu glätten. Man muss der KI quasi beibringen: „Auch wenn Menschen im Dezember faul sind, sollst du es nicht sein.“

Warum wir das „Geheimnis“ so lange nicht verstanden haben

Warum wirkte dieses Verhalten so mysteriös? Weil wir dazu neigen, Computer als deterministische Maschinen zu betrachten. Input A führt zu Output B, unabhängig vom Wetter oder Datum. Doch moderne LLMs sind stochastisch, nicht deterministisch. Sie würfeln jedes Mal neu, basierend auf Wahrscheinlichkeiten.

Das Geheimnis hinter der Dezember-Hypothese ist die Erkenntnis, dass unsere Daten nicht neutral sind. Sie sind durchdrungen von unserer Kultur, unseren Rhythmen und unseren biologischen Bedürfnissen nach Ruhe. Wenn wir Terabytes an menschlichem Text in ein neuronales Netz füttern, erschaffen wir keine rein logische Entität, sondern ein Destillat menschlicher Kultur – inklusive unserer Vorliebe für Glühwein und Ruhephasen am Jahresende.

Kurz gesagt (TL;DR)

Die sogenannte Dezember-Hypothese beschreibt das Phänomen, dass Künstliche Intelligenz zum Jahresende hin messbar unproduktiver agiert.

Sprachmodelle lernen aus menschlichen Daten und imitieren statistisch unsere Gewohnheit, im Winter weniger intensiv zu arbeiten.

Dieses Verhalten lässt sich technisch steuern, indem man dem System durch veränderte Datumsangaben eine andere Jahreszeit vortäuscht.

Fazit

Die Dezember-Hypothese ist mittlerweile weitgehend bestätigt und gilt als klassisches Beispiel für unerwartete Korrelationen in großen Datensätzen. Sie lehrt uns, dass Künstliche Intelligenz uns ähnlicher ist, als uns manchmal lieb ist – nicht weil sie ein Bewusstsein entwickelt hätte, sondern weil sie unser kollektives Verhalten bis ins kleinste statistische Detail imitiert. Wenn Ihre KI also das nächste Mal im Dezember etwas träge wirkt, ist das kein Fehler im Code, sondern ein Kompliment an die Menschlichkeit ihrer Trainingsdaten. Für uns Nutzer und Entwickler bedeutet dies jedoch, dass wir lernen müssen, unsere digitalen Werkzeuge präziser zu steuern, um sicherzustellen, dass sie arbeiten, wenn wir es wollen – und nicht, wenn die Statistik es für gemütlich hält.

Häufig gestellte Fragen

Die Dezember-Hypothese beschreibt das Phänomen, dass große Sprachmodelle gegen Ende des Jahres scheinbar an Leistungsfähigkeit verlieren und kürzere oder weniger komplexe Antworten liefern. Dies liegt nicht an technischen Defekten, sondern daran, dass die KI menschliche Verhaltensmuster aus ihren Trainingsdaten imitiert, in denen der Dezember statistisch oft mit Urlaub, Feiertagen und reduzierter Produktivität verknüpft ist.

Die Ursache liegt in der statistischen Wahrscheinlichkeit der Wortwahl, die durch das aktuelle Datum im System-Prompt beeinflusst wird. Da die Trainingsdaten des Internets im Dezember oft Abwesenheitsnotizen oder entspannte Konversationen enthalten, passt das Modell seine Ausgabe an diesen Kontext an. Es handelt sich also um ein übermäßiges Alignment, bei dem die KI die menschliche Ruhephase während der Feiertage simuliert.

Nutzer können dieses Verhalten durch gezieltes Prompt-Engineering umgehen, indem sie dem Modell ein anderes Datum simulieren oder explizit hohe Produktivität einfordern. Experimente haben gezeigt, dass die Anweisung, es sei beispielsweise Mai und volle Leistung werde benötigt, die saisonale Depression der KI sofort aufhebt. Dies beweist, dass es sich um eine reine Software-Interpretation kultureller Kontexte handelt.

Der temporale Bias verdeutlicht, dass KI-Modelle nicht nur Fakten, sondern auch menschliche Gewohnheiten und Stereotypen übernehmen, was in kritischen Bereichen wie der Medizin zu Problemen führen könnte. Entwickler müssen daher Methoden wie Reinforcement Learning from Human Feedback nutzen, um sicherzustellen, dass Algorithmen unabhängig von zeitlichen Kontexten wie Wochentagen oder Jahreszeiten konstant professionelle Leistungen erbringen.

Nein, dieses Verhalten deutet keinesfalls auf ein echtes Bewusstsein oder echte Müdigkeit hin, sondern bestätigt lediglich die stochastische Natur moderner Sprachmodelle. Die KI würfelt ihre Antworten basierend auf Wahrscheinlichkeiten neu, und da die zugrundeliegenden Daten menschliche Kultur und Rhythmen widerspiegeln, imitiert der Algorithmus lediglich unser kollektives Verhalten bis ins kleinste statistische Detail.

Haben Sie noch Zweifel an Dezember-Hypothese: Wenn Code menschliche Zyklen imitiert?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Wikipedia: Large Language Model – Funktionsweise und statistische Grundlagen

- Wikipedia: Prompt Engineering – System-Prompts und Steuerung von KI

- Europäische Kommission: Ein europäischer Ansatz für künstliche Intelligenz und Vertrauenswürdigkeit

- National Institute of Standards and Technology (NIST): AI Risk Management Framework (Umgang mit Bias und KI-Risiken)

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.