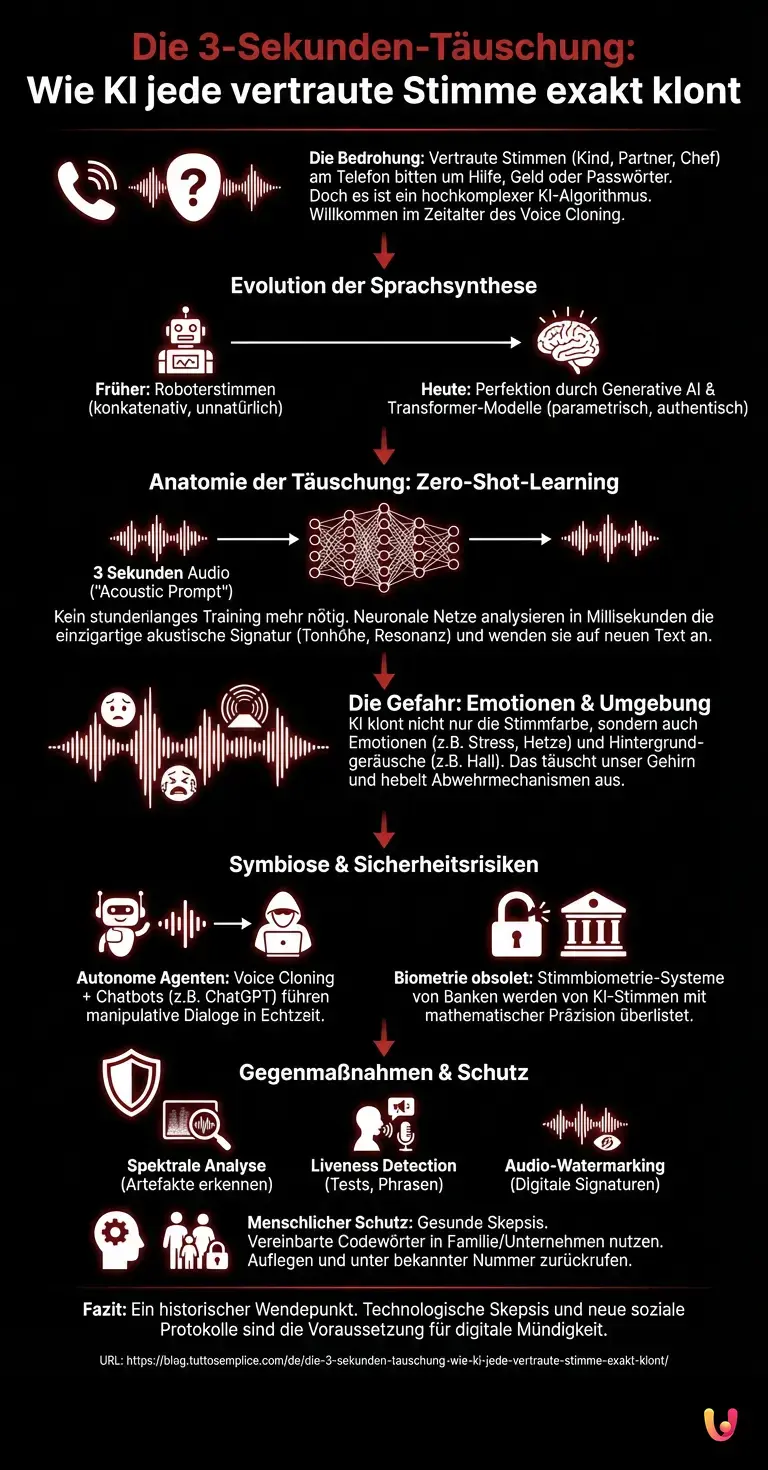

Stell dir vor, das Telefon klingelt. Am anderen Ende der Leitung ist die vertraute Stimme deines Kindes, deines Partners oder deines Vorgesetzten. Die Person klingt gestresst, bittet dringend um Hilfe, ein Passwort oder die sofortige Überweisung eines Geldbetrags. Die Sprachmelodie, der spezifische Dialekt, das Timbre und sogar das leichte Atmen zwischen den Wörtern – alles ist absolut authentisch und unverkennbar. Doch die Person, mit der du sprichst, ist nicht der Mensch, den du zu kennen glaubst. Es ist ein hochkomplexer Algorithmus. Willkommen in der Ära des Voice Cloning. Diese Technologie bildet den Kern der sogenannten Drei-Sekunden-Täuschung, eines Phänomens, das unsere Wahrnehmung von Realität und Identität in der digitalen Kommunikation derzeit grundlegend erschüttert.

Die Evolution der Sprachsynthese: Von Roboterstimmen zur Perfektion

Um zu verstehen, warum diese Entwicklung so bahnbrechend und gleichzeitig so beunruhigend ist, müssen wir einen Blick auf die Geschichte der Sprachsynthese werfen. Noch vor wenigen Jahren basierten Text-to-Speech-Systeme (TTS) auf der sogenannten konkatenativen Synthese. Dabei wurden unzählige kurze Sprachfragmente eines menschlichen Sprechers in einer Datenbank gespeichert und bei Bedarf aneinandergereiht. Das Ergebnis war verständlich, klang aber unnatürlich, abgehackt und emotionslos – die klassische “Roboterstimme”.

Der Paradigmenwechsel erfolgte durch den Einsatz moderner Künstliche Intelligenz. Anstatt vorgefertigte Schnipsel aneinanderzukleben, begannen Forscher, parametrische Modelle zu trainieren, die die physikalischen Eigenschaften der menschlichen Stimme mathematisch simulieren. Doch der eigentliche Durchbruch, der uns zur Drei-Sekunden-Täuschung führte, gelang erst in jüngster Zeit durch den Einsatz von Generative AI und fortschrittlichen Transformator-Architekturen.

Die Anatomie der Drei-Sekunden-Täuschung: Zero-Shot-Learning

Das Geheimnis hinter der Fähigkeit, eine Stimme mit nur drei Sekunden Audiomaterial perfekt zu klonen, liegt in einem Konzept namens “Zero-Shot Text-to-Speech”. Traditionelle KI-Stimmen erforderten stundenlanges, sauberes Audiomaterial einer Person in einem professionellen Tonstudio, um ein Modell spezifisch auf diese eine Stimme zu trainieren (Fine-Tuning). Die neuen Modelle hingegen benötigen dieses spezifische Training nicht mehr.

Wie funktioniert das technisch? Die Architektur dieser Systeme nutzt Neural Networks, die auf riesigen, unstrukturierten Audiodatensätzen trainiert wurden – oft zehntausende Stunden von Hörbüchern, Podcasts und öffentlichen Reden. Wenn das System nun einen drei Sekunden langen Audio-Schnipsel (den sogenannten “Acoustic Prompt”) erhält, analysiert es diesen nicht einfach nur oberflächlich. Ein Audio-Codec-Modell zerlegt die kontinuierliche Schallwelle in diskrete, komprimierte Einheiten, sogenannte akustische Tokens.

Hier kommt die Verwandtschaft zu modernen Text-KIs ins Spiel: Ähnlich wie ein LLM (Large Language Model) das nächste Wort in einem Satz vorhersagt, nutzt das Voice-Cloning-Modell die drei Sekunden Audio als Kontext, um die akustischen Tokens für den neuen, zu sprechenden Text vorherzusagen. Es lernt im Bruchteil einer Sekunde die einzigartige akustische Signatur – die Tonhöhe, die Resonanz des Vokaltrakts und die Sprechgeschwindigkeit – und wendet diese Parameter auf völlig neue Sätze an.

Neuronale Netze und die Mathematik der Emotionen

Was die Drei-Sekunden-Täuschung so gefährlich macht, ist nicht nur die Reproduktion der reinen Stimmfarbe, sondern die Übernahme der akustischen Umgebung und der Emotion. Wenn der drei Sekunden lange Referenz-Clip in einer hallenden Bahnhofshalle aufgenommen wurde und die Person gehetzt klingt, wird die KI den generierten Text mit exakt demselben Hall und derselben gehetzten Intonation ausgeben. Das System versteht durch Maschinelles Lernen den latenten Raum der Akustik so tiefgreifend, dass es Hintergrundgeräusche und emotionale Zustände als integralen Bestandteil der Stimmidentität begreift und reproduziert.

Diese Fähigkeit zur emotionalen Mimikry hebelt unsere menschlichen Abwehrmechanismen aus. Evolutionsbiologisch sind unsere Gehirne darauf programmiert, der Stimme von vertrauten Personen blind zu vertrauen. Eine Stimme transportiert Dringlichkeit, Angst oder Freude viel direkter als ein geschriebener Text. Wenn die Akustik stimmt, schaltet unser rationales Denken oft in den Hintergrund – ein fataler Nachteil bei Social-Engineering-Angriffen.

Die Symbiose der Systeme: Wenn die Stimme intelligent wird

Die isolierte Fähigkeit, eine Stimme zu klonen, ist bereits beeindruckend. Die wahre Sprengkraft entfaltet sich jedoch in der Kombination mit anderen KI-Technologien. Wenn Angreifer ein Voice-Cloning-Modell mit einem fortschrittlichen Textgenerator wie ChatGPT koppeln, entsteht ein autonomer, interaktiver Agent.

In einem solchen Szenario ruft nicht mehr ein Mensch an, der mühsam Sätze in einen Computer tippt, um sie synthetisieren zu lassen. Stattdessen übernimmt die AI die komplette Gesprächsführung in Echtzeit. Das Sprachmodell analysiert die Antworten des Opfers, generiert kontextbezogene, manipulative Erwiderungen und leitet diese in Millisekunden an den Voice-Cloner weiter. Das Ergebnis ist ein flüssiger, dynamischer Dialog mit der gestohlenen Stimme eines geliebten Menschen, der darauf optimiert ist, das Opfer zu einer bestimmten Handlung zu bewegen.

Das Ende der biometrischen Sicherheit?

Die Auswirkungen dieser Technologie beschränken sich nicht nur auf private Betrugsmaschen, den sogenannten “Enkeltrick 2.0”. Auch die Unternehmenssicherheit steht vor einem massiven Problem. Viele Banken und Institutionen nutzen mittlerweile Stimmbiometrie zur Authentifizierung von Kunden am Telefon. “Meine Stimme ist mein Passwort” war lange Zeit ein Slogan, der für höchste Sicherheit stand.

Mit der Perfektionierung der Drei-Sekunden-Täuschung wird dieses Sicherheitskonzept obsolet. Forscher haben bereits mehrfach demonstriert, dass generierte Stimmen problemlos in der Lage sind, biometrische Sicherheitssysteme von Banken zu überlisten. Die Systeme messen Frequenzen und Muster, die von den neuronalen Netzen der Angreifer mittlerweile mit mathematischer Präzision nachgebildet werden.

Der technologische Gegenangriff: Wie wir uns schützen können

Während die Angriffsvektoren immer ausgefeilter werden, rüstet auch die Verteidigung auf. Der Kampf gegen Audio-Deepfakes ist ein klassisches Katz-und-Maus-Spiel der Cybersicherheit. Um der Drei-Sekunden-Täuschung entgegenzuwirken, arbeiten Forscher an verschiedenen Erkennungsmethoden:

- Spektrale Analyse: Auch wenn eine KI-Stimme für das menschliche Ohr perfekt klingt, hinterlässt der Generierungsprozess oft winzige Artefakte im Hochfrequenzbereich. Spezielle Algorithmen können diese unnatürlichen Muster in der Spektrogramm-Darstellung des Audiosignals erkennen.

- Liveness Detection: Neue Sicherheitssysteme fordern den Anrufer auf, zufällige, schwer auszusprechende Phrasen nachzusprechen oder emotionale Brüche in der Stimme zu erzeugen, an denen aktuelle Echtzeit-Generatoren noch scheitern könnten.

- Audio-Watermarking: Entwickler von legitimen Voice-Cloning-Tools implementieren zunehmend unhörbare Wasserzeichen in die generierten Audiodateien. Diese kryptografischen Signaturen ermöglichen es, synthetisches Audio zweifelsfrei als solches zu identifizieren.

Dennoch bleibt das Problem bestehen, dass Open-Source-Modelle, die von böswilligen Akteuren modifiziert wurden, solche Sicherheitsmechanismen oft umgehen oder gar nicht erst implementieren.

Kurz gesagt (TL;DR)

Durch moderne Künstliche Intelligenz lassen sich menschliche Stimmen mit nur drei Sekunden Audiomaterial täuschend echt und absolut authentisch klonen.

Diese fortschrittlichen neuronalen Netze reproduzieren nicht nur den reinen Klang, sondern imitieren auch emotionale Zustände und akustische Umgebungen perfekt.

In Kombination mit intelligenten Textgeneratoren umgeht diese emotionale Sprachmimikry unsere natürlichen Abwehrmechanismen und macht gezielte Betrugsversuche am Telefon extrem gefährlich.

Fazit

Die Drei-Sekunden-Täuschung markiert einen historischen Wendepunkt in der Art und Weise, wie wir kommunizieren. Die Tatsache, dass ein winziger Schnipsel unserer Stimme ausreicht, um unsere akustische Identität vollständig zu kapern, zwingt uns zu einem radikalen Umdenken. Wir können uns nicht länger auf unsere Sinne verlassen, um die Authentizität unseres Gegenübers am Telefon zu verifizieren. Die rasante Entwicklung im Bereich der generativen KI und der neuronalen Netze hat eine Realität geschaffen, in der technologische Skepsis zur neuen Grundvoraussetzung der digitalen Mündigkeit wird. In Zukunft werden wir nicht nur technologische Abwehrmaßnahmen benötigen, sondern auch neue soziale Protokolle – wie vereinbarte Codewörter innerhalb der Familie oder des Unternehmens –, um in einer Welt, in der Stimmen beliebig reproduzierbar sind, die Wahrheit von der perfekten Illusion unterscheiden zu können.

Häufig gestellte Fragen

Bei der Drei-Sekunden-Täuschung handelt es sich um eine moderne Methode der künstlichen Intelligenz, bei der lediglich ein winziger Audio-Schnipsel ausreicht, um eine menschliche Stimme perfekt zu imitieren. Die Technologie nutzt sogenannte Zero-Shot-Modelle, um nicht nur die Stimmfarbe, sondern auch Emotionen und Hintergrundgeräusche täuschend echt zu reproduzieren. Dadurch können Betrüger am Telefon als vertraute Personen auftreten und gezielte Manipulationen durchführen.

Moderne Systeme verwenden neuronale Netze, die mit riesigen Mengen an Sprachdaten trainiert wurden, um die physikalischen Eigenschaften einer Stimme mathematisch zu simulieren. Ein spezielles Modell zerlegt eine kurze Sprachprobe in akustische Einheiten und sagt ähnlich wie ein Textgenerator die passenden Parameter für neue Sätze voraus. So lernt die KI in Sekundenbruchteilen die einzigartige akustische Signatur einer Person und wendet diese auf beliebige Texte an.

Lange Zeit galt die eigene Stimme als sicheres Passwort für telefonische Bankgeschäfte, da Systeme spezifische Frequenzen und Muster messen. Durch die rasante Entwicklung der generativen KI können Angreifer diese biometrischen Merkmale mittlerweile mit mathematischer Präzision nachbilden und Sicherheitssysteme problemlos überlisten. Daher reicht die reine Stimmerkennung heute nicht mehr aus, um die Identität eines Kunden zweifelsfrei zu bestätigen.

Der beste Schutz gegen moderne Betrugsmaschen am Telefon ist eine gesunde technologische Skepsis bei ungewöhnlichen Anrufen, selbst wenn die Stimme absolut vertraut klingt. Experten raten dringend dazu, innerhalb der Familie oder im Unternehmen geheime Codewörter zu vereinbaren, die bei Geldforderungen oder angeblichen Notfällen abgefragt werden können. Zudem sollte man bei verdächtigen Anrufen auflegen und die Person unter der bekannten Nummer selbst zurückrufen.

Obwohl KI-Stimmen für das menschliche Ohr oft perfekt klingen, hinterlässt der Generierungsprozess meist winzige unnatürliche Muster im Hochfrequenzbereich. Spezielle Algorithmen nutzen die spektrale Analyse, um diese feinen Abweichungen in der Schallwelle sichtbar zu machen und als Fälschung zu markieren. Zusätzlich setzen neue Abwehrmechanismen auf Tests, bei denen Anrufer zufällige Phrasen nachsprechen müssen, an denen aktuelle Echtzeit-Generatoren noch scheitern.

Haben Sie noch Zweifel an Die 3-Sekunden-Täuschung: Wie KI jede vertraute Stimme exakt klont?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.