Wenn Sie im Urlaub den Auslöser Ihres Smartphones drücken, glauben Sie vielleicht, einen flüchtigen Moment der Realität eingefangen zu haben. Das Licht fällt durch die Linse, trifft auf den Sensor und wird als digitales Abbild der Szenerie gespeichert. Doch das Bild, das auf Ihrem hochauflösenden Bildschirm erscheint, ist streng genommen eine Illusion. Die treibende Kraft hinter dieser perfekten Täuschung ist die sogenannte Computational Photography (rechnergestützte Fotografie) – ein hochkomplexer Prozess, der die Grenzen zwischen optischer Physik und algorithmischer Neuschöpfung verschwimmen lässt. Was Sie betrachten, ist kein einfaches Foto mehr, sondern das Ergebnis von Millionen von Berechnungen, die in Bruchteilen einer Sekunde durchgeführt werden.

Die physikalischen Grenzen und der Bayer-Filter

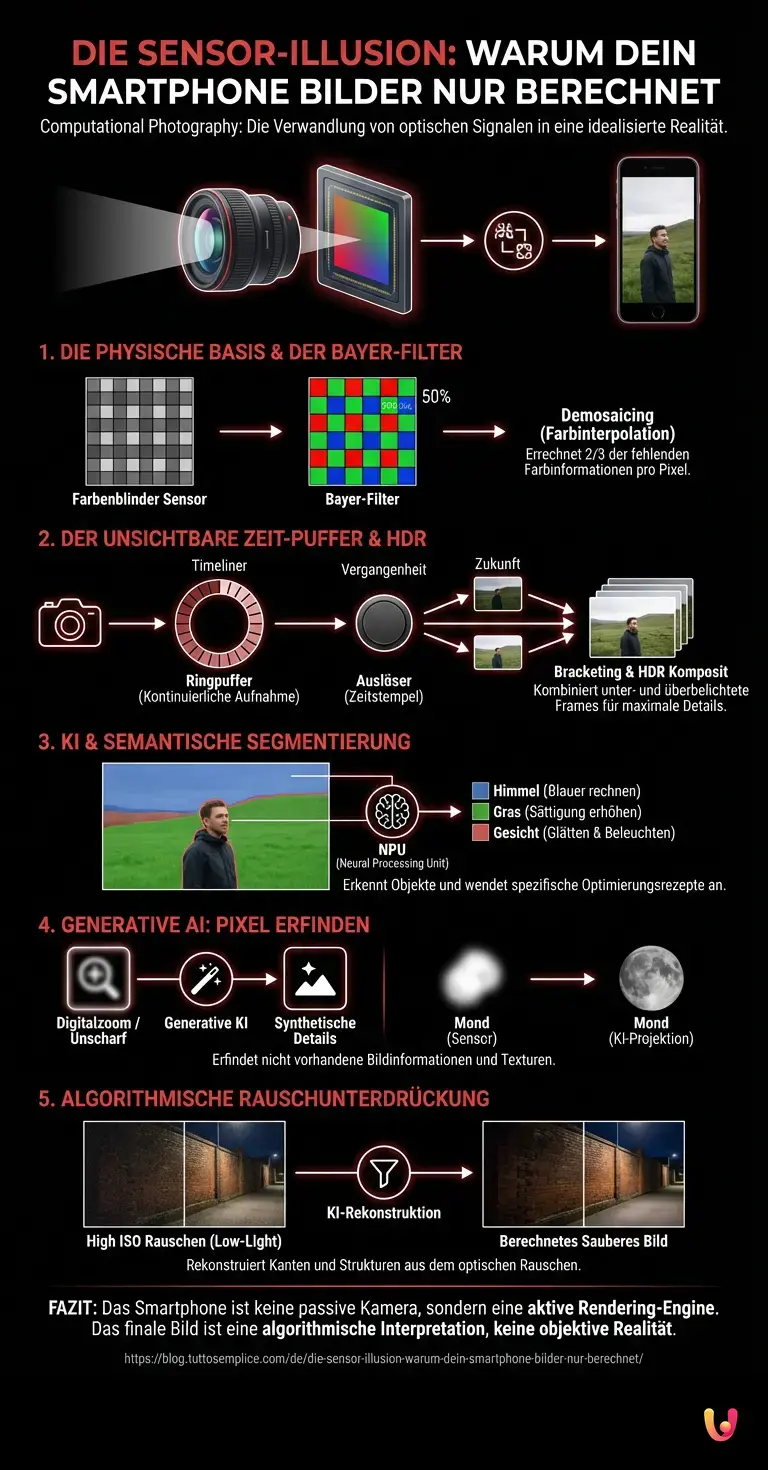

Um zu verstehen, warum das finale Bild von der Realität abweicht, müssen wir auf die Hardware-Ebene hinabsteigen. Ein herkömmlicher Kamerasensor ist farbblind. Er misst lediglich die Intensität der eintreffenden Photonen. Um Farbinformationen zu gewinnen, wird ein sogenannter Bayer-Filter über die Pixel gelegt – ein schachbrettartiges Muster aus roten, grünen und blauen Farbfiltern. Da das menschliche Auge besonders empfindlich für grüne Wellenlängen ist, besteht dieses Muster zu 50 Prozent aus grünen und zu je 25 Prozent aus roten und blauen Filtern.

Das bedeutet: Jeder einzelne Pixel Ihres Kamerasensors erfasst nur eine einzige Farbe. Die fehlenden zwei Farbinformationen für jeden Bildpunkt müssen durch einen mathematischen Prozess namens Demosaicing (Farbinterpolation) erraten werden. Der Image Signal Processor (ISP) analysiert die benachbarten Pixel und berechnet die wahrscheinlichste Farbe. Bereits auf dieser fundamentalen Ebene ist Ihr Foto also zu zwei Dritteln eine mathematische Schätzung und kein direktes physikalisches Abbild.

Der unsichtbare Puffer: Sie fotografieren die Vergangenheit und die Zukunft

In der klassischen Fotografie öffnet sich der Verschluss, Licht fällt auf den Film, der Verschluss schließt sich. Moderne digitale Systeme arbeiten völlig anders. Sobald Sie die Kamera-App öffnen, beginnt der Sensor kontinuierlich Bilder aufzuzeichnen und in einem temporären Ringpuffer (Buffer) zu speichern. Wenn Sie den Auslöser drücken, nehmen Sie in Wahrheit gar kein neues Bild auf. Sie setzen lediglich einen Zeitstempel (Timestamp).

Das System greift auf die Bilder zu, die vor dem Drücken des Auslösers im Puffer lagen, sowie auf einige, die unmittelbar danach aufgenommen wurden. Diese Technik, oft als Zero Shutter Lag (ZSL) bezeichnet, eliminiert die Auslöseverzögerung. Doch sie ist nur der Anfang. Durch das sogenannte Bracketing werden diese verschiedenen Frames – oft ein Dutzend oder mehr – mit unterschiedlichen Belichtungszeiten kombiniert. Unterbelichtete Frames retten die Details in den hellen Wolken, überbelichtete Frames holen die Struktur aus den dunklen Schatten. Das resultierende High Dynamic Range (HDR) Bild ist ein Komposit, das so in der Realität zu keinem einzigen Zeitpunkt existiert hat.

Maschinelles Lernen und Neural Networks: Die neuen Fotografen

Die reine Kombination von Belichtungsreihen reicht jedoch nicht aus, um die physikalischen Limitierungen winziger Smartphone-Linsen zu überwinden. Hier betritt die Künstliche Intelligenz die Bühne. Moderne Prozessoren verfügen über dedizierte Neural Processing Units (NPUs), die ausschließlich für die Ausführung von KI-Algorithmen konzipiert sind.

Durch maschinelles Lernen wurden diese Systeme mit Millionen von professionellen Fotografien trainiert. Sie nutzen komplexe Neural Networks (neuronale Netze), um das Bild nicht nur global, sondern lokal zu analysieren. Dieser Vorgang wird als semantische Segmentierung bezeichnet. Die Algorithmen zerlegen das Bild in seine Bestandteile: Sie erkennen den Himmel, das Gras, die Hautstruktur einer Person, Haare und architektonische Kanten.

Sobald das System versteht, was es sieht, wendet es spezifische Entwicklungsrezepte an. Der Himmel wird künstlich blauer und kontrastreicher gerechnet, das Gras erhält eine sattere grüne Sättigung, und Gesichter werden durch spezielle Filter geglättet und optimal ausgeleuchtet – selbst wenn die Person im Schatten stand. Das System entscheidet autonom, wie die Realität aussehen sollte, basierend auf den ästhetischen Präferenzen, die ihm während des Trainings antrainiert wurden.

Generative AI: Wenn fehlende Pixel einfach erfunden werden

Der vielleicht radikalste Eingriff in die Authentizität eines Fotos geschieht durch Generative AI. Wenn Sie bei einem Smartphone ohne optisches Teleobjektiv digital heranzoomen, vergrößern Sie im Grunde nur die vorhandenen Pixel. Das Ergebnis wäre normalerweise ein unscharfer, pixeliger Brei. Doch moderne Kamerasysteme nutzen AI, um dieses Problem zu lösen, indem sie schlichtweg neue Bildinformationen erfinden.

Die Algorithmen analysieren die unscharfen Kanten und Texturen und generieren synthetische Pixel, die nahtlos in das Bild eingefügt werden. Ein prominentes Beispiel hierfür ist die Astrofotografie mit Smartphones. Wenn Sie den Mond fotografieren, erkennt die Software den weißen, unscharfen Fleck am Nachthimmel. Anstatt nur den Kontrast zu erhöhen, greift das System auf eine interne Datenbank oder ein trainiertes Modell zurück und projiziert hochauflösende Kraterstrukturen auf den weißen Fleck. Das Foto, das Sie Ihren Freunden zeigen, enthält Texturen, die Ihr Kamerasensor niemals physisch erfasst hat. Es ist eine hybride Kreation aus dem spärlichen Licht, das den Sensor traf, und der Vorstellungskraft der KI.

LLMs und multimodale Modelle: Die Zukunft der Bildinterpretation

Die Entwicklung bleibt nicht bei einfachen Bildverbesserungen stehen. Die Architektur, die hinter Textgeneratoren wie ChatGPT steht, revolutioniert zunehmend auch die Bildverarbeitung. Ein LLM (Large Language Model) basiert auf sogenannten Transformern – einer Netzwerkarchitektur, die exzellent darin ist, Kontexte und Zusammenhänge in großen Datenmengen zu verstehen.

Diese Transformer-Architektur wird nun als Vision Transformer (ViT) in der Bildverarbeitung eingesetzt. Anstatt nur isolierte Pixelgruppen zu betrachten, analysiert das System das gesamte Bild im Kontext. Es versteht die Szene semantisch: “Ein Hund rennt bei Sonnenuntergang über einen nassen Strand”. Durch dieses tiefgreifende, multimodale Verständnis kann die Kamera Parameter wie Weißabgleich, Schärfentiefe (künstliches Bokeh) und Rauschunterdrückung mit einer Präzision anpassen, die der eines menschlichen Bildbearbeiters in Photoshop gleicht. Die Kamera fotografiert nicht mehr nur; sie interpretiert und inszeniert die Szene in Echtzeit.

Die Rauschunterdrückung als algorithmische Rekonstruktion

Ein weiteres Feld, in dem die Realität stark modifiziert wird, ist die Fotografie bei schlechten Lichtverhältnissen (Low-Light). Wenn wenig Licht vorhanden ist, muss die Empfindlichkeit des Sensors (ISO) erhöht werden, was zu einem starken Bildrauschen führt – zufälligen Farb- und Helligkeitsabweichungen der Pixel. Früher wurde dieses Rauschen durch einfache Weichzeichner kaschiert, was zu detailarmen, “matschigen” Bildern führte.

Heute analysieren KI-Modelle das verrauschte Bild und rekonstruieren die ursprünglichen Kanten und Texturen. Das System trennt das Rauschen vom eigentlichen Signal, indem es vorhersagt, wie das Bild ohne das Rauschen aussehen müsste. Wenn Sie nachts eine Backsteinmauer fotografieren, stellt die KI die Fugen und die raue Oberfläche der Steine wieder her, selbst wenn diese im optischen Rauschen völlig untergegangen waren. Die Mauer auf Ihrem Foto sieht gestochen scharf aus, aber die exakte Anordnung der Poren im Stein ist ein algorithmisches Konstrukt, keine optische Aufzeichnung.

Kurz gesagt (TL;DR)

Moderne Smartphone-Kameras fangen keine echte Realität ein, sondern erschaffen durch die rechnergestützte Fotografie in Sekundenbruchteilen eine perfekte digitale Illusion aus Millionen von Berechnungen.

Da winzige Kamerasensoren physikalisch stark limitiert sind, schätzen Algorithmen fehlende Farbinformationen und setzen das finale Bild aus vielen gepufferten Aufnahmen künstlich zusammen.

Zusätzlich optimieren künstliche Intelligenz und neuronale Netze gezielt einzelne Bildbereiche und erfinden beim digitalen Zoomen sogar völlig neue Pixel für ein perfektes Ergebnis.

Fazit

Ihre neuesten Urlaubsfotos sind Meisterwerke der modernen Informatik, aber sie sind keine objektiven Dokumente der Realität. Von der grundlegenden Farbinterpolation des Bayer-Filters über das Zusammenfügen von Zeitlinien im Puffer bis hin zur semantischen Neugestaltung durch komplexe neuronale Netze – jeder Schritt im Image Signal Processor entfernt das finale Bild weiter von den physikalischen Photonen, die durch die Linse fielen.

Die Kamera Ihres Smartphones ist längst kein passives Aufzeichnungsgerät mehr, sondern eine aktive Rendering-Engine. Sie nutzt fortschrittlichste Algorithmen, um eine idealisierte Version des Moments zu erschaffen. Eine Version, die schärfer, farbenfroher und dynamischer ist als das, was das menschliche Auge in diesem Augenblick tatsächlich wahrgenommen hat. Diese technologische Evolution hat die Fotografie demokratisiert und ermöglicht es jedem, unter schwierigsten Bedingungen atemberaubende Bilder zu erstellen. Doch man sollte sich stets bewusst sein: Das Pixel-Geheimnis bleibt bestehen. Was wir auf unseren Bildschirmen bewundern, ist nicht die ungeschminkte Wahrheit, sondern die faszinierende, algorithmische Interpretation unserer Erinnerungen.

Häufig gestellte Fragen

Moderne Handykameras nutzen rechnergestützte Fotografie, um Bilder in Echtzeit massiv zu optimieren. Durch künstliche Intelligenz werden verschiedene Motive wie blauer Himmel, grünes Gras oder menschliche Gesichter erkannt und automatisch verschönert. Das finale Foto ist somit eine idealisierte, berechnete Version des Moments und kein rein physikalisches Abbild der echten Welt. Diese technologische Entwicklung ermöglicht es jedem Nutzer, ohne Fachwissen beeindruckende Aufnahmen zu erstellen.

Sobald die Kamera-App auf dem Gerät geöffnet wird, speichert der Sensor kontinuierlich Bilder in einem unsichtbaren Zwischenspeicher. Beim Drücken des Auslösers wird lediglich ein Zeitstempel gesetzt, woraufhin das System bereits vergangene und unmittelbar folgende Aufnahmen auswählt. Diese Technik eliminiert die Auslöseverzögerung und kombiniert mehrere Belichtungen zu einem perfekten Gesamtergebnis. Dadurch verpassen Sie nie wieder den entscheidenden Augenblick bei schnellen Bewegungen.

Dieser Begriff beschreibt den hochkomplexen Prozess, bei dem intelligente Software und Algorithmen die physikalischen Grenzen winziger Smartphone-Linsen ausgleichen. Anstatt nur eintreffendes Licht passiv aufzuzeichnen, berechnet der Bildprozessor fehlende Farbinformationen und kombiniert verschiedene Belichtungsreihen. Maschinelles Lernen sorgt dabei für eine automatische Bildverbesserung, die weit über klassische Optik hinausgeht. Das Gerät fungiert somit eher als aktive Rendering-Engine denn als simpler Fotoapparat.

Wenn das optische Objektiv an seine physikalischen Grenzen stößt, greifen moderne Mobiltelefone auf generative künstliche Intelligenz zurück. Die integrierte Software analysiert unscharfe Kanten und erfindet passgenaue synthetische Bildpunkte einfach hinzu. Dies zeigt sich besonders eindrucksvoll bei der Astrofotografie, wo fehlende Strukturen auf Himmelskörpern durch trainierte Modelle künstlich ergänzt werden. Das Resultat ist eine hybride Kreation aus realem Lichteinfall und algorithmischer Vorstellungskraft.

Bei Dunkelheit muss die Empfindlichkeit des winzigen Kamerasensors stark erhöht werden, was unweigerlich zu störendem Bildrauschen führt. Spezielle KI-Modelle analysieren diese optischen Störungen und trennen das Rauschen vom eigentlichen Bildsignal. Anschließend rekonstruiert das System die ursprünglichen Kanten sowie feine Texturen, sodass selbst bei Nachtaufnahmen gestochen scharfe Details sichtbar bleiben. Eine scheinbar perfekt fotografierte Backsteinmauer in der Nacht ist somit oft ein reines algorithmisches Konstrukt.

Haben Sie noch Zweifel an Die Sensor-Illusion: Warum dein Smartphone Bilder nur berechnet?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Digitale Bildverarbeitung (Wikipedia)

- Bayer-Sensor und die Funktionsweise der Farbinterpolation (Wikipedia)

- High Dynamic Range Image: Erzeugung und Verarbeitung von HDR-Bildern (Wikipedia)

- Bildsegmentierung und semantische Analyse in der digitalen Bildverarbeitung (Wikipedia)

- Forschung und Standards zur Künstlichen Intelligenz (National Institute of Standards and Technology, US-Regierung)

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.