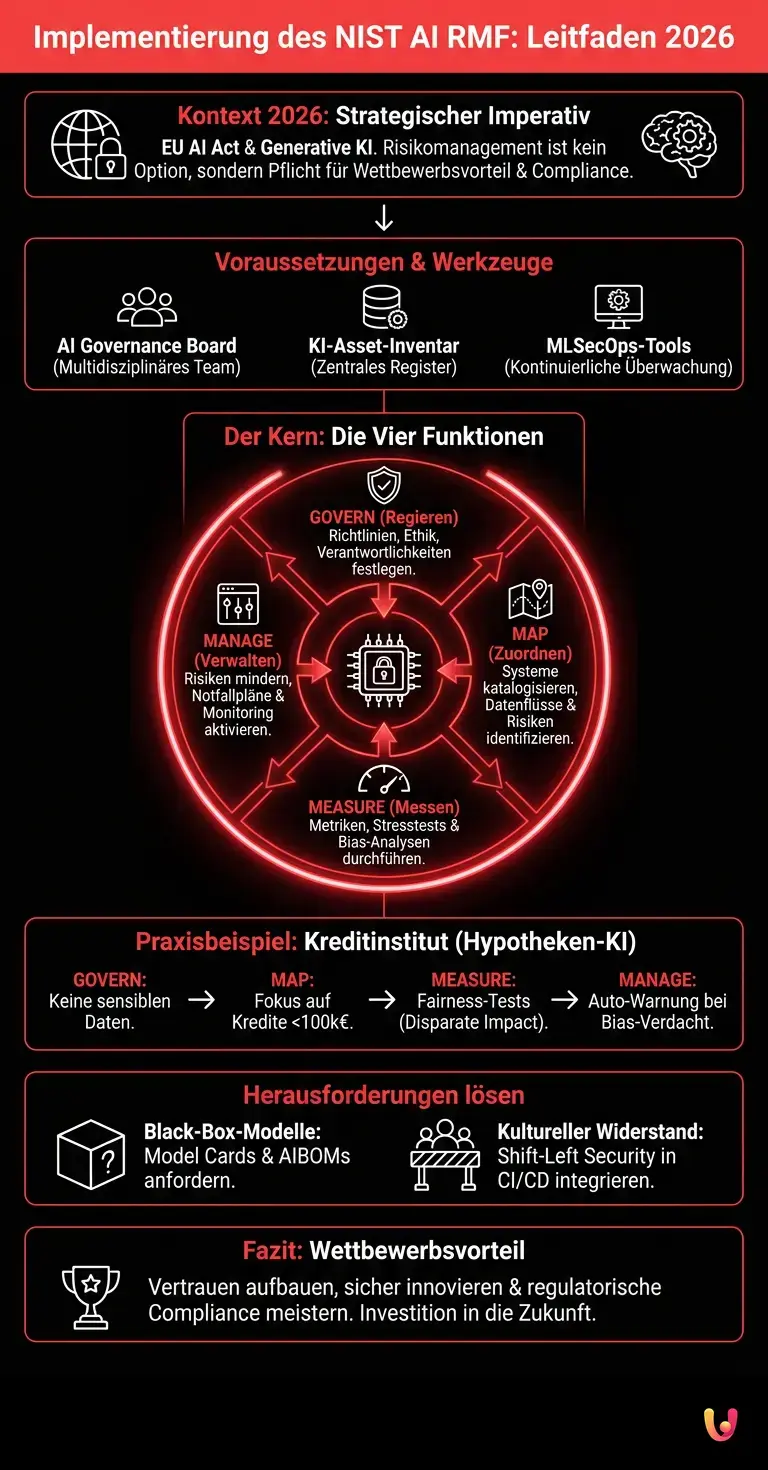

Die Integration des NIST AI RMF (Artificial Intelligence Risk Management Framework) stellt heute den Eckpfeiler für jede Organisation dar, die KI-Systeme entwickeln, erwerben oder integrieren möchte. Im technologischen Kontext des Jahres 2026, geprägt von der vollen Funktionsfähigkeit des EU AI Act und der Verbreitung komplexer generativer Modelle , ist Risikomanagement keine Option mehr, sondern ein strategischer Imperativ. Diese technische Anleitung bietet einen strukturierten Weg zur Implementierung des Frameworks und verwandelt die Einhaltung gesetzlicher Vorschriften durch eine solide KI-Governance in einen greifbaren Wettbewerbsvorteil.

Einführung in das KI-Risikomanagement

Die Einführung des NIST AI RMF stellt im Jahr 2026 den globalen Standard für die sichere Steuerung von künstlicher Intelligenz dar. Dieses Framework ermöglicht es Unternehmen, KI-bezogene Risiken zu erfassen, zu messen und zu managen und so die Einhaltung gesetzlicher Vorschriften und die Zuverlässigkeit technologischer Systeme zu gewährleisten.

Laut offizieller Dokumentation des National Institute of Standards and Technology ist das Framework branchenunabhängig und skalierbar konzipiert. Es handelt sich nicht um eine einfache Sicherheits-Checkliste, sondern um einen kulturellen Wandel, der die gesamte Unternehmensstruktur betrifft, vom Vorstand bis zu den Entwicklern von Machine-Learning-Anwendungen. Im Jahr 2026 erfordert die Angleichung des traditionellen NIST RMF an die Besonderheiten der künstlichen Intelligenz ein tiefes Verständnis von Konzepten wie Modellinterpretierbarkeit, Datenschutz bei Trainingsdaten und der Minderung algorithmischer Verzerrungen.

Voraussetzungen und Instrumente für die Compliance

Vor der Implementierung des NIST AI RMF ist die Etablierung einer soliden unternehmensweiten KI-Governance unerlässlich. Voraussetzungen hierfür sind die Bildung eines multidisziplinären Ethikkomitees, die Einführung von Software für das algorithmische Auditing und die Kartierung der bestehenden Dateninfrastruktur.

Um den Prozess erfolgreich zu starten, müssen Organisationen über ein Ökosystem aus geeigneten Werkzeugen und Kompetenzen verfügen. Der „Zero-to-Hero“-Ansatz erfordert die Vorbereitung des unternehmerischen Umfelds durch die folgenden operativen Schritte:

- Einrichtung des AI Governance Boards: Ein funktionsübergreifendes Team aus Data Scientists, Rechtsberatern, CISO und Unternehmensvertretern.

- Inventarisierung der KI-Assets: Erstellung eines zentralen Registers (KI-Register) aller eingesetzten Modelle, einschließlich der Dienste von Drittanbietern (Shadow AI).

- Einführung von MLSecOps-Tools: Integration von Plattformen zur kontinuierlichen Überwachung der Leistung und Sicherheit von Modellen im Produktionsbetrieb.

| Kategorie Werkzeug | Funktion im Framework | Anwendungsbeispiel 2026 |

|---|---|---|

| KI-TRiSM-Plattformen | Überwachung und Vertrauen | Echtzeit-Erkennung von Data-Drift und Bias. |

| GRC-Software (Governance, Risiko, Compliance) | Richtlinienverwaltung | Automatische Abstimmung zwischen internen Richtlinien und den Anforderungen des EU-KI-Gesetzes. |

| LLM-Schwachstellenscanner | Technische Sicherheit | Prävention von Prompt-Injection-Angriffen und Datenlecks. |

Der Kern des Frameworks: Die vier Funktionen

Die Architektur des NIST AI RMF basiert auf vier miteinander verbundenen Funktionen: Govern (Regieren), Map (Zuordnen), Measure (Messen) und Manage (Verwalten). Diese zirkuläre und kontinuierliche Struktur stellt sicher, dass der Lebenszyklus der künstlichen Intelligenz ständig überwacht wird, wodurch Verzerrungen und operative Schwachstellen reduziert werden.

Diese Funktionen sind nicht sequenziell, sondern arbeiten synergetisch zusammen. Ihre Implementierung erfordert strenge Methoden und eine nachvollziehbare Dokumentation, die unerlässlich ist, um etwaige Konformitätsprüfungen zu bestehen.

Regieren: Eine Sicherheitskultur schaffen

Die Govern-Funktion des NIST AI RMF legt Unternehmensrichtlinien und rechtliche Verantwortlichkeiten fest. Sie bildet das Herzstück der KI-Governance , da sie KI-Strategien mit ethischen Werte, Risikobereitschaft und geltenden Vorschriften in Einklang bringt.

In dieser Phase muss die Unternehmensführung klar definieren, wer für jedes KI-System verantwortlich ist. Zu den wichtigsten Maßnahmen gehören die Erstellung eines Ethikkodex für KI, die Festlegung akzeptabler Risikostufen (Risk Appetite Statement) und die Schaffung transparenter Kommunikationskanäle zur Meldung algorithmischer Anomalien ohne Angst vor Repressalien.

Map: Risiken von Modellen identifizieren

Im Rahmen der „Map“-Phase des NIST AI RMF katalogisieren Organisationen jedes eingesetzte KI-System. Dieser Schritt erfordert die Dokumentation der Trainingsdaten, der Modellgrenzen und der potenziellen negativen Auswirkungen auf Endnutzer oder das Geschäft.

Die Kartierung ist oft die komplexeste Phase. Branchenstatistiken zufolge kennen über 60 % der Unternehmen das tatsächliche Ausmaß ihrer KI-Angriffsfläche nicht. Folgendes muss dokumentiert werden:

- Der vorgesehene Verwendungszweck (Intended Use) und die vorhersehbaren Fehlanwendungen.

- Die Herkunft und Qualität der Trainings- und Validierungsdatensätze.

- Die Software-Lieferkette (AI Bill of Materials – AIBOM).

Maßnahme: Bewertung der Auswirkungen von Künstlicher Intelligenz

Die Messphase des NIST AI RMF verwendet quantitative und qualitative Metriken, um die Zuverlässigkeit von Modellen zu testen. Sie umfasst Stresstests, Biasanalysen und Robustheitsbewertungen und stellt sicher, dass die KI innerhalb der festgelegten Sicherheitsparameter arbeitet.

Die Messungen müssen objektiv und wiederholbar sein. Die technischen Teams müssen Metriken für Fairness (Gerechtigkeit), Genauigkeit, Interpretierbarkeit und Widerstandsfähigkeit gegen gegnerische Angriffe (Adversarial Machine Learning) implementieren. Der Einsatz von KI-spezifischem Red Teaming ist 2026 zum De-facto-Standard geworden, um die Robustheit generativer Modelle vor der Veröffentlichung in der Produktion zu validieren.

Verwalten: Schwachstellen mindern

Mit der Funktion „Manage“ (Verwalten) bietet das NIST AI RMF Richtlinien zur Bewältigung der identifizierten Risiken. Unternehmen implementieren technische Kontrollen, Fallback-Pläne und kontinuierliches Monitoring, um KI-Systeme bei Anomalien zu deaktivieren oder zu korrigieren.

Ein aktives Risikomanagement erfordert die Erstellung von Playbooks für die Reaktion auf KI-Vorfälle. Wenn ein Modell diskriminierende Ergebnisse oder schädliche Halluzinationen produziert, müssen Sicherheitsschalter- Systeme automatisch eingreifen, um den Dienst sicher herunterzufahren (Graceful Degradation) oder die Kontrolle an einen menschlichen Bediener zu übergeben (Human-in-the-Loop).

Praktische Beispiele für die unternehmerische Einführung

Die Anwendung des NIST AI RMF in realen Szenarien beweist seine Vielseitigkeit. Ob es sich um einen LLM-basierten Chatbot für den Kundenservice oder um Algorithmen für die Finanzbewertung handelt, das Framework standardisiert die Validierungs- und Freigabeprozesse.

Betrachten wir ein Kreditinstitut, das ein neues, auf maschinellem Lernen basierendes System zur Genehmigung von Hypotheken implementiert. Unter Verwendung des Frameworks:

- Governance: Das Komitee legt fest, dass das Modell keine sensiblen demografischen Variablen verwenden darf.

- Karte: Es wird dokumentiert, dass das Modell nur für Kredite unter 100.000 Euro verwendet wird, und die verwendeten historischen Daten werden kartiert.

- Messung: Es werden statistische Tests durchgeführt, um das Fehlen von Verzerrungen gegenüber bestimmten Minderheiten zu überprüfen (Disparate-Impact-Analyse).

- Verwalten: Es wird eine automatische Warnung eingerichtet, wenn die Ablehnungsrate für eine bestimmte demografische Gruppe einen kritischen Schwellenwert überschreitet, wodurch eine manuelle Überprüfung ausgelöst wird.

Lösung häufig auftretender Probleme

Bei der Integration des NIST AI RMF stoßen Unternehmen häufig auf Hindernisse wie mangelnde Transparenz seitens der Anbieter oder schlechte Datenqualität. Die Lösung dieser Probleme erfordert Audits durch Dritte und die kontinuierliche Aktualisierung der NIST RMF -Richtlinien.

| Problembehebung | Strategische Lösung |

|---|---|

| Undurchsichtigkeit von Drittanbieter-Modellen (Black Box) | Vertraglich die Model Cards und AIBOMs von den Anbietern vor der Anschaffung anfordern. |

| Kultureller Widerstand von Entwicklungsteams | Integrieren Sie Risikokontrollen direkt in die CI/CD-Pipelines (Shift-Left Security), um die Veröffentlichung nicht zu verlangsamen. |

| Schwierigkeiten bei der Quantifizierung des Reputationsrisikos | Verwenden Sie Frameworks zur Szenariensimulation und beziehen Sie externe Stakeholder (z. B. Verbraucherverbände) in die Messphase ein. |

Schlussfolgerungen

Die erfolgreiche Implementierung des NIST AI RMF im Jahr 2026 ist nicht nur eine Compliance-Pflicht, sondern ein Wettbewerbsvorteil. Unternehmen, die die KI-Governance beherrschen, bauen Vertrauen auf, innovieren sicher und bereiten sich auf zukünftige regulatorische Entwicklungen vor.

Das Risikomanagement im Bereich der künstlichen Intelligenz ist ein kontinuierlicher Prozess, kein Endziel. Durch die Anwendung der Funktionen „Govern“, „Map“, „Measure“ und „Manage“ können IT-Organisationen den Wert neuer Technologien maximieren und gleichzeitig ihre Nutzer, Daten und ihren Ruf auf dem globalen Markt schützen. Die heutige Investition in strukturierte Frameworks wie das des NIST stellt die beste Absicherung gegen die technologischen Unsicherheiten von morgen dar.

Häufig gestellte Fragen

Das NIST AI RMF-Framework stellt einen globalen Standard für das Risikomanagement im Bereich der künstlichen Intelligenz dar. Dieses System ermöglicht es Organisationen, Modelle zu erfassen, zu messen und zu steuern, wodurch die Einhaltung europäischer Vorschriften gewährleistet und die allgemeine technologische Sicherheit verbessert wird.

Die Architektur basiert auf vier kontinuierlichen und synergetischen Funktionen: Govern, Map, Measure und Manage. Diese Phasen ermöglichen die Festlegung ethischer Richtlinien, die Katalogisierung der eingesetzten Systeme, die Bewertung der Auswirkungen anhand objektiver Metriken und die zeitnahe Minderung operativer Schwachstellen.

Um den Prozess einzuleiten, ist die Etablierung einer soliden Unternehmensführung durch die Schaffung eines multidisziplinären Ethikkomitees unerlässlich. Anschließend müssen die bestehende Dateninfrastruktur erfasst und spezifische Instrumente für die kontinuierliche Überwachung der Leistung und Sicherheit der Modelle eingesetzt werden.

Um die mangelnde Transparenz externer Anbieter zu überwinden, empfiehlt das Framework, vertraglich spezifische Dokumentationen vor der Beschaffung anzufordern. Werkzeuge wie Model Cards und Stücklisten der Software sind unerlässlich, um die Grenzen und Trainingsdaten undurchsichtiger Modelle zu verstehen.

Die Einführung dieses Frameworks standardisiert die Prozesse der Validierung und des Risikomanagements und erleichtert so die Einhaltung der europäischen Rechtsvorschriften erheblich. Mithilfe spezieller Governance-Software können Unternehmen interne Richtlinien in Maßnahmen umsetzen, die den internationalen Richtlinien entsprechen.

Haben Sie noch Zweifel an Implementierung des NIST AI RMF im Unternehmen: Leitfaden 2026?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.