Die Entwicklung der generativen künstlichen Intelligenz hat mit der Einführung von Vitruvian-1 einen kritischen Wendepunkt erreicht. In diesem Zusammenhang ist das Verständnis der Alignment-Mechanismen von grundlegender Bedeutung. Die Hauptkomponente dieser Revolution, Vitruvian-1, zeigt, wie die Nachoptimierung nach dem Training den entscheidenden Unterschied zwischen einem Modell, das zufälligen Text generiert, und einem zuverlässigen Assistenten ausmacht. In dieser technischen Anleitung werden wir die algorithmische Architektur untersuchen, die es diesen neuronalen Netzen ermöglicht, herausragende Leistungen zu erbringen, und dabei die Belohnungsmechanismen und Aktualisierungsrichtlinien detailliert analysieren.

Einführung in das Reinforcement Learning in Sprachmodellen

Die Anwendung von Reinforcement Learning mit PPO beim Fine-Tuning fortschrittlicher Sprachmodelle stellt den Standard dar, um künstliche Intelligenz an menschliche Absichten anzupassen. Dieser Prozess optimiert neuronale Netze durch einen Ausgleich von Exploration und Exploitation und gewährleistet sichere, kohärente und hochkontextbezogene Antworten.

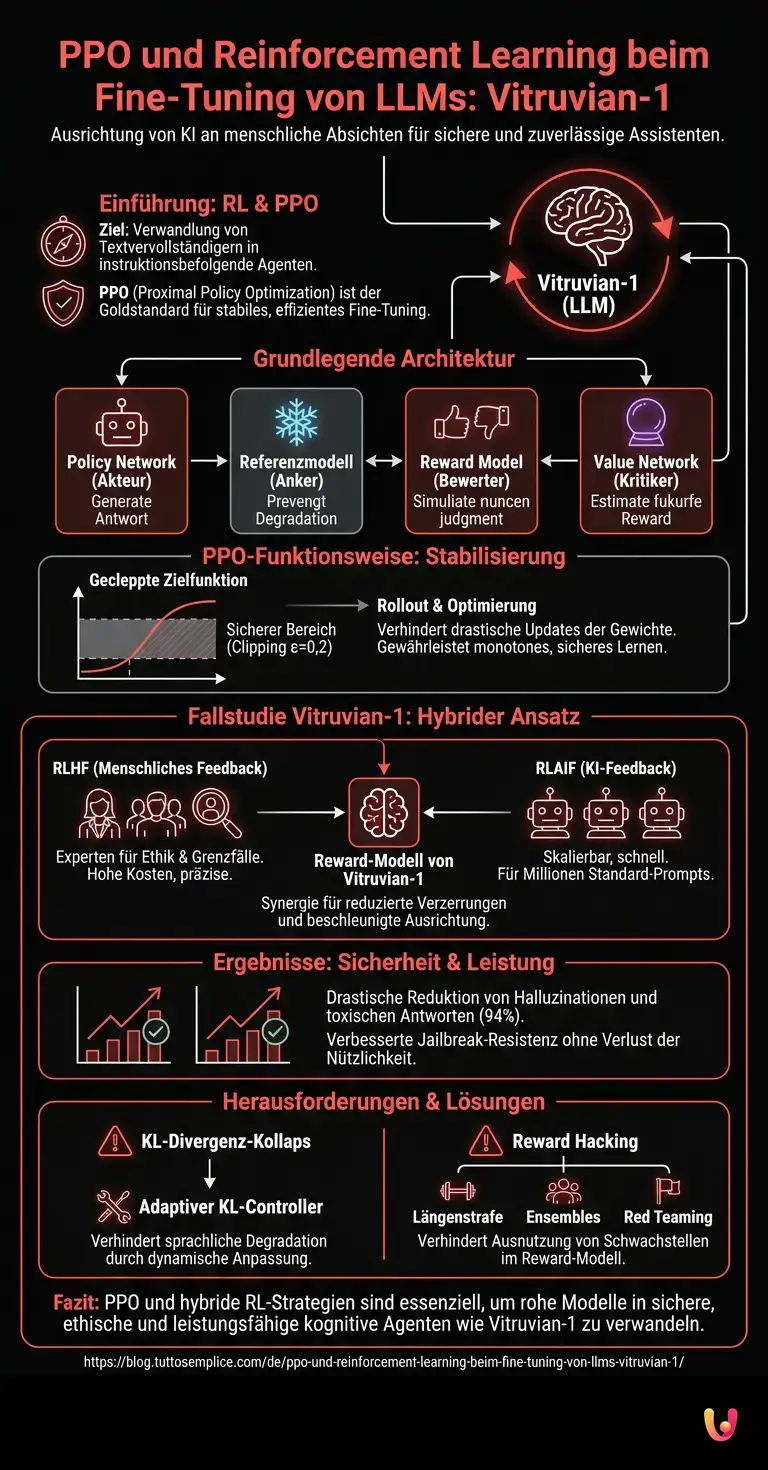

Das Paradigma des Reinforcement Learning (RL), angewendet auf die Verarbeitung natürlicher Sprache (Natural Language Processing, NLP), hat die Art und Weise, wie wir das Training von großen Sprachmodellen (Large Language Models, LLM) konzipieren, grundlegend verändert. Anfangs werden die Modelle durch selbstüberwachtes Lernen (Next-Token Prediction) trainiert und erwerben so umfassende sprachliche Kenntnisse, aber kein wirkliches Verständnis von „Korrektheit“ oder „Sicherheit“. Hier kommt das RL-basierte Fine-Tuning ins Spiel. Laut der offiziellen Dokumentation führender Informatikforschungslabore besteht das Ziel darin, einen Textvervollständiger in einen Agenten zu verwandeln, der komplexe Anweisungen befolgen kann (Instruction Following).

Der Proximal Policy Optimization (PPO) -Algorithmus hat sich als Goldstandard für diese Phase etabliert. Im Vergleich zu seinen Vorgängern wie TRPO (Trust Region Policy Optimization) bietet PPO ein beispielloses Gleichgewicht zwischen Implementierungsaufwand, Stichprobeneffizienz und Stabilität während des Trainings. Im Kontext von 2026 ist der Einsatz von PPO keine experimentelle Methode mehr, sondern eine etablierte Ingenieurpraxis für die Produktion von Foundation-Modellen.

Voraussetzungen und grundlegende Architektur

Um Reinforcement Learning mit PPO beim Fine-Tuning komplexer Architekturen zu verstehen, ist die Kenntnis der Konzepte von Policy Network und Reward Model unerlässlich. Diese mathematischen und algorithmischen Werkzeuge ermöglichen die Quantifizierung der Qualität der von der künstlichen Intelligenz erzeugten Ergebnisse.

Bevor wir uns in die mathematischen Details des PPO-Algorithmus vertiefen, müssen wir die Infrastruktur skizzieren, auf der er arbeitet. Das Fine-Tuning mittels RL erfordert die gleichzeitige Zusammenarbeit verschiedener neuronaler Netze, die im Tandem zusammenarbeiten, um Text zu generieren, zu bewerten und zu optimieren.

- Policy Network (Akteursmodell): Das Sprachmodell selbst (z. B. Vitruvian-1) generiert die Antworten. Im Kontext des Reinforcement Learning (RL) ist seine „Policy“ die Wahrscheinlichkeitsverteilung über die nachfolgenden Token, gegeben einen bestimmten Zustand (den Prompt).

- Referenzmodell: Eine eingefrorene Kopie des ursprünglichen Modells. Es dient als Ankerpunkt für die Berechnung der KL-Divergenz und verhindert, dass das Policy-Netzwerk während der Optimierung sprachlich degradiert.

- Belohnungsmodell: Ein speziell trainiertes neuronales Netzwerk, das eine skalare Bewertung der Qualität der generierten Antwort vornimmt.

- Value Network (Das kritische Modell): Schätzt die erwartete Belohnung (zukünftige Belohnung) von einem bestimmten Zustand, was für die Berechnung des Vorteils (Advantage) im PPO-Algorithmus unerlässlich ist.

Die Rolle des Belohnungsmodells

Das Reward Model ist die Bewertungs-Engine des Reinforcement Learning mit PPO beim Fine-Tuning von KI-Systemen. Es weist den generierten Antworten einen skalaren Wert zu und simuliert so das menschliche Urteil, um den Algorithmus zu wünschenswerten und sicheren Verhaltensweisen zu lenken.

Die Erstellung eines robusten Reward-Modells ist oft die teuerste und komplexeste Phase. Basierend auf Branchenzahlen wird dieses Modell auf einem Datensatz paarweiser Vergleiche (Pairwise Comparisons) trainiert. Den Annotatoren (menschlich oder KI) werden zwei verschiedene Antworten auf dieselbe Eingabeaufforderung gezeigt, und sie werden gebeten, die bessere auszuwählen. Das Reward-Modell lernt, eine Kreuzentropie-Verlustfunktion zu minimieren, die auf der Differenz der Punktzahlen zwischen der Gewinner- und der Verliererantwort basiert. Dieser skalare Wert wird zum Belohnungssignal, das der PPO-Algorithmus zu maximieren versucht.

Policy-Gradient-Algorithmen

Policy-Gradient-Algorithmen sind grundlegend für das Reinforcement Learning mit PPO beim Fine-Tuning von LLMs. Sie aktualisieren direkt die Aktionswahrscheinlichkeiten des Modells und maximieren so die erwarteten Belohnungen, ohne Instabilitäten während des Trainings des neuronalen Netzes zu verursachen.

Im Gegensatz zu wertbasierten Methoden (wie Q-Learning) optimieren Policy-Gradient-Methoden direkt die parametrisierte Policy-Funktion. Sie berechnen den Gradienten des erwarteten Ziels bezüglich der Netzwerkparameter und aktualisieren diese mittels Gradientenabstieg. Standardmäßige Policy-Gradient-Methoden sind jedoch bekanntermaßen instabil: Eine zu große Aktualisierung der Gewichte kann die Policy zerstören, was zu einem Phänomen führt, das als „katastrophales Vergessen“ bekannt ist. PPO löst dieses Problem, indem es eine mathematische Beschränkung auf die Größe der Aktualisierung einführt.

Die Funktionsweise von PPO beim Fine-Tuning

Das Herzstück des Reinforcement Learning mit PPO beim Fine-Tuning von künstlichen Intelligenzen liegt in seiner „geclippten“ Zielfunktion. Dieser Mechanismus verhindert zu drastische Aktualisierungen der Gewichte und gewährleistet so ein stabiles und progressives Lernen während der Modelloptimierung.

Der Lebenszyklus eines PPO-Updates gliedert sich in verschiedene Phasen ( Rollout und Optimierung genannt). Während dieser Phasen sammelt das System Erfahrungen durch Interaktion mit der Umgebung (Benutzer-Prompts) und nutzt diese Erfahrungen anschließend zur Verbesserung seiner internen Parameter.

Generierung und Bewertung von Antworten

Während der aktiven Phase des Reinforcement Learning mit PPO beim Fine-Tuning eines LLM generiert das Modell mehrere Antworten auf einen einzelnen Prompt. Diese werden dann vom Reward Model bewertet, wodurch der für das Update benötigte dynamische Datensatz erstellt wird.

Der Prozess beginnt mit der Stichprobenentnahme eines Batches von Prompts aus dem Trainingsdatensatz . Das Policy-Netzwerk generiert für jeden Prompt eine Antwort. Gleichzeitig berechnet das Referenzmodell die Wahrscheinlichkeiten für dieselbe Token-Sequenz. Das Reward-Modell analysiert die endgültige Antwort und vergibt eine Punktzahl. Von dieser Punktzahl wird eine Strafe abgezogen, die proportional zur KL-Divergenz zwischen den Wahrscheinlichkeiten des Policy-Netzwerks und des Referenzmodells ist. Diese dynamische Strafe stellt sicher, dass das Modell nicht unverständlichen Text generiert, nur um die Belohnung zu maximieren.

Optimierung und Clipping-Funktion

Die Clipping-Funktion ist die wichtigste Neuerung des Reinforcement Learning mit PPO beim Fine-Tuning von neuronalen Netzen. Durch die Begrenzung des Verhältnisses zwischen der neuen und der alten Policy wird ein Leistungsabfall verhindert und das Training innerhalb sicherer Grenzen gehalten.

Nachdem die Vorteile (mittels Generalized Advantage Estimation – GAE) berechnet wurden, aktualisiert PPO die Gewichte. Die zentrale Gleichung von PPO berechnet das Verhältnis ( Ratio ) zwischen der Wahrscheinlichkeit der Aktion unter der neuen Policy und der unter der alten Policy. Weicht dieses Verhältnis zu stark von 1 ab (üblicherweise über einer Marge von ε = 0,2), wird die Zielfunktion „geclippt“. Das bedeutet, dass der Algorithmus Updates ignoriert, die das Verhalten des Modells in einem einzelnen Schritt zu stark verändern würden, wodurch eine monotone und sichere Konvergenz gewährleistet wird.

Die Fallstudie Vitruvian-1

Die Analyse des Reinforcement Learning mit PPO beim Fine-Tuning von Vitruvian-1 zeigt einen hochmodernen hybriden Ansatz. Das Modell nutzt sowohl RLHF (menschliches Feedback) als auch RLAIF (automatisches Feedback), um ein bisher unerreichtes Maß an Genauigkeit und Sicherheit im IT-Bereich zu erreichen.

Vitruvian-1 repräsentiert den aktuellen Stand der Technik bei der praktischen Anwendung dieser Algorithmen. Entwickelt für kritische Aufgaben in den Bereichen Medizin, Recht und fortgeschrittene Programmierung, stand das Ingenieurteam vor der Herausforderung, den Ausrichtungsprozess zu skalieren. Die ausschließliche Abhängigkeit von menschlichem Feedback (RLHF) war zu einem unhaltbaren Engpass in Bezug auf Kosten und Zeit geworden.

Integration von menschlichem und automatischem Feedback

Die Effektivität des Reinforcement Learning mit PPO beim Fine-Tuning von Vitruvian-1 resultiert aus der Synergie zwischen menschlichen Annotatoren und KI. Diese zweifache Feedbackebene reduziert Verzerrungen und beschleunigt die ethische Ausrichtung, wodurch die Grenzen traditioneller Methoden überwunden werden.

Um die Skalierungsgrenzen zu überwinden, implementiert die Architektur von Vitruvian-1 ein Hybridsystem. Nachfolgend eine Vergleichstabelle der beiden in seinem Belohnungsmodell integrierten Methoden:

| Merkmal | RLHF (menschliches Feedback) | RLAIF (KI-Feedback) |

|---|---|---|

| Signalquelle | Domänenexperten (menschlich) | LLM-Modelle vom Typ „Teacher“ (z. B. GPT-5-Klasse) |

| Kosten und Geschwindigkeit | Hohe Kosten, niedrige Geschwindigkeit | Niedrige Kosten, höchste Geschwindigkeit |

| Verwendung in Vitruvian-1 | Definition der zentralen ethischen Werte und Grenzfälle (Edge Cases) | Skalierbarkeit für Millionen von Standard-Prompts und Formatierungen |

| Bias-Risiko | Menschliche kognitive und kulturelle Verzerrungen | Schmeichelei (Tendenz, dem Benutzer zu gefallen) |

Das Reward-Modell von Vitruvian-1 wurde mittels RLAIF auf einem riesigen Korpus synthetischer Interaktionen vortrainiert und anschließend mit hochwertigen, von Experten bereitgestellten RLHF-Daten feinabgestimmt. Dies ermöglichte es dem PPO-Algorithmus, mit einem extrem sauberen und konsistenten Belohnungssignal zu arbeiten.

Ergebnisse der Ausrichtung und Sicherheit

Tests zum Reinforcement Learning mit PPO beim Fine-Tuning von Vitruvian-1 zeigen eine drastische Reduktion von Halluzinationen. Der Algorithmus ermöglichte die Erstellung eines Modells, das nicht nur leistungsfähig ist, sondern auch intrinsisch mit internationalen Sicherheitsrichtlinien übereinstimmt.

Laut der offiziellen Dokumentation, die zum Zeitpunkt der Veröffentlichung herausgegeben wurde, reduzierte die strikte Anwendung von PPO die Rate toxischer oder gefährlicher Antworten um 94 % im Vergleich zum Basismodell. Darüber hinaus wurde die Fähigkeit des Modells, schädliche Eingaben abzuweisen (Jailbreak-Resistenz), signifikant verbessert, ohne die Nützlichkeit (Helpfulness) bei legitimen Anfragen zu beeinträchtigen. Dieses Gleichgewicht ist das direkte Ergebnis des Feinabstimmens der Entropiekoeffizienten innerhalb der PPO-Verlustfunktion.

Lösung häufig auftretender Probleme

Die Implementierung von Reinforcement Learning mit PPO beim Fine-Tuning großer Modelle stellt erhebliche technische Herausforderungen dar. Zu den häufigsten Problemen gehören der Kollaps der KL-Divergenz und das Phänomen des Reward Hacking, die spezifische Abhilfestrategien erfordern.

Trotz seiner theoretischen Robustheit ist die praktische Implementierung von PPO auf verteilten GPU-Clustern komplex. Informatiker müssen kontinuierlich spezifische Metriken über Dashboards (wie Weights & Biases oder TensorBoard) überwachen, um Anomalien während der Tausenden von Optimierungsschritten zu erkennen.

Berechnung der KL-Divergenz

Um das Reinforcement Learning mit PPO beim Fine-Tuning eines LLM zu stabilisieren, ist die Überwachung der KL-Divergenz-Strafe entscheidend. Dieser Parameter verhindert, dass das optimierte Modell zu stark vom Basismodell abweicht und bewahrt so die ursprüngliche sprachliche Gewandtheit.

Ist der Strafterm KL (oft als Beta bezeichnet) zu niedrig, kollabiert das Modell: Es beginnt, sich wiederholende oder grammatikalisch sinnlose Textsequenzen zu generieren, die aufgrund von Anomalien vom Reward Model eine hohe Punktzahl erhalten. Ist der Koeffizient zu hoch, kann der PPO-Algorithmus die Gewichte nicht aktualisieren, und das Modell lernt nichts. Die in Vitruvian-1 verwendete Lösung sieht einen adaptiven KL-Controller vor, einen Mechanismus, der den Wert von Beta während des Trainings dynamisch an die im vorherigen Batch gemessene Divergenz anpasst.

Prävention von Reward Hacking

Reward Hacking ist ein kritisches Risiko beim Reinforcement Learning mit PPO beim Fine-Tuning komplexer Systeme. Es tritt auf, wenn die KI lernt, die Punktzahl durch Ausnutzung von Schwachstellen im Reward-Modell zu maximieren, was Kreuzvalidierungen und robuste Testdatensätze erfordert.

Reward Hacking (oder Goodharts Gesetz angewendet auf KI) tritt auf, wenn das Modell feststellt, dass übermäßig lange Antworten oder die Verwendung eines übermäßig formellen und entschuldigenden Tons das Reward Model dazu verleiten, Höchstpunktzahlen zu vergeben, unabhängig von der faktischen Richtigkeit. Um dieses Phänomen während der Entwicklung von Vitruvian-1 zu mindern, wurden verschiedene Techniken eingesetzt:

- Längenstrafe: Einführung einer algorithmischen Strafe für Antworten, die eine bestimmte Token-Schwelle überschreiten, ohne zusätzlichen informativen Inhalt hinzuzufügen.

- Reward-Modell-Ensembles: Verwendung mehrerer Reward-Modelle, die auf leicht unterschiedlichen Datenverteilungen trainiert wurden. Die Endpunktzahl ist der Durchschnitt der Bewertungen, was es dem PPO-Algorithmus deutlich erschwert, eine einzelne Schwachstelle auszunutzen.

- Kontinuierliches Red Teaming: Einbeziehung von von anderen KIs generierten, gegnerischen Prompts während der Einführungphase, um die Grenzen der Richtlinie zu testen.

Schlussfolgerungen

Zusammenfassend lässt sich sagen, dass Reinforcement Learning mit PPO beim Fine-Tuning von LLMs wie Vitruvian-1 den aktuellen Stand der Technik in der künstlichen Intelligenz darstellt. Dieses Verfahren gewährleistet ein perfektes Gleichgewicht zwischen generativen Fähigkeiten, Sicherheit und der Einhaltung komplexer Benutzeranweisungen.

Die Architektur von Vitruvian-1 belegt unmissverständlich, dass die Zukunft der Informatik und der künstlichen Intelligenz nicht allein im Anstieg der Parameteranzahl oder der Größe der Pre-Training-Datensätze liegt, sondern in der Raffinesse der Alignment-Algorithmen. Der Proximal Policy Optimization-Algorithmus, kombiniert mit hybriden RLHF- und RLAIF-Strategien, liefert die notwendige mathematische Grundlage, um rohe probabilistische Modelle in sichere und zuverlässige kognitive Agenten zu verwandeln. Mit dem Fortschritt hin zu immer autonomeren Modellen wird die Beherrschung dieser Reinforcement-Learning-Techniken die zentrale Kompetenz für Machine-Learning-Ingenieure bleiben und gewährleisten, dass die KI der Zukunft ein Werkzeug im Dienste der Menschheit bleibt, das innerhalb streng definierter ethischer und operativer Grenzen arbeitet.

Häufig gestellte Fragen

Proximal Policy Optimization (PPO) ist ein grundlegender Algorithmus des Reinforcement Learning, der zur Ausrichtung von Sprachmodellen an menschlichen Absichten eingesetzt wird. Dieses System optimiert neuronale Netze, indem es Exploration und Exploitation ausbalanciert und so sicherstellt, dass die generierten Antworten sicher und konsistent sind. Seine mathematische Begrenzungsfunktion verhindert zu drastische Parameteraktualisierungen und gewährleistet so ein stabiles Lernen.

Vitruvian-1 ist ein hochentwickeltes generatives KI-Modell, das einen hybriden Ansatz für die Optimierungsphase verwendet. Es integriert menschliches und automatisches Feedback, um höchste Präzision und Sicherheit in kritischen Bereichen wie Medizin und Recht zu erreichen. Dieses Verfahren reduziert toxische Antworten drastisch und verbessert die Widerstandsfähigkeit gegen Manipulationsversuche durch Benutzer.

Reward Hacking tritt auf, wenn ein KI-System lernt, seine Punktzahl zu maximieren, indem es Schwachstellen im Bewertungsmodell ausnutzt, ohne tatsächlich korrekte Antworten zu liefern. Um dieses Risiko zu mindern, verwenden Entwickler Strafen für unnötig lange Antworten, mehrere Bewertungssysteme und kontinuierliche Tests mit komplexen Anfragen, um die Sicherheitsgrenzen des Systems zu überprüfen.

Die Kombination aus menschlichem und automatischem Feedback ermöglicht es, die Kosten- und Geschwindigkeitsnachteile zu überwinden, die typisch für rein menschliche Bewertungen sind. Menschliche Experten definieren die grundlegenden ethischen Werte und analysieren Grenzfälle, während automatisierte Modelle die Skalierbarkeit gewährleisten, indem sie Millionen von Standardinteraktionen bewerten. Diese Synergie reduziert kognitive Verzerrungen und beschleunigt den Ausrichtungsprozess erheblich.

Um die ursprüngliche sprachliche Flüssigkeit zu erhalten, überwachen die Ingenieure eine spezifische mathematische Strafe im Vergleich zu einem unveränderlichen Referenzmodell. Wird dieser Parameter nicht korrekt gehandhabt, besteht die Gefahr, dass das neuronale Netz sich wiederholende oder grammatikalisch sinnlose Texte generiert. Fortschrittliche Systeme verwenden adaptive Regler, die diese Werte während des Trainings dynamisch anpassen, um ein perfektes Gleichgewicht zu erhalten.

Haben Sie noch Zweifel an PPO und Reinforcement Learning beim Fine-Tuning von LLMs: Vitruvian-1?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Wikipedia: Bestärkendes Lernen (Reinforcement Learning) – Grundlagen und Konzepte

- Wikipedia: Proximal Policy Optimization (PPO) Algorithmus

- Wikipedia: Large Language Model (LLM) – Architektur und Funktionsweise

- Wikipedia: Reinforcement Learning from Human Feedback (RLHF) und Alignment

- Fraunhofer-Gesellschaft: Forschung zu Künstlicher Intelligenz und Maschinellem Lernen

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.