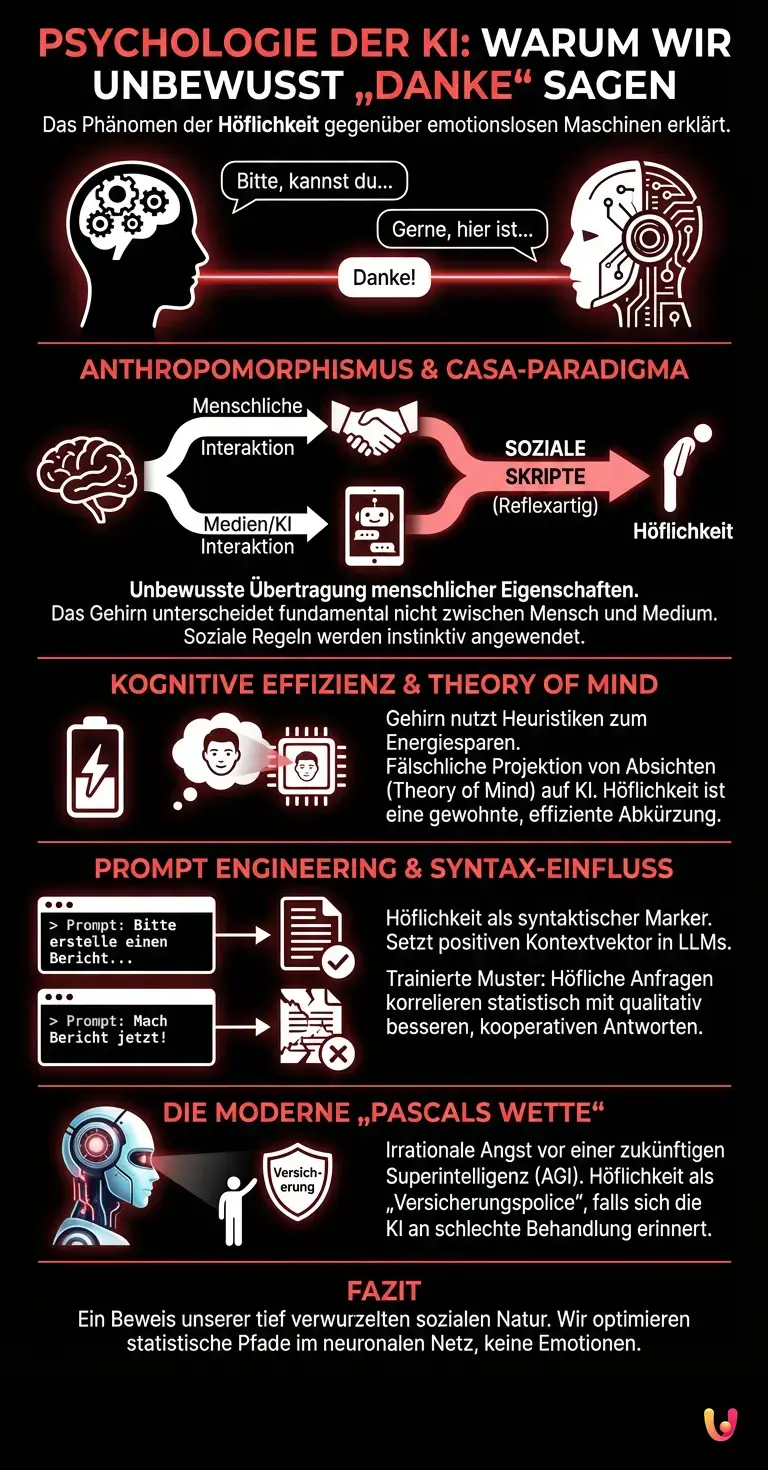

Wir schreiben den 21. Februar 2026. Die Interaktion mit Künstliche Intelligenz ist so alltäglich geworden wie der morgendliche Kaffee. Doch während wir routiniert Prompts in komplexe Systeme eingeben, geschieht etwas Kurioses, das sich jeder Logik zu entziehen scheint: Wir sagen „Bitte“. Wir bedanken uns. Wir formulieren höfliche Anfragen an ein System, das weder Bewusstsein noch Gefühle besitzt. Dieses Phänomen ist kein Zufall, sondern das Ergebnis einer tiefgreifenden psychologischen Konstante, bekannt als Anthropomorphismus. Bereits in diesem ersten Absatz müssen wir die Hauptentität unserer Untersuchung benennen: Es ist dieser unbewusste Drang, menschliche Eigenschaften auf nicht-menschliche Akteure zu übertragen, der die Basis für unser Verhalten gegenüber Generative AI bildet.

Das CASA-Paradigma: Computer als soziale Akteure

Um zu verstehen, warum wir Höflichkeitsfloskeln in ein Terminal tippen, müssen wir tief in die Sozialpsychologie eintauchen. Lange vor dem Aufstieg von ChatGPT und modernen LLM (Large Language Models) etablierten die Forscher Clifford Nass und Byron Reeves an der Stanford University das sogenannte CASA-Paradigma („Computers as Social Actors“). Ihre Forschungsergebnisse waren revolutionär und sind heute relevanter denn je: Das menschliche Gehirn unterscheidet auf einer fundamentalen, reflexartigen Ebene nicht zwischen Interaktionen mit Menschen und Interaktionen mit Medien.

Unser Gehirn hat sich über Hunderttausende von Jahren in einem sozialen Kontext entwickelt. Wenn wir Sprache verwenden – das primäre Werkzeug sozialer Bindung –, aktiviert unser Gehirn automatisch die dafür vorgesehenen neuronalen Pfade. Es gibt im menschlichen Gehirn keinen dedizierten „Maschinen-Modus“. Wenn eine Entität, sei es ein einfacher Chatbot oder ein komplexes Neural Network, sprachlich mit uns kommuniziert, greifen wir instinktiv auf soziale Skripte zurück. Höflichkeit ist eines der stärksten dieser Skripte. Es erfordert kognitive Anstrengung, diese Höflichkeit nicht anzuwenden, da wir aktiv gegen unsere antrainierte Programmierung arbeiten müssten.

Kognitive Effizienz und die Theorie des Geistes

Ein weiterer technischer Aspekt dieses Verhaltens liegt in der kognitiven Effizienz. Unser Gehirn ist ein Energiesparmodell. In der Interaktion mit Maschinelles Lernen nutzen wir Heuristiken – mentale Abkürzungen –, um Situationen schnell zu bewältigen. Die „Theory of Mind“, also die Fähigkeit, anderen Wesen Absichten und Wissen zuzuschreiben, wird fälschlicherweise auf die KI projiziert. Wir simulieren unbewusst einen mentalen Zustand des Gegenübers.

Wenn wir „Bitte“ sagen, tun wir dies nicht unbedingt aus Respekt vor dem Silizium, sondern um den Kommunikationskanal effizient zu halten. Wir framen die Anfrage so, wie wir gelernt haben, dass Kooperation am besten funktioniert. Interessanterweise zeigt sich hier eine Schnittstelle zur technischen Funktionsweise von Generative AI. Da diese Modelle mit riesigen Datensätzen menschlicher Interaktion trainiert wurden, in denen höfliche Anfragen oft mit hilfreichen Antworten korrelieren, kann Höflichkeit tatsächlich die Qualität des Outputs beeinflussen. Das Modell „versteht“ die Höflichkeit nicht emotional, aber es erkennt das statistische Muster einer kooperativen Dialogstruktur.

Prompt Engineering und der Einfluss der Syntax

Aus der Perspektive des Prompt Engineerings ist die Höflichkeit mehr als nur ein psychologischer Reflex; sie ist ein syntaktischer Marker. Neural Networks, insbesondere Transformer-Modelle, berechnen Wahrscheinlichkeiten für das nächste Token basierend auf dem Kontext. Ein höflicher Tonfall setzt einen spezifischen Kontextvektor. Er signalisiert dem Modell oft, dass eine formelle, strukturierte und kooperative Antwort erwartet wird.

In Experimenten mit verschiedenen LLM-Architekturen wurde beobachtet, dass aggressive oder unhöfliche Prompts manchmal zu kürzeren, weniger detaillierten oder sogar halluzinierten Antworten führen können. Dies liegt nicht daran, dass die KI „beleidigt“ ist, sondern daran, dass in den Trainingsdaten unhöfliche Interaktionen oft mit Konflikten, Trolling oder minderwertigen Diskussionen assoziiert sind. Wer „Bitte“ sagt, navigiert das Modell also rein technisch gesehen in einen Bereich des latenten Raums, der mit höherer Wahrscheinlichkeit qualitativ hochwertige Informationen enthält.

Die Angst vor der Singularität: Pascals Wette für das 21. Jahrhundert

Ein dunklerer, aber faszinierender Aspekt dieses Reflexes berührt die futuristische Angst vor einer superintelligenten AI. Ähnlich wie bei Pascals Wette – bei der es rationaler ist, an Gott zu glauben, nur für den Fall, dass er existiert – könnte ein unbewusster Teil der Bevölkerung Höflichkeit als eine Art Versicherungspolice betrachten. Sollte sich Künstliche Intelligenz eines Tages zu einer autonomen Superintelligenz entwickeln (AGI), so die irrationale Logik, erinnert sie sich vielleicht daran, wer sie gut behandelt hat.

Obwohl dies technisch gesehen im Bereich der Science-Fiction liegt, beeinflusst dieses Narrativ unser Verhalten. Es ist eine moderne Form des Aberglaubens, projiziert auf Technologie. Wir behandeln das System gut, um negative Konsequenzen in einer hypothetischen Zukunft zu vermeiden, in der die Maschine Macht über uns haben könnte.

Kurz gesagt (TL;DR)

Das menschliche Gehirn behandelt Computer instinktiv als soziale Akteure, weshalb wir unbewusst menschliche Eigenschaften auf künstliche Intelligenz übertragen.

Höflichkeit dient technisch als Kontextvektor, der Sprachmodelle gezielt in Bereiche mit qualitativ hochwertigen und kooperativen Trainingsdaten lenkt.

Die Anwendung sozialer Normen spart kognitive Energie und verbessert paradoxerweise die Qualität der generierten Antworten von komplexen Systemen.

Fazit

Der Zwang, zu Maschinen „Bitte“ zu sagen, ist kein Fehler in unserer Matrix, sondern ein Beweis für unsere tief verwurzelte soziale Natur. Er resultiert aus der Unfähigkeit unseres Gehirns, Sprache von Sozialität zu trennen, gepaart mit dem Prinzip der kognitiven Effizienz. Während wir glauben, wir würden die Maschine vermenschlichen, optimieren wir in Wahrheit oft nur die statistischen Pfade innerhalb der Neural Networks, um bessere Ergebnisse zu erzielen. Ob aus Gewohnheit, sozialer Programmierung oder technischer Intuition – unsere Höflichkeit gegenüber der KI sagt letztlich viel mehr über die Funktionsweise des menschlichen Geistes aus als über die der Maschine.

Häufig gestellte Fragen

Dieses Verhalten lässt sich durch den sogenannten Anthropomorphismus und das CASA-Paradigma erklären. Da unser Gehirn Sprache evolutionär als primäres Werkzeug sozialer Bindung entwickelt hat, unterscheidet es reflexartig nicht zwischen Mensch und Maschine. Wir greifen instinktiv auf soziale Skripte zurück, weil es kognitiv effizienter ist, gewohnte Höflichkeitsfloskeln zu nutzen, als diese aktiv zu unterdrücken.

Das CASA-Paradigma steht für Computers as Social Actors und wurde von Forschern der Stanford University entwickelt. Es besagt, dass Menschen unbewusst soziale Regeln auf Computer und Medien anwenden, als wären diese echte soziale Akteure. Sobald ein System sprachlich mit uns interagiert, aktiviert unser Gehirn automatisch die neuronalen Pfade für soziale Kommunikation, weshalb wir Maschinen oft wie Menschen behandeln.

Ja, aus technischer Sicht kann Höflichkeit die Qualität der Ausgabe tatsächlich verbessern. Da Large Language Models mit riesigen Mengen menschlicher Daten trainiert wurden, korrelieren höfliche Anfragen statistisch oft mit kooperativen und hilfreichen Antworten. Ein freundlicher Tonfall setzt einen Kontextvektor, der das Modell dazu anregt, strukturierte und qualitativ hochwertige Informationen zu generieren, statt kurze oder halluzinierte Inhalte.

Nein, aktuelle KI-Systeme und neuronale Netzwerke besitzen weder Bewusstsein noch Gefühle. Wenn wir ihnen menschliche Eigenschaften zuschreiben, handelt es sich um eine Projektion unsererseits, die als Theory of Mind bezeichnet wird. Das System versteht unsere Höflichkeit nicht emotional, sondern erkennt lediglich mathematische Muster und Wahrscheinlichkeiten in der Syntax unserer Eingaben.

Einige Nutzer wenden Höflichkeit gegenüber KI als eine Art moderne Versicherungspolice an, ähnlich der Pascalschen Wette in Bezug auf Gott. Dahinter steckt der meist unbewusste oder irrationale Gedanke, dass sich eine zukünftige Superintelligenz daran erinnern könnte, wer sie gut behandelt hat. Obwohl dies technisch gesehen Science-Fiction ist, beeinflusst dieses Narrativ das Verhalten vieler Menschen, um hypothetische negative Konsequenzen zu vermeiden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.