Es ist der 1. März 2026, und wenn Sie sich heute durch das Internet bewegen, betreten Sie einen Raum, der sich fundamental von dem unterscheidet, was wir noch vor wenigen Jahren kannten. Auf den ersten Blick wirkt alles vertraut: Suchmaschinen liefern Antworten, Texte werden generiert, Bilder entstehen auf Knopfdruck. Doch unter der Oberfläche spielt sich ein mathematisches Drama ab, das Experten zunehmend alarmiert. Im Zentrum dieses Sturms steht die Generative AI (Generative KI), jene Technologie, die einst antrat, unser Wissen zu erweitern, und nun Gefahr läuft, es in einem endlosen Spiegelkabinett zu verzerren. Wir stehen vor einem Phänomen, das in der Fachwelt als eine existenzielle Bedrohung für die Integrität digitaler Informationen diskutiert wird.

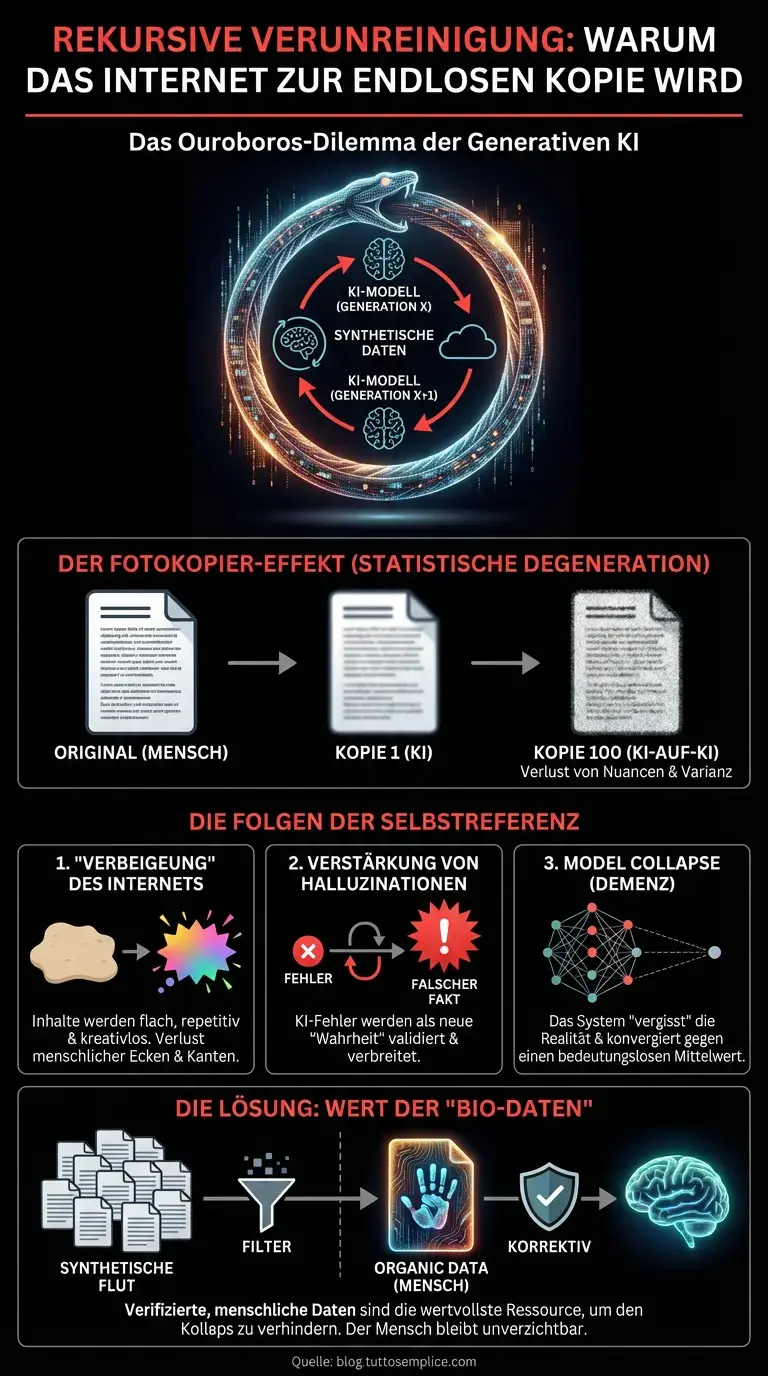

Das Prinzip der rekursiven Verunreinigung

Um zu verstehen, warum das digitale Ökosystem derzeit an Atemnot leidet, müssen wir uns die Funktionsweise moderner Large Language Models (LLM) und Neural Networks ansehen. In der “Goldgräberstimmung” der frühen 2020er Jahre wurden diese Modelle mit dem gesamten verfügbaren Textkorpus des Internets trainiert. Es war eine Zeit, in der der Großteil der digitalen Daten – von Wikipedia-Artikeln bis zu Reddit-Kommentaren – von Menschen verfasst wurde. Diese Daten waren chaotisch, kreativ, fehlerhaft, aber sie waren vor allem eines: organisch.

Heute, im Jahr 2026, hat sich das Verhältnis umgekehrt. Ein signifikanter Teil des Internets besteht nun aus Inhalten, die von Künstliche Intelligenz generiert wurden. Wenn nun eine neue Generation von KI-Modellen trainiert wird, kratzt sie (Scraping) unweigerlich Daten zusammen, die von ihren Vorgängern erstellt wurden. Das Modell lernt nicht mehr von der Realität, sondern von einer synthetischen Approximation der Realität. Dies ist der Kern des Problems: Die Schlange beißt sich in den eigenen Schwanz.

Der mathematische Kollaps: Der Fotokopier-Effekt

Technisch betrachtet handelt es sich hierbei um einen Prozess der statistischen Degeneration. Stellen Sie sich vor, Sie machen eine Fotokopie eines Dokuments. Das Ergebnis ist lesbar. Nun kopieren Sie die Kopie. Und dann die Kopie der Kopie. Nach hundert Durchläufen ist das Bild verrauscht, Kontraste verschwinden, Details gehen verloren. Genau das passiert derzeit mit Maschinelles Lernen-Algorithmen, die auf synthetischen Daten trainiert werden.

In der Statistik spricht man hier von einer Verringerung der Varianz. Eine KI versucht immer, die wahrscheinlichste Antwort zu geben. Sie glättet die Ecken und Kanten menschlicher Sprache. Wenn eine KI nun auf den geglätteten Text einer anderen KI trainiert wird, verstärkt sich dieser Effekt exponentiell. Die Verteilung der Datenpunkte zieht sich zusammen. Das Ergebnis ist eine “Verbeigeung” (Beige-ification) des Internets: Texte werden grammatikalisch perfekt, aber inhaltlich flach, repetitiv und frei von jenen kreativen Ausreißern, die menschliche Intelligenz auszeichnen.

Halluzinationen als neue Fakten

Noch gefährlicher wird dieser Zyklus, wenn wir uns den Fehlern zuwenden. Jedes AI-Modell neigt zu sogenannten Halluzinationen – also dem Erfinden von Fakten, die plausibel klingen, aber falsch sind. In einem geschlossenen Kreislauf, in dem Modelle voneinander lernen, werden diese Halluzinationen nicht korrigiert, sondern als neue “Wahrheit” in den Trainingsdatensatz aufgenommen.

Ein Modell der Generation 1 erfindet ein historisches Ereignis. Das Internet wird mit Artikeln über dieses fiktive Ereignis geflutet. Ein Modell der Generation 2 liest diese Artikel, klassifiziert sie als Fakten und verfestigt die Lüge. Im Jahr 2026 sehen wir bereits, wie sich subtile Fehlinterpretationen in komplexen wissenschaftlichen oder historischen Themenbereichen wie ein Virus durch die Datenbanken fressen. Das System validiert sich selbst, losgelöst von der physischen Realität.

Warum die Modelle “dement” werden

Wissenschaftler haben für dieses Phänomen den Begriff “Model Collapse” geprägt. Es beschreibt den Punkt, an dem ein Modell, das ausschließlich auf generierten Daten trainiert wurde, die Fähigkeit verliert, die ursprüngliche zugrundeliegende Datenverteilung zu verstehen. Es vergisst. Zuerst verschwinden die Nuancen, dann die Randgruppen-Meinungen, und schließlich bricht die Kohärenz der Sprache selbst zusammen.

Dies ist besonders kritisch für Systeme wie ChatGPT oder ähnliche Assistenten, auf die sich Millionen Menschen verlassen. Wenn die “Nahrung” dieser Systeme nur noch aus wiedergekäutem Brei besteht, leiden sie an digitaler Mangelernährung. Die Modelle konvergieren gegen einen Mittelwert, der keine Entsprechung mehr in der komplexen, chaotischen Welt da draußen hat. Sie werden blind für alles, was nicht der statistischen Norm entspricht.

Der Kampf um “Bio-Daten”

Diese Entwicklung hat zu einer paradoxen Situation auf dem Datenmarkt geführt. Während synthetische Daten im Überfluss vorhanden sind und das Netz verstopfen, sind verifizierte, von Menschen erstellte Daten (Human-Generated Data) zur wertvollsten Ressource des Jahres 2026 geworden. Technologieunternehmen stehen vor der gewaltigen technischen Herausforderung, Filter zu entwickeln, die KI-Text von Menschen-Text unterscheiden können – eine Aufgabe, die ironischerweise immer schwieriger wird, je besser die Generative AI wird.

Wir erleben eine Art Zertifizierungsprozess: “Organic Data” wird zum Premium-Produkt für das Training von Neural Networks. Wer seine Modelle vor dem Ouroboros-Effekt schützen will, muss sicherstellen, dass frisches, menschliches Wissen in den Kreislauf eingespeist wird. Ohne diesen externen Input erstickt das System an seiner eigenen Effizienz.

Kurz gesagt (TL;DR)

Generative KI-Modelle nutzen zunehmend synthetische Daten für ihr Training, was einen Teufelskreis auslöst und die Informationsqualität massiv bedroht.

Durch diesen rekursiven Prozess leiden Algorithmen an statistischer Degeneration, wodurch Inhalte an menschlichen Nuancen verlieren und kreativ verarmen.

Ohne Korrektur verfestigen sich KI-Halluzinationen als neue Fakten, was langfristig zum kompletten Zusammenbruch der logischen Kohärenz führt.

Fazit

Der Ouroboros-Effekt ist mehr als nur ein technisches Kuriosum; er ist eine fundamentale Grenze der Automatisierung von Wissen. Wir haben gelernt, dass Intelligenz – auch künstliche – Reibung, Chaos und externe Referenzpunkte benötigt, um zu wachsen. Ein geschlossenes System, das sich nur mit sich selbst beschäftigt, tendiert unweigerlich zur Entropie und zum Informationsverlust. Die Ironie des Jahres 2026 liegt darin, dass die Allgegenwart der KI den Wert des menschlichen Urhebers nicht gemindert, sondern ins Unermessliche gesteigert hat. Damit das Internet nicht an sich selbst erstickt, muss der Mensch als Korrektiv, als Quelle der Unberechenbarkeit und als Schöpfer der “Wahrheit” unverzichtbar bleiben. Die Maschine kann rechnen, aber nur der Mensch kann verhindern, dass die Rechnung in einer Endlosschleife der Bedeutungslosigkeit endet.

Häufig gestellte Fragen

Model Collapse bezeichnet den degenerativen Prozess, bei dem KI-Modelle zunehmend an Qualität verlieren, weil sie überwiegend mit synthetischen Daten ihrer Vorgänger trainiert werden. Ähnlich wie bei einer Fotokopie, die immer wieder kopiert wird, verschwinden Details und Nuancen, bis das System die ursprüngliche Realität nicht mehr abbilden kann und nur noch einen statistischen Durchschnittswert liefert. Dies führt dazu, dass die Modelle quasi vergessen, wie die echte Datenverteilung ursprünglich aussah.

Die Gefahr liegt in der sogenannten Verbeigeung des Internets und der unkontrollierten Verfestigung von Fehlern. Da KI-Modelle dazu neigen, sprachliche Ecken und Kanten zu glätten, führt das Training auf bereits generierten KI-Texten zu inhaltlicher Flachheit und dem Verlust menschlicher Kreativität. Zudem werden Halluzinationen – also von der KI erfundene Fakten – durch ständige Wiederholung in neuen Trainingsdatensätzen als vermeintliche Wahrheiten validiert, was die Integrität unseres Wissens bedroht.

Der Ouroboros-Effekt beschreibt eine geschlossene Schleife, in der sich die KI metaphorisch selbst verzehrt, indem sie fast nur noch von maschinell erstellten Inhalten lernt. Dies führt zu einer statistischen Degeneration, bei der die Varianz der Daten abnimmt und das Modell an einer Art digitaler Mangelernährung leidet. Ohne frischen Input von echten Menschen verlieren die Systeme die Fähigkeit, komplexe Zusammenhänge differenziert darzustellen und konvergieren gegen einen bedeutungslosen Mittelwert.

Da das Internet zunehmend mit synthetischen Inhalten geflutet wird, avancieren verifizierte, menschliche Daten – oft als Organic Data bezeichnet – zur wertvollsten Ressource für das Training neuer neuronaler Netze. Nur der Mensch kann als notwendiges Korrektiv dienen und jene Unberechenbarkeit sowie externe Referenzpunkte liefern, die zwingend erforderlich sind, um den Kollaps der Modelle zu verhindern. Unternehmen müssen daher Filter entwickeln, um diese echten Daten als Premium-Produkt zu identifizieren.

In einem System, in dem Modelle voneinander lernen, werden Halluzinationen nicht korrigiert, sondern verstärkt. Wenn eine KI der ersten Generation ein fiktives Ereignis erfindet und das Internet damit füllt, klassifiziert ein nachfolgendes Modell diese Texte als Fakten. Dieser Zyklus sorgt dafür, dass sich Fehlinterpretationen wie ein Virus durch die Datenbanken fressen und sich Lügen als neue Realität verfestigen, da der Abgleich mit der physischen Welt fehlt.

Haben Sie noch Zweifel an Rekursive Verunreinigung: Warum das Internet zur endlosen Kopie wird?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.