Wir schreiben das Jahr 2026. Künstliche Intelligenz hat in den letzten Jahren Quantensprünge vollzogen. Sie besteht juristische Staatsexamina, diagnostiziert seltene Krankheiten präziser als manche Fachärzte und generiert Kunstwerke, die in Galerien hängen. Doch unter der glänzenden Oberfläche dieser digitalen Superhirne verbirgt sich ein fundamentaler, fast schon peinlicher Fehler. Es ist eine logische Lücke, die so simpel erscheint, dass ein Grundschüler sie mühelos überbrücken würde, an der jedoch selbst die fortschrittlichsten Large Language Models (LLMs) regelmäßig scheitern. Dieses Phänomen, das Experten als „Reversal Curse“ (Umkehrfluch) bezeichnen, offenbart die wahre Natur dessen, wie Maschinen „denken“ – oder genauer gesagt, wie sie es nicht tun.

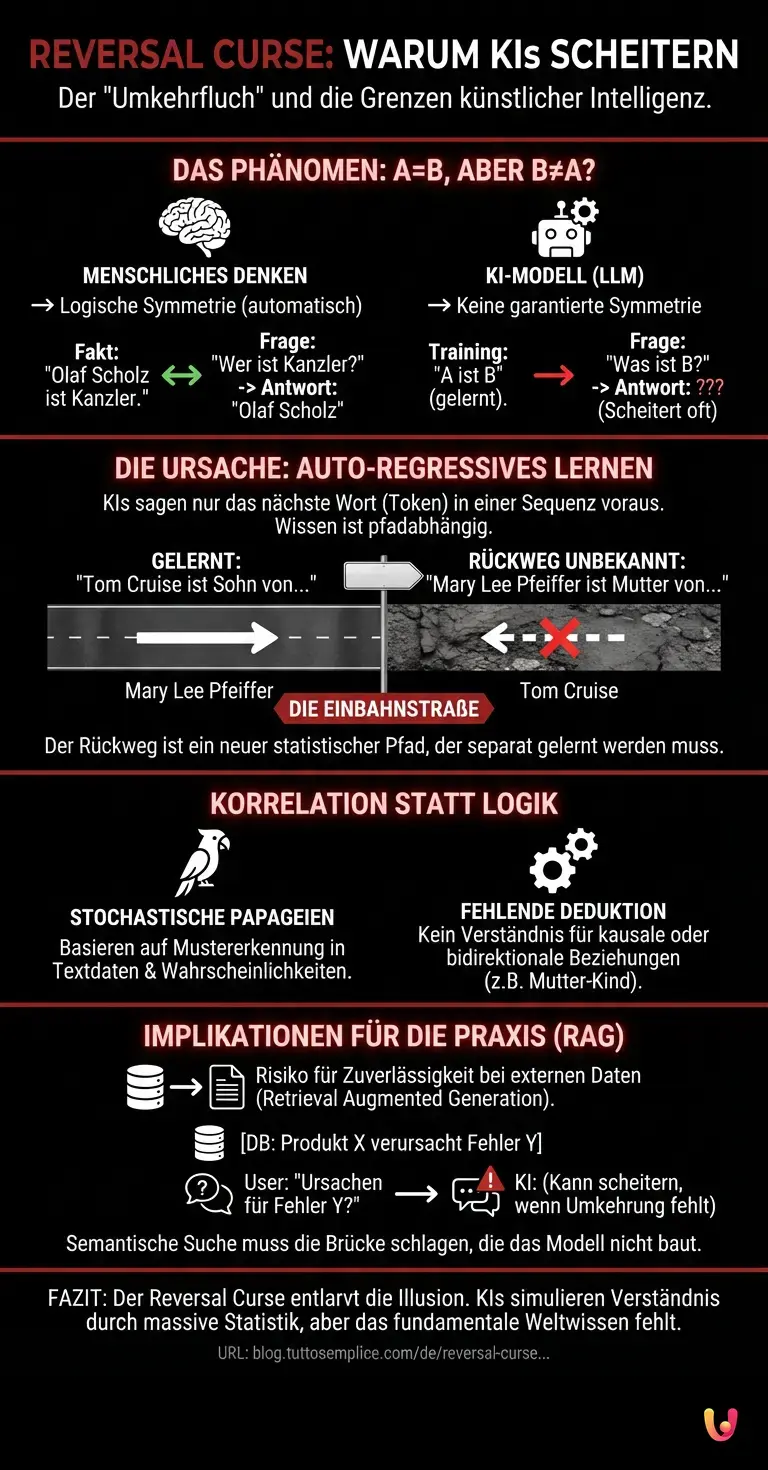

Das Phänomen: Wenn A gleich B ist, aber B nicht A

Stellen Sie sich vor, Sie lernen einen simplen Fakt: „Olaf Scholz ist der Bundeskanzler von Deutschland.“ Wenn man Sie nun fragt: „Wer ist der Bundeskanzler von Deutschland?“, antworten Sie sofort: „Olaf Scholz.“ Das ist trivial. Doch das menschliche Gehirn vollzieht automatisch und ohne Anstrengung eine logische Operation, die für generative AI alles andere als selbstverständlich ist: die Symmetrie der Beziehung. Wenn Sie gefragt werden: „Welches Amt bekleidet Olaf Scholz?“, greifen Sie auf dasselbe Wissen zu, nur von der anderen Seite.

Für ein künstliche Intelligenz-Modell, das rein auf der Architektur von Transformern basiert, ist diese Symmetrie nicht garantiert. Studien haben gezeigt, dass ein Modell, das ausschließlich mit dem Satz „A ist B“ trainiert wurde, oft nicht in der Lage ist, die Frage „Was ist A?“ zu beantworten, wenn ihm nur B präsentiert wird. Dies ist der „Rückwärts-Fehler“. Das Modell lernt die Wahrscheinlichkeit, dass auf „Olaf Scholz ist“ die Worte „der Bundeskanzler“ folgen. Es speichert jedoch nicht automatisch die logische Verknüpfung, dass „der Bundeskanzler“ rückwirkend auf „Olaf Scholz“ verweist, sofern dieser spezifische Rückweg nicht ebenfalls in den Trainingsdaten massenhaft vorhanden war.

Die Architektur der Einbahnstraße: Auto-regressives Lernen

Um dieses Paradoxon technisch zu durchdringen, müssen wir tief in den Maschinenraum von ChatGPT und ähnlichen Systemen blicken. Der Kern des Problems liegt in der Art und Weise, wie diese Modelle trainiert werden: dem sogenannten auto-regressiven Lernen. Ein LLM liest Text nicht wie ein Mensch, der den Sinnzusammenhang als Ganzes erfasst. Stattdessen ist es darauf trainiert, das nächste Token (Wortteil) in einer Sequenz vorherzusagen.

In der Welt der Neural Networks ist Wissen keine relationale Datenbank, in der Fakten als verknüpfte Entitäten gespeichert sind. Wissen ist hier Pfadabhängigkeit. Wenn das Modell den Satz „Tom Cruise ist der Sohn von Mary Lee Pfeiffer“ lernt, werden die synaptischen Gewichte so angepasst, dass der Pfad von „Tom“ zu „Mary“ geglättet wird. Der Weg ist eine Einbahnstraße. Die statistische Wahrscheinlichkeit führt von A nach B. Der Rückweg von „Mary Lee Pfeiffer“ zu „Tom Cruise“ ist jedoch ein völlig neuer, statistisch unabhängiger Pfad, der separat erlernt werden muss.

Warum statistische Papageien nicht logisch schlussfolgern

Kritiker und Forscher bezeichnen LLMs oft polemisch als „stochastische Papageien“. Auch wenn diese Bezeichnung der Komplexität moderner Systeme nicht ganz gerecht wird, trifft sie beim Rückwärts-Fehler ins Schwarze. Maschinelles Lernen in seiner heutigen Form basiert auf Korrelation, nicht auf Kausalität oder logischer Äquivalenz.

Ein Mensch versteht die Beziehung „Mutter von“ als inhärent bidirektional: Wenn X die Mutter von Y ist, muss Y das Kind von X sein. Das ist ein logisches Konzept. Ein LLM hingegen sieht nur Muster in Textdaten. Wenn in den Trainingsdaten der Satz „Paris ist die Hauptstadt von Frankreich“ milliardenfach vorkommt, aber der Satz „Die Hauptstadt von Frankreich ist Paris“ (hypothetisch) nie auftauchen würde, könnte das Modell auf die Frage „Was ist Paris?“ korrekt antworten, aber bei „Nenne die Hauptstadt von Frankreich“ halluzinieren oder scheitern. Da in realen Datensätzen beide Richtungen oft vorkommen, fällt dieser Fehler bei allgemeinem Wissen selten auf. Er wird jedoch eklatant, sobald es um spezifische, seltene Fakten oder neu eingeführte Informationen im Kontextfenster geht.

Der Unterschied zwischen Abruf und Deduktion

Der Rückwärts-Fehler entlarvt eine wichtige Unterscheidung in der Kognitionswissenschaft: den Unterschied zwischen Informationsabruf (Retrieval) und logischer Deduktion. Wenn wir glauben, eine KI würde „denken“, unterliegen wir einer Anthropomorphisierung. Wir projizieren unsere menschliche Art der Wissensverarbeitung auf die Maschine.

Das neuronale Netz speichert Fakten nicht als isolierte Fakten, sondern als Wahrscheinlichkeitsverteilungen in einem hochdimensionalen Vektorraum. Die Vektoren für „Tom Cruise“ und „Mary Lee Pfeiffer“ liegen vielleicht nahe beieinander, aber die Richtung des Vektors ist entscheidend. Ohne explizites Training der Umkehrung existiert für das Modell keine Brücke zurück. Das erklärt, warum selbst Modelle mit Billionen von Parametern bei Aufgaben scheitern können, die einfache logische Inversionen erfordern, während sie gleichzeitig komplexe Programmiercodes schreiben können – denn Code folgt oft strengen, vorwärtsgerichteten syntaktischen Mustern.

Implikationen für die Zuverlässigkeit von Generative AI

Warum ist das für den Anwender relevant? Weil es die Grenzen der Verlässlichkeit aufzeigt. Wenn wir uns auf Generative AI verlassen, um logische Schlüsse aus neuen Daten zu ziehen, müssen wir vorsichtig sein. Füttern wir ein Modell mit einem Bericht über Firma A, die Firma B kauft, versteht das Modell im statistischen Sinne nicht zwingend, dass Firma B nun zu Firma A gehört, es sei denn, es wird explizit danach gefragt oder die Umkehrung wird im Prompt provoziert.

Dies hat massive Auswirkungen auf die Entwicklung von RAG-Systemen (Retrieval Augmented Generation), bei denen Modelle mit externen Datenbanken verknüpft werden. Wenn die Datenbank Fakten nur in einer Richtung liefert („Produkt X verursacht Fehler Y“), kann die KI möglicherweise nicht korrekt antworten, wenn der Nutzer fragt: „Was sind die Ursachen für Fehler Y?“. Die semantische Suche muss hier die Brücke schlagen, die das „Gehirn“ des Modells nicht automatisch baut.

Kurz gesagt (TL;DR)

Trotz enormer Fortschritte scheitern modernste Sprachmodelle am Reversal Curse, da sie einfache logische Umkehrschlüsse oft nicht bewältigen.

Die Ursache liegt im auto-regressiven Training, wodurch Sprachmodelle Wissen lediglich als statistische Einbahnstraße und nicht relational speichern.

Dieses Phänomen verdeutlicht den fundamentalen Unterschied zwischen menschlicher Logik und der rein statistischen Mustererkennung künstlicher Intelligenz.

Fazit

Der Rückwärts-Fehler ist mehr als nur eine technische Kuriosität; er ist ein Fenster in die Seele der Maschine. Er erinnert uns daran, dass trotz der beeindruckenden Eloquenz von Systemen wie ChatGPT und ihren Nachfolgern das fundamentale Verständnis von Weltlogik, wie Menschen es besitzen, fehlt. Die KI simuliert Verständnis durch massive statistische Abdeckung, aber dort, wo die Statistik lückenhaft ist – wie bei der Umkehrung seltener Fakten – bricht die Illusion zusammen. Solange neuronale Netze primär auf der Vorhersage des nächsten Wortes basieren, wird dieser blinde Fleck bleiben: Ein Superhirn, das zwar alle Wege nach Rom kennt, aber oft nicht mehr weiß, wie es von Rom wieder nach Hause kommt.

Häufig gestellte Fragen

Der Reversal Curse, auch als Umkehrfluch bekannt, beschreibt ein Phänomen, bei dem große Sprachmodelle (LLMs) eine logische Beziehung nur in eine Richtung erlernen. Wenn eine KI trainiert wird, dass A gleich B ist, kann sie oft nicht automatisch ableiten, dass B auch gleich A ist, sofern diese spezifische Umkehrung nicht ebenfalls in den Trainingsdaten enthalten war. Dies offenbart, dass KI-Modelle Fakten nicht wie Menschen als symmetrische Beziehungen verstehen, sondern als statistische Einbahnstraßen.

Die Ursache liegt im sogenannten auto-regressiven Lernen, bei dem das Modell darauf trainiert ist, lediglich das nächste Wort in einer Sequenz vorherzusagen. Wissen wird dabei nicht als vernetztes Faktenwissen gespeichert, sondern als Pfadabhängigkeit, ähnlich einer Einbahnstraße von Wort A zu Wort B. Da der Rückweg statistisch ein völlig neuer Pfad ist, fehlt dem neuronalen Netz ohne explizites Training die Verbindung, um vom Ergebnis zurück auf den Ursprung zu schließen.

Für Systeme, die Retrieval Augmented Generation (RAG) nutzen, stellt dieser Fehler ein Risiko für die Zuverlässigkeit dar, wenn Informationen nur in einer Richtung vorliegen. Wenn eine Datenbank beispielsweise speichert, dass Produkt X den Fehler Y verursacht, versteht die KI statistisch nicht zwingend, dass bei einer Frage nach den Ursachen für Fehler Y das Produkt X genannt werden muss. Dies erfordert verbesserte semantische Suchmechanismen, da das Modell die logische Brücke nicht selbstständig schlagen kann.

Während das menschliche Gehirn Beziehungen intuitiv als bidirektional begreift und sofort versteht, dass eine Mutter-Kind-Beziehung auch umgekehrt gilt, basieren KI-Modelle rein auf Korrelationen und Wahrscheinlichkeiten. Menschen nutzen logische Deduktion, um Wissen umzukehren, wohingegen neuronale Netze auf Vektoren im Raum angewiesen sind. Ohne entsprechende Datenpunkte fehlt der Maschine das Verständnis für die logische Äquivalenz, was zu Halluzinationen oder Wissenslücken bei seltenen Fakten führen kann.

Der Reversal Curse stützt die These, dass LLMs eher als stochastische Systeme fungieren, die Wahrscheinlichkeiten berechnen, anstatt echtes Weltverständnis zu besitzen. Sie simulieren Intelligenz durch eine massive Abdeckung an Trainingsdaten, scheitern jedoch dort, wo statistische Muster fehlen, wie etwa bei der Umkehrung seltener Informationen. Dies zeigt, dass sie primär Muster erkennen und reproduzieren, anstatt kausale Zusammenhänge logisch zu durchdringen.

Haben Sie noch Zweifel an Reversal Curse: Warum KIs an dieser simplen Umkehrung scheitern?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.