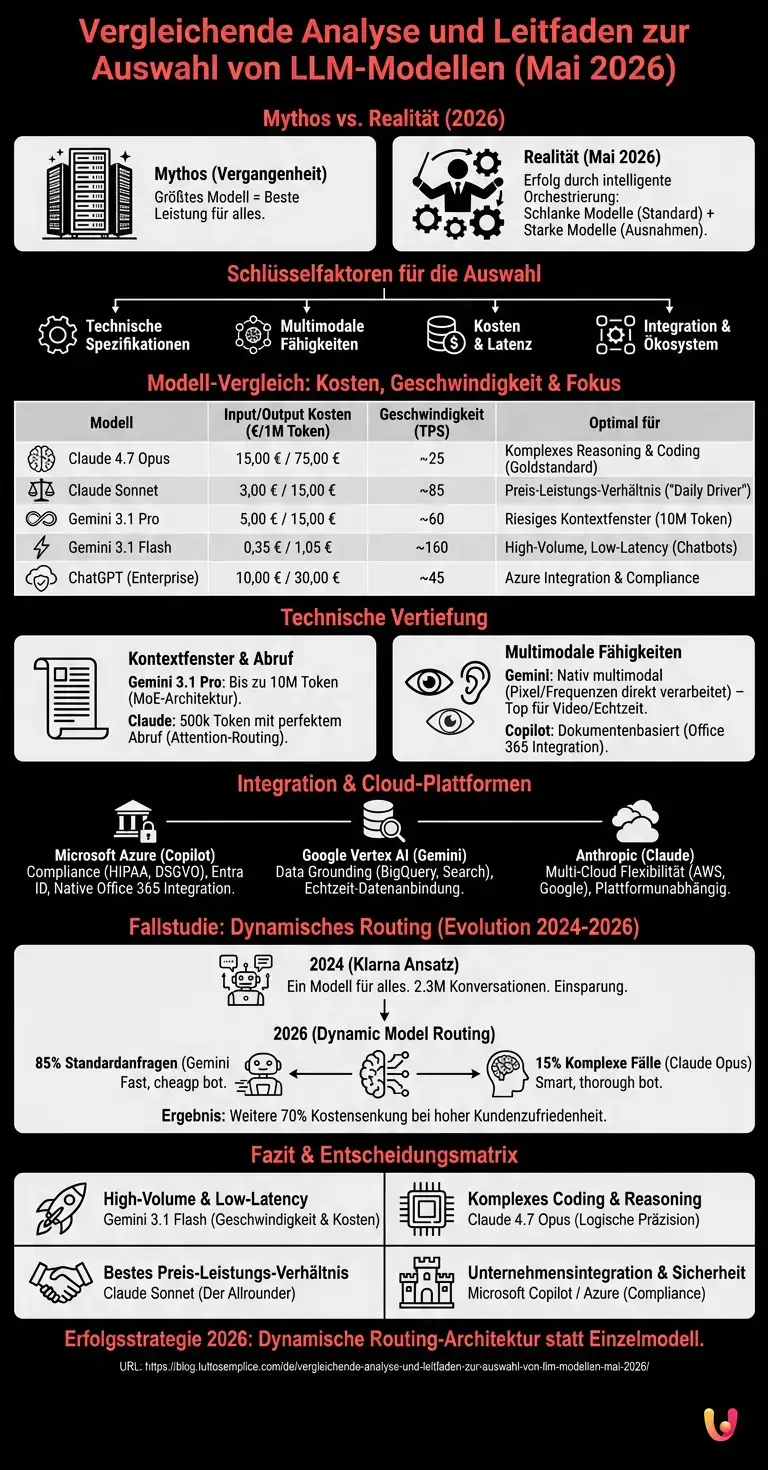

Der am tiefsten verwurzelte Mythos in der heutigen Landschaft der künstlichen Intelligenz besagt, dass für eine Leistung auf Enterprise-Niveau zwingend das größte und teuerste verfügbare Modell eingesetzt werden muss. Im Mai 2026 sieht die Realität jedoch völlig anders aus: Der Erfolg im produktiven Einsatz hängt nicht von den Ergebnissen in Reasoning-Benchmarks ab, sondern von der intelligenten Orchestrierung schlanker Modelle für das Standardvolumen und leistungsstarker Modelle für Ausnahmefälle. Dieser Vergleich von LLM-Modellen verdeutlicht, dass das Ökosystem, die Anbieterbindung (Vendor Lock-in) und die Latenz mittlerweile weitaus schwerer wiegen als die reinen Parameter, was CTOs zu einem radikalen Paradigmenwechsel beim Entwurf von KI-Architekturen zwingt.

Technische Spezifikationen und Basisarchitekturen

In diesem Vergleich von LLM-Modellen offenbaren die technischen Spezifikationen entscheidende Unterschiede. Wir analysieren die Größe des Kontextfensters, die Ratenbegrenzungen (RPM/TPM) sowie die architektonischen Besonderheiten, die die Leistungsfähigkeit von Claude, Gemini, ChatGPT und Copilot in intensiven Produktionsszenarien bestimmen.

Im Mai 2026 hat der Wettlauf um die Erweiterung des Kontextfensters ein funktionales Plateau erreicht, wodurch der Fokus auf die Effizienz des Informationsabrufs (native Retrieval-Augmented Generation) verlagert wurde. Laut der offiziellen Dokumentation von Google Cloud behauptet Gemini 3.1 Pro die absolute Spitzenposition mit einem dynamischen Kontextfenster von bis zu 10 Millionen Token, unterstützt durch eine hochgradig parallelisierte Mixture-of-Experts-Architektur (MoE). Dies ermöglicht die Verarbeitung ganzer Code-Repositories oder Videoarchive ohne Fragmentierung.

Andererseits bieten Claude 4.7 Opus und die neueste Iteration von Claude Sonnet ein Kontextfenster von 500.000 Token. Anthropic hat jedoch einen Attention-Routing- Mechanismus implementiert, der selbst an den äußersten Grenzen des Kontextes einen perfekten Abruf (100 % im „Needle-in-a-Haystack“-Test) gewährleistet und so strukturelle Halluzinationen reduziert. ChatGPT (in der Enterprise-Version auf Basis der GPT-4.5/5-Architektur ) und Microsoft Copilot bieten standardisierte Fenster von 256.000 Token, wobei sie extrem hohe Ratenbegrenzungen (TPM – Tokens Per Minute) priorisieren, um gleichzeitigen Arbeitslasten in Unternehmen gerecht zu werden.

Multimodale Fähigkeiten und komplexes Schlussfolgern

Die Bewertung komplexer Schlussfolgerungsfähigkeiten ist bei einem aktuellen Vergleich von LLM-Modellen von entscheidender Bedeutung. Wir untersuchen die Leistung in den neuesten Benchmarks für fortgeschrittene Programmierung , mathematische Zero-Shot-Logik sowie die native Analyse von Bildern und komplexen Dokumenten.

Die Schlussfolgerungsfähigkeiten haben sich in zwei unterschiedliche Kategorien aufgespalten: analytische Logik (Programmierung und Mathematik) und natives multimodales Verständnis. Im Bereich der Softwareentwicklung dominiert Claude 4.7 Opus unangefochten. In den SWE-bench-Benchmarks mit Stand 2026 löst Opus eigenständig über 48 % der komplexen GitHub-Issues und übertrifft damit ChatGPT dank seiner überlegenen Fähigkeit, die logische Konsistenz über mehrere Dateien hinweg zu wahren.

Was die Multimodalität betrifft, so basieren Gemini 3.1 Pro und Gemini 3.1 Flash auf einer Architektur, die bereits ab dem Pre-Training nativ multimodal ausgelegt ist. Das bedeutet, dass sie Bilder oder Audiodaten vor der Verarbeitung nicht in Text umwandeln, sondern Pixel und Frequenzen direkt in den latenten Raum abbilden. Das Ergebnis ist eine erdrückende Überlegenheit bei der Echtzeit-Videoanalyse sowie beim Lesen von Grundrissen oder komplexen Industriediagrammen. Microsoft Copilot , das in das Office-365-Ökosystem integriert ist, glänzt hingegen bei der dokumentenbasierten Schlussfolgerung, indem es Daten aus Excel, Word und Teams mit einer für administrative Aufgaben unerreichten semantischen Präzision verknüpft.

Latenz, Inferenzgeschwindigkeit und Betriebskosten

Die Budgetoptimierung erfordert einen sorgfältigen Vergleich von LLM-Modellen auf der Grundlage der Kosten pro Million Token und der Latenz. Finden wir heraus, welche Modelle für Unternehmen das beste Verhältnis zwischen Tokens pro Sekunde (TPS) und Infrastrukturkosten bieten.

Das eigentliche Schlachtfeld des Jahres 2026 ist die wirtschaftliche Effizienz. „Frontier“-Modelle (Opus, GPT-Spitzenmodelle) sind für Aufgaben mit hohem Volumen, wie die Log-Klassifizierung oder den First-Level-Kundensupport, nicht tragbar. Genau hier kommen optimierte Modelle ins Spiel.

| LLM-Modell | Input-Kosten (pro 1 Mio.) | Output-Kosten (pro 1 Mio.) | Geschwindigkeit (TPS) |

|---|---|---|---|

| Claude 4.7 Opus | 15,00 € | 75,00 € | ca. 25 |

| Claude Sonnet | 3,00 € | 15,00 € | ca. 85 |

| Gemini 3.1 Pro | 5,00 € | 15,00 € | ca. 60 |

| Gemini 3.1 Flash | 0,35 € | 1,05 € | ca. 160 |

| ChatGPT (Enterprise) | 10,00 € | 30,00 € | ca. 45 |

Laut der offiziellen Dokumentation von Google bietet Gemini 3.1 Flash eine Inferenzgeschwindigkeit von etwa 160 Tokens pro Sekunde (TPS), was es ideal für Echtzeitanwendungen und Sprachassistenten macht. Claude Sonnet positioniert sich als der beste Kompromiss auf dem Markt: Es bietet Schlussfolgerungsfähigkeiten, die denen der Spitzenmodelle des Jahres 2025 nahekommen, jedoch zu einem Fünftel der Kosten von Opus und mit einer für den Endbenutzer nicht wahrnehmbaren Latenz.

Integration, Ökosystem und Cloud-Plattformen

Kein Vergleich von LLM-Modellen ist vollständig, ohne den Vendor-Lock-in und die Infrastruktur zu analysieren. Wir vergleichen die Vorteile der APIs von Anthropic und OpenAI mit integrierten Enterprise-Plattformen wie Google Cloud Vertex AI und Microsoft Azure.

Die Wahl des Modells ist untrennbar mit der bestehenden Cloud-Infrastruktur des Unternehmens verbunden. Microsoft Copilot und die OpenAI-Modelle über Azure bieten den entscheidenden Vorteil der Unternehmens-Compliance (HIPAA, strenge DSGVO-Vorgaben) sowie der nativen Integration in Entra ID (ehemals Azure AD) für die Berechtigungsverwaltung auf Einzel-Dokument-Ebene. Nutzt ein Unternehmen bereits das Microsoft-Ökosystem, verkürzt die Einführung von Azure OpenAI die Time-to-Market um 60 %.

Gemini 3.1 auf Google Cloud Vertex AI zeichnet sich durch Data Grounding aus. Es ermöglicht, die Antworten des Modells in Echtzeit direkt an Unternehmensdatenbanken (BigQuery, AlloyDB) sowie an die Google-Suche anzubinden, wodurch Halluzinationen bei proprietären Daten faktisch eliminiert werden. Anthropic verfolgt – obwohl das Unternehmen über keine eigene Cloud-Infrastruktur verfügt – eine plattformunabhängige Strategie: Die Claude-APIs sind auf AWS Bedrock und Google Cloud verfügbar und bieten somit maximale Flexibilität für Multi-Cloud-Architekturen.

Fallstudie: Die Entwicklung des Kundenservices (2024–2026)

Im Jahr 2024 sorgte Klarna für Schlagzeilen, indem das Unternehmen 2,3 Millionen Konversationen (zwei Drittel der Gesamtzahl) über einen auf OpenAI basierenden KI-Assistenten abwickelte, die Bearbeitungsdauer von 11 auf 2 Minuten verkürzte und Einsparungen in Höhe von 40 Millionen US-Dollar verzeichnete. Im Mai 2026 haben führende Unternehmen diesen Ansatz durch die Implementierung von „Dynamic Model Routing“ weiterentwickelt. Anstatt ein einzelnes, rechenintensives Modell zu verwenden, analysiert ein KI-Router die Nutzerabsicht in Millisekunden: 85 % der Standardanfragen werden von Gemini 3.1 Flash bearbeitet (nahezu keine Kosten, sofortige Latenz), während nur 15 % der komplexen Fälle (z. B. Rechtsstreitigkeiten oder ungewöhnliche Rückerstattungen) an Claude 4.7 Opus weitergeleitet werden. Dieser hybride Ansatz hat die Betriebskosten im Vergleich zu 2024 um weitere 70 % gesenkt, wobei die Kundenzufriedenheit unverändert hoch blieb.

Schlussfolgerungen

Zum Abschluss dieses Vergleichs von LLM-Modellen präsentieren wir die finale Entscheidungsmatrix. Die Wahl des richtigen Modells hängt von der Balance zwischen dem Aufrufvolumen, dem Bedarf an Zero-Shot-Reasoning und den Anforderungen an die Unternehmensintegration ab.

Es gibt keinen absoluten Sieger, aber es gibt optimale Entscheidungen je nach Einsatzszenario:

- Aufgaben mit hohem Volumen und geringer Latenz (Chatbots, Triage, grundlegende Datenextraktion): Der unangefochtene Sieger ist Gemini 3.1 Flash . Die äußerst geringen Kosten und die enorme Geschwindigkeit machen es zum einzig logischen Kandidaten für groß angelegte Abläufe.

- Extreme Zero-Shot-Schlussfolgerungen und komplexes Coding: Claude 4.7 Opus bleibt der Goldstandard. Es ist die notwendige Investition, wenn logische Genauigkeit entscheidend ist und menschliche oder maschinelle Fehler hohe Kosten verursachen würden.

- Preis-Leistungs-Verhältnis (Der „Daily Driver“): Claude Sonnet stellt das perfekte Gleichgewicht für 80 % der Unternehmensanwendungen dar, die hohe Intelligenz erfordern, ohne das API-Budget zu sprengen.

- Unternehmensintegration und Dokumentensicherheit: Microsoft Copilot und das ChatGPT-Ökosystem auf Azure überzeugen durch die einfache Bereitstellung in stark regulierten Unternehmensumgebungen.

Die Erfolgsstrategie für 2026 besteht nicht darin, ein einzelnes Modell auszuwählen, sondern eine Routing-Architektur aufzubauen, die jeden Prompt dynamisch an das für die jeweilige Aufgabe effizienteste Modell weiterleitet.

Häufig gestellte Fragen

Für die Softwareentwicklung und fortgeschrittenes logisches Schlussfolgern setzt Claude 4.7 Opus den Maßstab. Dank seiner außergewöhnlichen Fähigkeit, die Konsistenz über mehrere Dateien hinweg zu wahren, löst es komplexe Probleme eigenständig und übertrifft damit die Alternativen auf dem Markt. Es ist das ideale Werkzeug, wenn die Präzision des Codes für das Projekt von entscheidender Bedeutung ist.

Die effektivste Strategie besteht in der Implementierung eines Systems zur dynamischen Weiterleitung von Anfragen. Anstatt für jeden Vorgang ein einziges, kostspieliges Modell zu verwenden, analysiert ein intelligenter Router den Zweck des Prompts und weist einfache Aufgaben kostengünstigen Lösungen wie Gemini 3.1 Flash zu. Komplexe Vorgänge werden an fortschrittliche Modelle weitergeleitet, wodurch die Unternehmenskosten drastisch gesenkt werden.

Gemini 3.1 Pro dominiert diesen Bereich dank eines dynamischen Fensters, das zehn Millionen Token umfasst und die Analyse ganzer Archive ohne Fragmentierung ermöglicht. Claude 4.7 Opus und Sonnet gewährleisten jedoch eine perfekte Informationswiedergabe selbst an den Grenzen ihres Kontextes, wodurch strukturelle Halluzinationen bei der Verarbeitung umfangreicher Texte auf ein Minimum reduziert werden.

Die Entscheidung für das Microsoft-System bietet enorme Vorteile hinsichtlich der regulatorischen Compliance und der Sicherheit von Unternehmensdaten. Diese Lösung gewährleistet eine native Integration für die Verwaltung von Berechtigungen auf Ebene einzelner Dokumente. Sie stellt somit die optimale Wahl für stark regulierte Unternehmen dar, die eine strikte Kontrolle über Zugriffe und sensible Informationen benötigen.

Die Versionen Pro und Flash von Gemini basieren auf einer Architektur, die bereits ab der grundlegenden Trainingsphase nativ multimodal ist. Das bedeutet, dass sie visuelle oder auditive Inhalte nicht erst in Text umwandeln müssen, bevor sie diese verarbeiten, sondern die Daten direkt abbilden. Das Ergebnis ist eine extrem hohe Präzision beim Verständnis von Echtzeit-Videos und komplexen Industriediagrammen.

Haben Sie noch Zweifel an Vergleichende Analyse und Leitfaden zur Auswahl von LLM-Modellen (Mai 2026)?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

- Large Language Model (Großes Sprachmodell) – Grundlagen und Architektur (Wikipedia)

- Generative KI und Large Language Models: Leitfaden und Analyse für Unternehmen (Fraunhofer IAIS)

- Europäisches Gesetz über künstliche Intelligenz (AI Act) – Europäische Kommission

- Retrieval-Augmented Generation (RAG) – Technische Funktionsweise (Wikipedia)

- Mixture of Experts (MoE) Architektur für maschinelles Lernen (Wikipedia)

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.