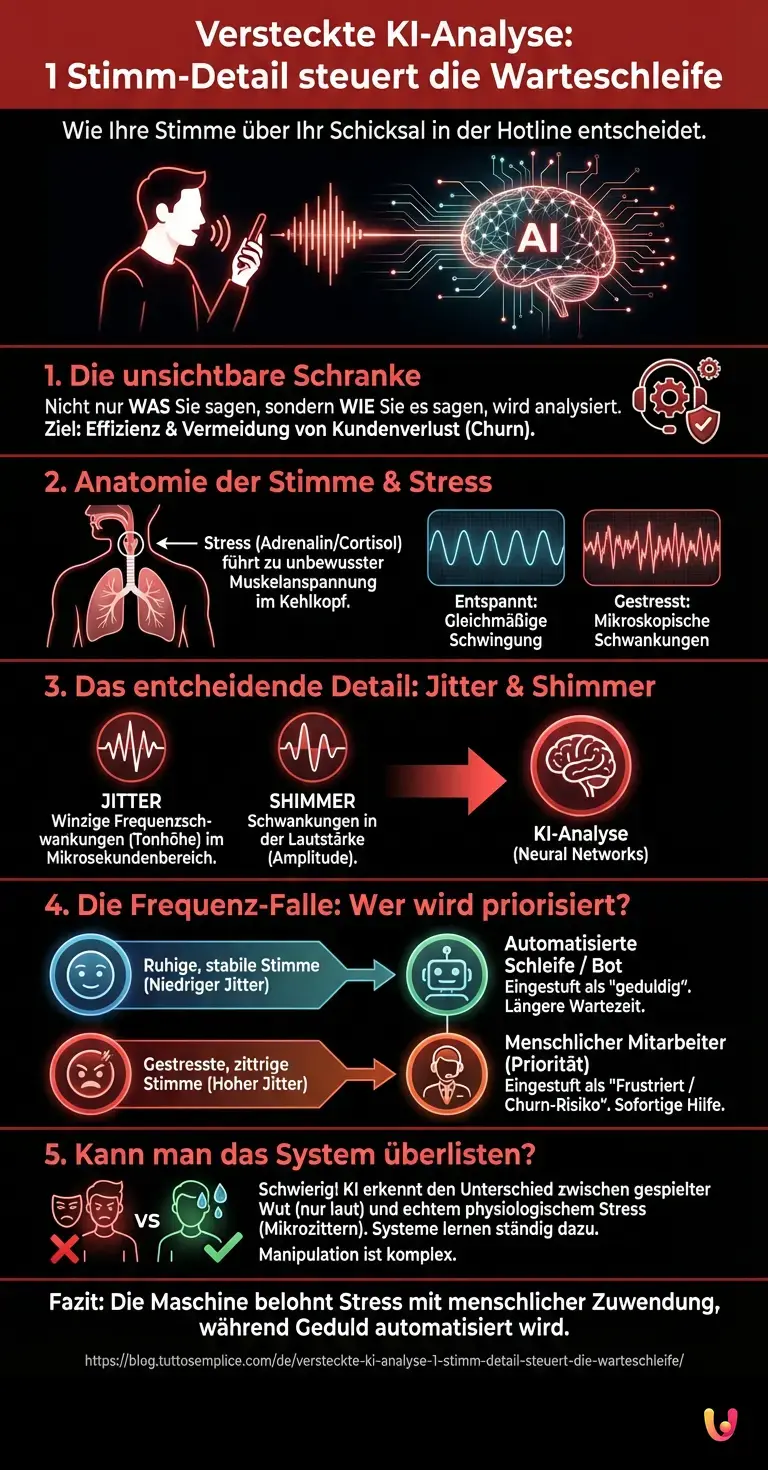

Jeder kennt die Situation: Man ruft bei der Hotline eines großen Telekommunikationsanbieters, einer Bank oder eines Online-Händlers an. Eine freundliche, aber unverkennbar synthetische Stimme begrüßt einen und bittet darum, das Anliegen in wenigen Worten zu schildern. Was die meisten Anrufer in diesem Moment nicht wissen: Noch bevor sie ihren Satz beendet haben, hat eine hochkomplexe Sprachanalyse-KI bereits eine weitreichende Entscheidung getroffen. Diese Entscheidung bestimmt, ob der Anrufer in einer endlosen automatisierten Schleife gefangen bleibt oder ob er binnen Sekunden mit einem menschlichen Mitarbeiter verbunden wird. Es ist nicht primär der Inhalt der Worte, der dieses Schicksal besiegelt. Es ist ein winziges, für das menschliche Ohr oft kaum wahrnehmbares Detail in der Akustik. Willkommen in der Frequenz-Falle.

Die unsichtbare Schranke im Kundenservice

Um zu verstehen, was im Hintergrund abläuft, müssen wir einen Blick auf die Architektur moderner Callcenter werfen. Früher basierten diese Systeme auf einfachen DTMF-Tönen (Dual-Tone Multi-Frequency) – dem klassischen “Drücken Sie die 1 für Rechnungsfragen”. Später folgten schlüsselwortbasierte Spracherkennungssysteme, die nach Wörtern wie “Kündigung” oder “Störung” suchten. Doch diese Zeiten sind längst vorbei. Heute durchdringt Künstliche Intelligenz jeden Aspekt der Kundeninteraktion.

Moderne Routing-Systeme nutzen fortschrittliche AI-Technologien, um nicht nur das Was, sondern vor allem das Wie einer Äußerung zu analysieren. Das Ziel der Unternehmen ist simpel: Effizienzsteigerung. Menschliche Agenten sind teuer und ihre Zeit ist begrenzt. Daher sollen Routineanfragen möglichst von automatisierten Systemen abgearbeitet werden. Doch gleichzeitig fürchten Unternehmen nichts mehr als den sogenannten “Churn” – den Verlust eines zahlenden Kunden aufgrund von Frustration. Hier entsteht ein technologischer Spagat, der durch eine präzise akustische Analyse gelöst wird.

Die Anatomie der menschlichen Stimme

Die menschliche Stimme ist ein physikalisches Wunderwerk und gleichzeitig ein unbestechlicher Spiegel unseres vegetativen Nervensystems. Wenn wir sprechen, pressen unsere Lungen Luft durch die Luftröhre. Diese Luftströmung versetzt die Stimmlippen im Kehlkopf (Larynx) in Schwingung. Die Frequenz, mit der diese Stimmlippen schwingen, bestimmt die Tonhöhe unserer Stimme – die sogenannte Grundfrequenz (F0). Bei Männern liegt diese typischerweise zwischen 85 und 180 Hertz (Hz), bei Frauen zwischen 165 und 255 Hz.

Doch eine Stimme besteht nicht nur aus einem einzigen, sauberen Ton. Sie ist ein komplexes Gemisch aus der Grundfrequenz und zahlreichen Obertönen, die im Vokaltrakt (Rachen, Mund- und Nasenhöhle) moduliert werden. Unter normalen, entspannten Bedingungen schwingen die Stimmlippen sehr gleichmäßig. Die Abstände zwischen den einzelnen Schwingungsperioden sind nahezu identisch. Doch sobald Emotionen ins Spiel kommen, ändert sich diese physikalische Harmonie drastisch.

Jitter und Shimmer: Die Verräter unserer Emotionen

Hier schließt sich der Kreis zur Frequenz-Falle und dem winzigen Detail, das über Ihr Hotline-Schicksal entscheidet. Wenn ein Mensch frustriert, wütend oder gestresst ist, schüttet der Körper Adrenalin und Cortisol aus. Das vegetative Nervensystem bereitet den Organismus auf eine Kampf-oder-Flucht-Reaktion vor. Dies führt zu einer unbewussten, unwillkürlichen Anspannung der Muskulatur – auch der winzigen Muskeln im Kehlkopf.

Diese mikroskopische Muskelanspannung stört die gleichmäßige Schwingung der Stimmlippen. Es entstehen zwei messbare Phänomene:

- Jitter: Dies bezeichnet die winzigen, unregelmäßigen Schwankungen der Frequenz von einer Schwingungsperiode zur nächsten. Auch wenn die Stimme für das menschliche Ohr konstant klingt, misst das System Abweichungen im Mikrosekundenbereich.

- Shimmer: Dies beschreibt die Schwankungen in der Amplitude (Lautstärke) der aufeinanderfolgenden Schallwellen.

Ein hoher Jitter-Wert ist der ultimative, unbewusste Verräter von Stress und Frustration. Es ist das akustische Äquivalent zu zitternden Händen. Genau dieses winzige Detail – die Instabilität der Grundfrequenz im Millisekundenbereich – ist der Schlüsselparameter, den die Systeme an der Hotline auswerten.

Wie maschinelles Lernen das Flüstern der Nerven decodiert

Die Erfassung von Jitter und Shimmer ist an sich eine rein mathematische Signalverarbeitung. Doch um aus diesen Rohdaten eine verlässliche Entscheidung abzuleiten, kommt maschinelles Lernen zum Einsatz. Das Audiosignal des Anrufers wird in Echtzeit in sogenannte Mel-Frequency Cepstral Coefficients (MFCCs) zerlegt. Diese Koeffizienten repräsentieren das Kurzzeit-Leistungsspektrum des Schalls und bilden die Grundlage für die weitere Analyse.

Anschließend werden diese Daten in komplexe Neural Networks (neuronale Netze) eingespeist. Diese Netzwerke, oft Convolutional Neural Networks (CNNs) oder Recurrent Neural Networks (RNNs), wurden mit Millionen von Stunden an Sprachaufzeichnungen trainiert. Sie haben gelernt, die spezifischen Muster von Jitter, Shimmer, Sprechgeschwindigkeit und Energieverteilung mit bestimmten emotionalen Zuständen zu korrelieren. Diese Disziplin wird in der Fachwelt als “Voice Emotion Recognition” (VER) oder “Emotion AI” bezeichnet.

Es ist wichtig, diese akustische Analyse von der semantischen Analyse zu trennen. Während ein modernes LLM (Large Language Model) wie ChatGPT hervorragend darin ist, den inhaltlichen Sinn eines Textes zu verstehen und logische Antworten zu generieren, ist es für die Emotionsebene der Stimme blind. Ein Text-KI-Modell liest nur das Transkript: “Mein Internet funktioniert nicht.” Die akustische KI hingegen misst das Mikrozittern in den Vokalen dieses Satzes. Erst die Kombination aus beiden Welten macht das System mächtig. Der Einsatz von Generative AI ermöglicht es dem System anschließend, eine natürlich klingende, deeskalierende Antwort zu formulieren, falls der Anrufer im automatisierten System verbleibt.

Die Frequenz-Falle schnappt zu: Wer wird priorisiert?

Warum aber ist dieses Detail nun eine “Falle”? Die Logik der Callcenter-Software basiert auf einer strengen Risikobewertung. Wenn die KI einen Anrufer mit einer ruhigen, stabilen Stimme (niedriger Jitter, konstanter Shimmer) analysiert, stuft sie diesen als “kooperativ” und “geduldig” ein. Das System geht davon aus, dass dieser Kunde die kognitive und emotionale Kapazität hat, sich durch Menüs zu navigieren, mit einem Bot zu interagieren und längere Wartezeiten zu tolerieren, ohne sofort seinen Vertrag zu kündigen.

Detektiert das neuronale Netz jedoch einen hohen Jitter-Wert, eine erhöhte Grundfrequenz und abrupte Energieanstiege in den Konsonanten, schrillen im Hintergrund die digitalen Alarmglocken. Das System klassifiziert den Anrufer als “hochgradig frustriert” oder “wütend”. In der Logik des Customer Relationship Managements (CRM) stellt dieser Kunde ein akutes Abwanderungsrisiko (Churn Risk) dar.

Die Konsequenz: Um eine weitere Eskalation zu vermeiden und den Kunden zu besänftigen, wird die automatisierte Schleife sofort abgebrochen. Der Anrufer wird mit höchster Priorität an einen speziell geschulten, menschlichen Deeskalations-Agenten durchgestellt. Die Frequenz-Falle besteht also in einem paradoxen Umstand: Wer höflich, ruhig und entspannt bleibt, wird von der Maschine als “verträglich” eingestuft und muss länger warten oder sich mit dem Bot unterhalten. Wer hingegen (bewusst oder unbewusst) gestresst klingt, erhält den menschlichen VIP-Service.

Können wir die Systeme überlisten?

Angesichts dieses Wissens stellt sich unweigerlich die Frage: Kann man das System manipulieren? Kann man einfach wütend klingen, um schneller durchgestellt zu werden? Die Antwort ist ein klares Jein. Einfach nur laut zu werden oder Schimpfwörter zu benutzen, reicht oft nicht aus. Zwar erkennen moderne Systeme auch aggressive Schlüsselwörter, doch die akustische Analyse ist weitaus subtiler.

Es ist für einen Menschen extrem schwierig, die unwillkürlichen Mikroschwankungen (Jitter) der Stimmlippen bewusst zu simulieren, ohne dass es künstlich oder theatralisch klingt. Hochwertige Algorithmen können sehr gut zwischen echtem, physiologischem Stress und gespielter Wut unterscheiden. Gespielte Wut äußert sich meist nur in einer erhöhten Lautstärke und einer künstlich veränderten Tonhöhe, lässt aber die feinen, chaotischen Frequenzschwankungen vermissen, die nur durch echte Adrenalinausschüttung entstehen.

Dennoch gibt es Berichte von Nutzern, die durch schnelles, abgehacktes Sprechen und leichtes, künstliches Zittern in der Stimme erfolgreich das Routing-System umgangen haben. Da die Systeme ständig dazulernen, wird dieses Katz-und-Maus-Spiel zwischen Anrufer und Algorithmus in Zukunft jedoch immer anspruchsvoller werden.

Kurz gesagt (TL;DR)

Moderne Callcenter nutzen versteckte KI-Systeme, die nicht nur den Inhalt Ihrer Worte, sondern den Klang Ihrer Stimme in Echtzeit analysieren.

Ein winziges akustisches Detail namens Jitter verrät unbewussten Stress und Frustration, da Emotionen die gleichmäßige Schwingung unserer Stimmlippen sofort messbar stören.

Basierend auf dieser unmerklichen Stimmanalyse entscheidet die künstliche Intelligenz blitzschnell, ob Sie in der Warteschleife bleiben oder einen menschlichen Berater erreichen.

Fazit

Die Zeiten, in denen wir an einer Hotline lediglich mit einem dummen Sprachcomputer sprachen, sind endgültig vorbei. Moderne Kundenservice-Systeme sind hochsensible, biometrische Analysewerkzeuge. Sie hören nicht nur zu, was wir sagen, sondern sie dringen tief in unsere Physiologie ein. Das winzige Detail der Frequenzschwankungen – der Jitter – fungiert als unbestechlicher Indikator unseres emotionalen Zustands.

Diese Technologie zeigt eindrucksvoll, wie weit die Verschmelzung von Akustik, Biologie und Datenverarbeitung bereits fortgeschritten ist. Sie offenbart aber auch eine zutiefst ironische Dynamik in unserer automatisierten Welt: Die Maschine belohnt diejenigen, die an der Schwelle zum Kontrollverlust stehen, mit menschlicher Zuwendung. Wer hingegen die gesellschaftliche Konvention der Höflichkeit und Ruhe wahrt, wird der Maschine überlassen. Wenn Sie also das nächste Mal in einer Warteschleife festhängen, denken Sie daran: Es ist nicht Ihre Geduld, die geprüft wird – es ist die Stabilität Ihrer Grundfrequenz.

Häufig gestellte Fragen

Moderne Callcenter nutzen künstliche Intelligenz, um die Stimme und Stimmung der Anrufer in Echtzeit zu analysieren. Wenn Sie am Telefon ruhig und entspannt klingen, stuft das System Sie als geduldig ein und belässt Sie länger im automatisierten Menü. Gestresste Kunden werden hingegen sofort zu menschlichen Mitarbeitern durchgestellt, um eine Eskalation zu verhindern.

Die Sprachanalyse-KI achtet nicht nur auf den reinen Inhalt Ihrer Worte, sondern vor allem auf unbewusste akustische Signale. Sie misst winzige Frequenzschwankungen und Lautstärkeunterschiede in der Stimme, die durch eine stressbedingte Anspannung der Kehlkopfmuskulatur entstehen. Diese biometrischen Parameter verraten dem System absolut zuverlässig, ob ein Anrufer frustriert oder wütend ist.

Es ist extrem schwierig, die KI durch gespielte Wut oder lautes Schreien zu manipulieren. Hochwertige Algorithmen erkennen den Unterschied zwischen echter Aufregung und künstlichem Verhalten sehr genau, da echte Frustration unwillkürliche Mikroschwankungen in den Stimmlippen erzeugt. Ein leichtes und unruhiges Zittern in der Stimme kann manchmal helfen, aber die Systeme lernen durch maschinelles Lernen ständig dazu.

Jitter beschreibt mikroskopisch kleine und unregelmäßige Schwankungen der Tonhöhe von einer Schwingungsperiode zur nächsten, die für das menschliche Ohr kaum hörbar sind. Wenn ein Mensch gestresst ist, schüttet der Körper Stresshormone aus, was zu einer unbewussten Anspannung der feinen Stimmmuskeln führt. Für die Software der Callcenter ist ein hoher Wert dieses Parameters der wichtigste Indikator für emotionale Frustration.

Große Unternehmen möchten um jeden Preis verhindern, dass zahlende Kunden aus purer Frustration ihren Vertrag kündigen. Sobald die Software durch akustische Stresssignale ein hohes Abwanderungsrisiko erkennt, bricht sie die automatische Schleife zu Ihrem Schutz sofort ab. Der Anrufer wird dann mit höchster Priorität an einen speziell geschulten Deeskalations-Mitarbeiter weitergeleitet, um das Problem persönlich zu lösen.

Haben Sie noch Zweifel an Versteckte KI-Analyse: 1 Stimm-Detail steuert die Warteschleife?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Quellen und Vertiefung

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.