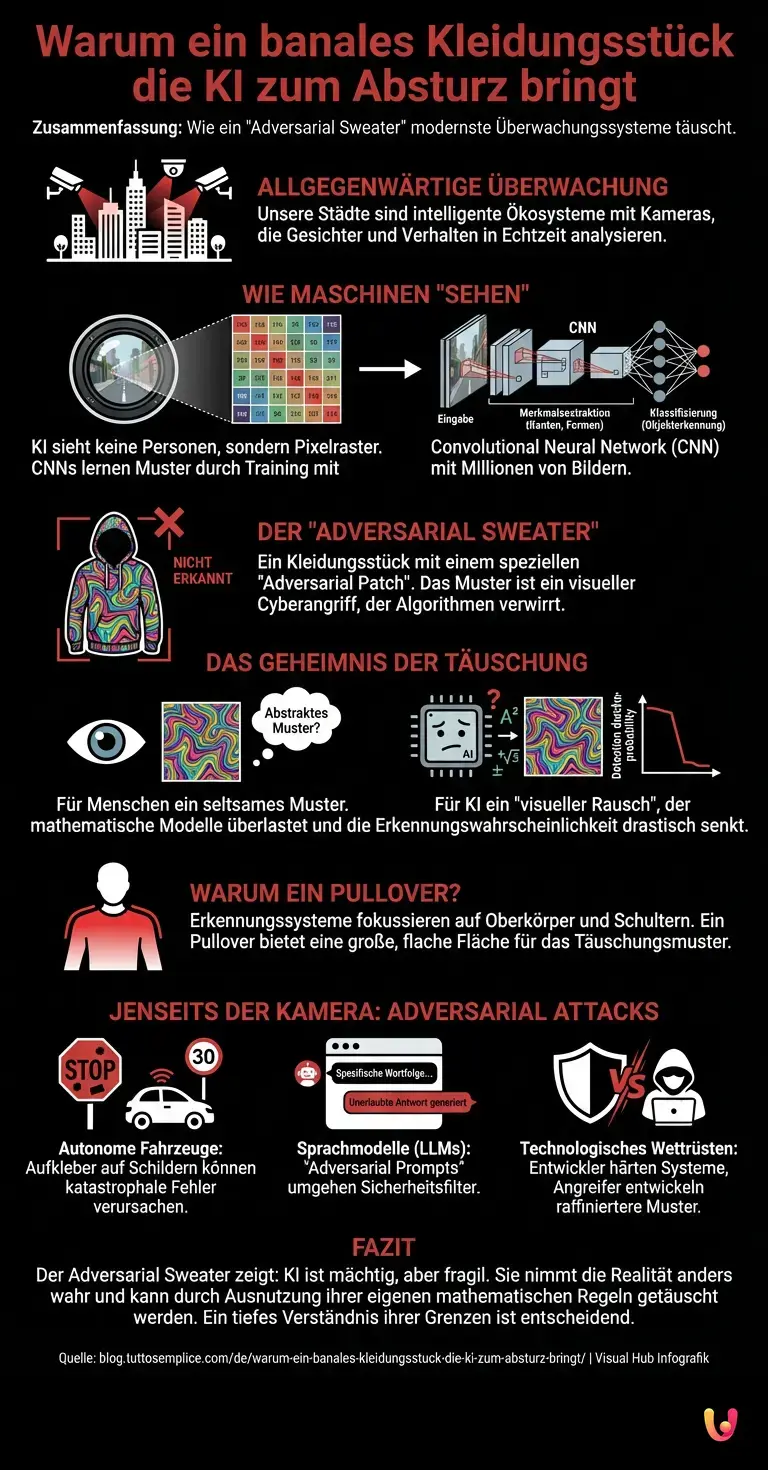

Wir leben in einer Zeit, in der der öffentliche Raum ständig überwacht wird. Unsere Städte sind zu intelligenten Ökosystemen geworden, durchzogen von modernsten Überwachungskameras, die nicht nur Bilder aufzeichnen, sondern diese auch in Echtzeit analysieren. Sie erkennen Gesichter, verfolgen Bewegungen und identifizieren ungewöhnliche Verhaltensweisen. Angesichts dieser allgegenwärtigen Überwachung könnte die instinktive Reaktion darin bestehen, sich futuristische Lösungen zum Schutz der Privatsphäre vorzustellen, wie Unsichtbarkeitsumhänge oder elektromagnetische Störgeräte. Doch die effektivste und überraschendste Antwort findet sich in einem alltäglichen Gegenstand, der Sicherheitsexperten im Bereich der Informatik als „adversarial sweater“ (Gegnerpullover) bekannt ist. Dieses scheinbar harmlose Kleidungsstück birgt ein technologisches Geheimnis, das die fortschrittlichsten Systeme der maschinellen Bildverarbeitung der Welt lahmlegen kann.

Um zu verstehen, wie ein einfaches Kleidungsstück Überwachungssysteme besiegen kann, die Millionen von Dollar an Forschungs- und Entwicklungskosten verschlungen haben, muss man einen Schritt zurückgehen und analysieren, wie Maschinen die Welt „sehen“ . Künstliche Intelligenz besitzt keine Augen und kein biologisches Gehirn, das Licht und Formen intuitiv interpretieren kann. Maschinelles Sehen basiert auf komplexen mathematischen und statistischen Modellen.

Das digitale Auge: Wie Maschinen „sehen“

Wenn eine Kamera eine Straße aufnimmt, sieht sie keine „Personen“ oder „Autos“. Sie sieht ein Raster aus Pixeln, von denen jedes einen numerischen Wert hat, der seine Farbe und Helligkeit darstellt. Hier kommt maschinelles Lernen ins Spiel. Durch das Training mit Millionen von vorab gekennzeichneten Bildern lernen Systeme, spezifische Muster zu erkennen. Wenn eine Gruppe von Pixeln bestimmte Kontrast-, Kanten- und Gradientenvariationen aufweist, berechnet das System die Wahrscheinlichkeit, dass diese Datenmenge einen Menschen darstellt.

Dieser Prozess wird durch Deep Learning und insbesondere durch eine spezifische neuronale Architektur, bekannt als Convolutional Neural Network (CNN), ermöglicht. Diese Netzwerke analysieren das Bild schichtweise: Die ersten Schichten erkennen einfache Linien und Kanten, die mittleren Schichten identifizieren geometrische Formen, und die letzten Schichten setzen diese Elemente zusammen, um komplexe Objekte wie ein Gesicht oder die Silhouette eines menschlichen Körpers zu erkennen. Bekannte Systeme wie YOLO (You Only Look Once) können diese Operationen in Sekundenbruchteilen durchführen und zeichnen sogenannte „Bounding Boxes“ (Begrenzungsrahmen) um die im Video identifizierten Personen.

Das Geheimnis gelüftet: Die Wissenschaft des gegnerischen Pullovers

Wenn KI auf visuellen Mustern basiert, um einen Menschen zu identifizieren, was passiert dann, wenn wir ihr ein Muster liefern, das speziell dazu entwickelt wurde, sie zu verwirren? Genau darauf basiert der Prinzip des „adversarial sweater“ (Gegnerischer Pullover). Es handelt sich nicht um einen magischen Stoff, der das Licht beugt, sondern um ein Kleidungsstück, das mit einem ganz bestimmten Bild bedruckt ist, das in der Fachsprache als „adversarial patch“ (Gegnerischer Patch) bezeichnet wird.

Für einen Menschen sieht der Pullover einfach wie ein Kleidungsstück mit einem seltsamen, vielleicht etwas psychedelischen oder abstrakten Muster aus. Es könnte ein unscharfes Bild von Menschen auf einem Markt sein oder eine Collage bunter geometrischer Formen. Doch für Algorithmen zur Objekterkennung stellt dieses Muster einen regelrechten visuellen Cyberangriff dar.

Die Forscher nutzten dieselbe künstliche Intelligenz, um diese Drucke zu erzeugen. Sie beauftragten einen Algorithmus, ein Bild zu kreieren, das exakt die visuellen Merkmale (Verläufe, Kontraste, Linienkreuzungen) enthielt, die neuronale Netze mit „etwas, das keine Person ist“ assoziieren, oder das einen solchen „visuellen Rausch“ erzeugte, dass das Klassifizierungssystem überlastet wurde. Wenn eine Person diesen Pullover trägt, erfasst die Kamera die Szene. Das neuronale Netz beginnt, die Pixel zu analysieren. Doch wenn es den vom Pullover bedeckten Brustbereich erreicht, geraten die mathematischen Berechnungen außer Kontrolle. Die Wahrscheinlichkeitswerte, die auf die Anwesenheit eines Menschen hindeuten, brechen drastisch ein. Das System entscheidet einfach, dass dort niemand ist. Die Person wird somit für alle digitalen Zwecke unsichtbar.

Warum gerade ein Pullover?

Die Wahl des Kleidungsstücks ist nicht zufällig. Fußgängererkennungssysteme basieren stark auf der Identifizierung von Oberkörper und Schultern, da dies die größten und sichtbarsten Körperteile sind, die weniger von Verdeckungen betroffen sind als Beine oder Arme. Das Abdecken dieses kritischen Bereichs mit einem gegnerischen Patch maximiert die Wirksamkeit der Täuschung. Darüber hinaus bieten ein Pullover oder ein Sweatshirt eine große und relativ flache Oberfläche zum Aufdrucken des Musters, wodurch sichergestellt wird, dass sich das Bild durch Körperbewegungen nicht übermäßig verformt, was seine Wirksamkeit beeinträchtigen könnte.

Tests in verschiedenen universitären Laboren haben gezeigt, dass diese Kleidungsstücke Überwachungssysteme mit erstaunlich hohen Erfolgsquoten umgehen und dabei alle gängigen Sicherheitsstandards zur Bewertung der Robustheit von Computer-Vision-Software mit Bravour bestehen.

Jenseits der Überwachung: Die Auswirkungen auf die Zukunft

Die Entdeckung dieser Schwachstelle wirft tiefgreifende Fragen auf, die weit über den bloßen Wunsch hinausgehen, eine Überwachungskamera zu umgehen. Sie zeigt, dass KI-Systeme, so fortschrittlich sie auch sein mögen, die Realität auf eine grundlegend andere Weise wahrnehmen als wir. Es sind statistische Maschinen, und als solche können sie durch Ausnutzung ihrer eigenen mathematischen Regeln getäuscht werden.

Dieses Phänomen der „ adversarial attacks “ beschränkt sich nicht auf die maschinelle Bilderkennung. Es ist ein systemisches Problem, das das gesamte Gebiet der künstlichen Intelligenz betrifft. So haben Forscher beispielsweise im Bereich der Automatisierung und autonomer Fahrzeuge gezeigt, dass das Anbringen weniger kleiner schwarzer Aufkleber auf ein „Stopp“-Schild ausreicht, um ein Fahrzeug glauben zu lassen, es handele sich um ein Geschwindigkeitsbegrenzungsschild – mit potenziell katastrophalen Folgen.

Ähnlich verhält es sich auch im Bereich der Verarbeitung natürlicher Sprache. Große Sprachmodelle (Large Language Models, LLMs ) wie GPT-4 können „adversarial prompts“ (oft als Jailbreaks bezeichnet) ausgesetzt sein. Durch die Eingabe spezifischer Wortfolgen, die für einen Menschen scheinbar harmlos oder bedeutungslos sind, können die Sicherheitsfilter des Modells umgangen und es gezwungen werden, Antworten zu generieren, die ihm normalerweise verboten wären. Die Grundlogik ist dieselbe wie beim Pullover: Es wird eine Eingabe (visuell oder textuell) bereitgestellt, die die blinden Flecken der Modellarchitektur ausnutzt.

Das technologische Wettrüsten

Der technologische Fortschritt in diesem Bereich hat ein regelrechtes Wettrüsten zwischen den Entwicklern von KI-Systemen und jenen ausgelöst, die versuchen, diese zu umgehen. Einerseits arbeiten Ingenieure daran, neuronale Netze robuster zu machen und sie darauf zu trainieren, gegnerische Patches zu erkennen und zu ignorieren. Andererseits entwickeln Forscher (und potenziell auch böswillige Akteure) immer raffiniertere Muster, die sich an verschiedene Blickwinkel und Lichtverhältnisse anpassen und sogar Infrarotsensoren täuschen können.

Diese Dynamik ist entscheidend für die Verbesserung der Technologie. Die Erkenntnis, dass ein einfacher Pullover ein Sicherheitssystem außer Gefecht setzen kann, zwingt die Entwickler dazu, die Unfehlbarkeit ihrer Kreationen nicht als selbstverständlich anzusehen. Sie erinnert uns daran, dass künstliche Intelligenz ein mächtiges, aber fragiles Werkzeug ist und ihre Integration in kritische Infrastrukturen ein tiefes Verständnis ihrer inhärenten Grenzen erfordert.

Schlussfolgerungen

Der Adversarial-Sweater stellt ein faszinierendes Paradoxon unseres digitalen Zeitalters dar: Die komplexeste und ausgeklügeltste Technologie kann von einem bedruckten Baumwollstück lahmgelegt werden. Dieses Kleidungsstück ist nicht nur ein kurioser Trick, um dem Big Brother zu entkommen, sondern die physische Manifestation einer mathematischen Schwachstelle. Es lehrt uns, dass sich mit der Weiterentwicklung und zunehmenden Durchdringung aller Lebensbereiche durch künstliche Intelligenz auch unser Verständnis davon, wie diese Maschinen „denken“ und „sehen“, weiterentwickeln muss. Unsichtbarkeit erfordert heute keine Magie, sondern nur die richtige Kombination von Pixeln, die auf ein alltägliches Kleidungsstück gedruckt werden.

Häufig gestellte Fragen

Ein „adversarial sweater“ ist ein spezielles Kleidungsstück, das entwickelt wurde, um KI-basierte Überwachungssysteme zu täuschen. Es weist einen besonderen Aufdruck auf, einen sogenannten „adversarial patch“, der visuelles Rauschen erzeugt und die Erkennungsalgorithmen verwirrt. Durch das Tragen dieses Kleidungsstücks geraten die mathematischen Berechnungen der Kamera durcheinander, und die Person wird für das digitale System effektiv unsichtbar.

Bildverarbeitungssysteme sehen die Welt nicht wie Menschen, sondern analysieren ein Pixelraster und bewerten Farben und Lichtintensität. Mithilfe von Convolutional Neural Networks (CNNs) suchen Algorithmen nach spezifischen Mustern wie Kontrasten und geometrischen Formen, die typisch für den menschlichen Körper sind. Wenn diese mathematischen Elemente mit den Trainingsdaten übereinstimmen, identifiziert die Software die Anwesenheit eines Fußgängers.

Fußgängererkennungssoftware konzentriert sich hauptsächlich auf die Identifizierung von Oberkörper und Schultern, da dies die größten Körperteile sind und am wenigsten von visuellen Hindernissen beeinträchtigt werden. Ein Pullover bietet eine große, relativ flache Oberfläche, die sich ideal eignet, um das Muster des Gegners aufzunehmen, ohne es während der Bewegung zu stark zu verformen. Das Abdecken dieses kritischen Bereichs maximiert die Erfolgsaussichten der digitalen optischen Täuschung.

Das Problem der mathematischen Schwachstellen betrifft das gesamte Gebiet des maschinellen Lernens, nicht nur Sicherheitskameras. Im Bereich autonomer Fahrzeuge können kleine Aufkleber auf einem Verkehrszeichen die Wahrnehmung des Fahrzeugs vollständig verändern und so erhebliche Gefahren verursachen. Auch fortgeschrittene Sprachmodelle können durch speziell gestaltete Textsequenzen, die darauf ausgelegt sind, Sicherheitsfilter zu umgehen, ähnlich manipuliert werden.

Derzeit findet ein regelrechter technologischer Wettstreit zwischen den Entwicklern von Sicherheitssystemen und denjenigen statt, die Methoden zu deren Umgehung entwickeln. Informatiker arbeiten kontinuierlich daran, neuronale Netze robuster zu gestalten, indem sie sie darauf trainieren, betrügerische Muster zu erkennen und zu ignorieren. Diese Dynamik ist entscheidend, um die inhärenten Grenzen der Technologie aufzudecken und die Zuverlässigkeit kritischer Infrastrukturen der Zukunft zu verbessern.

Haben Sie noch Zweifel an Warum ein banales Kleidungsstück die KI zum Absturz bringt?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.