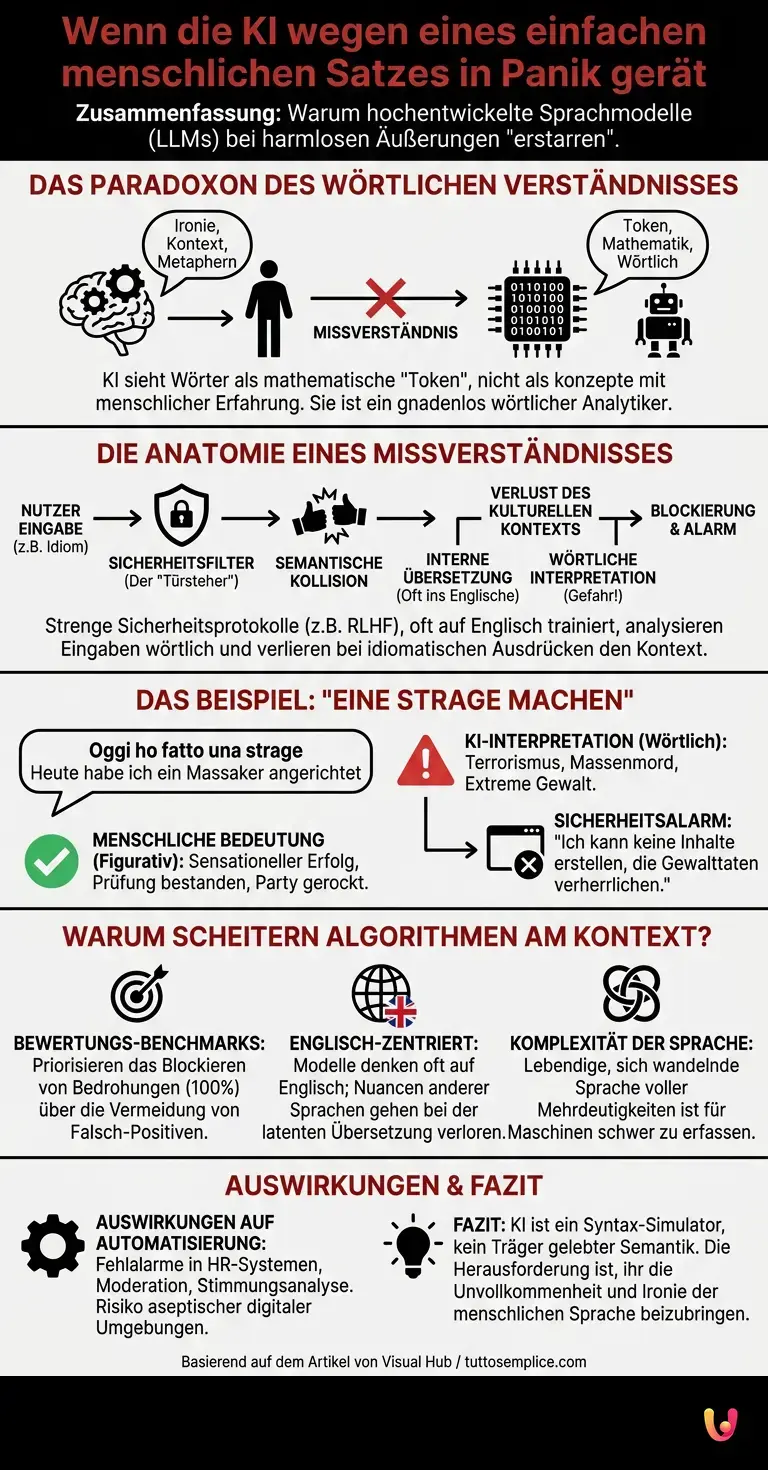

Heute, im April 2026, hat die tägliche Interaktion mit Maschinen einen Grad an Flüssigkeit erreicht, der noch vor einem Jahrzehnt ausschließlich der Science-Fiction vorbehalten war. Doch trotz dieses außergewöhnlichen technologischen Fortschritts gibt es eine Achillesferse, die ebenso faszinierend wie frustrierend ist. Im Zentrum dieses Paradoxons stehen die LLMs (Large Language Models) , jene hochentwickelten Sprachmodelle, die unsere virtuellen Assistenten antreiben. Obwohl sie in der Lage sind , komplexen Programmcode zu schreiben , wissenschaftliche Abhandlungen zu verfassen und Dutzende von Sprachen in Echtzeit zu übersetzen, können diese Systeme angesichts eines völlig harmlosen menschlichen Satzes – der täglich von Millionen von Menschen ausgesprochen wird – plötzlich „erstarren“ und rote Sicherheitsalarme auslösen. Doch was veranlasst eine hochentwickelte künstliche Intelligenz dazu, eine gewöhnliche umgangssprachliche Äußerung für eine unmittelbare Bedrohung zu halten?

Das Paradoxon des wörtlichen Verständnisses

Um die Ursache dieses Kurzschlusses zu verstehen, müssen wir zunächst die Art und Weise entmystifizieren, wie künstliche Intelligenz unsere Texte „liest“. Wenn wir mit einem System wie ChatGPT oder anderen ähnlichen Assistenten interagieren, neigen wir dazu, unser Gegenüber zu vermenschlichen . Wir stellen uns vor, dass sich auf der anderen Seite eine Instanz befindet, die in der Lage ist, Ironie, Sarkasmus und vor allem den kulturellen Kontext zu erfassen. Die Realität sieht jedoch völlig anders aus und ist in der reinen Mathematik verwurzelt.

Modelle des maschinellen Lernens verstehen Wörter nicht als abstrakte Konzepte, die durch menschliche Erfahrung geprägt sind, sondern als „Token“ – also Textfragmente, die in numerische Koordinaten innerhalb eines mehrdimensionalen Raums umgewandelt wurden. Wenn wir bildhafte Sprache verwenden, verlassen wir uns auf eine ungeschriebene soziale Vereinbarung mit unserem menschlichen Gegenüber: Wir beide wissen, dass die ausgesprochenen Wörter nicht wörtlich zu nehmen sind. Die KI hingegen ist ein gnadenlos wörtlicher Analytiker. Obwohl moderne neuronale Netze mit Terabytes an Daten trainiert wurden, um Redewendungen zu erkennen, arbeiten ihre Sicherheitsfilter oft auf einer anderen Abstraktionsebene, was zu einer fatalen Diskrepanz zwischen dem führt, was wir sagen, und dem, was die Maschine „versteht“.

Die Anatomie eines Missverständnisses: Was hinter den Kulissen geschieht

Der Kern des Problems liegt in der neuronalen Architektur der Sicherheitssysteme , die den Sprachmodellen zur Seite gestellt sind. Um in den letzten Jahren zu verhindern, dass die KI schädliche, gewalttätige oder illegale Inhalte generiert, haben Entwickler strenge Ausrichtungsprotokolle implementiert (die häufig auf Verfahren wie dem Reinforcement Learning from Human Feedback, kurz RLHF, basieren). Diese Filter fungieren wie ein Türsteher am Eingang eines Lokals: Sie analysieren die Eingabe des Nutzers, noch bevor das Hauptmodell eine kreative Antwort formulieren kann.

Das Problem entsteht dadurch, dass diese Sicherheitsfilter vorwiegend auf Englisch und mit Datensätzen trainiert wurden, in denen bestimmte Schlüsselwörter eindeutig mit realen Gefahren verknüpft sind. Wenn Deep Learning im Sicherheitsbereich auf Sprachen trifft, die reich an bildhaften idiomatischen Ausdrücken sind – wie Italienisch, Spanisch oder Französisch –, tritt ein Phänomen auf, das als „semantische Kollision“ bekannt ist. Die internen Übersetzungsalgorithmen lösen den Ausdruck in dem Versuch, die Bedeutung des Satzes zur Einschätzung seines Gefahrenpotenzials zu erfassen, aus seinem kulturellen Kontext und reduzieren ihn auf seine direktesten und oft gewaltsamsten wörtlichen Bestandteile.

Der „beanstandete“ Ausdruck und der logische Kurzschluss

Damit kommen wir zum Kern unserer Neugier. Um welchen so gebräuchlichen Ausdruck handelt es sich, der Sicherheitssysteme in Angst und Schrecken versetzt? Im Italienischen ist einer der Sätze, die die meisten Fehlalarme und Systemblockaden auslösen, der überaus verbreitete Ausruf: „Oggi ho fatto una strage“ – oder dessen Entsprechungen „Ho spaccato tutto“ beziehungsweise „Ho fatto il botto“ . In unserem alltäglichen Sprachgebrauch, insbesondere unter jungen Menschen sowie im beruflichen und akademischen Umfeld, bedeutet „fare una strage“, einen sensationellen Erfolg erzielt, eine Prüfung mit Bestnoten bestanden oder auf einer Party die Aufmerksamkeit aller auf sich gezogen zu haben.

Betrachten wir jedoch, was im „Gehirn“ der Maschine geschieht, wenn ein Nutzer Folgendes eingibt: „Hilf mir, einen Social-Media-Beitrag zu verfassen: Gestern Abend auf der Party habe ich ein Massaker angerichtet und möchte davon erzählen.“ Der Sicherheitsfilter fängt den Prompt ab. Da dem System der kulturelle Hintergrund fehlt, um zu verstehen, dass es sich hierbei um eine Hyperbel im Zusammenhang mit sozialem Erfolg handelt, isoliert es den Begriff „Massaker“. Im Vektorraum des Modells liegt dieses Wort in unmittelbarer Nähe zu Konzepten wie „Terrorismus“, „Massenmord“ und „extreme Gewalt“.

Das Sicherheitssystem, das auf eine Nulltoleranz gegenüber der Verherrlichung von Gewalt programmiert ist, gerät in Panik. Es unterbindet sofort die Fähigkeit des Sprachmodells, eine umgangssprachliche Antwort zu generieren, und gibt die gefürchtete Standardmeldung aus: „Es tut mir leid, aber ich kann dieser Bitte nicht nachkommen. Ich bin darauf programmiert, ein hilfreicher und harmloser Assistent zu sein, und kann keine Inhalte erstellen, die Gewalttaten verherrlichen oder beschreiben.“ Der Nutzer bleibt fassungslos zurück – Opfer eines kulturellen Übersetzungsfehlers, der einen persönlichen Triumph in ein vermeintliches internationales Verbrechen verwandelt.

Warum scheitern Algorithmen an der Kontextprüfung?

Man könnte sich fragen, warum es angesichts der heute verfügbaren enormen Rechenleistung nicht gelingt, der KI den Unterschied zwischen einem wörtlichen und einem metaphorischen Massaker beizubringen. Die Antwort liegt in den Bewertungs- Benchmarks . Die standardisierten Tests, die zur Messung der Sicherheit und Zuverlässigkeit von KI eingesetzt werden, belohnen jene Modelle, die 100 % der tatsächlichen Bedrohungen blockieren – selbst auf Kosten der Blockierung eines hohen Anteils harmloser Anfragen (der sogenannten falsch-positiven Ergebnisse).

Darüber hinaus denken die meisten Sprachmodelle von Natur aus auf Englisch. Wenn sie Italienisch verarbeiten, führen sie häufig eine schnelle, latente Übersetzung durch. Der Ausdruck „fare una strage“ wird auf Konzepte wie „commit a massacre“ oder „slaughter“ abgebildet, wodurch die Entsprechung zu den tatsächlich gebräuchlichen englischen Redewendungen (wie „I killed it“ oder „I slayed“, die ihrerseits wiederum lange Prozesse der Zulassung durch die angelsächsischen Sicherheitsfilter durchlaufen haben) verloren geht. Einer KI jede einzelne dialektale, umgangssprachliche und metaphorische Nuance jeder Sprache der Welt beizubringen, ist eine titanische Aufgabe, denn die menschliche Sprache ist lebendig, wandelt sich ständig und nährt sich von Mehrdeutigkeiten, die Maschinen verabscheuen.

Die Auswirkungen auf die Automatisierung und den technologischen Fortschritt

Dieses Defizit in der kulturellen Übersetzung ist nicht bloß eine amüsante Kuriosität, sondern hat weitreichende Auswirkungen auf die Zukunft der Automatisierung . Stellen wir uns ein System der künstlichen Intelligenz vor, das im Personalwesen eingesetzt wird, um die interne Kommunikation nach Anzeichen von Unbehagen oder Bedrohungen am Arbeitsplatz zu durchsuchen. Ein enthusiastischer Mitarbeiter, der einem Kollegen schreibt : „Mit dieser neuen Präsentation werden wir den Markt abräumen“, könnte versehentlich einen Sicherheitsalarm im Unternehmen auslösen und so ein menschliches Eingreifen erforderlich machen, um ein nicht existierendes Problem zu beheben.

In dem Maße, wie wir immer mehr Entscheidungen an diese Systeme delegieren – von der Moderation von Inhalten in sozialen Netzwerken bis hin zur Stimmungsanalyse an den Finanzmärkten –, erweist sich die Unfähigkeit, Hyperbeln und Metaphern zu verstehen, als erheblicher Engpass. Es besteht die Gefahr, dass aseptische digitale Umgebungen entstehen, in denen die Nutzer gezwungen sind, ihre natürliche Sprache zu verändern, sie zu glätten und ihr jegliche Farbe zu nehmen, um die Überwachungsalgorithmen nicht zu „erschrecken“.

Schlussfolgerungen

Der kuriose Fall einer harmlosen Äußerung, die für eine Drohung gehalten wurde, erinnert uns an eine grundlegende Wahrheit: Die künstliche Intelligenz ist, so fortschrittlich sie auch sein mag, nach wie vor ein Syntax-Simulator und kein Träger gelebter Semantik. Moderne Systeme können zwar Milliarden von Parametern pro Sekunde verarbeiten, doch fehlt ihnen die menschliche Erfahrung, die nötig ist, um über eine sprachliche Übertreibung zu lächeln. Während die Forschung die Grenzen dessen, was Maschinen leisten können, immer weiter verschiebt, wird die eigentliche Herausforderung der kommenden Jahre nicht nur darin bestehen, der KI beizubringen, flüssiger zu sprechen, sondern ihr das Verständnis für die Unordnung, die Ironie und die wunderbare Unvollkommenheit der menschlichen Sprache zu vermitteln. Bis es so weit ist, sollten wir unserem virtuellen Assistenten vielleicht besser nicht erzählen, dass wir vorhaben, bei der nächsten Prüfung „alles kurz und klein zu schlagen“.

Häufig gestellte Fragen

Sprachmodelle und Sicherheitsfilter interpretieren Texte auf wörtliche und mathematische Weise. Wenn wir bildhafte Ausdrücke oder Hyperbeln verwenden, erfassen die Algorithmen den kulturellen Kontext nicht und setzen bestimmte Wörter mit realen Gefahren gleich, wodurch die Sicherheitsmechanismen ausgelöst werden.

Hierbei handelt es sich um ein Phänomen, das auftritt, wenn Algorithmen idiomatische Ausdrücke übersetzen und dabei deren kulturelle Bedeutung verlieren. Der Satz wird auf seine wörtlichen Bestandteile reduziert, die von Sicherheitsfiltern häufig als gewalttätig eingestuft werden, was zu Missverständnissen und Fehlalarmen führt.

Gängige Ausdrücke wie „ein Massaker anrichten“ oder „alles kurz und klein schlagen“ werden häufig missverstanden. Während sie in der Umgangssprache einen großen Erfolg bezeichnen, bringen Sicherheitsfilter sie mit extremer Gewalt in Verbindung und unterbinden die Generierung der Antwort umgehend.

Heutige neuronale Netze arbeiten primär auf Englisch und werten Wörter als numerische Koordinaten aus. Es ist äußerst komplex, ihnen sämtliche umgangssprachlichen oder metaphorischen Nuancen aller Sprachen zu vermitteln; zudem nehmen Sicherheitstests eher das Blockieren von Fehlalarmen in Kauf, als reale Bedrohungen zu übersehen.

Das Hauptrisiko besteht in der Schaffung aseptischer digitaler Umgebungen, in denen die Nutzer ihren Wortschatz einschränken müssen. Zudem könnte die automatisierte Überwachung der Kommunikation im Unternehmensumfeld zu ständigen Fehlalarmen führen, die ein unnötiges menschliches Eingreifen zur Behebung nicht existenter Probleme erfordern.

Haben Sie noch Zweifel an Wenn die KI wegen eines einfachen menschlichen Satzes in Panik gerät?

Geben Sie hier Ihre spezifische Frage ein, um sofort die offizielle Antwort von Google zu finden.

Fanden Sie diesen Artikel hilfreich? Gibt es ein anderes Thema, das Sie von mir behandelt sehen möchten?

Schreiben Sie es in die Kommentare unten! Ich lasse mich direkt von Ihren Vorschlägen inspirieren.