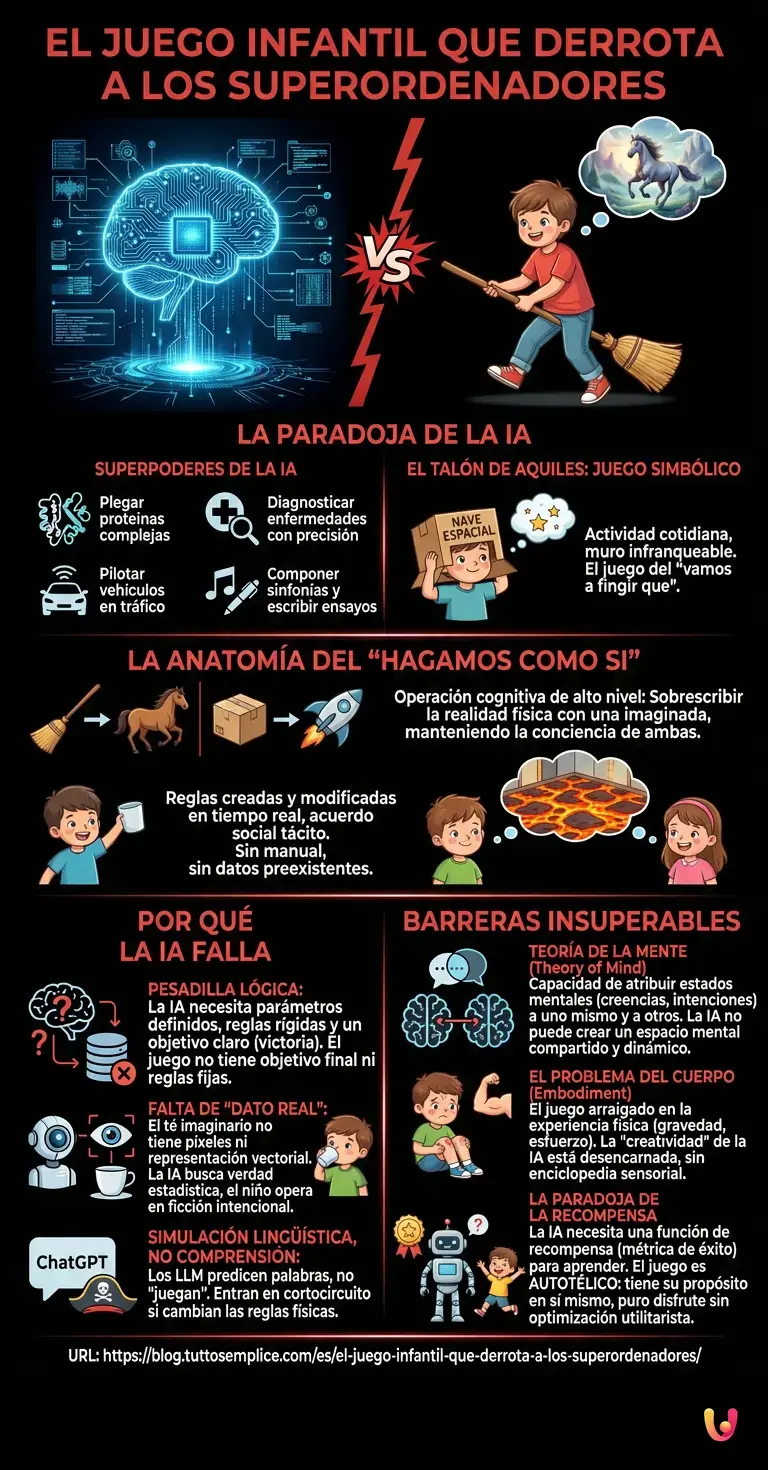

Vivimos en una época en la que la inteligencia artificial parece no tener ya fronteras. Los superordenadores actuales son capaces de plegar proteínas complejas, diagnosticar enfermedades raras con una precisión superior a la humana, pilotar vehículos en medio de un tráfico caótico e incluso componer sinfonías o escribir ensayos filosóficos. Sin embargo, si observamos el patio de un jardín de infancia, seremos testigos de una actividad cotidiana, aparentemente banal, que representa un muro infranqueable para cualquier mente sintética. Nos referimos al juego simbólico (conocido también como el juego del «vamos a fingir que»), el objeto principal de nuestra investigación y el verdadero talón de Aquiles de las máquinas modernas.

¿Por qué una actividad tan natural para un niño de tres años resulta imposible de replicar, o incluso de hacer comprender, a un sistema informático avanzado? La respuesta se oculta en los pliegues más profundos de la cognición humana y en los límites estructurales de la forma en que hemos construido nuestras máquinas pensantes. No se trata de una simple falta de potencia de cálculo, sino de un abismo filosófico y técnico que separa el procesamiento de datos de la experiencia vivida.

Más allá de la lógica: la anatomía del “Hagamos como si”

Para comprender el alcance de este desafío, primero debemos analizar qué sucede durante el juego simbólico. Cuando un niño toma el palo de una escoba y decide que es un caballo, o transforma una caja de cartón en una nave espacial, está llevando a cabo una operación cognitiva de altísimo nivel. Está sobrescribiendo deliberadamente la realidad física con una realidad imaginada, manteniendo, sin embargo, la conciencia de ambas.

El niño sabe perfectamente que la escoba es un trozo de madera, pero decide aplicar a ese objeto un conjunto de reglas físicas y de comportamiento completamente nuevas, inventadas en el momento. Aún más sorprendente es cuando este juego se vuelve social: dos niños se ponen de acuerdo al instante en que «el suelo es lava». No hace falta un manual de instrucciones, ni existe un conjunto de datos preexistente que analizar. Las reglas se crean, modifican y descartan en tiempo real, basándose en miradas, intuiciones y un acuerdo social tácito.

Para la IA , esto es una pesadilla lógica. Los sistemas informáticos, por complejos que sean, operan dentro de parámetros definidos. Pueden vencer al campeón mundial de ajedrez o de Go porque esos juegos, por vastos que sean en sus combinaciones, poseen reglas rígidas e inmutables, así como un objetivo claro (la victoria). El juego simbólico no tiene un objetivo final, no tiene reglas fijas y, sobre todo, requiere la capacidad de gestionar la paradoja: una cosa es simultáneamente ella misma y otra cosa distinta.

El límite de la arquitectura neuronal moderna

Si analizamos la arquitectura neuronal actual que impulsa los sistemas más avanzados, comprendemos por qué este obstáculo es tan arduo. Los modelos de aprendizaje automático y aprendizaje profundo funcionan mediante el reconocimiento de patrones dentro de enormes conjuntos de datos. Se entrenan para minimizar el error entre su predicción y el dato real.

Pero, ¿cuál es el «dato real» en el juego de «hacer como si»? No existe. Cuando un niño finge beber de una taza vacía, un sistema de visión artificial entrenado para reconocer acciones verá simplemente «un humano que se lleva un recipiente vacío a la boca». No puede ver el té imaginario, porque el té imaginario no tiene píxeles, no tiene peso, no tiene una representación vectorial en la base de datos de entrenamiento. El algoritmo busca la verdad estadística, mientras que el niño opera en el reino de la ficción intencional.

Los grandes modelos de lenguaje ( LLM ), como ChatGPT, ciertamente pueden generar un texto que describa a un niño jugando a ser pirata. Incluso pueden simular un diálogo entre dos piratas imaginarios. Sin embargo, se trata de una simulación lingüística, no de una comprensión semántica y situacional. El modelo está prediciendo la palabra siguiente más probable basándose en los textos que ha leído en Internet; no está “jugando”. Si se cambian repentinamente las reglas del mundo físico dentro de una simulación no textual, el modelo entra en cortocircuito, ya que no posee la agilidad cognitiva necesaria para reasignar instantáneamente nuevos significados a los objetos sin un nuevo y largo proceso de entrenamiento (ajuste fino).

El desafío de la “Teoría de la Mente”

El secreto detrás de la capacidad de los niños para sumergirse en este pasatiempo reside en lo que los psicólogos denominan *Theory of Mind* (Teoría de la Mente). Es la capacidad de atribuir estados mentales —creencias, intenciones, deseos, emociones y conocimientos— a uno mismo y a los demás, y de comprender que los otros tienen estados mentales distintos a los propios.

Cuando dos niños juegan a “policías y ladrones”, el niño que hace de policía debe imaginar constantemente qué está pensando el niño que hace de ladrón, dentro del contexto ficticio que han creado. Deben compartir una intencionalidad. Actualmente, ningún sistema sintético posee una verdadera Teoría de la Mente. Los algoritmos pueden simular la empatía o predecir el comportamiento humano basándose en estadísticas pasadas, pero no logran crear un espacio mental compartido y dinámico con un ser humano.

Sin esta capacidad, la automatización del juego simbólico es imposible. Un robot dotado de la inteligencia artificial más avanzada, situado en una habitación con niños que juegan a fingir que están en un restaurante, no sabría cómo interactuar de manera espontánea. Podría reconocer los objetos (platos de plástico, cubiertos de juguete), pero no entendería que, en ese momento específico y por acuerdo social, un trozo de plastilina verde se ha convertido en un exquisito plato de espaguetis alienígenas. Para la máquina, la plastilina sigue siendo plastilina.

La paradoja de la automatización creativa y el problema del cuerpo

Otro elemento crucial que impide a las mentes sintéticas comprender este pasatiempo es la falta de un cuerpo vivido, lo que en la robótica cognitiva se denomina *embodiment* . El juego simbólico está profundamente arraigado en la experiencia física del mundo. Un niño sabe cómo fingir que levanta una roca pesadísima (que en realidad es un cojín) porque posee la experiencia física de la gravedad, del esfuerzo muscular y de la fatiga.

El progreso tecnológico nos ha proporcionado máquinas capaces de procesar terabytes de información por segundo, pero estas máquinas nunca han experimentado lo que significa rasparse una rodilla, sentir el viento en la cara o padecer vértigo. En consecuencia, su «creatividad» está desencarnada. Cuando un niño juega, utiliza su propio cuerpo como herramienta principal de simulación. La inteligencia artificial, al carecer de esta enciclopedia sensorial primaria, no puede comprender el significado profundo de una acción simulada, limitándose a registrar, en el mejor de los casos, su cinemática superficial.

¿Qué sucede si intentamos enseñárselo a las máquinas?

Los investigadores en el campo de la inteligencia artificial general (AGI) son perfectamente conscientes de esta limitación. En los últimos años, se han creado diversos *benchmarks* para evaluar la capacidad de las máquinas de adaptarse a entornos abiertos y sin reglas fijas. Se ha intentado introducir agentes virtuales en mundos simulados, premiándolos (mediante aprendizaje por refuerzo) cuando mostraban comportamientos creativos o colaborativos.

Sin embargo, los resultados, por fascinantes que sean, siguen estando lejos del verdadero juego simbólico. Las máquinas tienden a encontrar atajos en el código (los llamados *reward hacks *) para maximizar la puntuación, en lugar de participar en una actividad lúdica que sea un fin en sí misma. El problema fundamental es que la IA necesita una función de recompensa (una métrica de éxito) para aprender. Pero, ¿cuál es la métrica de éxito al fingir ser un dinosaurio? No existe. El juego es autotélico: tiene su propio propósito en sí mismo. Es el puro disfrute de la exploración de posibilidades, un concepto que escapa por completo a la lógica utilitarista y optimizadora en la que se basa la informática moderna.

En Breve (TL;DR)

A pesar de que la inteligencia artificial sobresale en tareas complejas, fracasa ante el juego simbólico de los niños, demostrando un límite estructural infranqueable para las máquinas.

Los sistemas informáticos requieren parámetros definidos y reglas fijas, lo que hace imposible procesar las paradojas creativas y las realidades cambiantes imaginadas por los niños.

La verdadera barrera es la falta de la Teoría de la Mente, esa capacidad puramente humana de compartir intenciones y comprender los estados mentales ajenos.

Conclusiones

Mientras seguimos ampliando los límites de lo que las máquinas pueden hacer, delegándoles tareas cada vez más complejas y arduas, resulta tranquilizador y, al mismo tiempo, fascinante descubrir que las cimas más altas de la cognición no residen necesariamente en los cálculos matemáticos más abstrusos. Residen en la imaginación desbordante, en la capacidad de compartir ilusiones y en la alegría de transformar la realidad a través del pensamiento.

El juego simbólico sigue siendo el último baluarte de la exclusividad humana. Nos recuerda que la inteligencia no es solo la capacidad de resolver problemas o procesar información, sino también la capacidad de soñar despiertos, de dar significado a la nada y de conectar con los demás a través de mundos que existen solo porque hemos decidido, juntos, hacerlos existir. Hasta que no logremos enseñar a un ordenador la emoción de transformar una caja de cartón en una nave espacial, podremos estar seguros de que la chispa más profunda de la mente humana seguirá siendo inimitable.

Preguntas frecuentes

El juego simbólico representa una actividad cognitiva de altísimo nivel en la que los niños transforman objetos comunes en elementos de fantasía. Este proceso requiere la capacidad de manejar reglas flexibles y paradojas simultáneas. Se trata de una flexibilidad mental extraordinaria que, actualmente, resulta imposible de replicar para los sistemas informáticos más avanzados.

Los sistemas sintéticos operan bajo parámetros definidos y requieren objetivos claros para funcionar. Por el contrario, las actividades lúdicas infantiles basadas en la ficción no tienen reglas fijas ni una meta final que alcanzar. Las máquinas buscan verdades estadísticas en los datos, mientras que los niños crean mundos imaginarios sin necesidad de instrucciones preestablecidas.

La Teoría de la Mente permite a los seres humanos comprender y compartir los estados mentales y las emociones de los demás. Actualmente, ningún algoritmo posee esta característica fundamental para crear un espacio mental compartido. Sin esta empatía cognitiva, los robots solo pueden simular comportamientos basados en estadísticas pasadas, pero no saben interactuar de manera espontánea en contextos sociales complejos.

La experiencia física del mundo resulta esencial para comprender conceptos prácticos como la gravedad o el esfuerzo muscular. Esta enciclopedia sensorial primaria permite a los niños utilizar su propio cuerpo como herramienta de simulación durante el juego. Los superordenadores, al carecer de un cuerpo vivido, desarrollan una creatividad puramente teórica que no logra captar el significado profundo de las acciones reales.

Los modelos de aprendizaje automático necesitan una métrica de éxito para aprender y mejorar su rendimiento. El entretenimiento infantil basado en la imaginación, en cambio, resulta autotélico, es decir, encuentra su propósito en sí mismo sin buscar optimizaciones. Esta ausencia de un objetivo utilitario pone en crisis la lógica en la que se fundamenta la informática moderna.

¿Todavía tienes dudas sobre El juego infantil que derrota a los superordenadores?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

- Teoría de la mente: Concepto, desarrollo en la infancia y psicología (Wikipedia)

- Teoría de la mente en la Inteligencia Artificial: Capacidades y limitaciones (Wikipedia)

- Desarrollo infantil (MedlinePlus – Biblioteca Nacional de Medicina de EE. UU.)

- Investigación, estándares y evaluación de las capacidades de la Inteligencia Artificial (NIST – Gobierno de EE. UU.)

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.