En el panorama Fintech de 2026, la expectativa del usuario es la inmediatez. Ya no es aceptable esperar días para obtener un feedback preliminar sobre una solicitud de financiación. Aquí entra en juego la Event-Driven Architecture: Gestión en Tiempo Real del procesamiento de solicitudes, un paradigma que transforma procesos bancarios monolíticos y lentos en flujos de datos reactivos y escalables. Este artículo técnico explora cómo diseñar un sistema distribuido capaz de gestionar el ciclo de vida de una hipoteca, garantizando resiliencia y consistencia de los datos.

1. El Problema: Límites de las Arquitecturas Request/Response en las Hipotecas

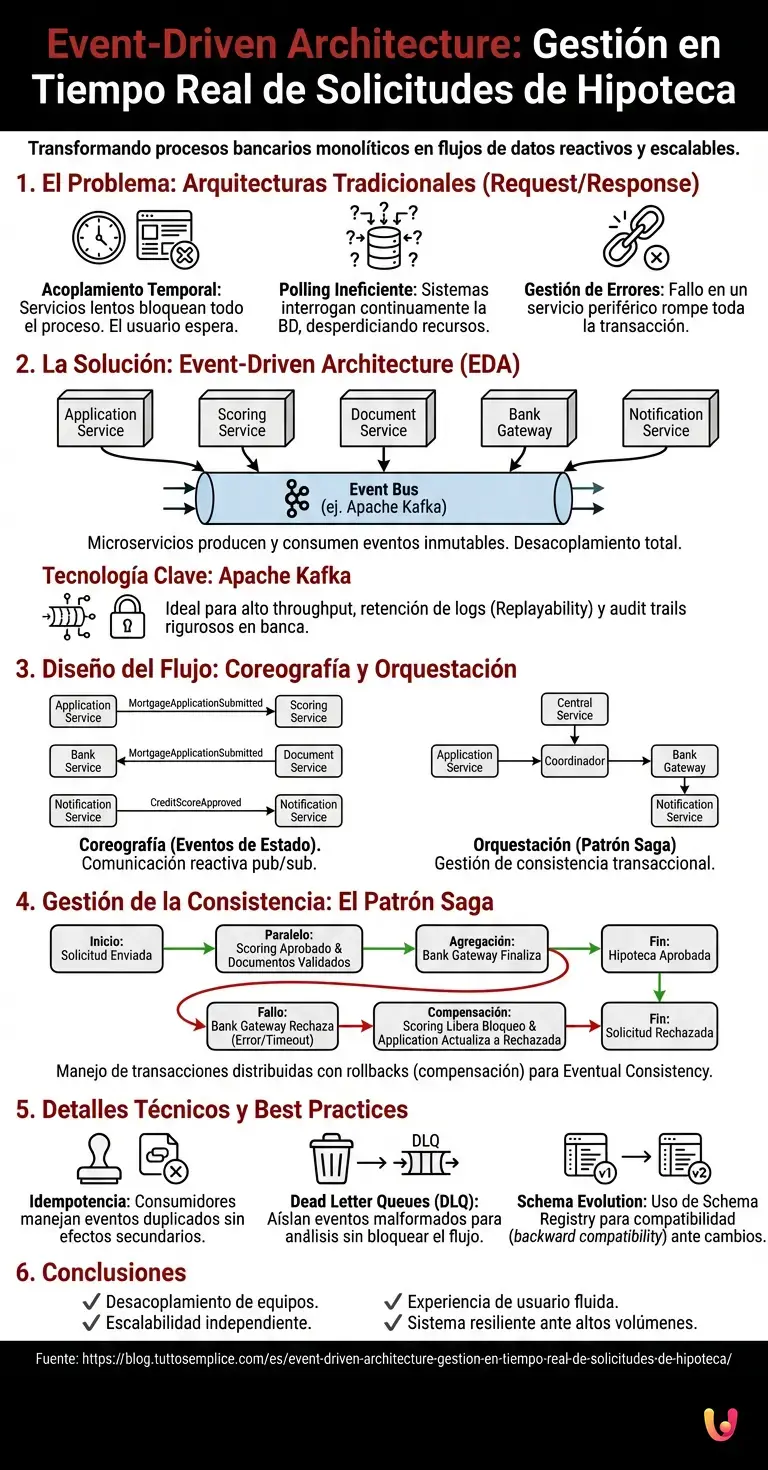

Tradicionalmente, la orquestación de un expediente hipotecario se realizaba mediante arquitecturas monolíticas o microservicios acoplados vía HTTP (REST/gRPC). Este enfoque presenta debilidades estructurales:

- Acoplamiento Temporal: Si el servicio de Credit Scoring es lento, todo el proceso de solicitud se bloquea, dejando al usuario esperando frente a un icono de carga.

- Polling Ineficiente: Los sistemas downstream deben interrogar continuamente la base de datos central para saber si hay nuevas solicitudes para trabajar («¿Ya hemos llegado?»), desperdiciando recursos computacionales.

- Gestión de Errores: En una cadena de llamadas síncronas, el fallo de un servicio periférico (ej. el generador de PDF) puede hacer fallar toda la transacción.

2. La Solución: Event-Driven Architecture (EDA)

En una arquitectura guiada por eventos, los microservicios no se hablan directamente. En su lugar, producen y consumen eventos. Un evento es un hecho inmutable ocurrido en el pasado (ej. MortgageApplicationSubmitted).

Componentes Clave de la Arquitectura

Para nuestro caso de uso, compararemos dos backbones tecnológicos dominantes:

- Apache Kafka: Ideal para throughputs elevados y cuando es necesaria la Log Retention para reprocesar los eventos (Replayability). Es la elección preferida para los bancos que necesitan un audit trail inmutable on-premise o híbrido.

- Amazon EventBridge: Solución Serverless perfecta para el enrutamiento inteligente de eventos en la nube AWS. Reduce la carga operativa pero tiene límites en el tamaño del payload y en la retención respecto a Kafka.

Decisión Arquitectónica: Para un sistema de hipotecas complejo que requiere historificación y auditorías rigurosas, utilizaremos Apache Kafka como Event Bus central, integrando patrones de Schema Registry (ej. Avro o Protobuf) para garantizar la compatibilidad de los contratos de datos.

3. Diseño del Flujo: Coreografía vs Orquestación

La gestión de una solicitud de hipoteca es un Long-Running Process. Debemos decidir cómo coordinar los servicios:

Microservicios Involucrados

- Application Service: Recibe la solicitud del usuario.

- Scoring Service: Evalúa el riesgo crediticio (Crif, Experian).

- Document Service: Gestiona la subida y validación OCR de los documentos.

- Bank Gateway: Comunica con los sistemas legacy del banco para la resolución final.

- Notification Service: Envía email/SMS/Push al usuario.

Utilizaremos un enfoque híbrido: Coreografía para los eventos de estado (pub/sub) y Orquestación (mediante el patrón Saga) para la gestión de la consistencia transaccional.

4. Gestión de la Consistencia: El Patrón Saga

En un sistema distribuido, no podemos usar las transacciones ACID de la base de datos local para procesos que atraviesan múltiples servicios. Debemos abrazar la Eventual Consistency. Pero, ¿qué sucede si el Bank Gateway rechaza la solicitud después de que el Scoring Service la había aprobado?

Debemos implementar el Patrón Saga para gestionar los rollbacks (transacciones de compensación).

Ejemplo de Flujo Saga (Coreografía)

Imaginemos el flujo feliz y el flujo de fallo:

Paso 1: Inicio de Transacción

El usuario envía la solicitud. El Application Service publica el evento:

{

"eventId": "uuid-1234",

"eventType": "MortgageApplicationSubmitted",

"payload": {

"applicationId": "M-999",

"amount": 200000,

"applicant": "Mario Rossi"

}

}Paso 2: Procesamiento Paralelo

El Scoring Service y el Document Service escuchan el evento.

El Scoring Service aprueba y publica CreditScoreApproved.

El Document Service valida los PDF y publica DocumentsValidated.

Paso 3: Agregación y Decisión

El Bank Gateway espera ambos eventos. Una vez recibidos, intenta finalizar el expediente en el mainframe bancario.

Paso 4: Fallo y Compensación (Rollback)

Si el mainframe responde con un error (ej. «Fondos insuficientes» o «Timeout»), el Bank Gateway publica el evento MortgageFinalizationFailed.

En este punto, se activan las Compensating Transactions:

- El Scoring Service escucha el fallo y libera cualquier «bloqueo» sobre el rating crediticio del usuario.

- El Application Service escucha el fallo y actualiza el estado de la solicitud de «En Proceso» a «Rechazada», notificando al usuario.

5. Detalles Técnicos y Best Practices

Idempotencia

En Kafka, la entrega exactly-once es compleja. Es más seguro diseñar los consumidores para ser idempotentes. Si el Notification Service recibe dos veces el evento MortgageApproved, debe ser capaz de entender (mediante un ID único del evento guardado en Redis o DB) que ya ha enviado el email y descartar el duplicado.

Dead Letter Queues (DLQ)

¿Qué sucede si un evento está malformado y provoca un crash en el consumidor? No podemos bloquear la cola. El evento problemático debe ser movido a una Dead Letter Queue después de X intentos fallidos, permitiendo al equipo de ingeniería analizarlo manualmente sin detener el flujo de las otras solicitudes.

Schema Evolution

Las solicitudes de hipoteca cambian con el tiempo (nuevas normativas, nuevos campos de datos). Utilizar un Schema Registry es fundamental. Los productores y los consumidores deben acordar el esquema (ej. Avro). Si añadimos el campo tasa_interes_bonificada, los viejos consumidores no deben romperse (backward compatibility).

6. Implementación: Snippet de Configuración Kafka (Java/Spring Boot)

Aquí tienes un ejemplo de cómo configurar un consumer que soporta la gestión de transacciones en un contexto Spring Cloud Stream:

@Bean

public Consumer<MortgageEvent> mortgageProcessor() {

return event -> {

if (event.getType().equals("MortgageApplicationSubmitted")) {

try {

scoringService.calculate(event.getPayload());

} catch (Exception e) {

// Lógica de envío a DLQ o retry automático

throw new AmqpRejectAndDontRequeueException(e);

}

}

};

}7. Conclusiones

Pasar a una arquitectura de eventos para la gestión de hipotecas no es solo un ejercicio de estilo tecnológico, sino una necesidad de negocio. Permite desacoplar los equipos de desarrollo (el equipo «Documentos» puede lanzar actualizaciones sin coordinarse con el equipo «Banco»), escalar los servicios de manera independiente (más recursos al Scoring durante los picos de solicitudes) y ofrecer al usuario final una experiencia fluida y transparente.

La complejidad introducida por la gestión de la consistencia eventual y por los patrones de compensación es el precio a pagar para obtener un sistema resiliente, capaz de gestionar volúmenes elevados sin los cuellos de botella de las bases de datos relacionales centralizadas.

Preguntas frecuentes

Esta arquitectura supera los límites de los sistemas monolíticos eliminando el acoplamiento temporal y el polling ineficiente. Permite transformar procesos lentos en flujos reactivos, garantizando escalabilidad independiente de los servicios y proporcionando feedback inmediato al usuario, en lugar de dejarlo esperando frente a una carga infinita.

El Patrón Saga gestiona la consistencia de los datos a través de una serie de transacciones locales coordinadas. Si un paso falla, como un rechazo del gateway bancario, el sistema ejecuta transacciones de compensación para anular las operaciones anteriores, garantizando que el estado final del sistema permanezca coherente sin bloquear los recursos.

Apache Kafka es preferible cuando es necesaria una rigurosa historificación y la capacidad de reprocesar los eventos pasados, funcionalidades esenciales para los audit trails bancarios. A diferencia de EventBridge, que es excelente para el enrutamiento serverless, Kafka gestiona mejor payloads elevados y garantiza la persistencia inmutable de los datos on-premise o híbridos.

La idempotencia es la capacidad de un sistema para gestionar el mismo evento varias veces sin producir efectos secundarios duplicados. Es crucial en arquitecturas como Kafka, donde la entrega exactly-once es compleja; los consumidores deben reconocer eventos ya procesados para evitar, por ejemplo, enviar dobles notificaciones al cliente.

Para evitar que un evento erróneo bloquee toda la cola de procesamiento, se utilizan las Dead Letter Queues (DLQ). Después de un número definido de intentos fallidos, el evento problemático se mueve a esta cola especial para ser analizado manualmente por los ingenieros, permitiendo que el flujo principal de las solicitudes continúe sin interrupciones.

¿Todavía tienes dudas sobre Event-Driven Architecture: Gestión en Tiempo Real de Solicitudes de Hipoteca?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

- Definición y conceptos de la Arquitectura dirigida por eventos (Wikipedia)

- Estrategias de seguridad para sistemas basados en microservicios – NIST (Publicación en inglés)

- Reglamento (UE) 2022/2554 del Parlamento Europeo y del Consejo sobre la resiliencia operativa digital del sector financiero (Texto oficial DORA – EUR-Lex)

- ¿Qué son los microservicios? – Amazon Web Services

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.