În peisajul Fintech din 2026, așteptarea utilizatorului este imediatul. Nu mai este acceptabil să aștepți zile întregi pentru un feedback preliminar la o cerere de finanțare. Aici intervine Event-Driven Architecture: Gestionarea în Timp Real a procesării dosarelor, o paradigmă care transformă procesele bancare monolitice și lente în fluxuri de date reactive și scalabile. Acest articol tehnic explorează modul de inginerie a unui sistem distribuit capabil să gestioneze ciclul de viață al unui credit ipotecar, garantând reziliența și consistența datelor.

1. Problema: Limitele Arhitecturilor Request/Response în Creditele Ipotecare

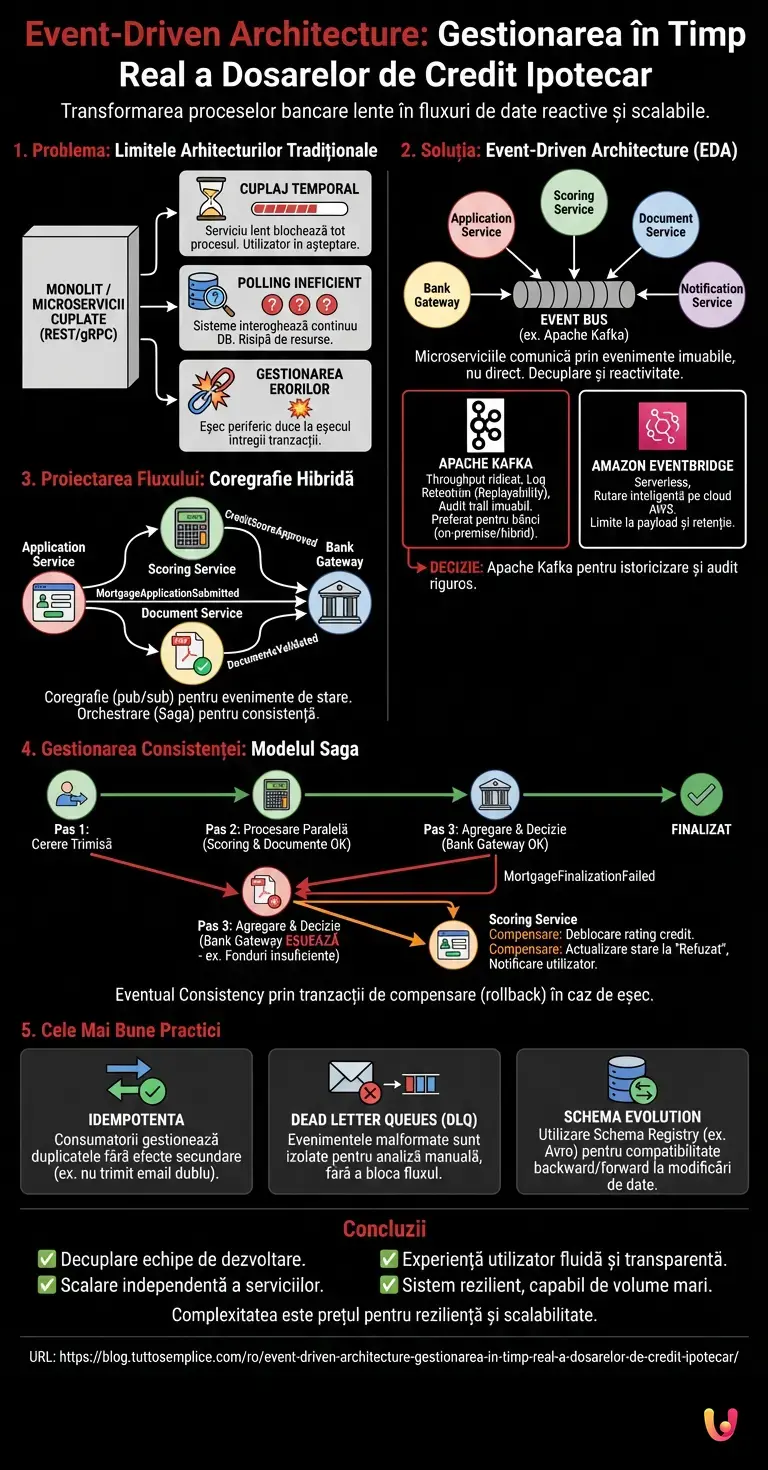

În mod tradițional, orchestrarea unui dosar de credit ipotecar se realiza prin arhitecturi monolitice sau microservicii cuplate via HTTP (REST/gRPC). Această abordare prezintă criticități structurale:

- Cuplaj Temporal: Dacă serviciul de Credit Scoring este lent, întregul proces de solicitare se blochează, lăsând utilizatorul în așteptare în fața unui simbol de încărcare.

- Polling Ineficient: Sistemele downstream trebuie să interogheze continuu baza de date centrală pentru a ști dacă există dosare noi de lucrat (“Are we there yet?”), irosind resurse computaționale.

- Gestionarea Erorilor: Într-un lanț de apeluri sincrone, eșecul unui serviciu periferic (ex. generatorul de PDF) poate duce la eșecul întregii tranzacții.

2. Soluția: Event-Driven Architecture (EDA)

Într-o arhitectură ghidată de evenimente, microserviciile nu vorbesc direct între ele. În schimb, produc și consumă evenimente. Un eveniment este un fapt imuabil petrecut în trecut (ex. MortgageApplicationSubmitted).

Componente Cheie ale Arhitecturii

Pentru cazul nostru de utilizare, vom compara două structuri tehnologice dominante:

- Apache Kafka: Ideal pentru throughput ridicat și când este necesară Log Retention pentru a reprocesa evenimentele (Replayability). Este alegerea preferată pentru băncile care necesită un audit trail imuabil on-premise sau hibrid.

- Amazon EventBridge: Soluție Serverless perfectă pentru rutarea inteligentă a evenimentelor pe cloud AWS. Reduce overhead-ul operațional, dar are limite privind dimensiunea payload-ului și retenția comparativ cu Kafka.

Decizie Arhitecturală: Pentru un sistem de credite ipotecare complex care necesită istoricizare și audituri riguroase, vom utiliza Apache Kafka ca Event Bus central, integrând modele de Schema Registry (ex. Avro sau Protobuf) pentru a garanta compatibilitatea contractelor de date.

3. Proiectarea Fluxului: Coregrafie vs Orchestrare

Gestionarea unui dosar de credit ipotecar este un Long-Running Process. Trebuie să decidem cum coordonăm serviciile:

Microservicii Implicate

- Application Service: Primește cererea de la utilizator.

- Scoring Service: Evaluează riscul de credit (Crif, Experian).

- Document Service: Gestionează încărcarea și validarea OCR a documentelor.

- Bank Gateway: Comunică cu sistemele legacy ale băncii pentru decizia finală.

- Notification Service: Trimite email/SMS/Push utilizatorului.

Vom utiliza o abordare hibridă: Coregrafie pentru evenimentele de stare (pub/sub) și Orchestrare (prin modelul Saga) pentru gestionarea consistenței tranzacționale.

4. Gestionarea Consistenței: Modelul Saga

Într-un sistem distribuit, nu putem folosi tranzacțiile ACID ale bazei de date locale pentru procese care traversează mai multe servicii. Trebuie să adoptăm Eventual Consistency. Dar ce se întâmplă dacă Bank Gateway refuză dosarul după ce Scoring Service l-a aprobat?

Trebuie să implementăm Modelul Saga pentru a gestiona rollback-urile (tranzacții de compensare).

Exemplu de Flux Saga (Coregrafie)

Să ne imaginăm fluxul fericit și fluxul de eșec:

Pasul 1: Începutul Tranzacției

Utilizatorul trimite cererea. Application Service publică evenimentul:

{

"eventId": "uuid-1234",

"eventType": "MortgageApplicationSubmitted",

"payload": {

"applicationId": "M-999",

"amount": 200000,

"applicant": "Mario Rossi"

}

}Pasul 2: Procesare Paralelă

Scoring Service și Document Service ascultă evenimentul.

Scoring Service aprobă și publică CreditScoreApproved.

Document Service validează PDF-urile și publică DocumentsValidated.

Pasul 3: Agregare și Decizie

Bank Gateway așteaptă ambele evenimente. Odată primite, încearcă să finalizeze dosarul pe mainframe-ul bancar.

Pasul 4: Eșec și Compensare (Rollback)

Dacă mainframe-ul răspunde cu o eroare (ex. “Fonduri insuficiente” sau “Timeout”), Bank Gateway publică evenimentul MortgageFinalizationFailed.

În acest punct, se declanșează Compensating Transactions:

- Scoring Service ascultă eșecul și eliberează eventualele “blocaje” pe ratingul de credit al utilizatorului.

- Application Service ascultă eșecul și actualizează starea dosarului din “În Lucru” în “Refuzat”, notificând utilizatorul.

5. Detalii Tehnice și Cele Mai Bune Practici

Idempotenta

În Kafka, livrarea exactly-once este complexă. Este mai sigur să proiectăm consumatorii pentru a fi idempotenți. Dacă Notification Service primește de două ori evenimentul MortgageApproved, trebuie să fie capabil să înțeleagă (printr-un ID unic al evenimentului salvat în Redis sau DB) că a trimis deja email-ul și să ignore duplicatul.

Dead Letter Queues (DLQ)

Ce se întâmplă dacă un eveniment este malformat și blochează consumatorul? Nu putem bloca coada. Evenimentul problematic trebuie mutat într-o Dead Letter Queue după X încercări eșuate, permițând echipei de inginerie să îl analizeze manual fără a opri fluxul celorlalte dosare.

Schema Evolution

Dosarele de credit ipotecar se schimbă în timp (noi reglementări, noi câmpuri de date). Utilizarea unui Schema Registry este fundamentală. Producătorii și consumatorii trebuie să cadă de acord asupra schemei (ex. Avro). Dacă adăugăm câmpul dobanda_preferentiala, vechii consumatori nu trebuie să se strice (backward compatibility).

6. Implementare: Fragment de Configurare Kafka (Java/Spring Boot)

Iată un exemplu despre cum să configurați un consumer care suportă gestionarea tranzacțiilor într-un context Spring Cloud Stream:

@Bean

public Consumer<MortgageEvent> mortgageProcessor() {

return event -> {

if (event.getType().equals("MortgageApplicationSubmitted")) {

try {

scoringService.calculate(event.getPayload());

} catch (Exception e) {

// Logica de trimitere către DLQ sau reîncercare automată

throw new AmqpRejectAndDontRequeueException(e);

}

}

};

}7. Concluzii

Trecerea la o arhitectură bazată pe evenimente pentru gestionarea creditelor ipotecare nu este doar un exercițiu de stil tehnologic, ci o necesitate de business. Permite decuplarea echipelor de dezvoltare (echipa “Documente” poate lansa actualizări fără a se coordona cu echipa “Bancă”), scalarea serviciilor în mod independent (mai multe resurse pentru Scoring în timpul vârfurilor de cereri) și oferirea unei experiențe fluide și transparente utilizatorului final.

Complexitatea introdusă de gestionarea consistenței eventuale și de modelele de compensare este prețul de plătit pentru a obține un sistem rezilient, capabil să gestioneze volume mari fără blocajele bazelor de date relaționale centralizate.

Întrebări frecvente

Această arhitectură depășește limitele sistemelor monolitice eliminând cuplajul temporal și polling-ul ineficient. Permite transformarea proceselor lente în fluxuri reactive, garantând scalabilitatea independentă a serviciilor și oferind feedback imediat utilizatorului, în loc să îl lase în așteptare în fața unei încărcări infinite.

Modelul Saga gestionează consistența datelor printr-o serie de tranzacții locale coordonate. Dacă un pas eșuează, cum ar fi un refuz din partea gateway-ului bancar, sistemul execută tranzacții de compensare pentru a anula operațiunile anterioare, garantând că starea finală a sistemului rămâne coerentă fără a bloca resursele.

Apache Kafka este preferabil când este necesară o istoricizare riguroasă și capacitatea de a reprocesa evenimentele trecute, funcționalități esențiale pentru pistele de audit bancar. Spre deosebire de EventBridge, care este excelent pentru rutarea serverless, Kafka gestionează mai bine payload-urile mari și garantează persistența imuabilă a datelor on-premise sau hibrid.

Idempotenta este capacitatea unui sistem de a gestiona același eveniment de mai multe ori fără a produce efecte secundare duplicate. Este crucială în arhitecturi precum Kafka, unde livrarea exactly-once este complexă; consumatorii trebuie să recunoască evenimentele deja procesate pentru a evita, de exemplu, trimiterea de notificări duble clientului.

Pentru a evita ca un eveniment eronat să blocheze întreaga coadă de procesare, se utilizează Dead Letter Queues (DLQ). După un număr definit de încercări eșuate, evenimentul problematic este mutat în această coadă specială pentru a fi analizat manual de către ingineri, permițând fluxului principal al dosarelor să continue fără întreruperi.

Încă ai dubii despre Event-Driven Architecture: Gestionarea în Timp Real a Dosarelor de Credit Ipotecar?

Tastați aici întrebarea dvs. specifică pentru a găsi instantaneu răspunsul oficial de la Google.

Surse și Aprofundare

Ați găsit acest articol util? Există un alt subiect pe care ați dori să-l tratez?

Scrieți-l în comentariile de mai jos! Mă inspir direct din sugestiile voastre.