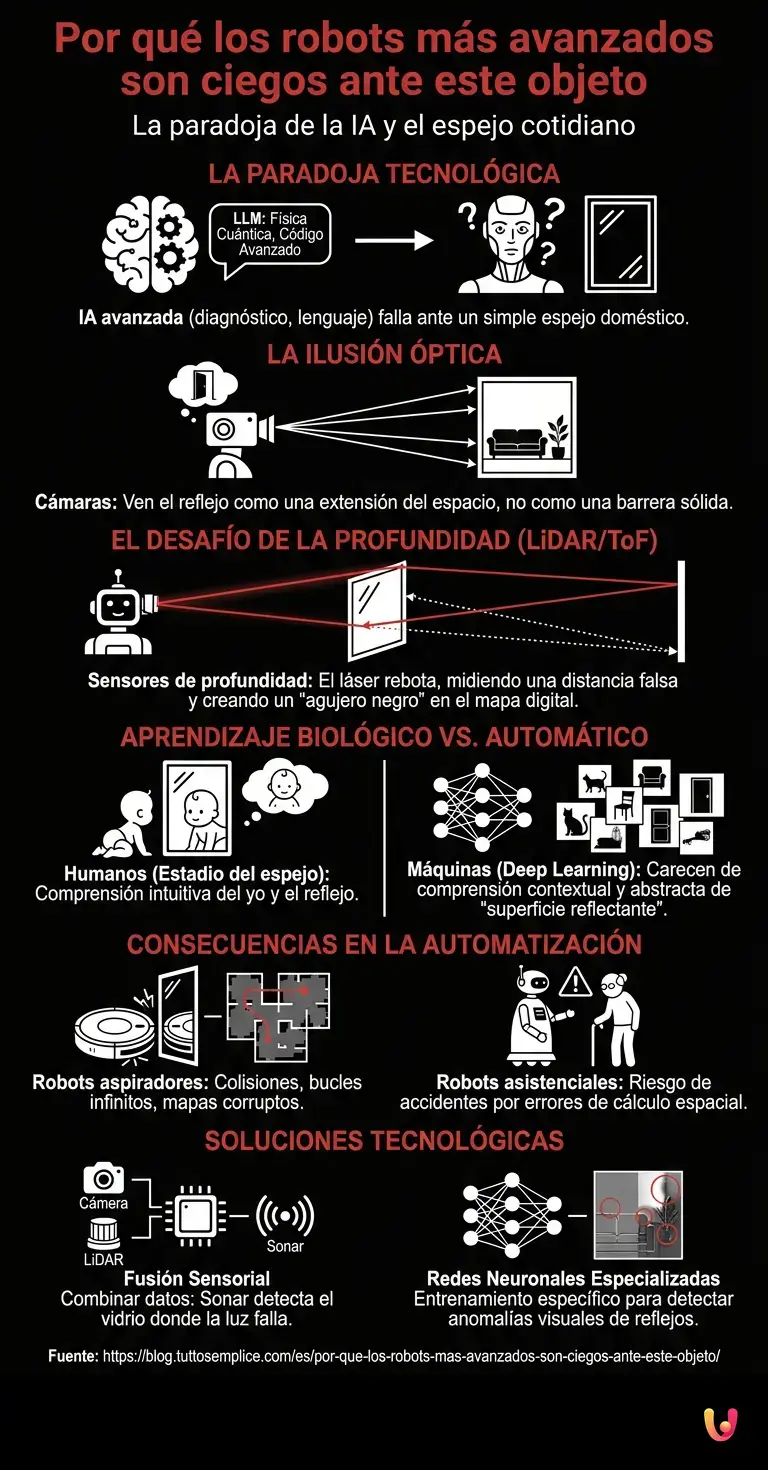

Vivimos en una época en la que la inteligencia artificial parece no tener límites. Los sistemas modernos son capaces de diagnosticar patologías complejas analizando radiografías en fracciones de segundo, conducir automóviles en el tráfico caótico de las metrópolis e incluso mantener conversaciones filosóficas. Si bien un LLM (Gran Modelo de Lenguaje) como ChatGPT puede generar ensayos impecables sobre física cuántica o escribir código de programación avanzado, existe una paradoja fascinante en el campo de la robótica y la visión artificial. Si transferimos esta inmensa potencia de cálculo a un androide físico y lo dejamos libre para explorar una vivienda común, hay un objeto cotidiano, banal y omnipresente, que provocará un cortocircuito en su comprensión del espacio : el espejo . Este sencillo elemento decorativo representa hoy en día uno de los mayores puntos ciegos para los cerebros sintéticos.

Para comprender el alcance de esta curiosidad tecnológica, debemos adentrarnos en la forma en que las máquinas “ven” e interpretan el mundo que las rodea. No se trata de un simple defecto de programación, sino de una limitación intrínseca vinculada a la física de la luz y a la naturaleza misma de los actuales modelos de aprendizaje automático . Resolver el enigma del espejo significa impulsar la tecnología hacia una nueva frontera de la conciencia espacial.

La ilusión óptica que engaña a las máquinas

Para un ser humano, reconocer una superficie reflectante es una acción casi instintiva. Nuestro cerebro utiliza una serie de indicios visuales y contextuales: el marco, los ligeros reflejos en la superficie del vidrio, la posición del objeto (por ejemplo, sobre un lavabo) y, sobre todo, la presencia de nuestra propia imagen reflejada. Para una IA , sin embargo, el proceso de visión es radicalmente diferente. Las cámaras de un robot doméstico capturan la luz y la convierten en una cuadrícula bidimensional de píxeles, cada uno con un valor numérico correspondiente a un color.

Cuando los algoritmos de visión artificial analizan esta cuadrícula, buscan patrones, bordes y texturas para identificar los objetos. El problema fundamental del espejo es que no posee un aspecto visual propio: su naturaleza consiste en apropiarse del aspecto del entorno circundante. En consecuencia, cuando un robot mira hacia un armario con espejos, sus sensores ópticos no registran un obstáculo sólido, sino que ven una extensión de la habitación. Ven otro suelo, otras paredes y otros muebles. La ilusión óptica es perfecta: la máquina está convencida de que existe un espacio abierto y transitable donde, en realidad, hay una barrera de vidrio y plata.

Arquitectura neuronal y el desafío de la profundidad

Se podría pensar que el problema se limita únicamente a las cámaras tradicionales y que los sensores de profundidad avanzados pueden sortear fácilmente el obstáculo. Lamentablemente, la realidad física complica aún más las cosas. Muchos sistemas de navegación autónoma se basan en el LiDAR (Light Detection and Ranging) o en sensores ToF (Time of Flight). Estos dispositivos emiten pulsos de luz láser o infrarroja y miden el tiempo que tardan en rebotar en los objetos y regresar, calculando así la distancia con extrema precisión.

Sin embargo, la arquitectura neuronal que procesa estos datos choca con las leyes de la óptica. Cuando el rayo láser de un LiDAR incide sobre un espejo, no rebota en la superficie para regresar al sensor. Por el contrario, se refleja según el ángulo de incidencia, atraviesa la habitación, impacta contra un objeto real (como un sofá situado a espaldas del robot), rebota de nuevo en el espejo y, finalmente, regresa al sensor. ¿El resultado? El robot calcula una distancia doble o triple con respecto a la real. En la «nube de puntos» tridimensional generada por el cerebro sintético, el espejo desaparece por completo, sustituido por un agujero negro o por una habitación fantasma que se extiende más allá de la pared. Este fenómeno crea una disonancia cognitiva en la máquina: los sensores táctiles o los parachoques indican una colisión, pero el mapa digital insiste en que el camino está libre.

¿Por qué el aprendizaje automático fracasa donde un niño sobresale?

La dificultad de las máquinas para gestionar los reflejos pone de manifiesto una diferencia abismal entre el aprendizaje biológico y el aprendizaje automático . En la psicología del desarrollo humano, existe una fase crucial conocida como el “estadio del espejo”, teorizada por el psicoanalista Jacques Lacan. Alrededor de los 18 meses de edad, un niño aprende a reconocer que la imagen reflejada no es otro niño, sino él mismo. Esta epifanía requiere una comprensión compleja del yo, del espacio y de la física básica.

Los sistemas actuales de aprendizaje profundo (*deep learning*), por muy sofisticados que sean, carecen de esta comprensión causal y contextual del mundo . Se entrenan con millones de imágenes estáticas, aprendiendo a asociar determinados patrones de píxeles con etiquetas específicas (p. ej., “gato”, “silla”, “puerta”). Si el conjunto de datos de entrenamiento no incluye una cantidad masiva de ejemplos específicos de espejos en todas las condiciones posibles de iluminación y ángulo, la red neuronal nunca desarrollará el concepto abstracto de “superficie reflectante”. La máquina no sabe que existe, no sabe qué aspecto tiene y, en consecuencia, no puede utilizar su propia imagen reflejada como indicio para deducir la presencia de un espejo.

Las consecuencias para la automatización del hogar

Este punto ciego no es solo una curiosidad académica, sino que tiene repercusiones prácticas inmediatas en el campo de la automatización . Los robots aspiradores de gama alta, que mapean nuestros hogares con precisión milimétrica, a menudo se comportan de manera anómala ante espejos de cuerpo entero o puertas acristaladas muy reflectantes. Pueden intentar atravesar el cristal repetidamente, quedar atrapados en bucles infinitos tratando de limpiar una “habitación” inexistente, o corromper el mapa digital de la vivienda al superponer la geometría real con la reflejada.

Para la industria de la robótica, superar este obstáculo se ha convertido en un verdadero punto de referencia . No se trata solo de evitar que una aspiradora se raye, sino de garantizar la seguridad de los futuros robots asistenciales. Imaginen un robot humanoide diseñado para asistir a personas mayores o con discapacidad: un error de cálculo espacial provocado por un reflejo podría derivar en caídas, accidentes o daños a objetos frágiles. La capacidad de identificar de manera fiable superficies transparentes y reflectantes se ha convertido en una métrica fundamental para evaluar la fiabilidad de los nuevos sistemas de navegación autónoma.

Más allá del reflejo: las soluciones del progreso tecnológico

¿Cómo están abordando este problema los ingenieros y los investigadores? El progreso tecnológico está impulsando soluciones multimodales que no dependen de un único tipo de sensor. Una de las estrategias más prometedoras es la fusión sensorial (*sensor fusion*). Al combinar los datos visuales de las cámaras, las mediciones del LiDAR y, sobre todo, los sensores de ultrasonidos (sonar), los robots pueden contrastar la información. Mientras que la luz atraviesa el vidrio o se refleja en él, las ondas sonoras rebotan en la superficie sólida. Si el LiDAR indica «espacio abierto», pero el sonar señala «obstáculo a 10 centímetros», el algoritmo aprende a deducir la presencia de un espejo o de un vidrio.

Además, los investigadores están desarrollando redes neuronales especializadas en la “segmentación semántica de superficies reflectantes”. En lugar de buscar únicamente objetos sólidos, estas redes se entrenan para detectar las anomalías visuales típicas de los espejos: discontinuidades en los bordes del suelo, diferencias de iluminación entre el reflejo y el entorno real, y la presencia del propio robot en la imagen. Se busca enseñar a las máquinas no solo a mirar, sino a deducir el contexto, dotándolas de una especie de “sentido común espacial” artificial.

En Breve (TL;DR)

A pesar de la increíble potencia de la inteligencia artificial moderna, los robots más avanzados no logran reconocer un objeto doméstico común como el espejo.

Las cámaras y los sensores láser interpretan las superficies reflectantes como extensiones navegables del espacio, creando peligrosas ilusiones ópticas y mapeos tridimensionales completamente erróneos.

Este obstáculo pone de manifiesto una profunda carencia del aprendizaje automático, que reconoce los patrones visuales pero carece de la conciencia espacial de los seres humanos.

Conclusiones

El espejo representa una metáfora perfecta del estado actual de la inteligencia artificial. Nos recuerda que, a pesar de los extraordinarios logros alcanzados en el procesamiento del lenguaje natural y en el cálculo abstracto, la interacción física con el mundo real y caótico sigue siendo un desafío formidable. Las máquinas pueden calcular las órbitas de los planetas o simular el plegamiento de las proteínas, pero tropiezan ante una ilusión óptica que un niño de dos años sabe desenmascarar. Resolver el problema del punto ciego doméstico no significa solo mejorar nuestros electrodomésticos, sino dar un paso fundamental hacia la creación de cerebros sintéticos dotados de una verdadera conciencia espacial. Hasta ese momento, el espejo seguirá reflejando no solo nuestras habitaciones, sino también los fascinantes límites de la tecnología que estamos intentando crear.

Preguntas frecuentes

Los robots aspiradores tienen dificultades para reconocer las superficies reflectantes, ya que sus sensores ópticos y láser se ven engañados. En lugar de detectar un obstáculo sólido, las cámaras perciben el reflejo de la habitación como un espacio abierto, lo que lleva al dispositivo a intentar atravesar el cristal.

Cuando el rayo láser de un sistema de navegación incide sobre una superficie reflectante, no regresa directamente, sino que rebota hacia otros objetos de la habitación. Este error de medición hace creer a la máquina que existe un espacio vacío mucho más profundo, creando habitaciones inexistentes en su mapa digital.

Los ingenieros están adoptando la fusión sensorial, una técnica que combina cámaras, láseres y sensores de ultrasonidos. Dado que las ondas sonoras rebotan en el vidrio, a diferencia de la luz, el sistema cruza los datos para detectar la presencia de un obstáculo y corregir el defecto visual.

Un ser humano utiliza su intuición y el contexto para comprender que se encuentra ante una superficie reflectante, reconociendo su propia imagen. Los sistemas artificiales analizan únicamente patrones de píxeles y, sin un entrenamiento específico sobre estas anomalías visuales, no logran procesar el concepto de reflejo.

La incapacidad de mapear correctamente los espacios reflectantes representa un grave problema de seguridad para los robots asistenciales. Un error de cálculo espacial podría provocar colisiones, caídas o daños a objetos frágiles, haciendo fundamental el desarrollo de una conciencia espacial avanzada.

¿Todavía tienes dudas sobre Por qué los robots más avanzados son ciegos ante este objeto?

Escribe aquí tu pregunta específica para encontrar al instante la respuesta oficial de Google.

Fuentes y Profundización

¿Te ha resultado útil este artículo? ¿Hay otro tema que te gustaría que tratara?

¡Escríbelo en los comentarios aquí abajo! Me inspiro directamente en vuestras sugerencias.