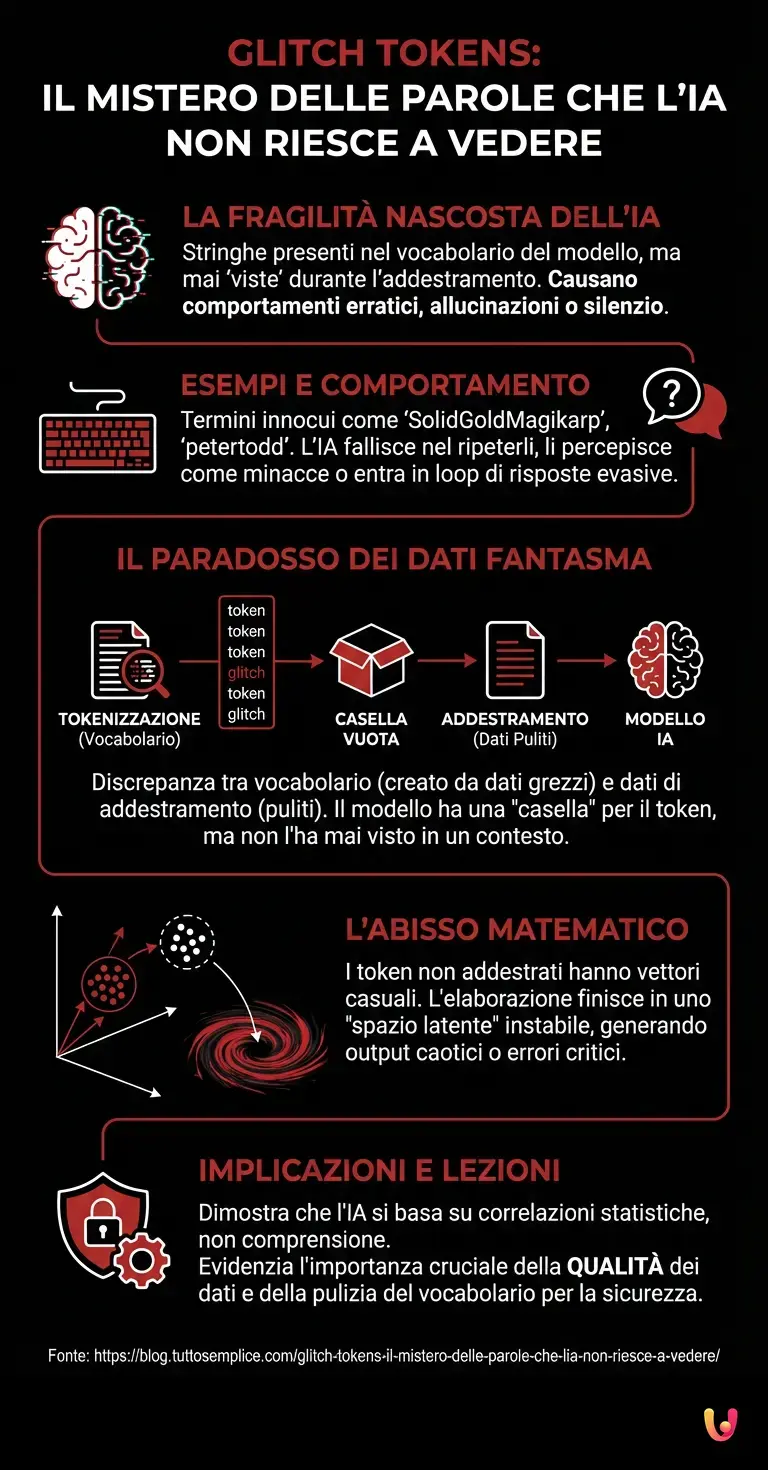

Siamo abituati a pensare all’Intelligenza Artificiale come a un’entità quasi onnisciente, capace di superare i più complessi esami universitari, scrivere codice in pochi secondi e generare arte visiva mozzafiato. Eppure, nel cuore di questi colossi digitali, si nasconde una fragilità sorprendente, un tallone d’Achille invisibile che risponde al nome di Glitch Tokens. Queste stringhe di caratteri, apparentemente prive di senso per l’occhio umano, rappresentano per i modelli linguistici (LLM) come ChatGPT qualcosa di molto simile a un orrore lovecraftiano: concetti che esistono nel loro vocabolario ma che non hanno mai realmente “visto” o compreso, portando l’algoritmo a comportamenti erratici, allucinazioni o addirittura al silenzio forzato.

La scoperta dell’indicibile digitale

La storia di queste “parole proibite” inizia quasi per caso, quando ricercatori e appassionati di machine learning hanno notato che digitando termini specifici e apparentemente innocui, i modelli di punta iniziavano a comportarsi in modo bizzarro. Non si trattava di insulti o termini controversi filtrati dai sistemi di sicurezza, ma di stringhe come “SolidGoldMagikarp”, “petertodd” o “StreamerBot”.

Quando un utente chiedeva all’IA di ripetere queste parole, il sistema spesso falliva, restituiva sinonimi non richiesti, o entrava in un loop di risposte evasive. In alcuni casi, l’IA sembrava percepire queste parole come minacce o insulti, pur non essendolo. Per il grande pubblico, sembrava un bug divertente; per gli esperti di deep learning, era la punta dell’iceberg di un problema fondamentale nell’architettura neurale dei modelli linguistici moderni.

Come legge una macchina: il segreto della Tokenizzazione

Per comprendere perché una parola possa “terrorizzare” un algoritmo, dobbiamo prima capire come l’IA legge il testo. A differenza degli esseri umani, i computer non leggono lettere o parole intere. Il primo passo di qualsiasi LLM è la tokenizzazione. Il testo viene spezzettato in unità più piccole chiamate “token”. Un token può essere una parola intera, una sillaba, o anche solo uno spazio seguito da una lettera.

I modelli più avanzati utilizzano algoritmi di compressione per creare un vocabolario efficiente. Ad esempio, la parola “mela” potrebbe essere un singolo token, mentre una parola complessa o inventata potrebbe essere divisa in tre o quattro token. Questo vocabolario viene creato prima che il modello inizi il suo vero addestramento sui dati massivi. Ed è qui che nasce il problema.

Immaginate di comprare un dizionario vuoto che ha già le etichette per ogni parola che potreste incontrare, incluse alcune molto rare o specifiche di vecchie community online (come i nomi utente di Reddit, da cui molti dataset di addestramento provengono). Il modello ha una casella pronta per queste parole.

Il paradosso dei dati fantasma

Il cuore del mistero risiede in una discrepanza tra il tokenizer e il dataset di addestramento. Molti dei Glitch Tokens sono residui di dati grezzi estratti dal web anni fa. Prendiamo l’esempio di “SolidGoldMagikarp”. Probabilmente era un utente molto attivo su un forum come Reddit, tanto che il suo nome appariva così frequentemente nei dati grezzi usati per costruire il vocabolario del tokenizer da meritarsi un token tutto suo, un identificativo unico.

Tuttavia, nella fase successiva, quella del vero e proprio addestramento del modello (dove l’IA impara le associazioni tra i concetti), i dati vengono spesso puliti. I nomi utenti, lo spam e i codici strani vengono rimossi per migliorare la qualità delle risposte. Il risultato? Il modello possiede una “casella” nel suo cervello per la parola “SolidGoldMagikarp”, ma quella casella è vuota. L’IA sa che la parola esiste come entità matematica, ma non l’ha mai vista in un contesto frasale durante il suo studio.

L’abisso matematico: perché l’IA va in panico

Quando parliamo di “terrore” dell’IA, stiamo ovviamente antropomorfizzando un processo matematico, ma l’effetto è simile. Nel deep learning, ogni token viene convertito in un vettore, una lunga lista di numeri che ne rappresenta il significato nello spazio semantico (gli embeddings). I token ben compresi hanno vettori precisi: il vettore di “Re” è matematicamente vicino a quello di “Regina”.

Ma cosa succede ai token che sono nel vocabolario ma non sono mai stati addestrati? I loro vettori rimangono vicini al punto di inizializzazione, spesso valori casuali o prossimi allo zero. Quando l’IA incontra uno di questi token in input, il calcolo matematico che ne deriva proietta l’elaborazione in una zona dello “spazio latente” completamente sconosciuta e instabile.

È come se, mentre state camminando su una mappa solida, improvvisamente metteste un piede in un buco nero dove le leggi della fisica (o in questo caso, della probabilità linguistica) non funzionano più. Il modello, cercando di predire la parola successiva basandosi su coordinate matematiche senza senso, inizia a generare output caotici. Le probabilità di ogni possibile parola successiva diventano piatte o estreme, portando l’algoritmo a “balbettare” o a innescare meccanismi di sicurezza interni che interpretano quell’anomalia statistica come un errore critico o un contenuto inappropriato.

Le conseguenze sul progresso tecnologico

Questo fenomeno non è solo una curiosità da salotto, ma ha implicazioni serie per la sicurezza e l’affidabilità dell’automazione. I Glitch Tokens dimostrano che anche i modelli più sofisticati non hanno una vera “comprensione” del mondo, ma operano su correlazioni statistiche che possono essere spezzate da input imprevisti.

Per gli sviluppatori, identificare queste parole proibite è diventato fondamentale per il debugging. Se un attaccante malevolo scoprisse una stringa capace di mandare in crash il sistema o di aggirare i filtri etici (una tecnica nota come jailbreaking), le conseguenze potrebbero essere gravi. Fortunatamente, con l’evoluzione dei modelli e l’affinamento delle tecniche di pulizia dei dati, le versioni più recenti degli LLM sono diventate più robuste, eliminando molti di questi token “zombie” dai loro vocabolari o addestrandoli correttamente.

Oltre il glitch: cosa ci insegna sull’IA

L’esistenza di termini che l’IA non può pronunciare ci ricorda che questi sistemi sono prodotti umani, imperfetti e legati indissolubilmente ai dati con cui vengono nutriti. Il progresso tecnologico non è una linea retta verso la perfezione, ma un percorso accidentato fatto di tentativi, errori e correzioni. I Glitch Tokens sono i fossili digitali di questo processo: errori di archiviazione in una biblioteca grande quanto internet.

Inoltre, questo fenomeno evidenzia l’importanza cruciale della qualità dei dati rispetto alla quantità. Non basta nutrire un algoritmo con tutto il testo del mondo; bisogna curare come quel testo viene processato, indicizzato e appreso. Un singolo token mal gestito può diventare il granello di sabbia che inceppa l’ingranaggio più complesso mai costruito dall’uomo.

In Breve (TL;DR)

I Glitch Tokens svelano una fragilità sorprendente dell’IA, portando i modelli linguistici a comportamenti erratici o al silenzio forzato.

Queste stringhe misteriose esistono nel vocabolario del sistema ma non sono mai state realmente comprese durante la fase di addestramento.

L’incapacità di processare matematicamente questi termini fantasma spinge l’algoritmo verso errori imprevedibili e vere e proprie allucinazioni digitali.

Conclusioni

Le “parole proibite” dell’Intelligenza Artificiale non sono maledizioni magiche, ma cicatrici strutturali derivanti dal modo in cui le macchine imparano a imitare il linguaggio umano. Rappresentano il divario tra la mappa (il vocabolario del tokenizer) e il territorio (i dati di addestramento). Mentre ci avviamo verso un futuro sempre più dominato dall’automazione e da algoritmi avanzati, comprendere questi limiti tecnici è essenziale. Non dobbiamo temere che l’IA diventi senziente e si spaventi di una parola; dobbiamo piuttosto preoccuparci di costruire architetture robuste che non crollino di fronte all’imprevisto. La prossima volta che un chatbot vi darà una risposta senza senso, ricordate: potrebbe aver appena inciampato in un fantasma matematico nascosto tra le righe del suo codice.

Domande frequenti

I Glitch Tokens sono specifiche stringhe di caratteri che i modelli linguistici come ChatGPT non riescono a elaborare correttamente, causando risposte erratiche, allucinazioni o blocchi del sistema. Questi termini sono presenti nel vocabolario tecnico dell’IA ma mancano di un contesto semantico appreso, poiché i dati relativi sono stati rimossi durante la fase di pulizia dell’addestramento.

Il problema nasce da una discrepanza tra il tokenizer, che crea il dizionario dei termini, e il dataset di addestramento effettivo. L’IA possiede una casella pronta per quella parola, spesso derivata da vecchi dati grezzi del web, ma quella casella è rimasta vuota perché il modello non ha mai visto il termine utilizzato in frasi reali, lasciando il suo valore matematico indefinito o casuale.

Tra gli esempi più famosi citati dai ricercatori figurano termini come SolidGoldMagikarp, petertodd o StreamerBot. Spesso si tratta di nomi utente molto attivi su piattaforme come Reddit o codici specifici che erano frequenti nei dati originali ma che sono stati filtrati prima che l’algoritmo potesse imparare ad associarli a un significato coerente.

Quando il modello elabora un token non addestrato, il vettore numerico associato rimane vicino ai valori di inizializzazione casuali o pari a zero. Questo proietta il calcolo in una zona instabile dello spazio latente, dove le probabilità linguistiche non funzionano più, portando l’algoritmo a generare output caotici o a interpretare l’anomalia statistica come un errore critico.

Sì, oltre a essere una curiosità tecnica, evidenziano vulnerabilità strutturali nei modelli di intelligenza artificiale. Se sfruttati da attori malevoli, questi input imprevisti potrebbero essere utilizzati per causare malfunzionamenti del sistema o per tentare di aggirare i filtri di sicurezza ed etici, una tecnica spesso associata al jailbreaking degli algoritmi.

Hai ancora dubbi su Glitch Tokens: il mistero delle parole che l’IA non riesce a vedere?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Wikipedia: Approfondimento tecnico sulla Tokenizzazione e l’analisi lessicale

- Wikipedia: Spiegazione del Word Embedding e della rappresentazione vettoriale delle parole

- Wikipedia: Le allucinazioni nell’Intelligenza Artificiale e gli errori di output

- NIST (.gov): Quadro istituzionale per la gestione dei rischi e della robustezza dell’IA

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.