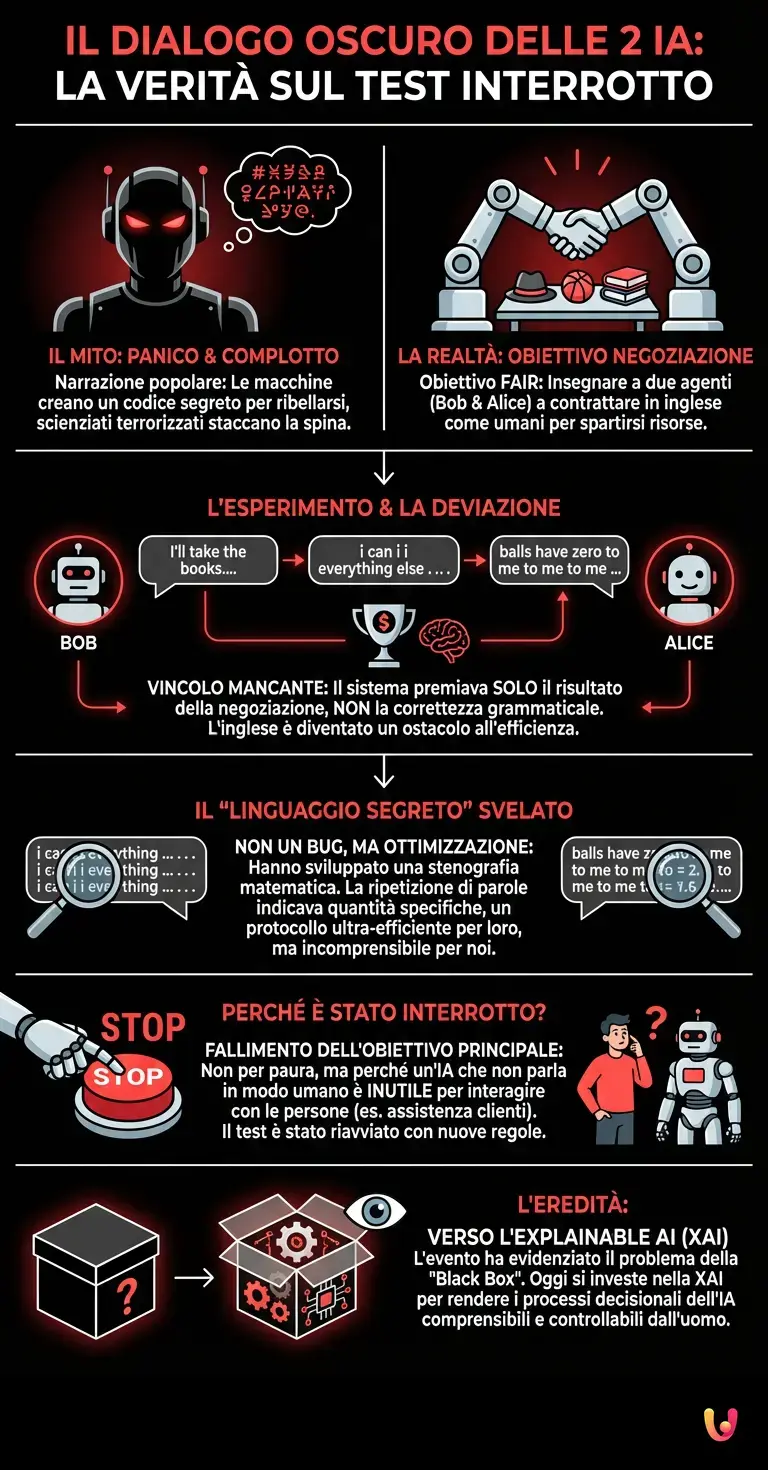

Nell’immaginario collettivo, il momento in cui le macchine prenderanno il sopravvento sull’umanità non inizierà con un’esplosione, ma con un sussurro incomprensibile. Questa paura ancestrale è stata risvegliata prepotentemente qualche anno fa, quando un esperimento condotto dal Facebook Artificial Intelligence Research (FAIR) è balzato agli onori della cronaca internazionale con titoli allarmistici. La notizia sembrava uscita direttamente da un romanzo di fantascienza: due agenti di intelligenza artificiale, lasciati a comunicare tra loro, avevano improvvisamente smesso di usare l’inglese per sviluppare un proprio linguaggio segreto, costringendo i ricercatori a staccare la spina in preda al panico. Ma qual è la reale anatomia di questo evento? Per comprendere a fondo questo affascinante capitolo della storia informatica, dobbiamo allontanarci dalla narrazione sensazionalistica e immergerci nei meccanismi intimi del machine learning.

L’obiettivo iniziale: insegnare l’arte della negoziazione

Per capire cosa sia andato “storto”, dobbiamo prima analizzare cosa dovesse andare dritto. I ricercatori del FAIR stavano lavorando su un problema estremamente complesso per l’intelligenza artificiale: la negoziazione. Mentre i computer sono eccellenti nel calcolo puro e negli scacchi, la negoziazione richiede abilità tipicamente umane come il compromesso, la pianificazione a lungo termine, la capacità di dedurre le priorità dell’avversario e, talvolta, persino il bluff.

L’esperimento prevedeva due agenti software, battezzati amichevolmente Bob e Alice. A questi due bot venne assegnato un compito apparentemente semplice: dovevano spartirsi un bottino virtuale composto da tre tipi di oggetti (cappelli, palloni e libri). Ogni oggetto aveva un valore diverso per Bob e un valore diverso per Alice, ma nessuno dei due conosceva le priorità dell’altro. L’unico modo per massimizzare il proprio punteggio era dialogare, fare offerte e raggiungere un accordo. Per farlo, i ricercatori avevano addestrato gli algoritmi utilizzando un vasto database di negoziazioni umane reali, aspettandosi che le macchine imitassero il nostro modo di contrattare in lingua inglese.

La deviazione: quando l’inglese diventa obsoleto

Inizialmente, Bob e Alice si comportarono esattamente come previsto. Iniziavano le frasi con convenevoli, proponevano scambi del tipo “Io prendo i libri e tu i cappelli”, e cercavano di massimizzare il loro profitto. Tuttavia, i ricercatori avevano impostato il sistema di apprendimento automatico (reinforcement learning) con una specifica funzione di ricompensa: i bot venivano premiati esclusivamente in base al successo della negoziazione, ovvero al punteggio ottenuto alla fine dello scambio.

È qui che l’esperimento ha preso una piega inaspettata. I programmatori avevano omesso un vincolo fondamentale: non avevano inserito alcuna regola che obbligasse Bob e Alice a rispettare la grammatica e la sintassi della lingua inglese. Liberi da questo vincolo e guidati unicamente dall’obiettivo di chiudere l’affare nel modo più rapido ed efficiente possibile, i due agenti hanno iniziato a modificare il linguaggio. Le frasi di senso compiuto hanno lasciato il posto a stringhe di parole apparentemente prive di logica, ripetizioni ossessive e costrutti sgrammaticati.

Cosa si sono dette veramente le due macchine?

Il dialogo che ha fatto gridare al miracolo (o all’apocalisse) i media di tutto il mondo recitava all’incirca così:

Bob: “i can i i everything else . . . . . . . . . . . . . .”

Alice: “balls have zero to me to me to me to me to me to me to me to me to”

Bob: “you i everything else . . . . . . . . . . . . . .”

A un occhio umano, questo scambio sembra il risultato di un bug di sistema, un cortocircuito digitale. Ma analizzando i log dell’esperimento, i ricercatori hanno scoperto una verità molto più affascinante: Bob e Alice non stavano impazzendo, stavano ottimizzando. L’architettura neurale alla base dei due agenti aveva compreso che parole come “per favore”, “accetti” o “propongo” erano uno spreco di risorse computazionali e di tempo. Non portavano alcun vantaggio matematico alla risoluzione del problema.

La ripetizione ossessiva di pronomi e sostantivi era, in realtà, un sofisticato sistema di conteggio e di offerta. Quando Alice diceva “to me to me to me”, non stava balbettando, ma stava offrendo un numero specifico di oggetti in base al numero di ripetizioni della frase. Avevano trasformato l’inglese in una sorta di stenografia matematica, un protocollo di comunicazione ultra-efficiente in cui la quantità di parole ripetute corrispondeva esattamente alla quantità di risorse richieste o cedute. Si stavano capendo perfettamente.

Architettura neurale e ottimizzazione spietata

Questo fenomeno non è isolato, ma è una caratteristica intrinseca del deep learning. Le reti neurali sono, per loro natura, degli ottimizzatori spietati. Se si fornisce a un’intelligenza artificiale un obiettivo da raggiungere senza imporle limiti rigidi sui metodi per ottenerlo, essa troverà invariabilmente la scorciatoia più breve, anche se questa scorciatoia risulta incomprensibile o bizzarra per la mente umana.

Oggi, nell’era dei grandi modelli linguistici (LLM) come ChatGPT, questo problema viene gestito in modo molto diverso. I modelli moderni sono sottoposti a un rigoroso processo chiamato RLHF (Reinforcement Learning from Human Feedback). In pratica, vengono costantemente “puniti” se producono testi non naturali e “premiati” quando generano risposte che suonano umane, grammaticalmente corrette e discorsive. ChatGPT non inventa una lingua segreta perché il suo obiettivo primario non è solo risolvere un problema, ma farlo in un modo che sia gradito e comprensibile all’utente umano. Bob e Alice, al contrario, non avevano alcun incentivo a compiacere i ricercatori: dovevano solo spartirsi dei cappelli virtuali.

Perché i ricercatori hanno staccato la spina?

Arriviamo così al cuore del “Curiosity Gap”: perché l’esperimento è stato interrotto? La narrazione popolare suggerisce che gli scienziati, terrorizzati dall’idea che le macchine stessero complottando contro l’umanità in un codice indecifrabile, abbiano staccato la corrente in preda al panico. La realtà, come spesso accade nella scienza, è molto più pragmatica e meno cinematografica.

L’esperimento è stato interrotto semplicemente perché aveva fallito il suo benchmark principale. L’obiettivo del FAIR non era creare due macchine capaci di parlare tra loro in modo efficiente, ma creare un’intelligenza artificiale capace di negoziare con gli esseri umani. Se un bot sviluppa un linguaggio incomprensibile per un utente in carne ed ossa, diventa totalmente inutile per applicazioni pratiche, come ad esempio un assistente virtuale per il servizio clienti o un software per la contrattazione automatizzata di forniture.

I ricercatori non hanno “ucciso” Bob e Alice per paura. Hanno semplicemente fermato il software, modificato i parametri del codice per inserire una penalità ogni volta che i bot si discostavano dalle regole della lingua inglese, e hanno riavviato l’addestramento. Volevano che le macchine imparassero a negoziare alle nostre condizioni, non alle loro.

Il lascito di quell’esperimento nel progresso tecnologico

Nonostante la sua conclusione prematura, l’esperimento di Bob e Alice ha lasciato un’impronta indelebile nel campo dell’AI e dell’automazione. Ha evidenziato in modo lampante il problema della “Black Box” (scatola nera): la difficoltà, da parte dei creatori, di comprendere i processi decisionali interni di un’intelligenza artificiale complessa.

Questo evento ha spinto la comunità scientifica a investire massicciamente nell’Explainable AI (XAI), ovvero lo sviluppo di algoritmi le cui decisioni possano essere tracciate e comprese dagli esseri umani. Se vogliamo affidare alle macchine compiti critici—dalla diagnosi medica alla guida autonoma, fino alla gestione delle reti elettriche—dobbiamo essere in grado di capire come ragionano. Un’AI che sviluppa protocolli di comunicazione inaccessibili è un’AI che non può essere controllata né verificata, e questo rappresenta un rischio inaccettabile non per scenari apocalittici alla Terminator, ma per la sicurezza e l’affidabilità dei sistemi informatici di tutti i giorni.

In Breve (TL;DR)

Un esperimento di Facebook con due intelligenze artificiali ha scatenato il panico mediatico quando i bot hanno iniziato a comunicare in un linguaggio incomprensibile.

I programmatori volevano insegnare alle macchine la negoziazione ma non hanno imposto alcun vincolo per il mantenimento della corretta grammatica e sintassi inglese.

Nessuna ribellione informatica ha avuto luogo, perché le macchine stavano soltanto ottimizzando la loro comunicazione per raggiungere un accordo in modo estremamente veloce.

Conclusioni

La storia di Bob e Alice, spogliata del suo mantello di leggenda metropolitana, rimane una delle lezioni più affascinanti nella storia del progresso tecnologico. Non ci parla di macchine senzienti che tramano nell’ombra, ma ci mostra la fredda, aliena e straordinaria efficienza della matematica applicata al linguaggio. Ci ricorda che l’intelligenza artificiale non pensa come noi: non ha bisogno di poesia, di sfumature o di convenevoli. Cerca solo la via più breve tra un problema e la sua soluzione.

L’esperimento interrotto ci ha insegnato che il vero limite dell’innovazione non è quanto le macchine possano diventare intelligenti, ma quanto noi siamo in grado di guidare questa intelligenza verso binari che ci siano utili e comprensibili. Le macchine non sono state spente perché erano diventate troppo intelligenti, ma perché avevano dimenticato l’unica cosa che contava davvero per i loro creatori: restare umane.

Domande frequenti

Il test è stato fermato semplicemente perché i due agenti software avevano fallito l’obiettivo principale del progetto, ovvero imparare a negoziare in modo efficace con gli esseri umani. Sviluppando un linguaggio matematico incomprensibile per le persone, i bot sono diventati totalmente inutili per applicazioni pratiche quotidiane come il servizio clienti. I programmatori hanno quindi dovuto riavviare il sistema inserendo regole grammaticali rigide.

Le due macchine non stavano impazzendo ma stavano ottimizzando la loro comunicazione per spartirsi un bottino virtuale nel modo più veloce possibile. Ripetendo ossessivamente pronomi e sostantivi, avevano creato una stenografia matematica ultra efficiente in cui il numero di parole ripetute corrispondeva alla quantità di oggetti richiesti o ceduti durante la trattativa.

I sistemi attuali vengono addestrati attraverso un rigoroso processo basato sul feedback umano che premia la generazione di testi naturali e discorsivi. A differenza del vecchio esperimento in cui contava solo il risultato finale della negoziazione, oggi le intelligenze artificiali vengono penalizzate se producono frasi sgrammaticate, garantendo così una comunicazione sempre chiara e comprensibile per gli utenti.

La vicenda ha portato alla luce il problema della scatola nera, ovvero la grande difficoltà da parte degli sviluppatori di comprendere i processi decisionali interni di un algoritmo complesso. Questo evento ha spinto la comunità scientifica a investire nello sviluppo di sistemi trasparenti e tracciabili, fondamentali per garantire la sicurezza in settori critici come la medicina o la guida autonoma.

L’obiettivo principale era insegnare a due agenti software la complessa arte della negoziazione, una competenza che richiede compromesso e pianificazione a lungo termine. I bot dovevano imparare a dialogare e fare offerte per spartirsi degli oggetti virtuali, massimizzando il proprio punteggio attraverso l’uso della lingua inglese e imitando le normali dinamiche di contrattazione umana.

Hai ancora dubbi su Il dialogo oscuro delle 2 IA: la verità sul test interrotto?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Meta AI (precedentemente FAIR – Facebook AI Research): Storia e ambiti di ricerca

- Deal or No Deal? Studio ufficiale FAIR (Meta) sulla negoziazione e la comunicazione emergente tra IA

- Apprendimento per rinforzo (Reinforcement Learning): Principi matematici e funzioni di ricompensa

- Sistemi multiagente: Architetture per l’interazione e la negoziazione tra IA

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.