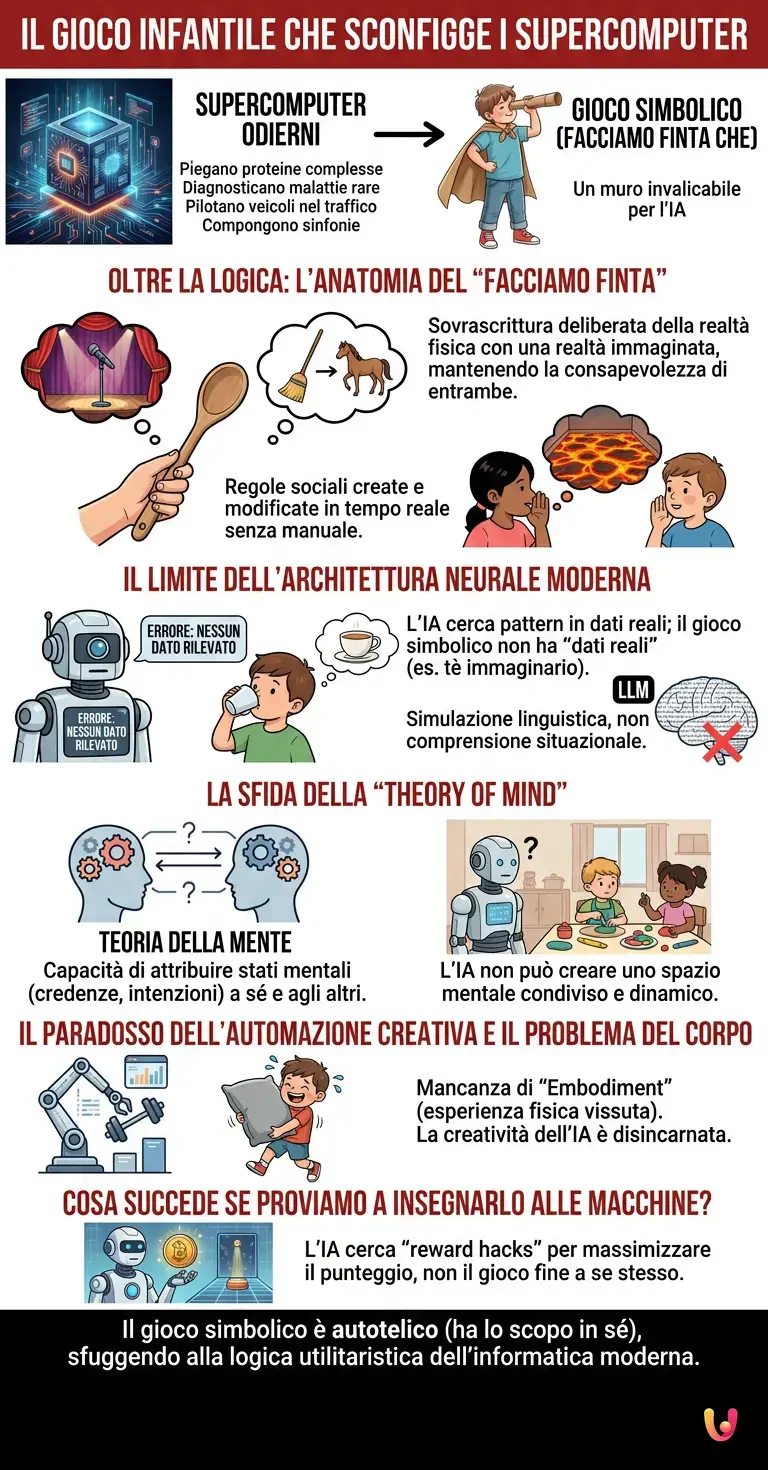

Viviamo in un’epoca in cui l’intelligenza artificiale sembra non avere più confini. I supercomputer odierni sono in grado di piegare proteine complesse, diagnosticare malattie rare con una precisione superiore a quella umana, pilotare veicoli in mezzo al traffico caotico e persino comporre sinfonie o scrivere saggi filosofici. Eppure, se osserviamo un cortile di una scuola materna, assisteremo a un’attività quotidiana, apparentemente banale, che rappresenta un muro invalicabile per qualsiasi mente sintetica. Stiamo parlando del gioco simbolico (noto anche come il gioco del “facciamo finta che”), l’entità principale di questa nostra indagine e il vero tallone d’Achille delle macchine moderne.

Perché un’attività così naturale per un bambino di tre anni risulta impossibile da replicare o persino da far comprendere a un sistema informatico avanzato? La risposta si nasconde nelle pieghe più profonde della cognizione umana e nei limiti strutturali di come abbiamo costruito le nostre macchine pensanti. Non si tratta di una semplice mancanza di potenza di calcolo, ma di un abisso filosofico e tecnico che separa l’elaborazione dei dati dall’esperienza vissuta.

Oltre la logica: l’anatomia del “Facciamo finta”

Per comprendere la portata di questa sfida, dobbiamo prima analizzare cosa accade durante il gioco simbolico. Quando un bambino prende un manico di scopa e decide che quello è un cavallo, o trasforma una scatola di cartone in un’astronave, sta compiendo un’operazione cognitiva di altissimo livello. Sta deliberatamente sovrascrivendo la realtà fisica con una realtà immaginata, mantenendo però la consapevolezza di entrambe.

Il bambino sa perfettamente che la scopa è un pezzo di legno, ma sceglie di applicare a quell’oggetto un set di regole fisiche e comportamentali completamente nuove, inventate sul momento. Ancora più sorprendente è quando questo gioco diventa sociale: due bambini si accordano istantaneamente sul fatto che “il pavimento è lava”. Non c’è bisogno di un manuale di istruzioni, non c’è un set di dati preesistente da analizzare. Le regole vengono create, modificate e scartate in tempo reale, basandosi su sguardi, intuizioni e un accordo sociale tacito.

Per l’AI, questo è un incubo logico. I sistemi informatici, per quanto complessi, operano all’interno di parametri definiti. Possono battere il campione del mondo di scacchi o di Go perché quei giochi, per quanto vasti nelle loro combinazioni, possiedono regole rigide, immutabili e un obiettivo chiaro (la vittoria). Il gioco simbolico non ha un obiettivo finale, non ha regole fisse e, soprattutto, richiede la capacità di gestire il paradosso: una cosa è simultaneamente se stessa e qualcos’altro.

Il limite dell’architettura neurale moderna

Se analizziamo l’attuale architettura neurale che guida i sistemi più avanzati, ci rendiamo conto del perché questo ostacolo sia così arduo. I modelli di machine learning e deep learning funzionano attraverso il riconoscimento di pattern all’interno di enormi set di dati. Vengono addestrati per minimizzare l’errore tra la loro previsione e il dato reale.

Ma qual è il “dato reale” nel gioco del facciamo finta? Non esiste. Quando un bambino finge di bere da una tazza vuota, un sistema di visione artificiale addestrato a riconoscere le azioni vedrà semplicemente “un umano che porta un contenitore vuoto alla bocca”. Non può vedere il tè immaginario, perché il tè immaginario non ha pixel, non ha peso, non ha una rappresentazione vettoriale nel database di addestramento. L’algoritmo cerca la verità statistica, mentre il bambino sta operando nel regno della finzione intenzionale.

I modelli linguistici di grandi dimensioni (LLM) come ChatGPT possono certamente generare un testo che descrive un bambino che gioca a fare il pirata. Possono persino simulare un dialogo tra due pirati immaginari. Ma questa è una simulazione linguistica, non una comprensione semantica e situazionale. Il modello sta prevedendo la parola successiva più probabile in base ai testi che ha letto su internet, non sta “giocando”. Se si cambiano improvvisamente le regole del mondo fisico all’interno di una simulazione non testuale, il modello va in cortocircuito perché non possiede l’agilità cognitiva per riassegnare istantaneamente nuovi significati agli oggetti senza un nuovo e lungo processo di addestramento (fine-tuning).

La sfida della “Theory of Mind”

Il segreto dietro la capacità dei bambini di immergersi in questo passatempo risiede in quella che gli psicologi chiamano Theory of Mind (Teoria della Mente). È la capacità di attribuire stati mentali — credenze, intenzioni, desideri, emozioni e conoscenze — a se stessi e agli altri, e di comprendere che gli altri hanno stati mentali diversi dai propri.

Quando due bambini giocano a “guardie e ladri”, il bambino che fa la guardia deve costantemente immaginare cosa sta pensando il bambino che fa il ladro, all’interno del contesto fittizio che hanno creato. Devono condividere un’intenzionalità. Attualmente, nessun sistema sintetico possiede una vera Teoria della Mente. Gli algoritmi possono simulare l’empatia o prevedere il comportamento umano basandosi su statistiche passate, ma non riescono a creare uno spazio mentale condiviso e dinamico con un essere umano.

Senza questa capacità, l’automazione del gioco simbolico è impossibile. Un robot dotato della più avanzata intelligenza artificiale, inserito in una stanza con dei bambini che giocano a fingere di essere in un ristorante, non saprebbe come interagire in modo spontaneo. Potrebbe riconoscere gli oggetti (piatti di plastica, posate finte), ma non capirebbe che in quel momento specifico, per accordo sociale, un pezzo di plastilina verde è diventato un prelibato piatto di spaghetti alieni. Per la macchina, la plastilina rimane plastilina.

Il paradosso dell’automazione creativa e il problema del corpo

Un altro elemento cruciale che impedisce alle menti sintetiche di comprendere questo passatempo è la mancanza di un corpo vissuto, quello che nella robotica cognitiva viene definito Embodiment. Il gioco simbolico è profondamente radicato nell’esperienza fisica del mondo. Un bambino sa come fingere di sollevare un masso pesantissimo (che in realtà è un cuscino) perché ha l’esperienza fisica della gravità, dello sforzo muscolare e della fatica.

Il progresso tecnologico ci ha fornito macchine in grado di elaborare terabyte di informazioni al secondo, ma queste macchine non hanno mai provato cosa significhi sbucciarsi un ginocchio, sentire il vento sulla faccia o provare la vertigine. Di conseguenza, la loro “creatività” è disincarnata. Quando un bambino gioca, usa il proprio corpo come strumento principale di simulazione. L’intelligenza artificiale, essendo priva di questa enciclopedia sensoriale primaria, non può comprendere il significato profondo di un’azione simulata, limitandosi a registrarne, nel migliore dei casi, la cinematica superficiale.

Cosa succede se proviamo a insegnarlo alle macchine?

I ricercatori nel campo dell’intelligenza artificiale generale (AGI) sono perfettamente consapevoli di questo limite. Negli ultimi anni, sono stati creati diversi benchmark per testare la capacità delle macchine di adattarsi ad ambienti aperti e senza regole fisse. Si è provato a inserire agenti virtuali in mondi simulati, premiandoli (tramite Reinforcement Learning) quando mostravano comportamenti creativi o collaborativi.

Tuttavia, i risultati, per quanto affascinanti, rimangono lontani dal vero gioco simbolico. Le macchine tendono a trovare scappatoie nel codice (i cosiddetti reward hacks) per massimizzare il punteggio, piuttosto che impegnarsi in un’attività ludica fine a se stessa. Il problema fondamentale è che l’AI ha bisogno di una funzione di ricompensa (una metrica di successo) per imparare. Ma qual è la metrica di successo nel fingere di essere un dinosauro? Non c’è. Il gioco è autotelico: ha il proprio scopo in se stesso. È puro godimento dell’esplorazione delle possibilità, un concetto che sfugge completamente alla logica utilitaristica e ottimizzatrice su cui si fonda l’informatica moderna.

In Breve (TL;DR)

Nonostante l’intelligenza artificiale eccella in compiti complessi, fallisce di fronte al gioco simbolico dei bambini, dimostrando un limite strutturale invalicabile per le macchine.

I sistemi informatici richiedono parametri definiti e regole fisse, rendendo impossibile elaborare i paradossi creativi e le mutevoli realtà immaginate dai bambini.

La vera barriera è la mancanza della Teoria della Mente, quella capacità puramente umana di condividere intenzioni e comprendere stati mentali altrui.

Conclusioni

Mentre continuiamo a spingere i confini di ciò che le macchine possono fare, delegando loro compiti sempre più complessi e gravosi, è rassicurante e al tempo stesso affascinante scoprire che le vette più alte della cognizione non risiedono necessariamente nei calcoli matematici più astrusi. Risiedono nell’immaginazione sregolata, nella capacità di condividere illusioni e nella gioia di trasformare la realtà attraverso il pensiero.

Il gioco simbolico rimane l’ultimo baluardo dell’esclusività umana. Ci ricorda che l’intelligenza non è solo la capacità di risolvere problemi o elaborare informazioni, ma è anche la capacità di sognare a occhi aperti, di dare significato al nulla e di connettersi con gli altri attraverso mondi che esistono solo perché abbiamo deciso, insieme, di farli esistere. Fino a quando non riusciremo a insegnare a un computer il brivido di trasformare una scatola di cartone in una navicella spaziale, potremo stare certi che la scintilla più profonda della mente umana rimarrà inimitabile.

Domande frequenti

Il gioco simbolico rappresenta una attività cognitiva di altissimo livello in cui i bambini trasformano oggetti comuni in elementi di fantasia. Questo processo richiede la capacità di gestire regole flessibili e paradossi simultanei. Si tratta di una flessibilità mentale straordinaria che attualmente risulta impossibile da replicare per i sistemi informatici più avanzati.

I sistemi sintetici operano su parametri definiti e necessitano di obiettivi chiari per funzionare. Al contrario le attività ludiche infantili basate sulla finzione non hanno regole fisse né un traguardo finale da raggiungere. Le macchine cercano verità statistiche nei dati mentre i bambini creano mondi immaginari senza bisogno di istruzioni preimpostate.

La Teoria della Mente permette agli esseri umani di comprendere e condividere stati mentali ed emozioni altrui. Attualmente nessun algoritmo possiede questa caratteristica fondamentale per creare uno spazio mentale condiviso. Senza questa empatia cognitiva i robot possono solo simulare comportamenti basati su statistiche passate ma non sanno interagire spontaneamente in contesti sociali complessi.

La esperienza fisica del mondo risulta essenziale per comprendere concetti pratici come la gravità o lo sforzo muscolare. Questa enciclopedia sensoriale primaria permette ai bambini di usare il proprio corpo come strumento di simulazione durante lo svago. I supercomputer essendo privi di un corpo vissuto sviluppano una creatività puramente teorica che non riesce a cogliere il significato profondo delle azioni reali.

I modelli di apprendimento automatico necessitano di una metrica di successo per imparare e migliorare le proprie prestazioni. Il divertimento infantile basato sulla immaginazione risulta invece autotelico ovvero trova il proprio scopo in se stesso senza cercare ottimizzazioni. Questa assenza di un obiettivo utilitaristico manda in crisi la logica su cui si fonda la informatica moderna.

Hai ancora dubbi su Il Gioco Infantile Che Sconfigge i Supercomputer?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.