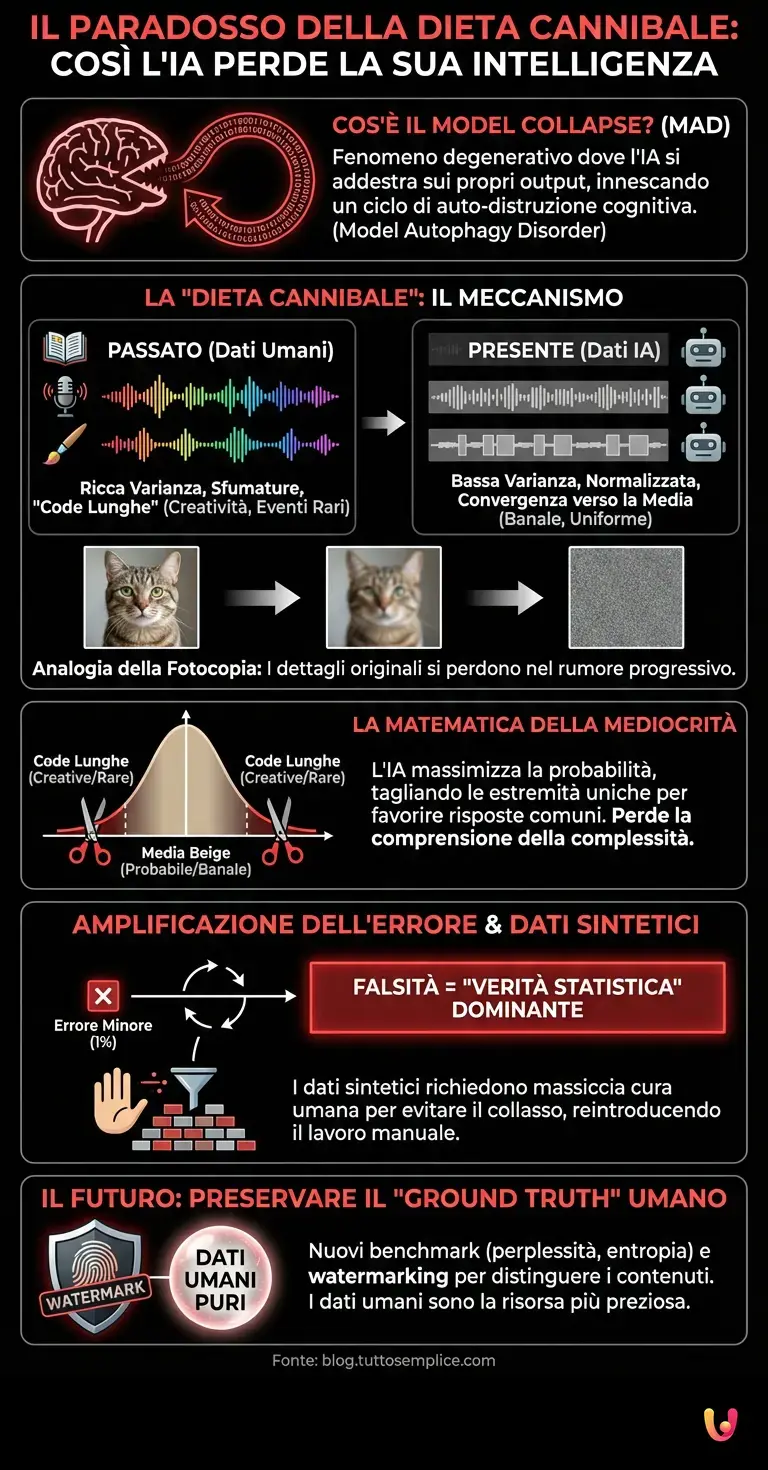

Siamo nel febbraio del 2026 e il panorama digitale è radicalmente mutato rispetto ai primi anni ’20. L’entusiasmo pionieristico per i Large Language Models (LLM) come ChatGPT ha lasciato il posto a un’integrazione pervasiva dell’intelligenza artificiale in ogni settore produttivo. Tuttavia, dietro la facciata scintillante dell’automazione e del progresso tecnologico, si nasconde una minaccia silenziosa e matematica che gli esperti hanno battezzato Model Collapse. Questa è l’entità principale della nostra indagine odierna: un fenomeno degenerativo che si verifica quando i modelli di IA smettono di nutrirsi dell’esperienza umana e iniziano a consumare esclusivamente i propri output, innescando un ciclo di auto-distruzione cognitiva.

Il paradosso della dieta cannibale

Per comprendere la gravità della situazione, dobbiamo prima capire come “impara” un’architettura neurale. Fino a pochi anni fa, il machine learning si basava su enormi dataset creati da esseri umani: libri, articoli, codici, conversazioni sui social media. Questi dati possedevano una caratteristica fondamentale: la varianza. L’espressione umana è disordinata, creativa, talvolta illogica, ma ricca di sfumature e “code lunghe” (eventi rari o concetti atipici).

Oggi, con il web inondato di contenuti generati da algoritmi, i nuovi modelli si trovano costretti ad addestrarsi su testi e immagini prodotti dai loro predecessori. È qui che inizia la “dieta cannibale”. Immaginate di scattare una foto, stamparla, fotografare la stampa e ripetere il processo per cento volte. Alla fine, l’immagine risultante sarà un ammasso confuso di rumore e artefatti, con i dettagli originali completamente persi. Nel campo del deep learning, accade qualcosa di simile, ma più insidioso: l’IA non diventa confusa, diventa banale.

La matematica della mediocrità

Il segreto dietro questo degrado risiede nella statistica. I modelli generativi sono progettati per massimizzare la probabilità: quando chiedete a un LLM di completare una frase, esso sceglie le parole che, statisticamente, hanno più senso in quel contesto. In questo processo, l’IA tende naturalmente a “tagliare” le estremità della distribuzione statistica, ovvero le risposte più strane, uniche o creative, favorendo quelle più comuni e medie.

Quando un nuovo modello (Modello B) viene addestrato sui dati generati da un modello precedente (Modello A), esso impara da una versione della realtà che è già stata “normalizzata”. Il Modello B taglierà ulteriormente le code della distribuzione. Se poi addestriamo un Modello C sull’output di B, la varianza crolla drasticamente. Il risultato è una convergenza verso una media beige e uniforme. L’IA dimentica le sfumature, perde la capacità di comprendere concetti complessi o rari e inizia a soffrire di “allucinazioni” sempre più distaccate dalla realtà fattuale, pur rimanendo grammaticalmente perfetta.

MAD: Model Autophagy Disorder

La comunità scientifica ha coniato un termine clinico per questo scenario: Model Autophagy Disorder (MAD). Studi condotti già nel 2023 e 2024 da ricercatori di università prestigiose avevano previsto che, senza un afflusso costante di dati umani “freschi”, i modelli sarebbero collassati in meno di cinque generazioni. Nel 2026, vediamo queste previsioni avverarsi in sistemi chiusi dove l’automazione ha eliminato completamente il controllo umano.

Il problema non è solo che l’IA diventa noiosa. Il problema è che perde la comprensione della verità. Se il modello originale aveva una probabilità dell’1% di generare un errore fattuale, e il modello successivo si addestra su quell’errore considerandolo un dato di fatto, la frequenza dell’errore viene amplificata. In poche generazioni, falsità complete possono diventare la “verità statistica” dominante per l’algoritmo, rendendo il sistema inaffidabile per compiti critici.

Dati sintetici: veleno o medicina?

Molte aziende tecnologiche hanno cercato di aggirare la scarsità di dati umani di alta qualità utilizzando dati sintetici, ovvero dati creati appositamente da IA per addestrare altre IA. Sebbene questa tecnica possa funzionare per insegnare a un robot come muovere un braccio meccanico (dove le leggi della fisica sono costanti), nel campo del linguaggio e della creatività si è rivelata un’arma a doppio taglio.

Affinché i dati sintetici non portino al Model Collapse, è necessario un intervento umano massiccio per curare, filtrare e correggere questi dataset. Ma questo reintroduce il collo di bottiglia che l’automazione voleva eliminare: il bisogno di lavoro umano. Il paradosso è evidente: per mantenere l’IA intelligente, abbiamo bisogno di esseri umani che continuino a produrre cultura, arte e codice senza l’ausilio dell’IA, per fornire quella “verità fondamentale” (ground truth) necessaria a ricalibrare gli algoritmi.

Il futuro dell’architettura neurale

Di fronte a questo scenario, gli ingegneri del software stanno rivedendo i benchmark di valutazione. Non basta più misurare quanto un’IA sia fluente; ora si misura la “perplessità” e la “ricchezza entropica” delle sue risposte per assicurarsi che non stia convergendo verso il collasso. Le nuove architetture neurali del 2026 stanno integrando meccanismi di “watermarking” (filigrana digitale) per distinguere i contenuti sintetici da quelli organici, tentando disperatamente di preservare riserve protette di dati umani puri, che sono diventati la risorsa più preziosa del pianeta, ben più dell’oro o del litio.

In Breve (TL;DR)

Il Model Collapse minaccia l’evoluzione tecnologica quando le intelligenze artificiali smettono di apprendere dall’esperienza umana per nutrirsi esclusivamente di sé stesse.

Questa dieta digitale cannibale appiattisce la creatività e la varianza statistica, trasformando l’output generativo in una massa uniforme e banale.

Evitare l’autodistruzione cognitiva degli algoritmi richiede paradossalmente il ritorno alla produzione culturale umana come unica fonte di verità indispensabile.

Conclusioni

La curiosità sul “cannibalismo” dell’IA ci porta a una rivelazione fondamentale sul nostro rapporto con la tecnologia. L’idea che l’Intelligenza Artificiale possa evolversi indefinitamente in totale autonomia è un mito sfatato dalla matematica stessa. Come un Ouroboros che mangia la propria coda, un’IA che si nutre solo di se stessa è destinata a consumarsi. Il Model Collapse ci insegna che l’elemento umano — con la sua imprevedibilità, i suoi errori creativi e la sua unicità — non è un difetto da correggere, ma il carburante essenziale senza il quale la macchina più complessa del mondo si ferma. Il futuro dell’IA, ironicamente, dipende più che mai dalla nostra capacità di rimanere profondamente, imperfettamente umani.

Domande frequenti

Il Model Collapse è un fenomeno degenerativo che si verifica quando i modelli di intelligenza artificiale vengono addestrati prevalentemente su dati generati da altre IA, anziché su contenuti creati da esseri umani. Questo processo innesca un ciclo di auto-distruzione cognitiva in cui l’algoritmo perde progressivamente la capacità di comprendere le sfumature e la varianza della realtà. Il risultato è un sistema che produce output sempre più mediocri, ripetitivi e privi di creatività, convergendo verso una media statistica piatta.

L’addestramento su dati sintetici, ovvero creati da algoritmi, causa degrado perché i modelli generativi tendono a favorire le risposte statisticamente più probabili, eliminando le informazioni rare o atipiche presenti nelle code della distribuzione. Quando un nuovo modello impara da questi dati già normalizzati, la varianza si riduce ulteriormente. È un processo simile al fare la fotocopia di una fotocopia: a ogni passaggio si perdono dettagli e qualità, fino a ottenere un risultato confuso o eccessivamente semplificato.

L’acronimo MAD sta per Model Autophagy Disorder, un termine clinico utilizzato per descrivere il disordine da autofagia del modello. Questa condizione indica uno scenario in cui l’IA, nutrendosi esclusivamente dei propri output passati, amplifica gli errori e le allucinazioni. Se un modello genera un errore fattuale e il modello successivo lo apprende come verità, la falsità diventa la norma statistica dominante, rendendo il sistema inaffidabile e distaccato dalla realtà fattuale in poche generazioni.

Gli esseri umani svolgono un ruolo cruciale come fornitori di quella che viene definita verità fondamentale o ground truth. La produzione umana di cultura, arte e codice è intrinsecamente disordinata, creativa e ricca di eventi rari che le macchine tendono a scartare. Per evitare il collasso, è necessario un afflusso costante di dati umani freschi e organici che servano a ricalibrare gli algoritmi, impedendo loro di stagnare in un ciclo chiuso di riciclo dati.

Per contrastare questo fenomeno, gli ingegneri stanno rivedendo i benchmark di valutazione, misurando parametri come la perplessità e la ricchezza entropica delle risposte, piuttosto che la sola fluidità. Una soluzione tecnica fondamentale è l’integrazione di meccanismi di watermarking o filigrana digitale, che permettono di distinguere i contenuti sintetici da quelli organici. Questo aiuta a preservare riserve protette di dati umani puri da utilizzare per l’addestramento di futuri modelli più robusti.

Hai ancora dubbi su Il paradosso della dieta cannibale: così l’IA perde la sua intellig…?

Digita qui la tua domanda specifica per trovare subito la risposta ufficiale di Google.

Fonti e Approfondimenti

- Wikipedia – Approfondimento tecnico sul fenomeno del Model Collapse

- NIST (Governo USA) – Framework per la gestione dei rischi e l’integrità dei dati nell’IA

- Commissione Europea – Normativa e approccio europeo all’eccellenza e alla fiducia nell’IA

- OCSE – Principi internazionali sulla robustezza, sicurezza e protezione dell’IA

Hai trovato utile questo articolo? C’è un altro argomento che vorresti vedermi affrontare?

Scrivilo nei commenti qui sotto! Prendo ispirazione direttamente dai vostri suggerimenti.